我是先看到了一张极其意料之外的图

我相信

但凡做过一点开发的

都知道我在说什么

于是我就写了一个测试脚本

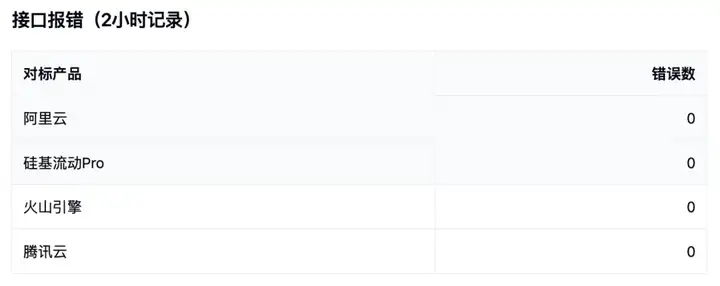

来真实测一下主流 API 供应商

DeepSeek 官方 + 阿里/火山/腾讯云 + 硅基流动

首先我要说

除了 DeepSeek 官方,其他家都很稳定

(这里没有吐槽官方的意思,毕竟情况特殊)

至少我没检测到超时或者断开

而对于速度

我在中国时间:2025-02-13 02:04:41

进行了测试,结果如下

这里是测试记录

https://colab.research.google.com/drive/1cUqspnOrft2Qp9Oq4sGfDzlsJN_WCogl

测试代码在后面

代码我放在了最后,可以自己跑

这个测试方法一点都不复杂,包含以下步骤:

在这里,我用的 Prompt 也非常简单(对于推理模型来说,太长的 prompt 也没意义)

#测试 prompt:

给我写一首七言绝句,赞叹祖国的大好河山

以下是测试切片

按生成速度从高到底排序

测试于中国时间:2025-02-13 02:04:41

测试样本,仅包括我常用的服务商,非常主观

DeepSeek 官方 + 阿里/火山/腾讯云 + 硅基流动

火山引擎:

首 token 响应时间:1.01 秒

Reasoning 部分:318 tokens,用时:8.96 秒,推理速度:35.50 tokens/s

Content 部分:118 tokens,用时:3.12 秒,生成速度:37.76 tokens/s

总体生成:436 tokens,总用时:13.21 秒,平均速度:33.01 tokens/s

硅基流动(Pro):

首 token 响应时间:1.57 秒

Reasoning 部分:180 tokens,用时:7.57 秒,推理速度:23.78 tokens/s

Content 部分:82 tokens,用时:3.35 秒,生成速度:24.48 tokens/s

总体生成:262 tokens,总用时:12.55 秒,平均速度:20.88 tokens/s

DeepSeek 官方:

首 token 响应时间:7.12 秒

Reasoning 部分:496 tokens,用时:22.83 秒,推理速度:21.72 tokens/s

Content 部分:119 tokens,用时:5.39 秒,生成速度:22.06 tokens/s

总体生成:615 tokens,总用时:35.43 秒,平均速度:17.36 tokens/s

腾讯云/腾讯知识引擎:

首 token 响应时间:1.44 秒

Reasoning 部分:629 tokens,用时:47.82 秒,推理速度:13.15 tokens/s

Content 部分:158 tokens,用时:13.85 秒,生成速度:11.41 tokens/s

总体生成:787 tokens,总用时:63.47 秒,平均速度:12.40 tokens/s

阿里云/百炼:

首 token 响应时间:1.44 秒

Reasoning 部分:96 tokens,用时:16.21 秒,推理速度:5.92 tokens/s

Content 部分:34 tokens,用时:5.67 秒,生成速度:6.00 tokens/s

总体生成:130 tokens,总用时:23.51 秒,平均速度:5.53 tokens/s

测试代码如下:https://colab.research.google.com/drive/1cUqspnOrft2Qp9Oq4sGfDzlsJN_WCogl(直接在 Colab 里面跑)

记得先替换 API Key

然后 pip install openai

1. 各家 API 都挺稳定的

2. 火山最快,其次硅基流动,都比官方快

3. 有调查,才有发言权

文章来自微信公众号 “ 赛博禅心 “,作者 金色传说大聪明