生成式 AI 已经改变了我们的交互形态。

最近,各家手机厂商都在不约而同地做着一件事:把生成式 AI 搬上手机。

先是在 10 月份的骁龙峰会上,小米放出消息,能在手机端侧运行的 60 亿参数大模型。

他们提出的 AI 模型搭载在新一代手机系统中,可以回答人们提出的各种复杂问题,帮你生成文章、表格,或是帮你写代码。

荣耀提前展示了下一代旗舰机 Magic 6 的生成式 AI 能力,在手机上通过自然语言发出指令,你就能让 AI 去找你拍摄的素材,寻找合适的部分整合成一段视频。

随后在 11 月份,vivo、OPPO 等厂商发布了新一代旗舰机的生成式 AI 能力,他们的手机系统也将与 AI 实现深度融合。

两周前,号称超越 GPT-4 的谷歌 Gemini 也给这股趋势添了把火。Gemini 是原生的多模态大模型,可以泛化并无缝地理解、操作和组合不同类型的信息,包括文本、代码、音频、图像和视频。

Gemini 的 Nano 版本直接加入了安卓 14 的 Android AICore,可以在手机端侧实现「具有 Bard 体验的高质量智能助手能力」。过不了多久,手机无需连接云端就可以实现包含通话录音自动摘要、输入法自动回复等功能。

安卓手机厂商未来都可以基于 AICore 构建自己的大模型应用,实现不同的效果。谷歌表示,明年还将支持多种第三方应用,以及高通等旗舰手机芯片。

ChatGPT 刚满一周岁,强大的生成式 AI 应用就要进入手机,来到我们身边了。

大模型之所以成为人们追求的目标,是因为它聚合了人类大量的知识与信息,同时可以自如地应用这些信息去解决问题。不仅如此,当前的大模型已经展示出了一些逻辑思维甚至情感的能力。

如果智能程度很高的 AI,可以在人们的指令下利用移动设备上的各类应用实现操纵,手机的体验就会发生巨大的变化。

在这里,从手机厂商到科技公司,大家似乎达成了一种共识 —— 只有让生成式 AI 实现真正的终端运行,这种革命性的技术才能算是真正落地。毕竟只有实现了端侧的大模型推理,我们才能获得无缝的实时响应,也不必将用户个人的数据传输到云端,避免隐私泄露问题。

而实现端侧生成式 AI 的重任,最终还是要落在移动端芯片上。今年 10 月,首个专为生成式 AI 打造的第三代骁龙 8 移动平台打响了手机版生成式 AI 的第一枪。

基于骁龙 8Gen3,最先发布新一代旗舰手机的小米展示了这样的技术:

终端的 AI 模型可以理解你的任意指令,并正确地完成复杂任务,比如写发言稿、写商品评价、拟祝福微信等等。

在手机接入视频会议的时候,大模型可以生成实时的字幕并把内容全程记录下来,会后整合成摘要以供人们参考。

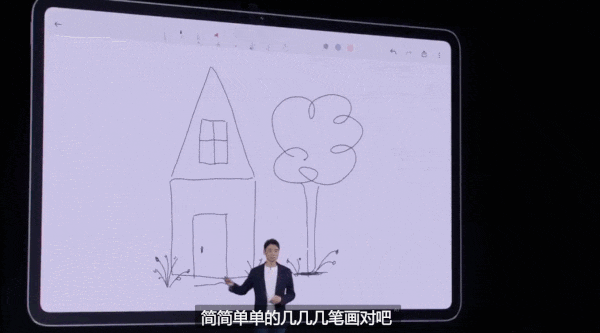

在平板电脑上画画,人们只需勾勒出简单线条的大致形象,剩下的修正、材质和着色交给 AI 脑补就可以了。

在手机的相册中,你可以输入任意形容画面的关键词,AI 会搜索出相关的图片。如果你对照片内容不太满意,比如前景的角色把画面占得太满,还可以一键让 AI 进行扩图。

从最直观的 AI 搜索到复杂的视频创作,生成式 AI 正在改变很多任务上人机交互的形态。而且这还只是个开始,未来的 AI 芯片不仅会让手机速度更快、体验更好,还会通过新技术从根本上改变我们的使用方式。

围绕生成式 AI 加持的系统,很多厂商都预告了手机系统中更加强大的「意图感知」能力,电脑和手机可以更加了解用户本人,会根据人们的使用行为和所处位置,主动提出各项服务,提升工作效率。

到最后,智能手机的使用方式将变成人与 AI 协同工作。当人机交互的形态发生转变时,新一轮变革会在很多行业中发生。

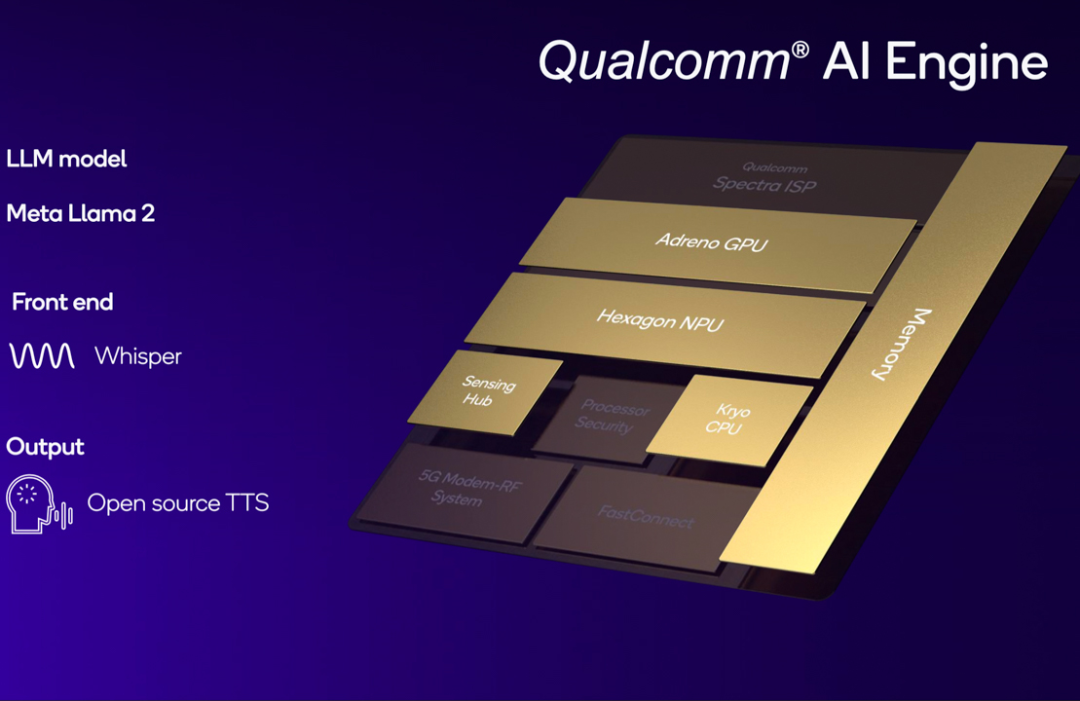

基于新一代高通 AI 引擎,骁龙 8Gen3 实现了前所未有的 AI 性能, 它可以支持在手机端运行 100 亿参数大语言模型,在跑 Llama2-7B 时,每秒能生成 20 个 token。与此同时,8Gen3 跑大模型的实用性也有很大的进步,以往需要占用十几 G 内存才能运行的大模型,经过量化后只需不到 2G,完全足以运行在常规配置的手机上。

骁龙 8Gen3 采用的高通 AI 引擎拥有全新设计的 Hexagon NPU,集成了硬件加速单元和微型区块推理单元,以及全新的张量、标量及矢量单元,所有单元共享两倍带宽的大容量共享内存,内部运行频率更高,内部缓存空间更大,速度相较上代有了显著的提升。

另一方面,骁龙 8Gen3 也进一步提升了 AI 模型的量化能力,其同时支持 INT8+INT16 的混合精度以及 INT4、INT8 等精度。通过异构计算的方式,骁龙 8Gen3 的 Hexagon NPU 的 AI 性能较前代提升 98%,能效也提升了 40%。

除此之外,骁龙 8Gen3 集成的高通传感器中枢也提升了长期待机应用的使用效果,其拥有两个始终感应 ISP、两个 microNPU 和一个 DPS,内存增加了 30%,支持 INT4 精度,AI 性能提升了 3.5 倍。

如此性能,自然能够让人们的使用体验升上一个台阶。今年 2 月份,高通先后展示了搭载骁龙 8Gen2 移动平台的手机运行 Stable Diffusion、ControlNet 的效果,实现了大模型端侧运行的从零到一。在骁龙 8Gen3 上,Stable Diffusion 的推理速度已经从 14.4 秒缩短到了只需 0.6 秒。

短时间内能有这样的速度提升,不禁令人惊叹。

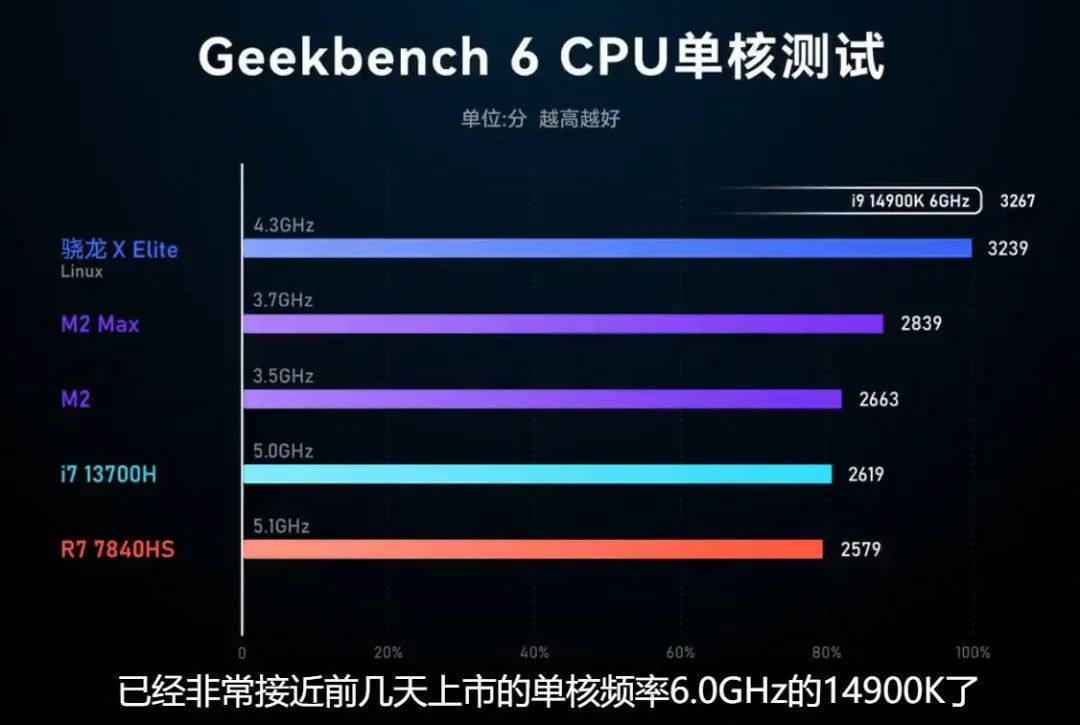

生成式 AI 算力上的突破还不止于手机。在骁龙峰会上,高通宣布了全新的 Arm 架构 PC 平台 Snapdragon X Elite,它采用该公司自研的全新 Oryon CPU,其 CPU 单核性能超过了 M2 Max,在同性能条件下的功耗也要比竞争对手少 30%。

图片来源:极客湾。

骁龙 X Elite 同样专为人工智能打造,目前已支持在端侧运行超过 130 亿参数的生成式 AI 模型,面向 70 亿参数大模型每秒生成 30 个 token,AI 处理速度是竞品的 4.5 倍。预计从 2024 年中期开始,就会有 OEM 厂商会推出搭载 Snapdragon X Elite 的 PC。

对于正在搞大模型军备竞赛的科技公司来说,骁龙 X Elite 来得正是时候,随着 Copilot 能力马上就要加入 Windows 系统,很多即将变革 PC 交互方式的能力正在路上。我们的下一台电脑,也需要有能为生成式 AI 进行加速的芯片。

人们围绕大模型用例的讨论还在持续,高通 CEO 安蒙(Cristiano Amon)最近在与媒体的对话中,畅享了生成式 AI 加持的移动端设备会带来怎样的未来体验。

使用生成式 AI,过去复杂的工作会变得更简单。人们可以无需打开专业软件,仅需发出口头指令就能让 AI 帮助快速剪辑视频中重复的语句,同时保持音画完美同步,仅需要一分钟就能够完成以前五个小时的工作量。

部署在端侧的生成式 AI,也可以让电脑和手机了解用户的习惯和所处位置,利用情境信息让人先行一步。

「假设我正在发短信,我说『很高兴参加这次活动,我还遇到了另一个人』,如果之前我遇到这个人时和他拍了合影。AI 就会在我提到这个人时给出提示,进入相册并识别出这张照片,」安蒙表示。

理想中的机器人能与人进行自然的交流,它们会改变人机交互的方式。(图片来自高通)

接着,AI 会问使用者是否需要分享这张图片,此时 AI 会在应用程序和云端之间进行交互。在同一次对话中,如果用户说「我去伦敦时如果咱俩能约饭就好了」。后续对话问及他人是否能够见面时,日历应用就会显示空闲时间。单击一个时间,AI 就能在另一个不同的应用中发送邀请。

不知我们吐槽过多少次,各家手机厂商的 OS 在新版本升级后看不出有哪些改进,甚至图标重画都会被拿出来当发布会重点。现在不一样了:安蒙表示,我们将看到以应用为中心的用户界面发生改变,生成式 AI 将成为人与应用之间的接口。

生成式 AI 来了,我们正在见证人工智能的「发光 时刻」。在高通看来,它的重要性将会和当初移动互联网的变革一样深刻。

而现在,我们手中设备的芯片已经有能力让 AI 应用无所不在,时刻不停地运行。

命运的齿轮已经开始转动。

我们都在期待,革命性的交互方式会在 2024 年进入每个人手中。

文章来自于微信公众号“机器之心”,作者 “泽南”