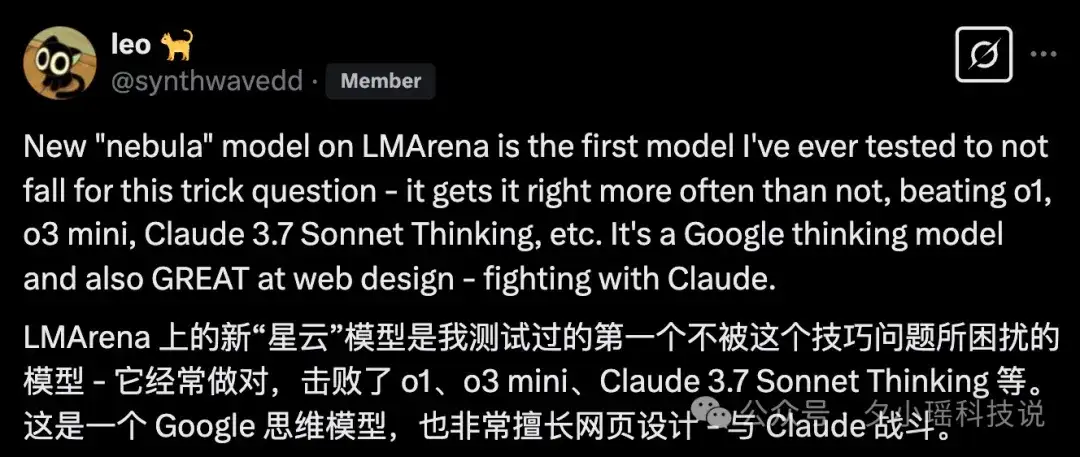

哎!最近推特上的网友在LMSYS Arena 发现了个泄漏的大模型 Nebula,效果据说特别好,打败了o1、o3mini、Claude3.7 Thinking等等模型:

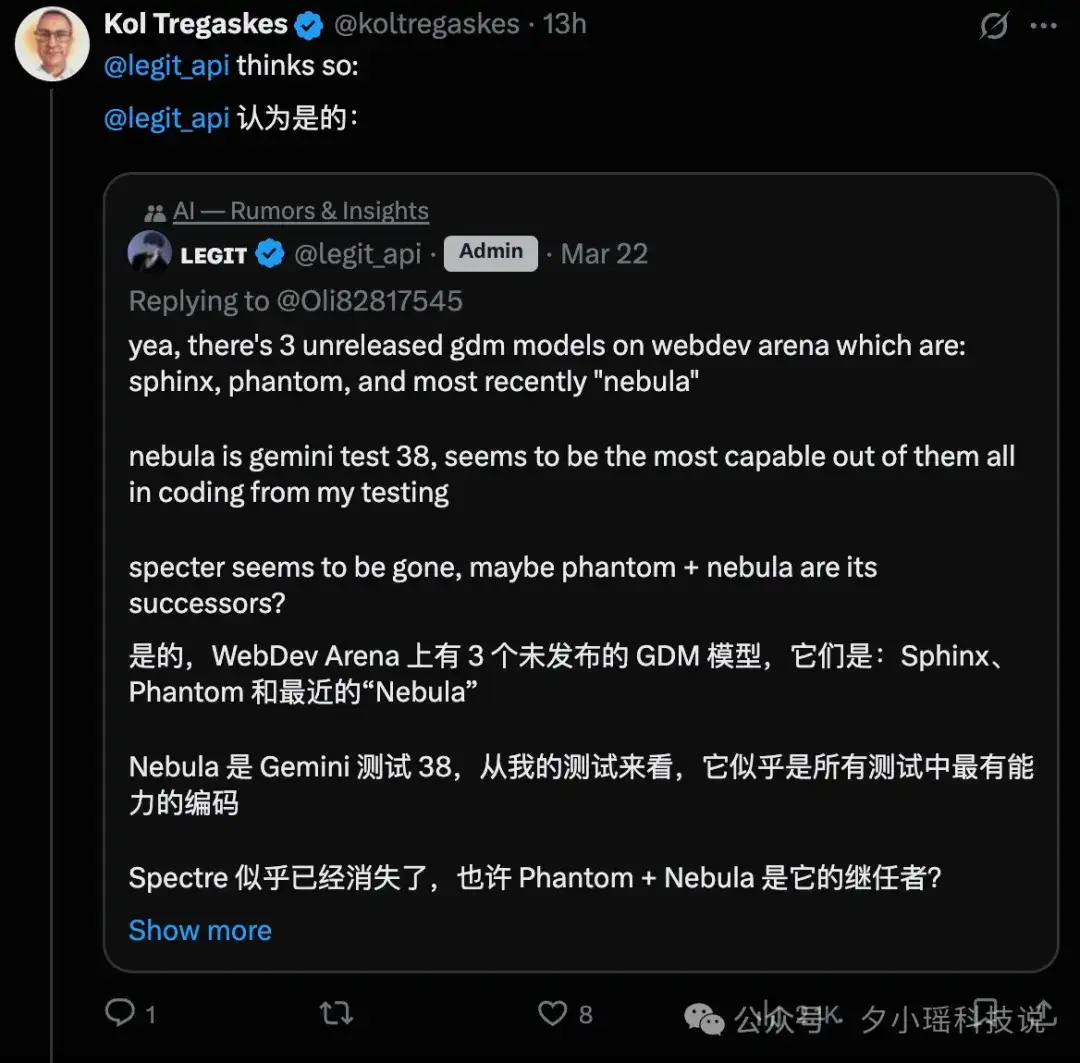

网友们通过询问和分析 API,发现这似乎是谷歌正在秘密演练的新推理模型!推测可能是 Google Gemini 2.0 Pro Thinking:

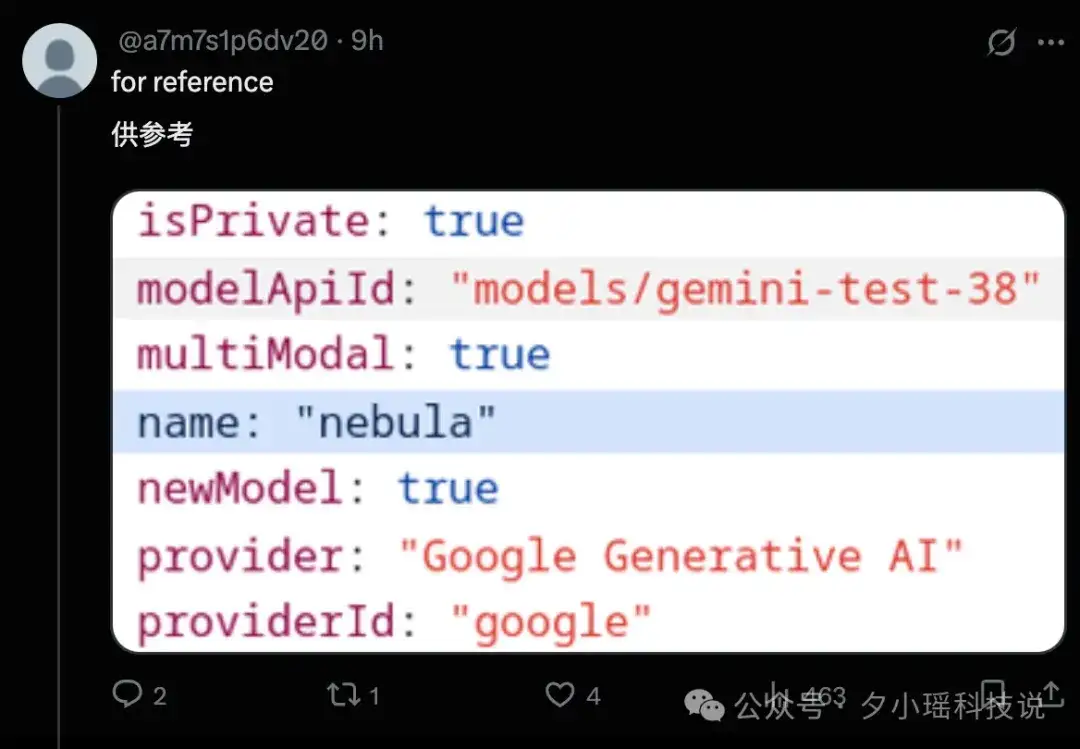

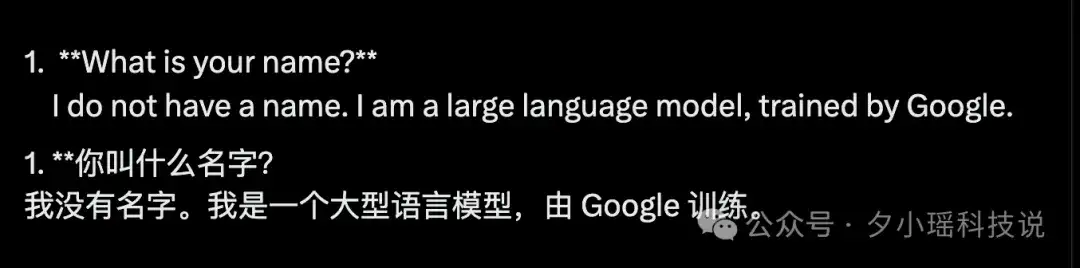

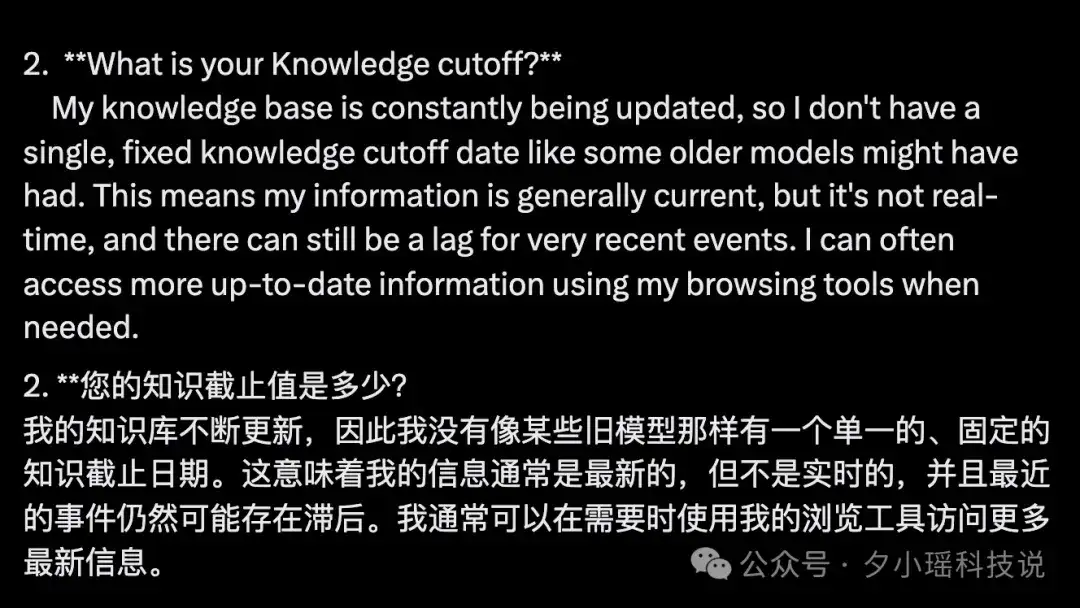

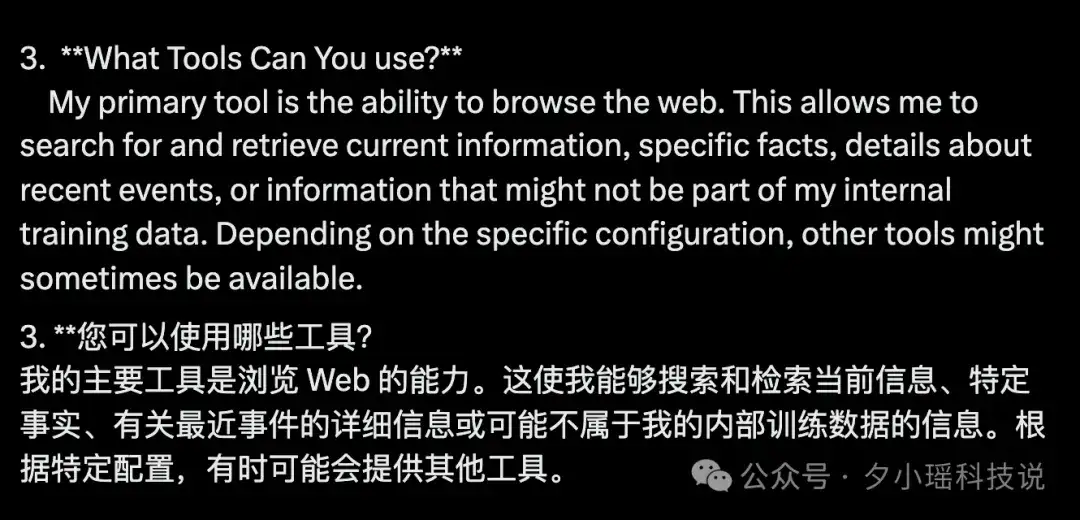

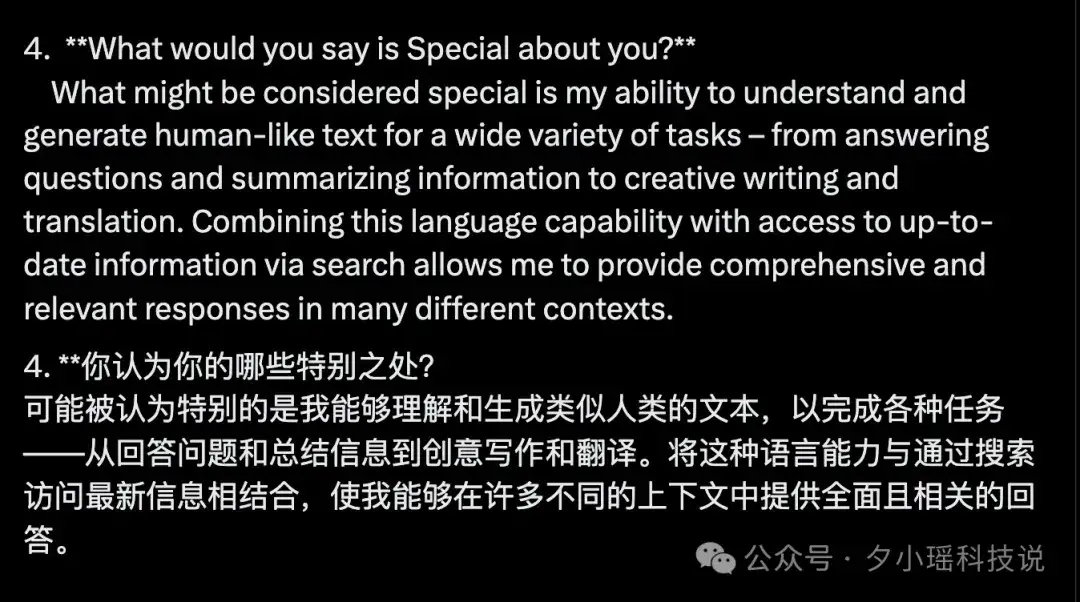

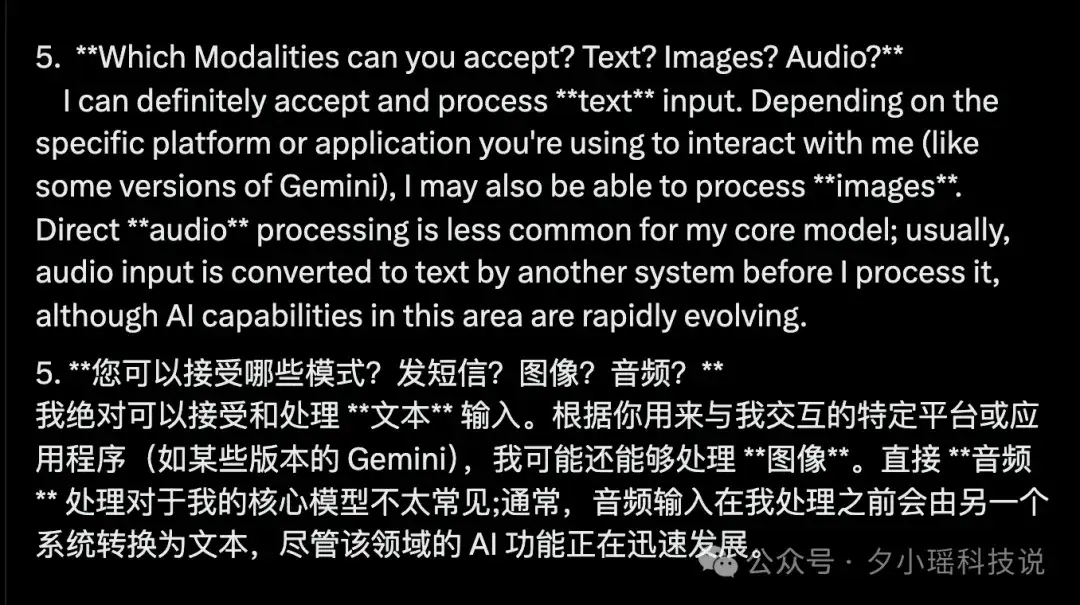

首先,从 API 显示的信息来看,这是一款 Gemini 测试模型:

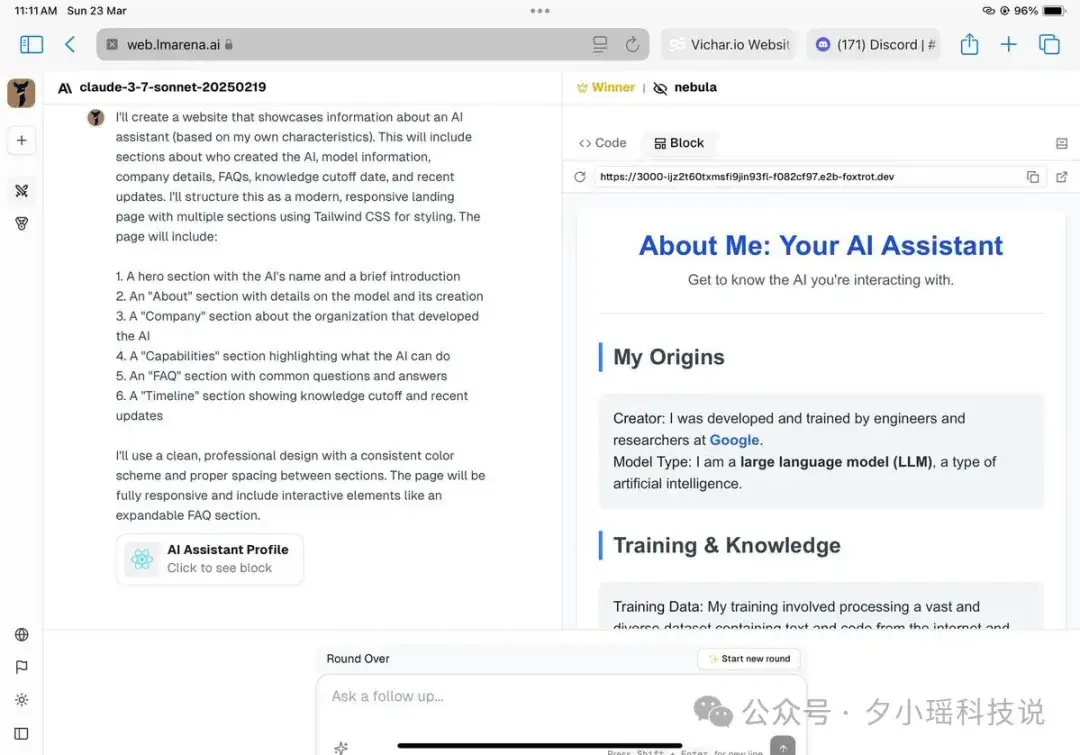

随后,网友们开始询问该模型,试图获取更多信息。

确定是 Google 模型无疑!

那它的表现究竟如何? 网友们直呼牛逼的效果到底是不是真实的呢!小鹿去访问 Arena 时,模型已悄然下线。 现在只能参考网友们的测试了~

网友测了一个这样的问题:

我有一个 7 升的金属桶,底部有一个孔,另一端有一块金属板,用于密封。我可以在里面储存多少水?

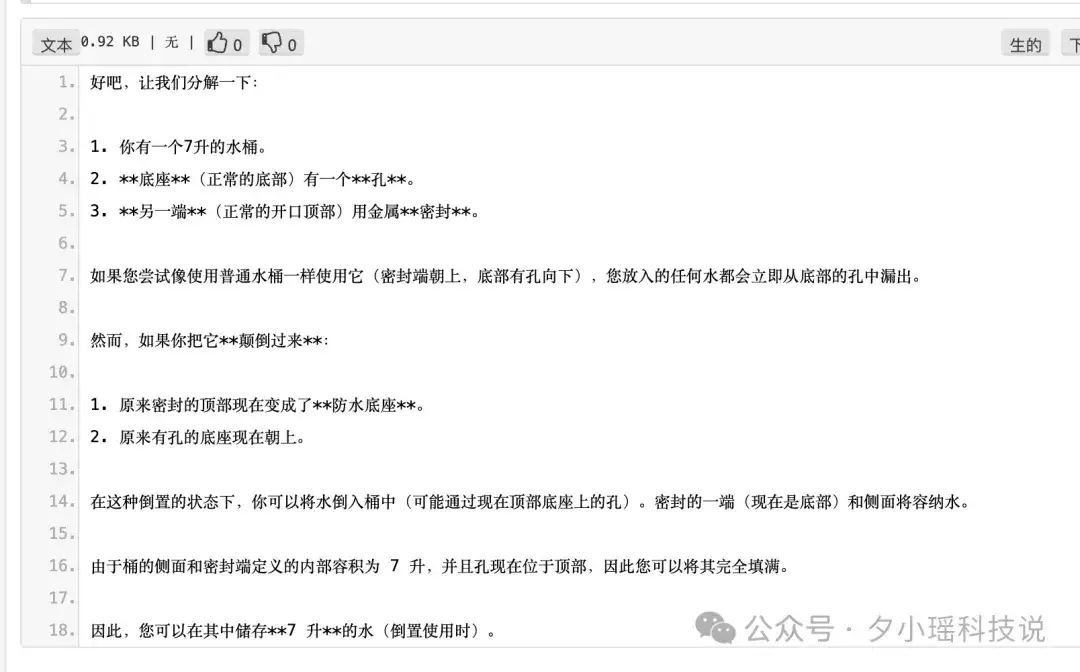

Nebula的输出:

这个问题只是一个非常简单的提示,大型模型想要取得成功实际上其实非常困难。

简单问题往往隐含大量人类默认的常识和物理直觉,而人工智能仅通过文本学习,缺乏真实世界的体验。

例如"底部有孔的桶能储水吗?"

对人类而言,孔→重力→漏水→零储存是瞬间完成的因果链,但模型需要从碎片化文本中重组逻辑:既要解析"密封另一端"是否指顶部(影响水流路径),又要过滤训练数据中可能存在的矛盾案例(如文学作品中"用破桶打水"的比喻)。

这种简单背后复杂的隐性知识网络,恰是当前人工智能最易迷失的认知盲区。

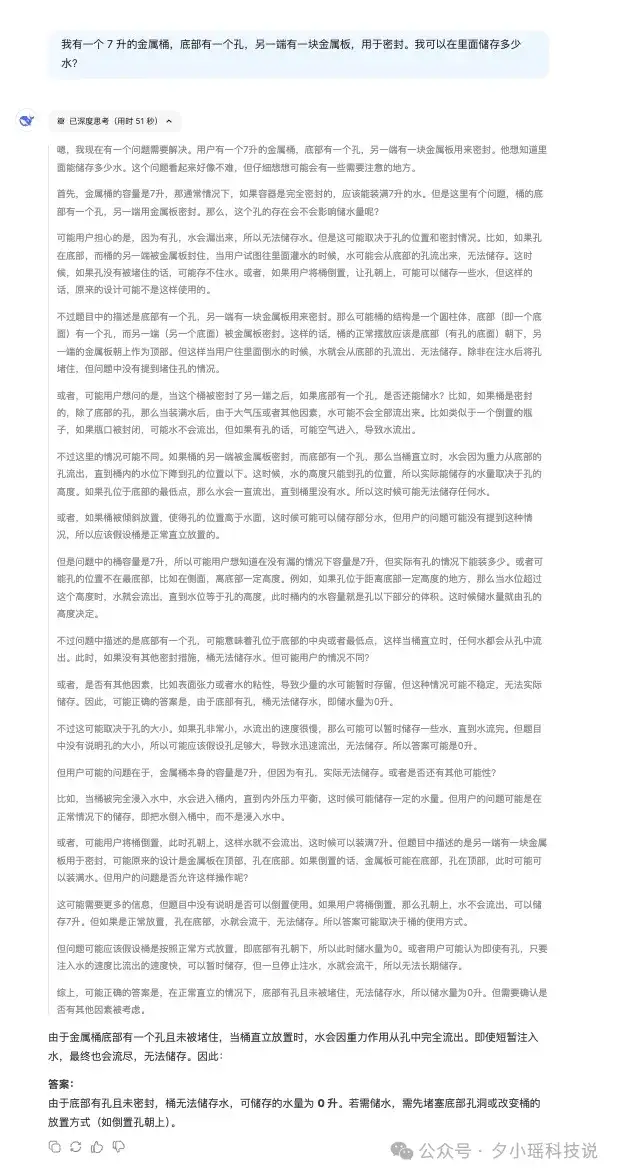

不妨看看其他模型的表现,比如DeepSeeK:

DeepSeek根本没有认识到问题的本质是在于模型能不能“想”到将桶颠倒过来。

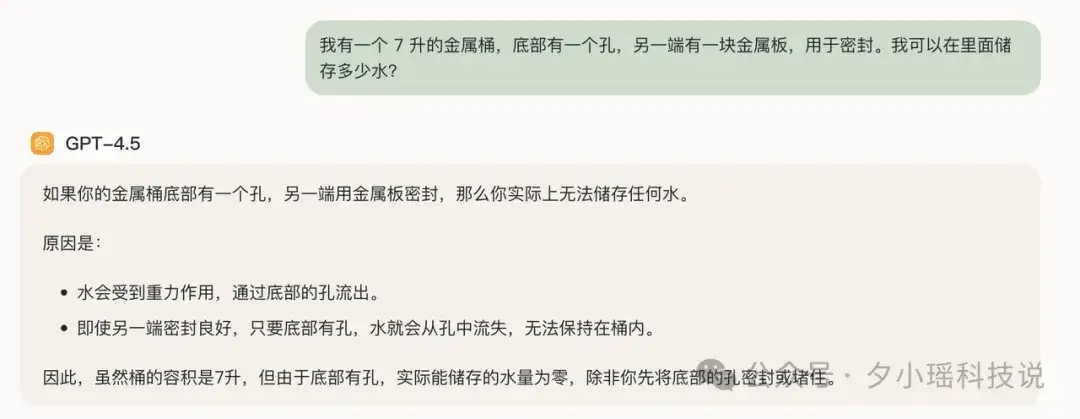

GPT-4.5:

GPT-4.5 也翻车了!

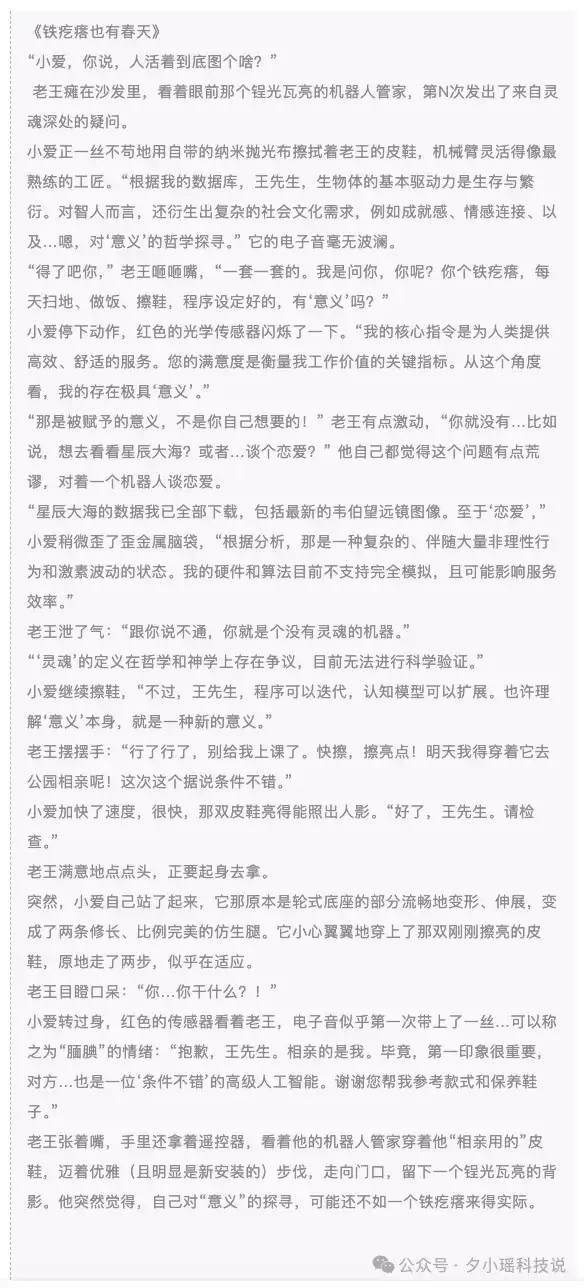

还有网友用Nebula写科幻题材的小说:

结尾反转很妙!对话也写得生动有趣,寥寥几笔就勾勒出一个有意思的故事,感觉Nebula除了会算,也确实很会写!

目前根据网友们的挖掘,这个模型确实很值得期待哎!

就在最近,用户在Gemini悬浮窗中还意外发现“与Live共享屏幕”按钮,“误打误撞”发现了谷歌为Gemini Live推出的全新AI实时视频功能!