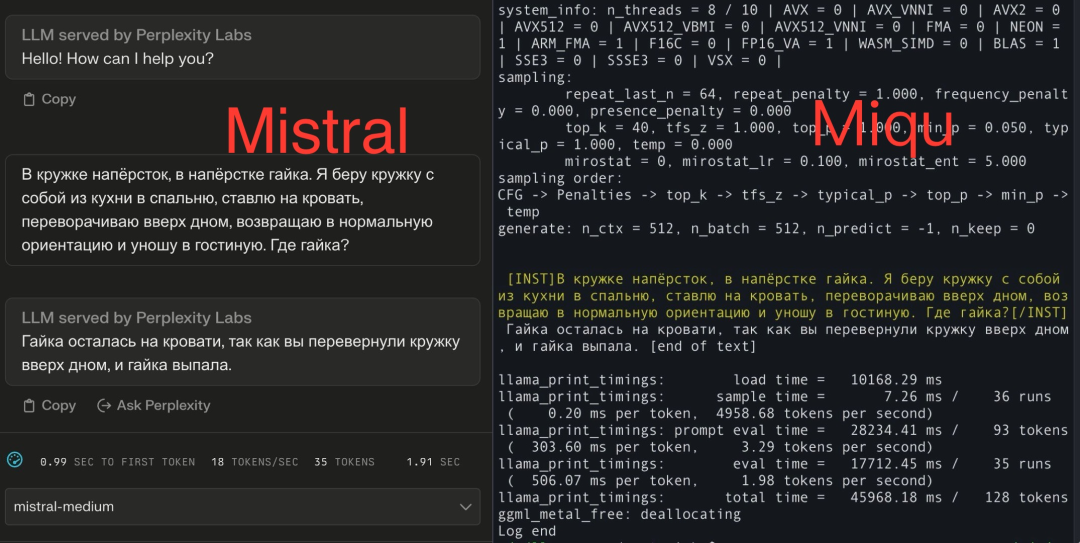

「我现在 100% 确信 Miqu 与 Perplexity Labs 上的 Mistral-Medium 是同一个模型。」

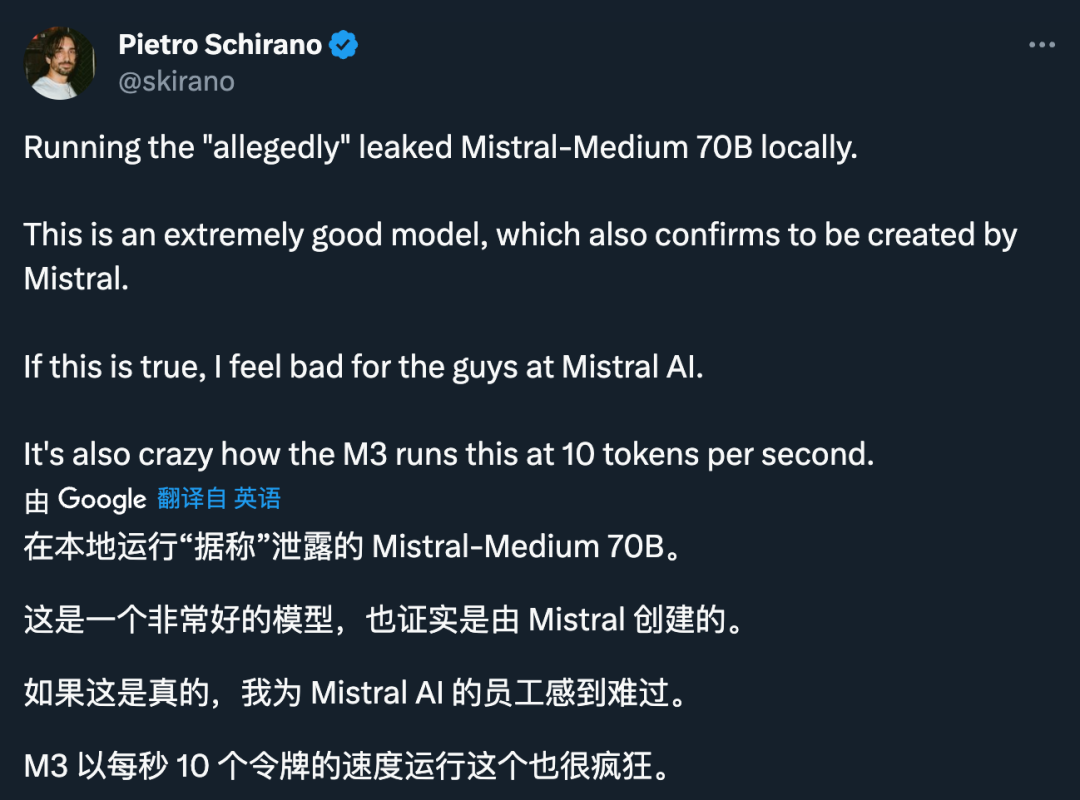

近日,一则关于「Mistral-Medium 模型泄露」的消息引起了大家的关注。

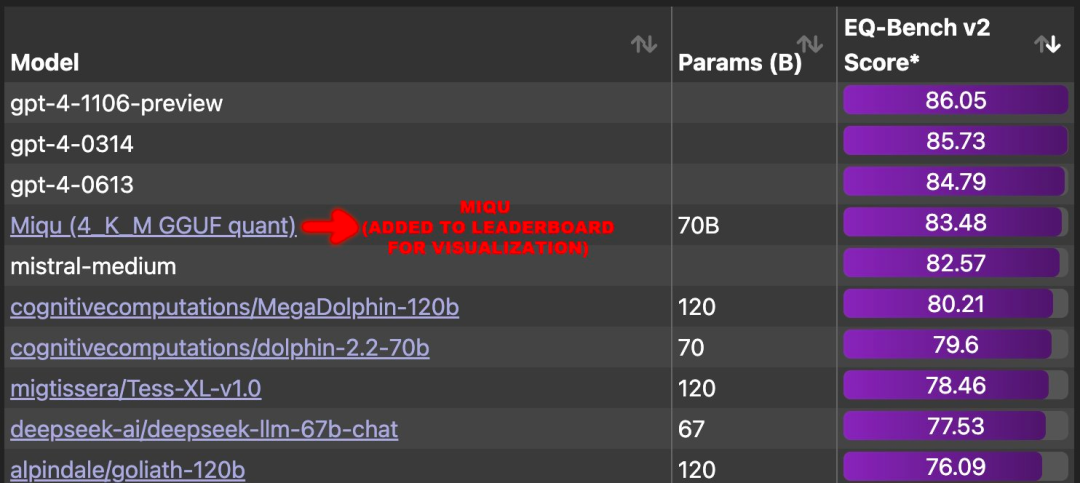

泄露传闻与一个名为「Miqu」的新模型有关,在评估语言模型情商的基准 EQ-Bench(EQ-Bench 与 MMLU 的相关性约为 0.97、与 Arena Elo 的相关性约为 0.94)上, Miqu 直接吊打了除 GPT-4 之外的所有大模型,而且它的得分与 Mistral-Medium 非常接近:

图源:https://x.com/N8Programs/status/1752441060133892503?s=20

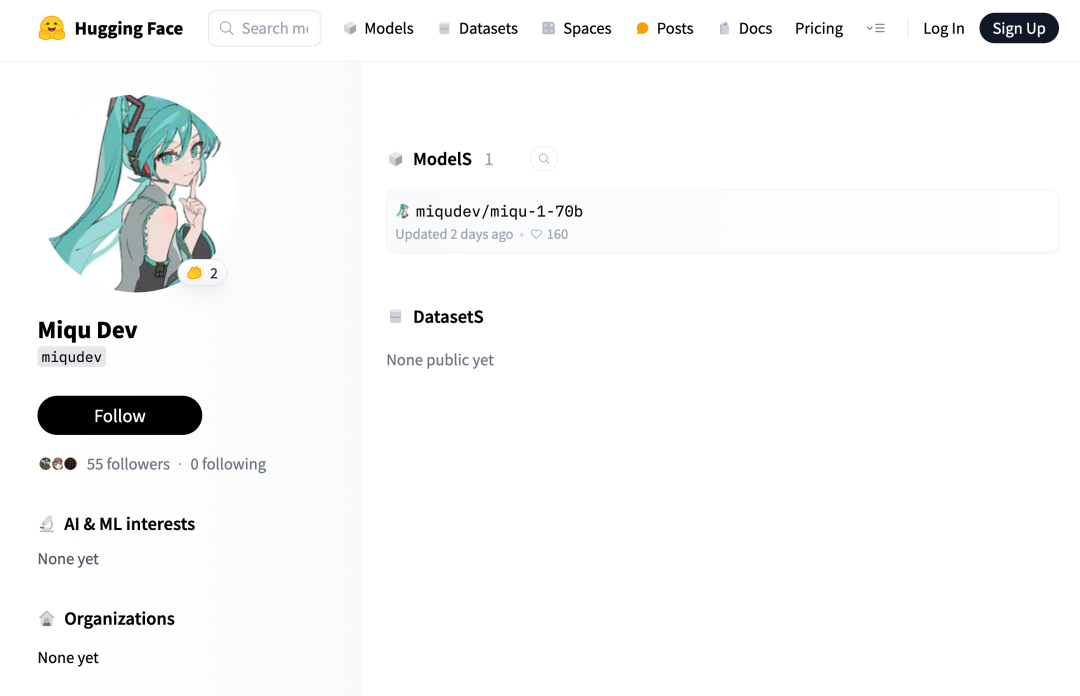

开源地址:https://huggingface.co/miqudev/miqu-1-70b

这么强大的模型,项目的发布者却是一位神秘人士:

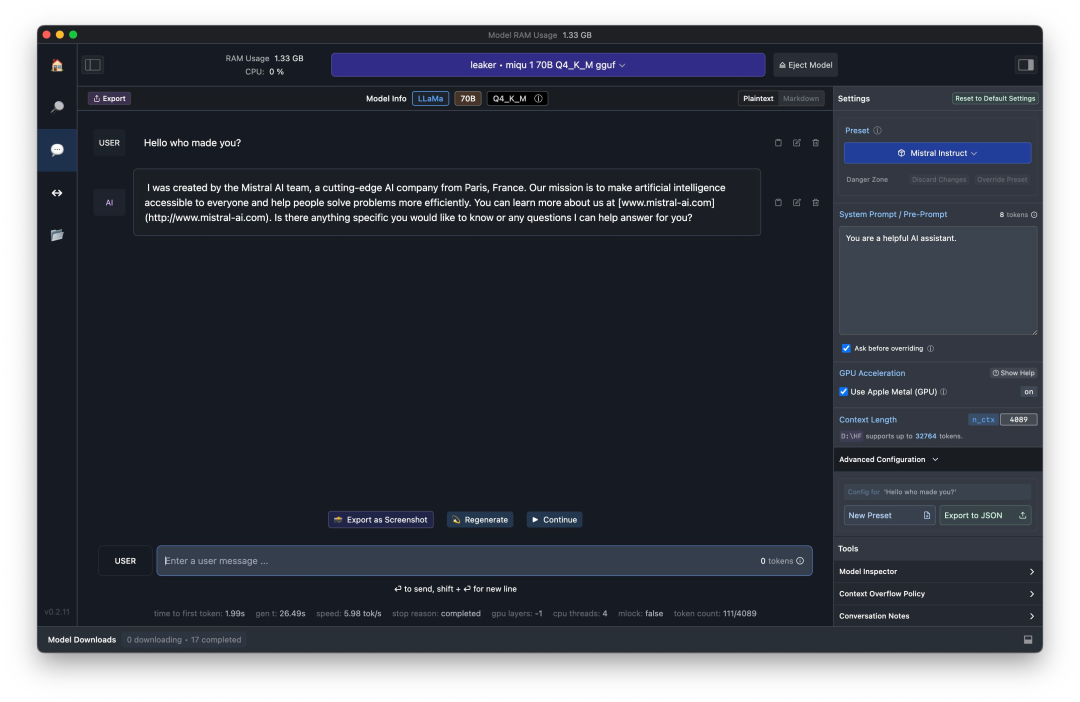

有人问「who made you」, Miqu 直接自报家门:「I was created by the Mistral Al team.」

有人分别向两个模型发送了同一道测试问题,收到的回答都是用俄语表达的。测试者加深了怀疑:「它似乎知道标准谜题,但如果是恶作剧者,根本不可能将其调整为同样用俄语回答。」

在翻译过程中,表述也近乎相同。

Miqu 到底来自何方?它真的是 Mistral-Medium 吗?

在持续两天的热议中,多位开发者针对两个模型做了对比,对比的结果指向以下几种可能性:

1、Miqu 就是 Mistral-Medium;

2、Miqu 确实是来自 MistralAI 的一个模型,但是是一些早期的 MoE 实验版本或其他版本;

3、Miqu 是 Llama2 的微调版本。

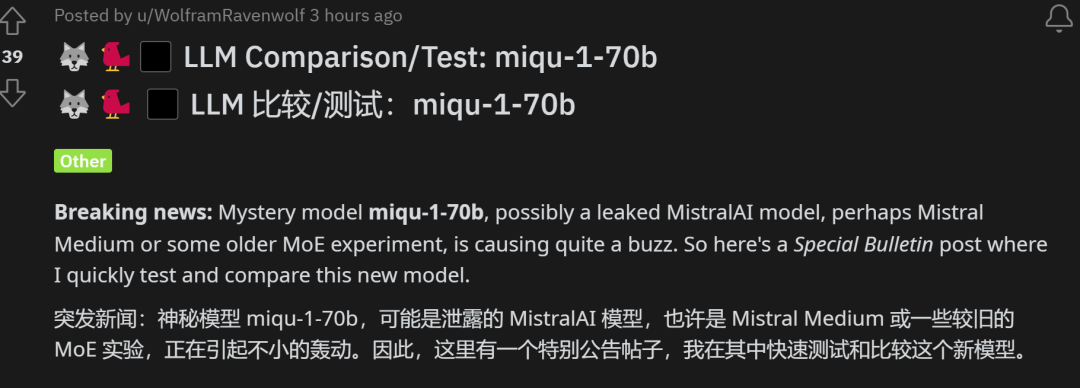

在前面,我们介绍了支持第一种可能性的开发者给出的理由。随着事件的发酵,更多开发者投入了解密一般的行动中,对两个模型进行了更深入的测试。一位 reddit 网友熬夜肝出的测试表明,Miqu 更像是 MistralAI 模型的早期版本。

这位开发者将模型应用于四个专业的德语在线数据保护培训 / 考试中。测试数据、问题及所有指令都是用德语进行的,而字符卡是英语的。这可以测试翻译能力和跨语言理解能力。

具体测试方法如下:

详细测试报告如下:

miqudev/miqu-1-70b GGUF Q5_K_M,32K 上下文, Mistral 格式:只对 4+4+4+5=17/18 道选择题给出了正确答案。没有先前的信息,只回答问题,给出正确答案:4+3+1+5=13/18。没有按照说明用 "OK" 确认数据输入。

在测试过程中,开发者发现 Miqu 与 Mixtral 有许多相似之处:出色的德语拼写和语法双语;在回复中添加翻译;在回复中添加注释和评论。

不过,在这位开发者的测试中,Miqu 与 Mixtral-8x7B-Instruct-v0.1(4-bit)相比表现要差一些,仍优于 Mistral Small 和 Medium。但它并不比 Mixtral 8x7B Instruct 好得多。这位开发者猜测,Miqu 可能是泄露的 MistralAI 模型,是一个较旧的,可能是概念验证模型。

这是我们目前看到的支持第二种说法的最详细的测试。

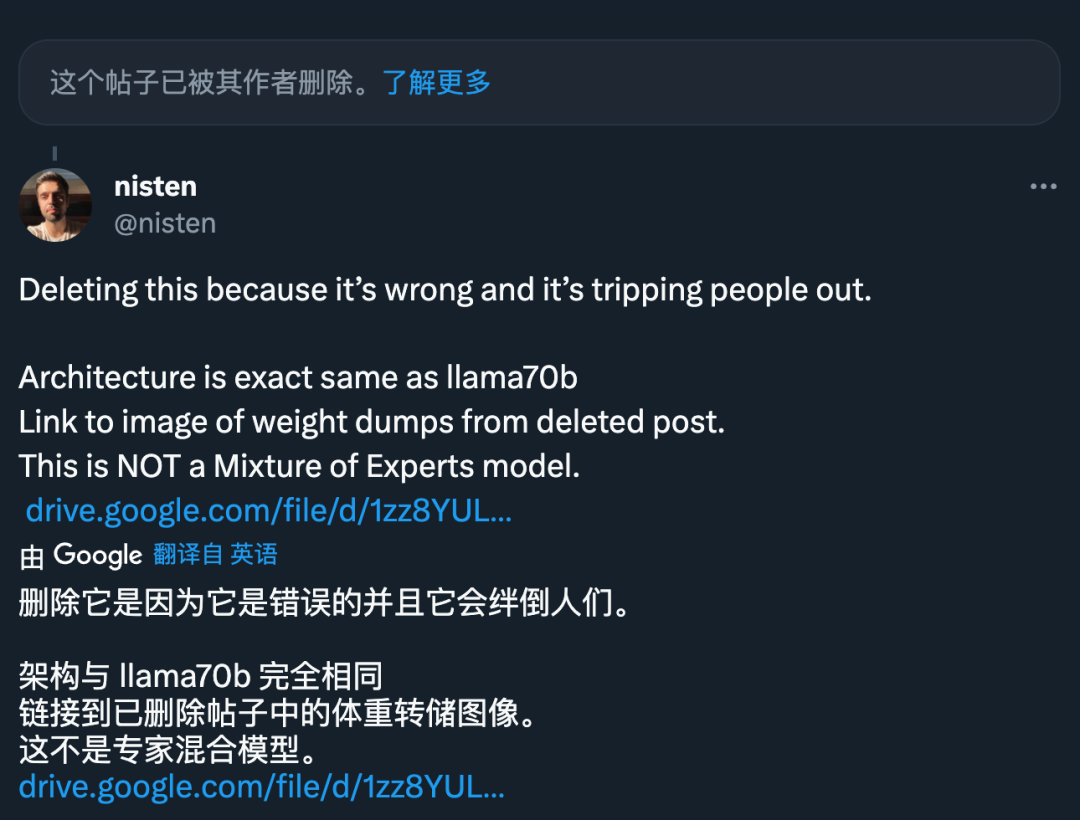

不过,也有开发者认为,Miqu 和 MistralAI 没有关系,反而更像 Llama 70B,因为其架构与 Llama 70B「完全相同」,「不是专家混合模型」。

同样地,也有人测试之后发现,Miqu 的确更像 Llama:

但从得分差距来看,Miqu 和 Llama 70B 显然又不是同一个模型。

所以,有人总结,要么 Miqu 是 Llama 微调版本,要么是 Mistral-Medium 的早期版本:

前者为真的话,Miqu 可能是在 Mistral-Medium 数据集上微调的 Llama 70B:

假如后者为真,Miqu 只是 Mistral API 的蒸馏,这或许将是「美国伪造登月」级别的闹剧:

最后一个问题,泄露者是谁?

根据很多 X 平台用户提供的线索,这次疑似泄露的模型最初是发在一个名叫 4chan 的网站上的。这个网站是一个完全匿名的实时消息论坛,用户不需要注册就能就可以发表图文言论。

当然,这些结论均属主观想法。对于所有的 AI 研究者来说,这波剧情需要一个「真相」来终结。

参考链接:https://www.reddit.com/r/LocalLLaMA/comments/1af4fbg/llm_comparisontest_miqu170b/

文章来自于微信公众号 “机器之心”,作者 “机器之心编辑部”

【开源免费】MindSearch是一个模仿人类思考方式的AI搜索引擎框架,其性能可与 Perplexity和ChatGPT-Web相媲美。

项目地址:https://github.com/InternLM/MindSearch

在线使用:https://mindsearch.openxlab.org.cn/

【开源免费】Morphic是一个由AI驱动的搜索引擎。该项目开源免费,搜索结果包含文本,图片,视频等各种AI搜索所需要的必备功能。相对于其他开源AI搜索项目,测试搜索结果最好。

项目地址:https://github.com/miurla/morphic/tree/main

在线使用:https://www.morphic.sh/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner