无论晴天雨天,都是中国AI和云计算的赶路天

围绕AI算力展开的政治博弈,一直在此起彼伏地发生着。

不过,事情也在悄然发生变化。

我们发现,那种“美国一禁运,中国就破防”的紧张情绪,已经减弱了很多。

前不久,美国商务部出了一份《采取额外措施应对与重大恶意网络行为相关的国家紧急状态》提案,提出:禁止中国公司使用美国的云计算资源来训练AI模型。

这相当于AI芯片禁运的“补丁”。美国商务部长吉娜·雷蒙多在采访时提到,美国的云数据中心也大量使用AI芯片,而美国对芯片实施了出口管制,也必须考虑关闭这条路径。

这一次,中国AI业内和大众的情绪都还算稳定。

一方面表现在语言上。AI行业群内对这个提案的讨论都很少,并不是讳莫如深,而是一种“早已料到”的淡定,倒是对国产算力替代、通用算力训练AI等话题的关注度,不断提升。

另一方面表现在行动上。各个AI企业、大模型公司,也并没有急着“下美国云”,或是紧急研究什么避险方案。要知道之前英伟达H100和A100芯片被禁运时,产业各方都迅速反应,英伟达随即推出定制版,国内大厂疯抢囤货,紧张感拉满。

同样是对AI算力的限制,为什么美国云基础设施,不再让我们 “汗流浃背”了?从一张“哑火”的AI禁令背后,我们可以读到很多。

先说结论:没多大。

可能有人要急了,AI算力供需本就紧张,芯片不让卖、云也不给用,你还说没事,心也太大了吧?

知道你很急,但你先别急。

第一,美国云厂商在国内公有云市场的份额很小,并且越来越小。

按美国商务部长的说法,被要求审核中国AI公司身份的美国基础设施即服务 (IaaS) 提供商,主要包括亚马逊AWS、微软Azure、英伟达算力云等。

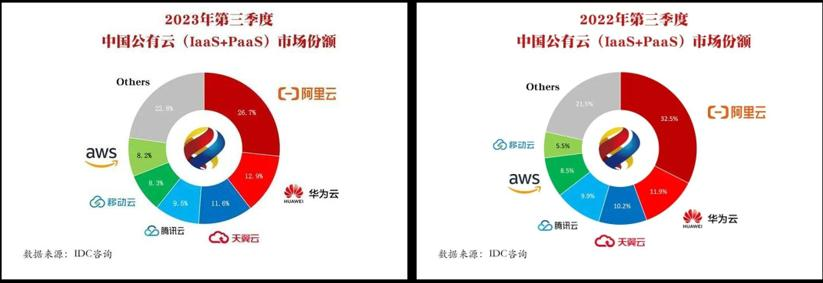

微软Azure、英伟达算力云的中国市场份额,小到无法拥有姓名。IDC近日发布的《中国公有云服务市场(2023年第三季度)跟踪》报告显示,2023年第三季度,中国公有云(IaaS+PaaS)市场中,唯一占据一席之地的美国云服务商是AWS,其市场份额也只有8.2%。并且相比2022年第三季度的8.5%,占比还有所下降。所以说,受该禁令影响的中国用户数量并不多。

第二,美国云厂商的中国用户,使用量也都不大。

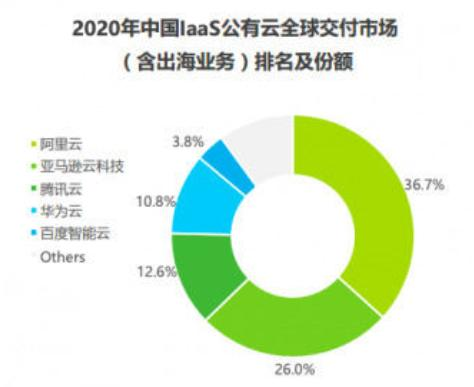

目前使用AWS、azure等美国云数据中心的中国用户,以外企的中国机构、出海中企、混合部署等需求为主。艾瑞咨询曾在《2021年中国基础云服务行业数据报告》中,首次增加了“出海业务”,亚马逊AWS的市场排名立马从第五挺进前三,说明其国内业务的“出海”比例极高。

外企在中国、中企走出去,是一个目前还不算主流的边缘市场。而混合多云部署的中国政企客户,“不把鸡蛋放在同一个篮子里”,目的是分散风险,美国厂商的云本身就是“备胎”,当然也不会将太多核心业务放在上面。

(艾瑞咨询:2021年中国基础云服务行业数据报告)

第三,美国云的AI黏性有限,中国主流的AI大模型及应用都在国内云上。

有人会担心,微软云azure支持OpenAI那么领先的大模型,还有各种AI套件,肯定会吸引一部分国内用户,通过云访问调用其AI能力吧?

一方面,OpenAI的大模型并不向大陆开放,IaaS层面的计算资源差异性不大,海外云的吸引力也就大打折扣。另外,要让AI模型跑得“多快好省”,不仅要有万卡集群的硬实力,还需要软硬协同优化、异构硬件兼容、开发工具链、社区生态,甚至商业资源、联合开发等各种支持,国内云厂商无疑更具本土化优势,也成为中国产学研用机构做AI的首选。

政企客户和国计民生关键行业,自主可控已经成为共识,纷纷选择成为国内云厂商的客户。2023百度云智大会的一组数据显示,千帆大模型平台上的月活企业数,已近万家。

具备底层技术的中国AI大模型企业,更是从一开始,就将大模型部署在国内的云上。2023年7月,讯飞星火就与华为昇腾AI联合,让国产大模型架构在自主创新的软硬件基础之上,打造国产通用智能新底座。最新升级的讯飞星火认知大模型 V3.5,也强调自己是“国产算力原生模型”。

所以说,美国云服务商在中国大陆的市场份额少,业务体量小,AI黏性又不够强,因此对中国AI的影响有限,从而导致了此次禁令的“哑火”。

这样会不会出现一种情况,像20世纪熊猫EDA那样,美国一看禁了个寂寞,干脆放开来抢市场,国内用户就流向了海外云平台?

大概率也是不会出现的。

因为国产算力并不只有安全自主可控这一个“卖点”,性价比优势对中国AI产业界也很有吸引力,而这是英伟达AI芯片很难取代的。

坦率地说,我们的芯片制造工艺确实还做不出顶级的强大芯片,性能上不比N卡强,为什么国产算力还能有高性价比呢?

高性价比的背后,是国内云厂商从三个角度的努力:

一是自建多样化的国产算力平台。

除了英伟达的高端GPU,国产AI芯片、通用CPU算力、超算中心算力,也都能处理AI专项任务,而且成本上更具优势。目前,云厂商都在强化对国产硬件的兼容性,积极构建国产算力体系。

具体来说,华为的AI芯片制造技术已经开始取得突破,昇腾系列稳定出货,在某些性能上甚至超越了英伟达的中国特供版。海光、华为、飞腾等自主设计开发的CPU/DCU芯片,既可以确保自主可控,也容易规模化量产。已经建好的超算中心,也可以为AI提供算力服务。

多样化、异构的国产算力体系,可以缓解AI和云计算对高端GPU的紧缺。

记得一位中科院的科学家跟我说过:等到智算、超算没有分界线的那一天,中国AI可能就真的崛起了。而国产算力从硬件走上云端,转变为AI云服务,正在加速这一天的到来。

二是算力网络的一体化调度。

OpenAI训练ChatGPT等采用的是“集中式”算力,即万卡集群。中国没有那么多先进的卡怎么办?用“分布式”算力,把各个地区的算力网互联互通,一样可以给AI企业提供算力服务。

举个例子,北京、上海、广州、武汉等地都有2000块卡的算力中心,把它们通过专网联合起来,就能组建起一万块、两万块卡的算力平台,代替一个万卡集群,来做超大规模数据训练。

“分布式”算力,就需要把分布在全国各地的智算中心、云计算中心、超算中心给联接起来。早在2020年,国家多部门就出台了《关于加快构建全国一体化大数据中心协同创新体系的指导意见》,建立横跨东西的算力网络与数据存算一体化节点,可以有效调节中国算力供需。通过统一算力调度平台,可以将数据源周围的闲置算力资源调度起来,更高效地满足AI产业各界的巨大需求。

三是技术创新的算力榨取。

当然,国产算力要在性能上达到顶级GPU的能力,确实有些为难。所以,尽可能地榨取国产算力,让其精准适配AI训练推理等任务的需求,会让资源利用率更高,成本效益更加显著。

提升算效,发挥出每一张卡的价值,需要一系列创新技术的支持,软硬件联合优化,计算行业与AI行业的协作。云厂商联合基础设施供应商、AI产研各方,积极开展技术创新,提升算力训练效率。

比如,百度智能云千帆平台,就通过分布式并行训练策略和微秒级互联能力,让万卡训练集群的加速比达到95%,也就是发挥出了95%比例的机器的效能。

总结一下,让中国AI发展不掣肘于芯片供应,国内云厂商真的很努力。

今天再面对一纸“禁令”,中国AI也可以淡定地说一句:不是N卡用不起,而是国产算力更有性价比。

如今,对于AI算力,或许我们可以暂时放下紧张情绪,对相关禁令松一口气了。

必须强调一点,自主可控不是为了全面替代。彻底脱离海外AI软硬件的供应链,既不现实,也没有经济效益。

有句话说得好,要把枪放在谈判桌上。

当我们有了自主的AI基础设施,自己的AI软硬件开发生态,不用担心“美国一禁运,就没有算力用”,对方没有了“博弈”的筹码,一通操作结果禁了个寂寞,自然也就没有必要再继续折腾了。如此,才有可能避免“擦枪走火”,让算力供应维持一个比较平衡和稳定的外部环境。

所以说,备战是为了不战。

当然,一波又一波的禁令也表明,围绕AI这一关键领域的博弈只会愈演愈烈。昨天禁芯片,今天禁云服务,明天禁什么不知道,但禁令一定会“虽迟但到”。

这种局势下,我们也要做好更多准备,才能在较量中获得话语权。

云计算作为中国AI的战略支柱,国内云厂商想要接住“泼天的富贵”,接下来还有许多工作要做:

1.做好国内算力基础设施与一体化算力网络的有效应用。

比如AI芯片种类繁多,既有不同品类,也有不同版本,兼容难度非常大,AI企业想用到最合适的芯片,有较高的切换成本,云平台对国产芯片的兼容性更强,能够减少企业AI训练的难度。再比如,算力网互联以后,异构算力怎么标识、怎么调度、怎么计费、通信协议怎么解决、资源配置效率怎么提升……这些问题都是需要持续解决的,也构成了国内云厂商的机遇。

2.提供全栈AI能力和完善的迁移服务。

AI大模型的技术复杂性也带来了采用、部署等方面的挑战,云厂商可以通过更友好、全面的AI能力和迁移能力,支持行业客户与开发者,建立起自己的AI生态系统,收获业务增长。

3.加强出海业务及服务能力。

前面提到,禁令的影响范围,可能是AWS上一些外企在华、中企出海的业务。这也提醒我们,中国的云服务商,不能故步自封,要积极出海,给中国企业在海外,搭建一条可信、可靠的通道,支撑它们海外业务的持续开展。目前,拥有全球化经验和业务布局的华为云,已经加速了欧洲、中东等市场的脚步,给中企出海、外企入中一个“更好的选择”。

莫听穿林打叶声,何妨吟啸且徐行。这些技术、产品与解决方案,汇合成一条中国AI前进的云端通道。让我们可以看到禁令,从容以对。因为AI基础设施,中国已经做好了准备。

文章来自于微信公众号 “脑极体”(ID:unity007),作者 “藏狐”