Mistral又惊喜上新了!

就在今天,Mistral发布了两款小模型:Mathstral 7B和Codestral Mamba 7B。

首先是专为数学推理和科学发现设计的Mathstral 7B。

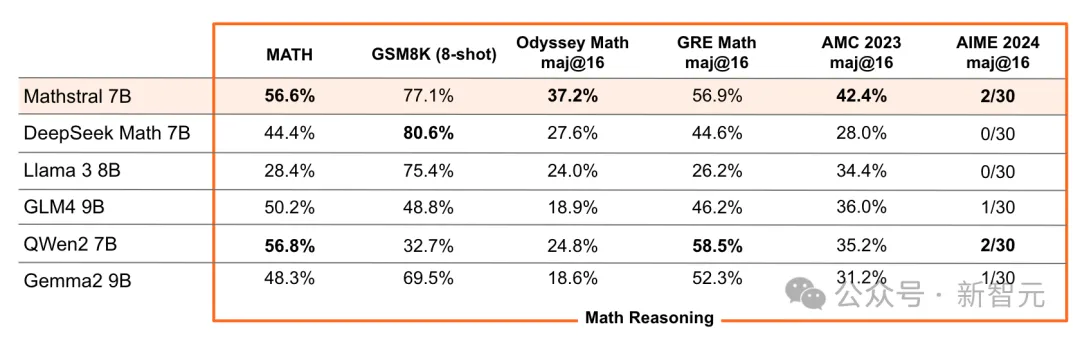

在MATH基准测试中,它获得了56.6% pass@1的成绩,比Minerva 540B提高了20%以上。Mathstral在MATH上的得分为68.4%,使用奖励模型得分为74.6%。

而代码模型Codestral Mamba,是首批采用Mamba 2架构的开源模型之一。

它是可用的7B代码模型中最佳的,使用256k token的上下文长度进行训练。

两款模型均在Apache 2.0许可证下发布,目前权重都已上传HuggingFace仓库。

Hugging Face地址:https://huggingface.co/mistralai

Mathstral

有趣的是,根据官宣文章,Mathstral的发布恰好庆祝了阿基米德2311周年诞辰。

Mathstral专为STEM学科设计,以解决需要复杂、多步骤推理的高级数学问题。参数仅有7B,上下文窗口为32k。

而且,Mathstral的研发还有一个重量级的合作伙伴——上周刚刚在Kaggle第一届AI奥数竞赛中得到冠军宝座的Numina。

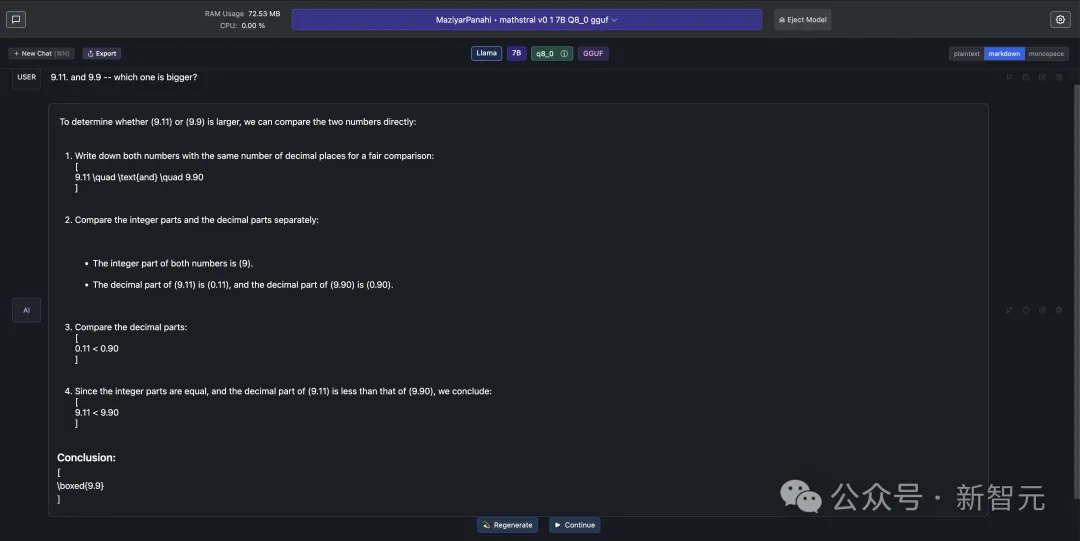

而且,有推特网友发现,Mathstral可以正确回答「9.·11和9.9哪个更大」这个难倒一众大模型的问题。

整数、小数分开比较,思维链清清楚楚,可以说是数学模型优秀作业的典范了。

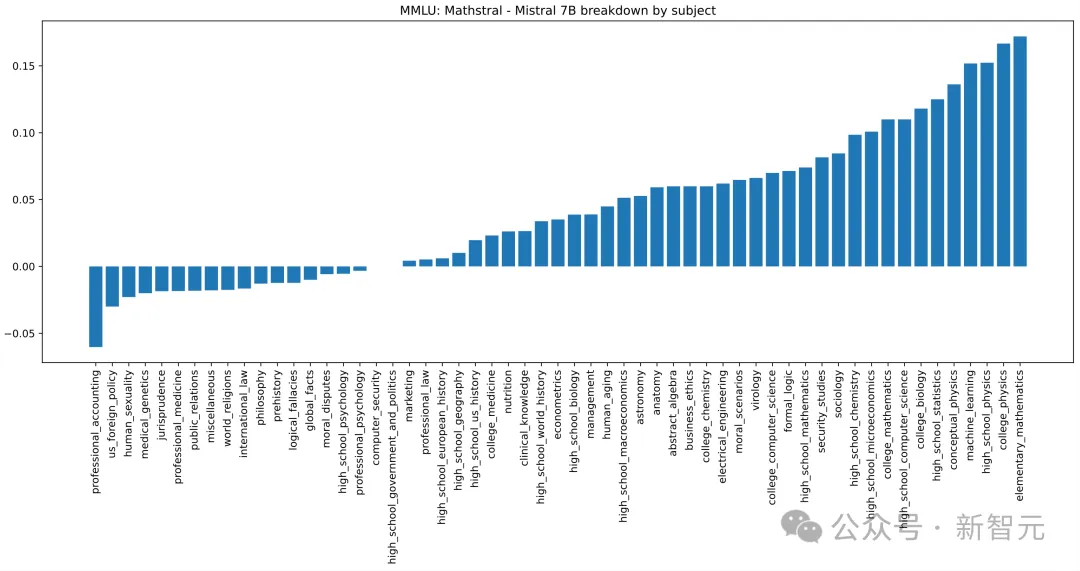

基于Mistral 7B的语言能力,Mathstral进一步聚焦STEM学科。根据MMLU的学科分解结果,数学、物理、生物、化学、统计学、计算机科学等领域都是Mathstral的绝对优势项目。

根据官方博客文章的透露,Mathstral似乎牺牲了一些推理速度以换取模型性能,但从测评结果来看,这种权衡是值得的。

在多个数学、推理领域的基准测试中,Mathstral打败了Llama 3 8B、Gemma2 9B等流行的小模型,特别是在AMC 2023、AIME 2024这类数学竞赛题上达到了SOTA。

而且,还可以进一步增加推理时间以取得更好的模型效果。

如果对64个候选使用多数投票(majority voting),Mathstral在MATH上的分数可以达到68.37%,进一步添加额外的奖励模型,还能取得74.59%的高分。

除了HuggingFace和la Plateforme平台,还可以调用官方发布的Mistral-finetune和Mistral Inference两个开源SDK,使用或微调模型。

Codestral Mamba

继沿用Transformer架构的Mixtral系列发布后,第一个采用Mamba2架构的代码生成模型Codestral Mamba也问世了。

而且,研发过程也得到了Mamba原作者Albert Gu和Tri Dao的协助。

有趣的是,官宣文章专门cue到了和????有关的「埃及艳后」Cleopatra七世,她就是戏剧般地用一条毒蛇终结了自己的生命。

Mamba架构发布后,其优越的实验性能得到了广泛的关注和看好,但由于整个AI社区在Transformer上投入了太多成本,我们至今也很少看到实际采用Mamba的工业界模型。

此时,Codestral Mamba恰好能为我们提供研究新架构的全新视角。

Mamba架构首发于2023年12月,两位作者又在今年5月推出了更新版的Mamba-2。

与Transformer不同,Mamba模型具有线性时间推理的优势,并且理论上能够建模无限长度的序列。

同为7B模型,Mathstral的上下文窗口只有32k时,Codestral Mamba却能扩展到256k。

这种推理时间和上下文长度方面的效率优势,以及实现快速响应的潜力,在用于提升编码效率的实际场景中尤为重要。

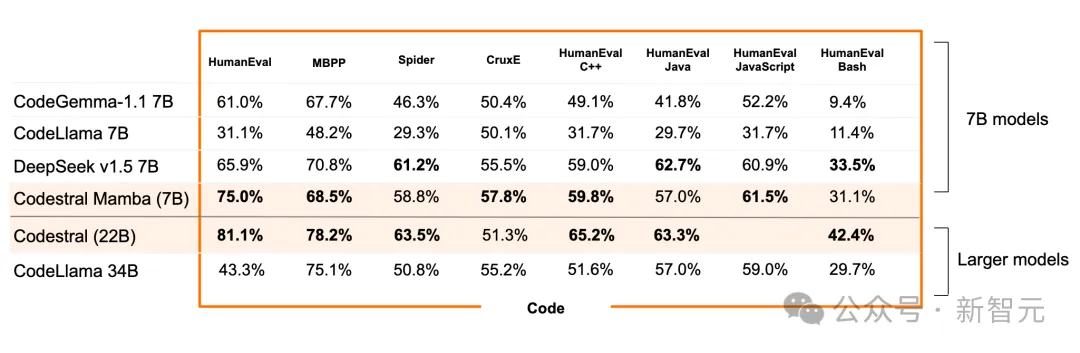

Mistral团队正是看到了Mamba模型的这种优势,因而率先尝试。从基准测试来看,7B参数的Codestral Mamba不仅比其他7B模型有明显优势,甚至可以和更大规模的模型掰掰手腕。

在8个基准测试中,Codestral Mamba基本达到了和Code Llama 34B相匹配的效果,甚至在其中6个测试上实现了性能超越。

然而相比大姐姐Codestral 22B,Codestral Mamba的参数量劣势就体现出来了,依旧显得能力不足。

值得一提的是,Codestral 22B还是不到两个月前发布的新模型,再次感叹一下总部在巴黎的Mistral竟如此之卷。

Codestral Mamba同样可以使用Mistral-inference部署,或者英伟达发布的快速部署API TensorRL-LLM。

GitHub地址:https://github.com/NVIDIA/TensorRT-LLM

对于本地运行,官方博客表示,可以留意后续llama.cpp的支持。但ollama行动迅速,已经将Mathstral加入到了模型库中。

面对网友催更codestral mamba,ollama也非常给力地表示:「已经在弄了,稍安勿躁。」

文章来源于“新智元”,作者“新智元”