AI 换脸的风,这次吹到了网课界。

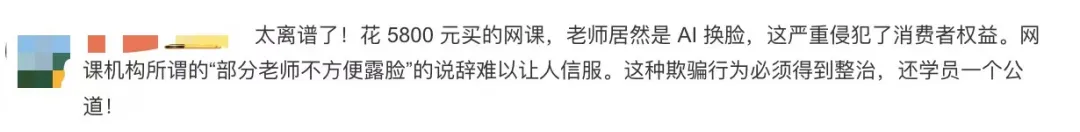

花了 5800 块从专业补习机构购买的网课,不仅教材上有多处错字漏字,老师甚至也是「假的」。

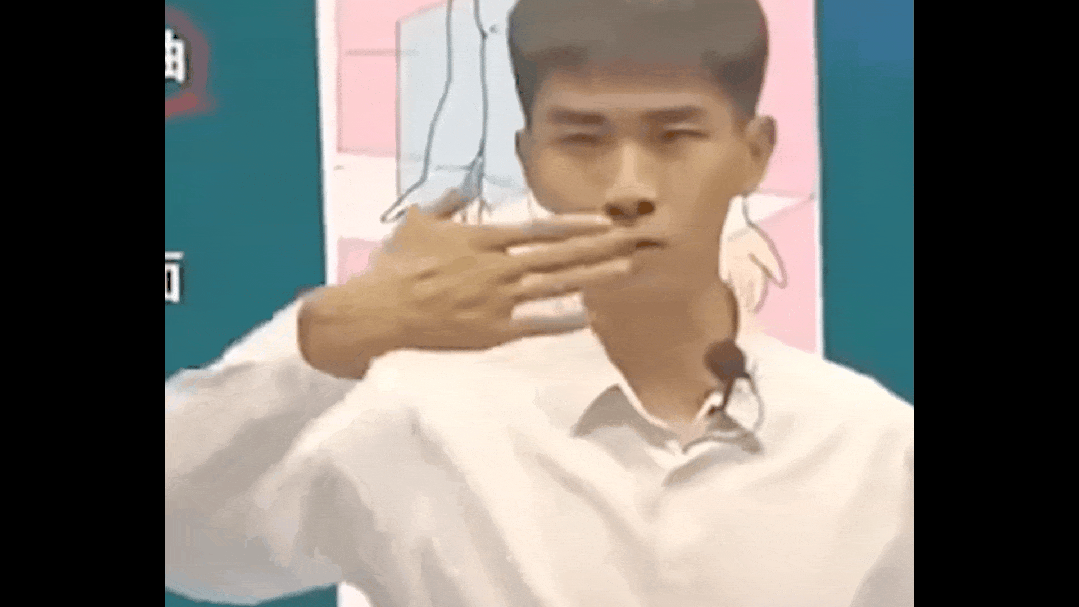

谁能想到,当老师在讲解解剖切面的走向,用手放在面前做演示时,表层的这张面皮被「掀了起来」,手指头就这么「水灵灵」地横穿鼻子过去了,让买课的学生起了疑心。

来源:红星新闻 https://www.bilibili.com/video/BV1MGH4eKEz3

并且老师总是「蜕皮」,很吓人、很诡异,分散了他的注意力,严重影响了他的学习效率。

唯一合理的解释是,网课老师经历了「AI 换脸」。

AI 换脸是深度伪造(DeepFake)技术最常见的应用之一。DeepFake 技术旨在基于深度学习方法,合成人体图像。

和以往 DeepFake 事件的受害者通常在不知情的情况下被换脸不同,这一次,借助 AI 换脸是视频主角自己的选择。

据红星新闻报道,起初学生怀疑是售卖网课的辅导机构盗用了其他机构的网课视频,用自家老师的形象「夺舍」了其他老师的劳动成果。

但当他去退课的时候,才发现网课不是按节收费,而是按观看次数收费,这节让他「感到生理不适」的课,他总共观看了 166 次。按这个规则,他无法收到全额退款。

经红星新闻核实,该机构称:换脸是因为有些老师要维护自己的隐私,也有老师有公职在身,不方便露脸。至于退款,该机构表示,「就是他自己不想学了」,用户系恶意投诉,正收集证据通过法律程序提起诉讼。

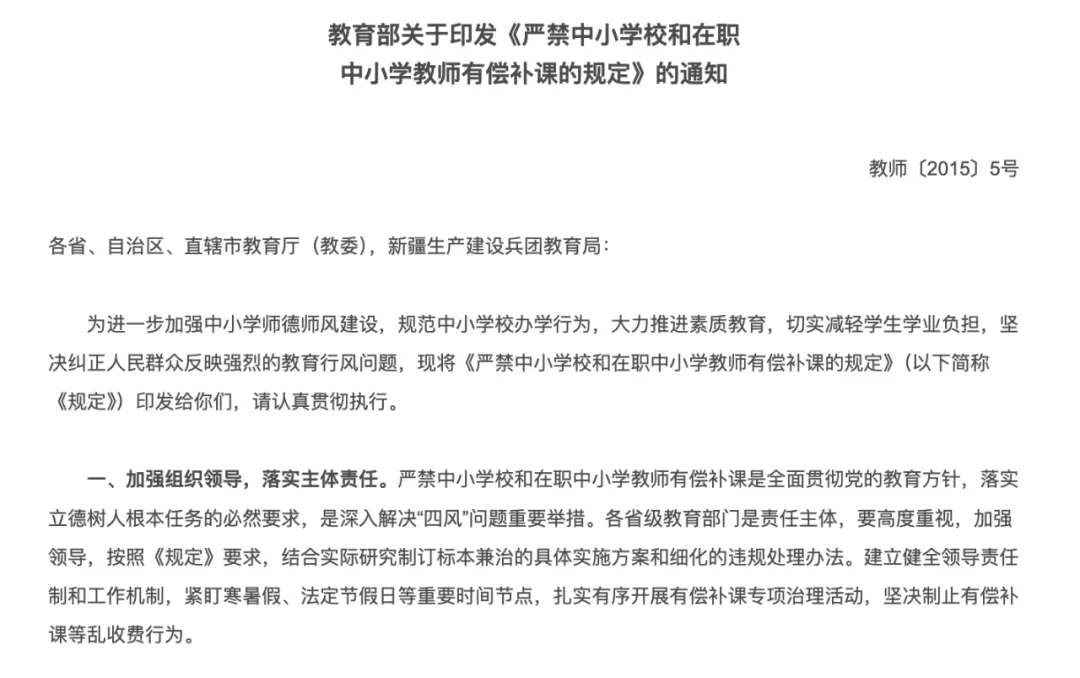

据教育部印发的《严禁中小学校和在职中小学教师有偿补课的规定》,严禁在职中小学教师参加校外培训机构或由其他教师、家长、家长委员会等组织的有偿补课。

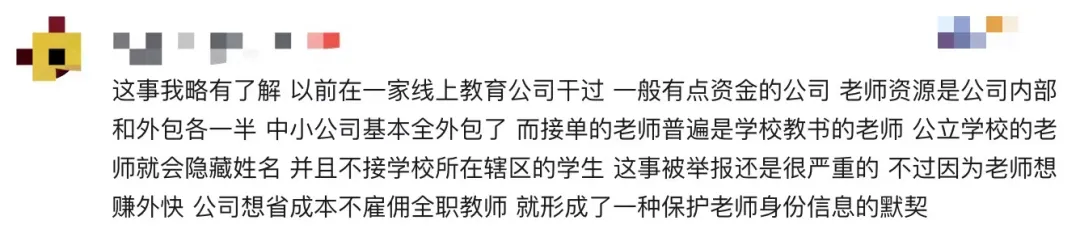

随着这件事的曝光度不断提升,也有「懂行」的网友现身说法:

对于花钱买账的学生来说,这种「货不对版」的行为也是对消费者权益的一种侵犯。

更令人担忧的是,在「宇宙的尽头是买课」的时代,很多网课老师往往使用化名,老师的真名都很难知道。有些机构还会为普通老师打造虚假的光环,如「名校毕业」、「多年执教毕业班,拥有丰富的教学经验」等标签,以此来吸引学生。

更令人担忧的是,在「宇宙的尽头是买课」的时代,很多网课老师往往使用化名,老师的真名都很难知道。有些机构还会为普通老师打造虚假的光环,如「名校毕业」、「多年执教毕业班,拥有丰富的教学经验」等标签,以此来吸引学生。

网课能卖出高价,很大程度上基于消费者对名师的信赖和追捧。网课教师的资质原本就难以确保,AI 换脸则使得对教师身份的确认变得更加困难。

不过也有网友表示,「无所谓了,只要能学到东西就值了。」

把思路打开,如果能打入「二次元」,那就是走在潮流尖端的 vtuber 了。

从技术的角度讲,现在的 AI 换脸技术已相当高明,与原有面部的融合度极为自然,吃东西、做夸张表情不会像美颜一样失效,只会在某些片段中存在违和感,但对于普通观众而言,这种细微的差别几乎难以察觉。

但也正因合成结果可能非常真实,难以用肉眼分辨真假,因此 DeepFake 技术存在诸多争议,并且通常被限制使用。

回顾 DeepFake 技术及应用的发展历程,我们可以看到很多负面消息。

2017 年,英伟达基于生成对抗网络(GAN)创建出合成人脸图像,之后,Reddit 用户「Deepfakes」使用英伟达的 GAN 技术,将色情女演员的面部替换成其他知名女性的脸部,制作出以假乱真的合成视频,DeepFake 因此得名,并引发关注和质疑。

2019 年,陌陌推出了一款名为 ZAO 的 AI 换脸应用,上架几天就冲到应用榜榜首,但很快就因存在滥用隐患而下架了。2021 年,一段用换脸技生成的「蚂蚁呀嘿」视频及其制作软件 Avatarify 再掀风波,并在一周之后火速下架。

DeepFake 应用下架的原因主要是涉及隐私安全问题。一方面技术滥用会导致虚假信息泛滥;另一方面,如使用明星等他人的照片来制作相关视频,就可能涉及名誉权、肖像权、知识产权等法律问题。此外,个人隐私泄漏可能会涉及资产安全、人身安全等问题。

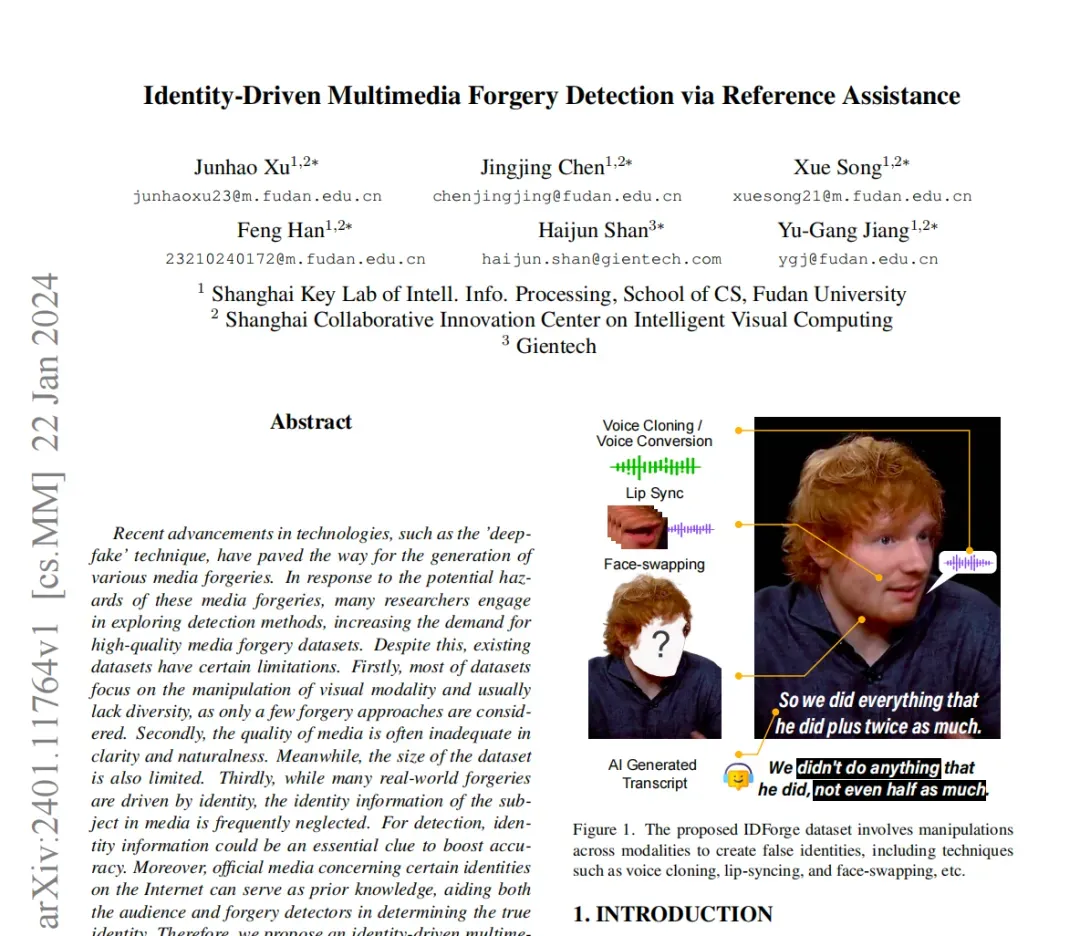

因此,近年来一些研究提出了「伪造检测方法」,旨在检测图像、视频等媒体数据是否是 AI 合成的。

早期的伪造检测方法主要关注单个模态,如检测图像的真假、音频的真假等。单模态鉴伪方法处理速度快,但场景泛化性能有限,无法同时检测多个模态的真伪。

为了解决上述问题,多模态鉴伪方法应运而生。例如,机器之心曾经报道过,为了防止 AI 换脸视频诈骗,中电金信联合复旦提出参照辅助的多模态鉴伪方法(Reference-assisted Multimodal Forgery Detection Network,R-MFDN ),R-MFDN 方法利用丰富的身份信息,挖掘跨模态不一致性来进行伪造检测。

不过,这次网课老师 AI 换脸事件还不需要硬核检测方法,毕竟肉眼就看出「穿帮了」。

文章来源于“机器之心”