解读OpenAI o1,也就是过去说的草莓模型的影响

假设o1草莓模型最终表现和发布的信息完全一致,然后回发生什么呢?下面这篇文章描述的比较详细,大家可以参照阅读,不读也不影响理解后文:OpenAI发布最强推理模型o1。

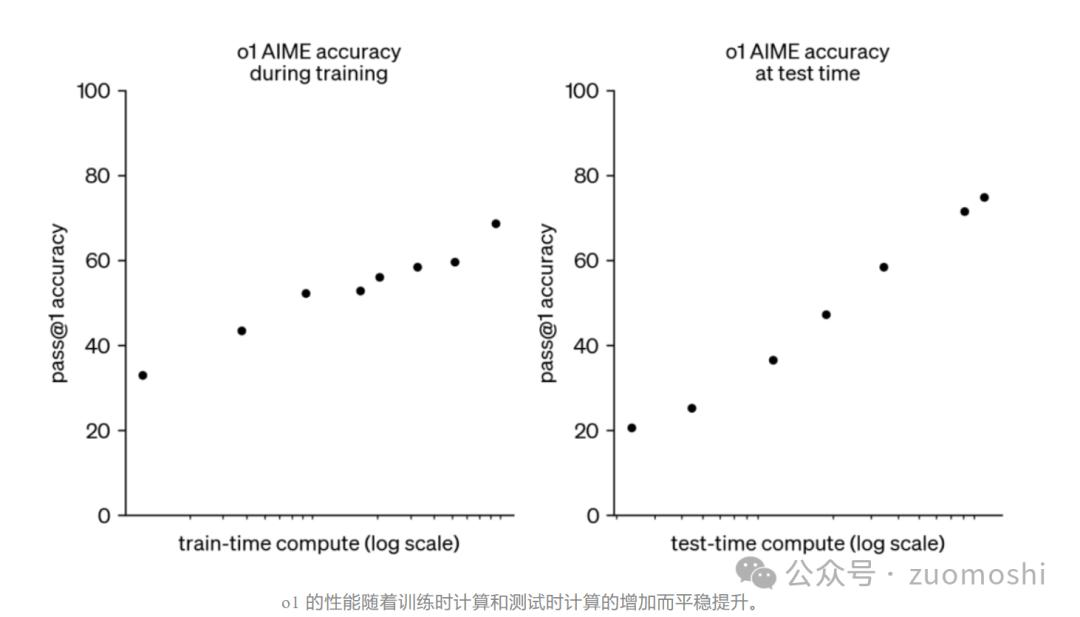

从披露的数据来看,我们可以认为Scaling Law有效,不过这次不是堆数据而是堆机器和优化算法。

这意味着AI大模型显然会更贵,也更难,先是需要更多的机器,这导致更贵,然后靠人来做画龙点睛,这导致更难。

这可以和过去Sam Altman的言论结合起来看,Sam Altman发过的惊人言论包括需要募集七万亿美金等等,投资去解决电力问题等,两者倒是匹配。

AI公司的风险有无数个,但AI作为一个行业,其风险只有1个,就是AI不好用。

如果Scaling Law有效,那不管多贵,都意味着这个行业解决问题的价值在增加,所以这个行业安全了。大概率不会再变成80年代人人喊骗子的局面,行业的安全意味着AI大时代基本会确定打开。

但很多AI大模型公司是真的危险了。他们变成了应用不是应用,模型不是模型的一种公司。

跟进跟不起,不管是机器还是人才储备,显然的要想干好模型不单下一步贵,并且一段时间会越来越贵。

不跟进,那自己的高估值拿什么做支撑呢?定位是什么呢?同时这种推理的进展覆盖正是他们本来做的那部分工作。

从报道看Level2确实能过去,那我们之前所有对Level2影响的预判将在短期成为现实。之前我们这么解读五级模型:

上层应用实现的程度和先后可以参照OpenAI对后续AI进阶划分进行推测,下述为参照OpenAI分阶并补充系统型超级应用信息后整理而来。

阶段1:聊天机器人。AI能够与人对话,然后纯粹看对话内容你不能分辨它是人还是AI。对话的时候AI可能有幻觉并胡说八道,但逻辑自洽。当前就处在这个阶段。这个时候垂直型应用处于只能出现类似Copilot这类纯粹的生产力工具,让ERP等进入下一代这类事情只可能在极小的领域中出现,处于萌芽期。

阶段2:推理并解决真实问题的机器人。当你给AI真实的问题,它能够自行推理,甚至找你要它解决问题所欠缺的信息或者资源,然后真正的能够代替人解决问题。到了这个阶段,所有白领工作基本就不需要人了。在这个阶段各种不牵涉现实物理世界的事情基本可以全部用AI来解决,大量系统型超级应用会在企业领域、部分行业比如律师出现。

阶段3:AI智能体。全面感知物理世界并且能够采取行动解决问题,相当于把阶段2的能力从虚拟数字世界扩展到真实物理世界。到了这个阶段所有体力工作就不需要人了,街道、家庭、公司随处都是机器人。这个阶段新式系统型超级应用扩展到物理空间,具身机器人会充斥在各个生成生活的环节。

阶段4:创新者。AI能够组合现有要素在特定的方向上完成创新,比如他会创造性的根据面条和动物捏合出来用各种栩栩如生的动物。到了这个阶段,现在200人的公司估计只要不到10个人,像产品经理这样需要创新能力去定义产品的角色AI也能够承担了。这个阶段现有大部分可见的岗位全部完成AI对人的置换。系统型超级应用会遍布在各行各业。

阶段5:组织者。这时候AI能够负责组织协调的工作,承担AI之上的AI角色(过去高管和CEO的角色)。到这里每个我们现在看到的领域也都有了一个自己的AlphaGo,这个AlphaGo的专业性和能力远超过去人类同时具有通用性,大多企业里不需要管理人员,而是全部被AI接管。

这个五级分类可以看成是一种AI宏大叙事类比过去的大同社会等。

现在Level2眼看要实现了,那首先是Level2的影响会发生,其次在于后面的是不是也是靠谱的,而不是单纯的想象?

推理这事的影响方向非常清楚:白领包括高级白领乃至科研人员受冲击最大。

不过如果幻觉问题没解决,那人类还能略有喘息。

如果说推理能力确实能破局(当前并非是大成,而是一种破局),那AI真的可以做积极的未来展望。不是因为OpenAI多牛,关键是我们总说的智能飞轮要启动了。

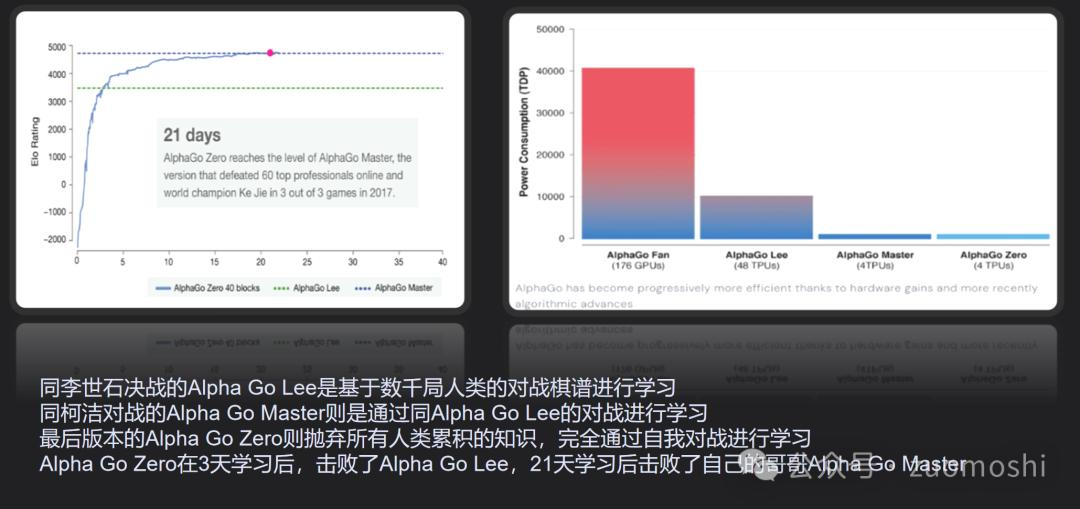

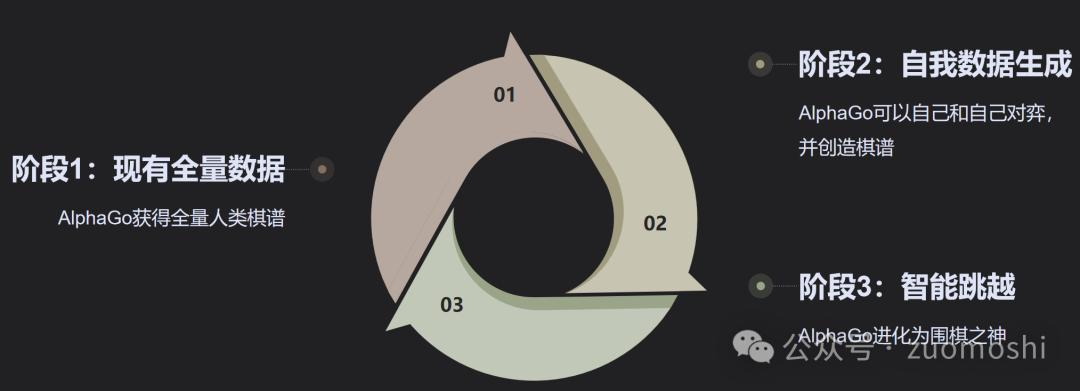

当年AlphaGo为什么后来水平进展极其快?

核心就在于它转起来一个叫智能飞轮的东西。

形象讲就是AI能够伺候AI。

AlphaGo的领域太垂直了,围棋太特殊了,所以过去几乎只有AlphaGo能干这事。

可如果推理能力搞定了,情况会有大变化。

在数据和算法两个环节,AI逼近能够伺候自己的边缘。而这会解锁AI的进化速度。

说起来是个有点悲伤的故事,从智能飞轮、从AI进化的角度看,人才是最大障碍,人负责的越少,AI负责的越多,那智能飞轮转的越快。

而推理能力最关键的就在于削弱人在AI进展过程中的角色,这反倒是会加速AI的进展。

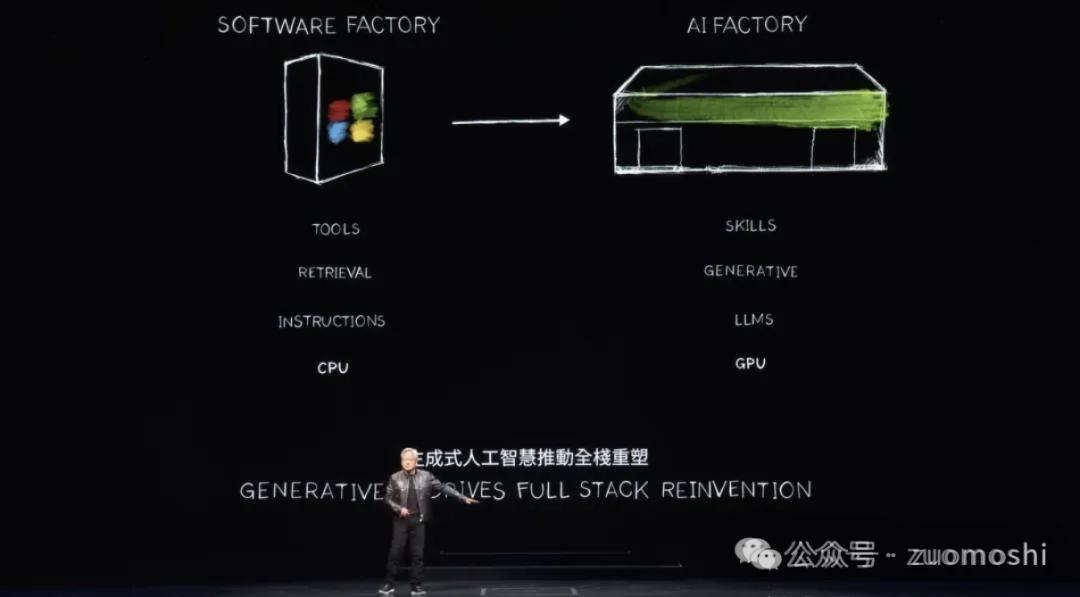

琢磨事一直反复说个话题,AI会因为计算模式的迁移导致大量的应用重做(参见:角色中心式计算:AI大模型颠覆性的起点与终点),过去我们把它总结成从功能中心式计算迁移到角色中心式计算。用老黄的图就是:

但这种重做在过去有点像构思闪电战缺内燃机,推理的窗口一打开,各种新现实就不是空想,而是需要更为认真的构思了。

这种认真的构思关键是需要前瞻性,顺着AI脉络的前瞻性。

当年基于摩尔定律有这么一种思维模式:

我先把程序按照未来的计算量开发好,那怕现在慢点,然后我就休假去了,什么也不用干,等我回来过去不怎么好用的复杂图形用户界面就好用了。

现在AI的脉络在呈现类似摩尔定律的确定性,所以认真思考是指基于这种脉络的前瞻性思考。

参见:AI的脉络:非共识时刻的认知价值,为什么说AI也是普通人的机会?

不管怎么样AI革命先革自己也是有点出乎意料的,过去大量AI的算法人员在这种进展下承压可能比装修人员大的多。当年那些深度学习算法,是不是很快AI就可以干的比人更好?当然这还只是发布会上的一些零散信息,它的真正潜力还需要一些先锋应用来验证。值得期待。

文章来自于“琢磨事”,作者“老李话一三”。

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md