OpenAI产品的吸引力在于便利、价格和性能之间的某个最佳平衡点。

智东西9月29日消息,据Supervised今天报道,虽然OpenAI的最新模型o1在性能上有了显著提升,但它也给该公司带来了一个潜在的新挑战:产品组合繁杂。

OpenAI的最新产品o1和o1-mini,实际上让用户和客户在性能和成本之间做出了权衡:你可以选择等待更长时间,并暂时支付更多费用,但输出结果应该会好得多。它不是那种可以插入呼叫中心的应用程序接口(API),但它确实为这家已经覆盖了一系列细分市场(除了没有“一个几乎无所不能的产品”)的公司填补了一种新的细分市场。

o1的应用场景基本上是“你需要稍微思考一下”的问题。美国云服务管理平台Box CEO亚伦·列维(Aaron Levie)给出了一个极好的企业应用场景,即需要找到合同中一个非常具体的参数——例如,合同的最终签署日期,也就是合同实际生效的日期。这是一个真正“需要稍微思考一下”的问题,在一个原本简单的问题上增加了一层复杂性,人们可能在不同的日子签署了合同。

这对于OpenAI来说也是一种相对较新的应用场景。在过去,OpenAI可能需要调用一系列很长的API,并请求模型以提示调整或检索增强生成(RAG)的形式完成所需任务。相反,整个过程可能会被压缩成一两次调用,从而简化某些架构。OpenAI已经经历了一种“SaaS化”的过程,在这一过程中,OpenAI逐渐成熟,成为一家真正的企业。

随着OpenAI逐渐发展成为一个真正的企业,其产品组合(或称为模型组合)日益复杂,OpenAI正面临着公司产品组合繁杂的挑战。产品组合越庞大,管理难度就越大,处于这一阶段的公司面临的最大挑战就是如何避免产品组合变得繁杂,难以向用户传达价值。而且随着模型质量的不断提高,任何微小的分心都可能导致OpenAI被其他前沿模型公司超越。

Supervised总结了OpenAI现在非常庞大的API组合,共有9个产品:

1、GPT-4o:一个多模态、昂贵(虽然也没能幸免于降价影响)的模型,应该是通用型的好产品。

2、GPT-4o mini:GPT-4o的削弱版本,旨在作为其主力模型GPT-3.5 Turbo的继任者,以满足大量更简单的应用场景。

上述模型的微调版本,可满足企业的特定需求,尽管它们通过API提供,这可能会让一些更注重安全性的公司望而却步。

3、o1:一个以速度和价格为代价换取质量的模型,允许它有更多时间对答案进行“推理”。基本上就是需要“停下来想一想”的问题。

4、o1-mini:就像4o mini一样,是o1的削弱版本,设计用于……同样的“停下来想一想”的问题,但我们可以假设它确实能解决一系列问题。

5、Whisper:可以说是市场上最好的语音转文本模型,可以肯定的是,它是为生成OpenAI所需的训练数据而构建的。

6、文本嵌入:算不上最好的嵌入产品,但其优势通常在于它与其他OpenAI产品一起提供,从而减少了采购的麻烦。

7、文本转语音:假设延迟正常,你可以将其应用到类似呼叫中心里的API。它有普通和高清两个版本的API。

8、高级语音助手:一个技术奇迹般的产品,它可以让你在ChatGPT内进行主动对话,尽管其应用场景仍然不太明确。

9、ChatGPT:OpenAI将上述所有内容“产品化”,集合到一个前端企业友好型的包装中。

在此期间,Meta开始显示出更多的混乱,它在几乎每一个类别中都发布了更新的模型。不过Meta这些模型是开源的,并为一系列非常不同的产品提供支持,尽管它们存在于同一个“桶”中。通过o1,OpenAI本质上是在再次尝试创建新的类别,但同时也冒着产品组合繁杂的风险。

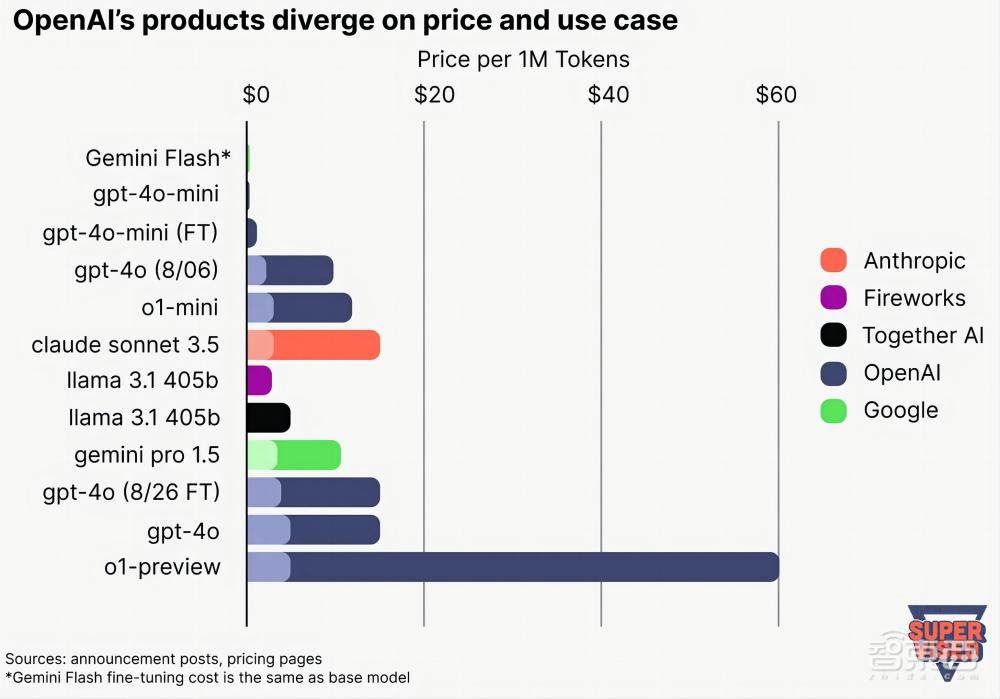

下面对比了OpenAI和其竞争对手的产品定价:

OpenAl的产品在价格和用途上存在差异(图源:X)

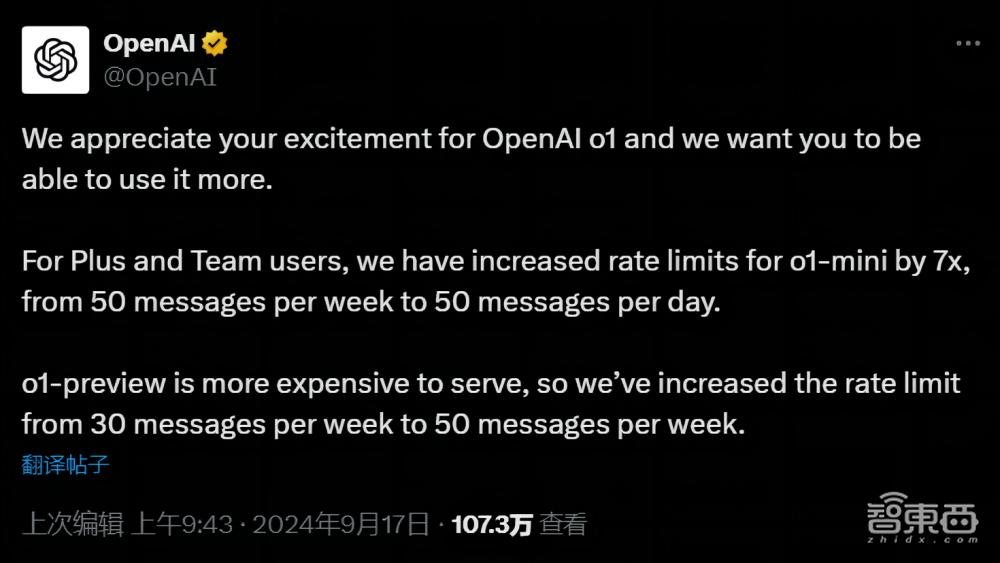

这些费用可能远未达到o1发布一段时间后的水平。OpenAI已经开始逐步增加速率限制,最近o1-preview从每周30个增加到50个,o1-mini从每周50个增加到每天50个。

OpenAI在社交平台X上分享道,将逐步增加o1-preview和o1-mini的速率限制(图源:Supervised)

虽然OpenAI的吸引力一直在于便利、价格和性能之间的某个最佳平衡点,但其繁杂的产品组合无疑既是挑战也是机遇。该文章作者马修·林利(Matthew Lynley)严重怀疑价格不会一直这么高,因为其下一个GPT模型迟早会准备好。但就目前而言,它至少在试图筹集巨额资金的时候,开发者拥有了一些价格较高的产品当作谈判筹码。

然而,这里的挑战与任何成熟企业随时间推移开始面临的挑战相同:产品繁杂。虽然OpenAI在技术上以API和ChatGPT的形式拥有“两个”产品,但这些产品都有大量的分支,服务于非常广泛的应用场景。这些API也远远超出了聊天补全和文本生成的范围,包括了各种各样的模态。而它的语音产品看似是ChatGPT“惊艳”的部分,其实可能是其产品组合中最尴尬的部分。

产品繁杂在创业领域是一个公认的问题,如果你还能称OpenAI为一家初创公司的话。随着初创公司的成熟,其用户和客户群的不断扩大,它必须有方向性地发展,更少的产品满足更多客户的需求,而不是为每个人构建一切。或者更简洁地说,做几件事,但都要做好。

提供如此广泛的应用场景,让OpenAI能够将用户引导到某种稳定状态,在这种状态下,它不一定赚钱,但至少不会亏本。在API方面,传统的做法是将用户推向其主力模型(特别是微调版本),但对于ChatGPT而言,这一点就不太清楚了。

虽然新模型在ChatGPT中是有速率限制的,但这也是OpenAI除了API之外极其重要的业务部分。据The Information报道,OpenAI COO布拉德·莱特卡普(Brad Lightcap)告诉员工,OpenAI拥有超过1000万名ChatGPT的付费订阅用户,另外还有100万名企业订阅用户。(彭博社此前曾报道,OpenAI有100万名ChatGPT的企业订阅用户。)

当然,我们可以做很多粗略的计算,但都会得出相同的结论:除了API之外,ChatGPT的企业业务现在和将来都会是OpenAI业务的重要组成部分。

但ChatGPT带来的收入并不会像API那样,直接随着o1的使用而增长。无论是通过API还是ChatGPT内部运行o1,实际运行它的成本可能会随着预训练计算资源转向推理而发生变化。

幸运的是,OpenAI在这一领域已经有了很多进展。业内人士目前额外关注的一种方法是蒙特卡洛树搜索(Monte Carlo Tree Search),它可以减少生成高质量结果所需的计算量。蒸馏(distillation)是另一种“缩小”大模型的方法,随着人们的兴趣转向管理高性能模型的推理成本,蒸馏法也获得了很大的发展。 (蒸馏是一种机器学习模型压缩方法,它用于将大型模型的知识迁移到较小的模型中。)

“这就是甜点,将传统预测性机器学习的策略与现代技术相结合。”模型开发商和平台h2o的联合创始人兼CEO斯里·安巴蒂(Sri Ambati)告诉马修,“树状搜索是一个绝对的天才技巧,它是一种非常容易实现的目标,与大语言模型的卓越性相结合。”

在与专家和知情人士交谈的交谈中,最常提到的另一点是诺姆·布朗(Noam Brown)在OpenAI的工作。布朗被广泛认为是博弈论领域的顶尖专家,许多人都想知道他的工作将如何应用到OpenAI的产品中。布朗还是一篇论文的共同作者,该论文部分研究了蒙特卡洛树搜索在开发类人代理中的应用。

OpenAI的API面临的挑战是,根据最近与大多数企业和平台的情况,在为场景构建AI应用时,成本是第一或第二重要的考虑因素。但OpenAI已经表现出逐渐降低价格以保持竞争力的意愿。

此外,ChatGPT的企业业务似乎是OpenAI业务的主要驱动力,这也很说明问题,因为所有这些开发基本上都是为该企业套件服务的。对于那些在管理和成本方面有更高要求的公司来说,使用现成的廉价产品在公司内部开发定制产品的做法越来越有吸引力。

有一种愤世嫉俗的观点认为,OpenAI试图说:“嘿,看,我们还在创造非常先进的东西,别忽视我们的融资号召。”

然而,这种观点的另一面是,根据CNBC的报道,OpenAI似乎已经获得了一轮超额认购的巨额融资,已经成长为一家更适合企业产品的公司。现在,OpenAI只需要确保其在销售电话中不会用庞大的产品组合迷惑企业。

文章来自于“智东西”,作者“吴浪娜”。

【开源免费】graphrag是微软推出的RAG项目,与传统的通过 RAG 方法使用向量相似性作为搜索技术不同,GraphRAG是使用知识图谱在推理复杂信息时大幅提高问答性能。

项目地址:https://github.com/microsoft/graphrag

【开源免费】Dify是最早一批实现RAG,Agent,模型管理等一站式AI开发的工具平台,并且项目方一直持续维护。其中在任务编排方面相对领先对手,可以帮助研发实现像字节扣子那样的功能。

项目地址:https://github.com/langgenius/dify

【开源免费】RAGFlow是和Dify类似的开源项目,该项目在大文件解析方面做的更出色,拓展编排方面相对弱一些。

项目地址:https://github.com/infiniflow/ragflow/tree/main

【开源免费】phidata是一个可以实现将数据转化成向量存储,并通过AI实现RAG功能的项目

项目地址:https://github.com/phidatahq/phidata

【开源免费】TaskingAI 是一个提供RAG,Agent,大模型管理等AI项目开发的工具平台,比LangChain更强大的中间件AI平台工具。

项目地址:https://github.com/TaskingAI/TaskingAI

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner