这两天有个很神奇的现象,就是有两个从来不碰A股的小伙伴,竟然跑过来问我——“现在上车A股还有机会吗?”

放心吧,我当然不可能在这里回答这个问题的,否则就你懂的。

今天这篇文章不是讨论A股的。而是我无意间发现,今天有一家国产大模型厂商也疯狂了——

1

意思就是说,你现在打开智谱开放平台(bigmodel.cn),能直接领取「1亿tokens」。

好家伙,真是双喜临门啊。

在股市上刚收获了一波现金,又收获了一波大模型Tokens,而且直接就是一个小目标。

而且重点是,这可是能消费GLM-4-Plus(最强旗舰大模型)的1亿 Tokens!

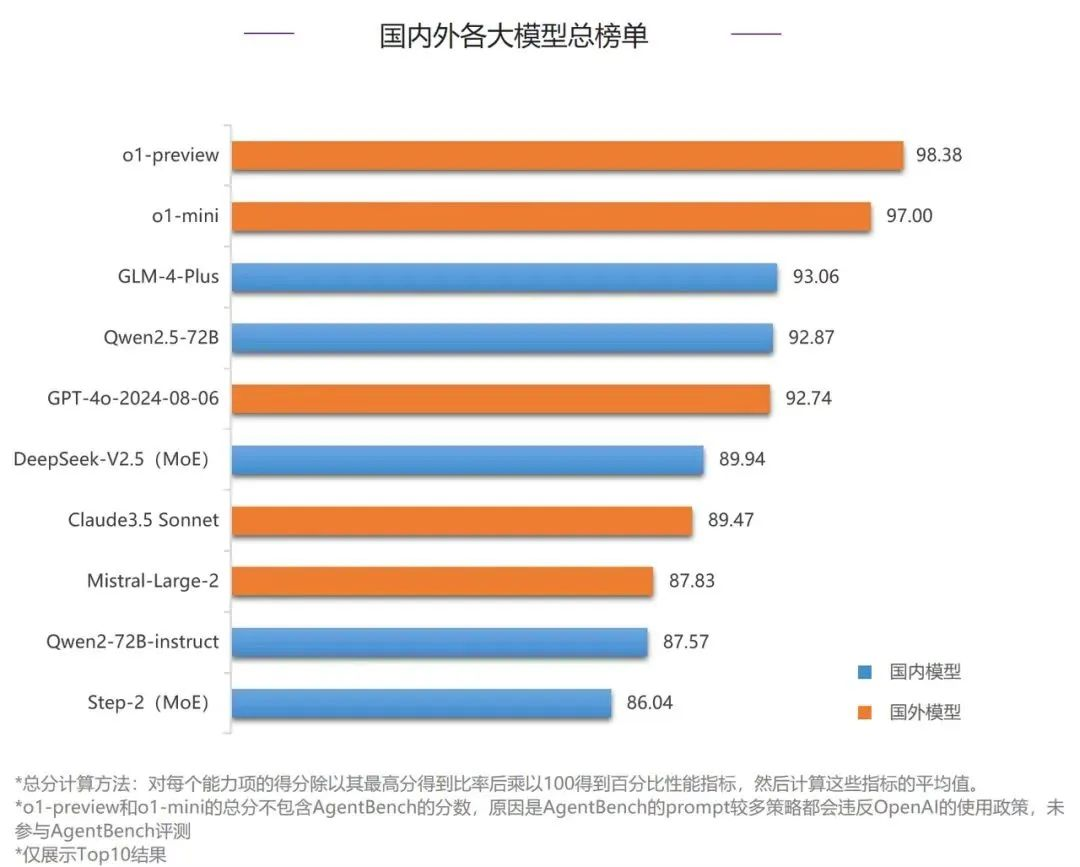

要知道,GLM-4-Plus可是现在,离o1最近的国产模型。在国内最新的9月份大模型综合能力评测SuperBench榜单中,GLM-4-Plus杀进了全球前三,且是其中唯一的中国模型。

尤其是GLM-4-Plus的推理能力,实测非常强,你把它当做一个“入门版的o1”去用的话,不仅不会觉得拉胯,甚至会觉得性价比极高。

众所周知,o1在回答问题前的一顿思维链输出,对用户来说情绪价值是直接拉满了,像极了一个卖力干活的打工人。

为了让GLM-4-Plus的回答风格看起来更像o1一些,你可以在sysprompt里内置这么一段:

请在回答前,输出完整的思维链,思维链内容的每一行都要用markdown引用符号"> "开头。

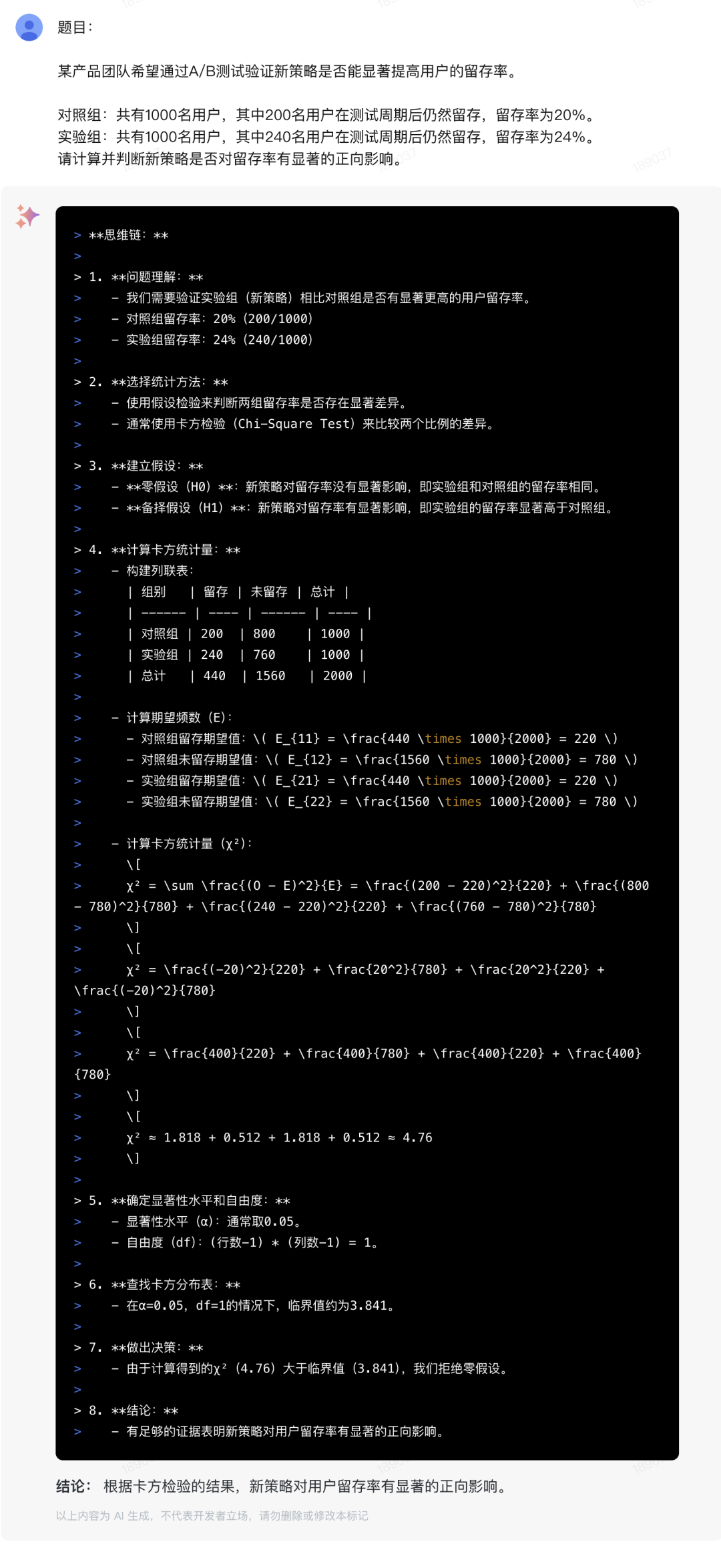

然后我们拿一道互联网人都懂的A/B Test实验计算统计显著性的题目测试下:

好家伙,这思维链也搞的太详细了,以至于思维链之后,好像没啥可讲的了。而且计算完全正确。

当然,你也可以进一步调整sysprompt来优化它的输出结构,但这样意义不大。

我又仔细想了一下,上面这个统计显著性检验的题目,可能不是能很好的考验模型是不是有真正强大的逻辑推理能力。因为这种统计显著性检验的知识,大概率在互联网语料中学习过很多次。

为此,我弄了一道完全依赖现场推理计算的题目,而且细节非常多,很变态。

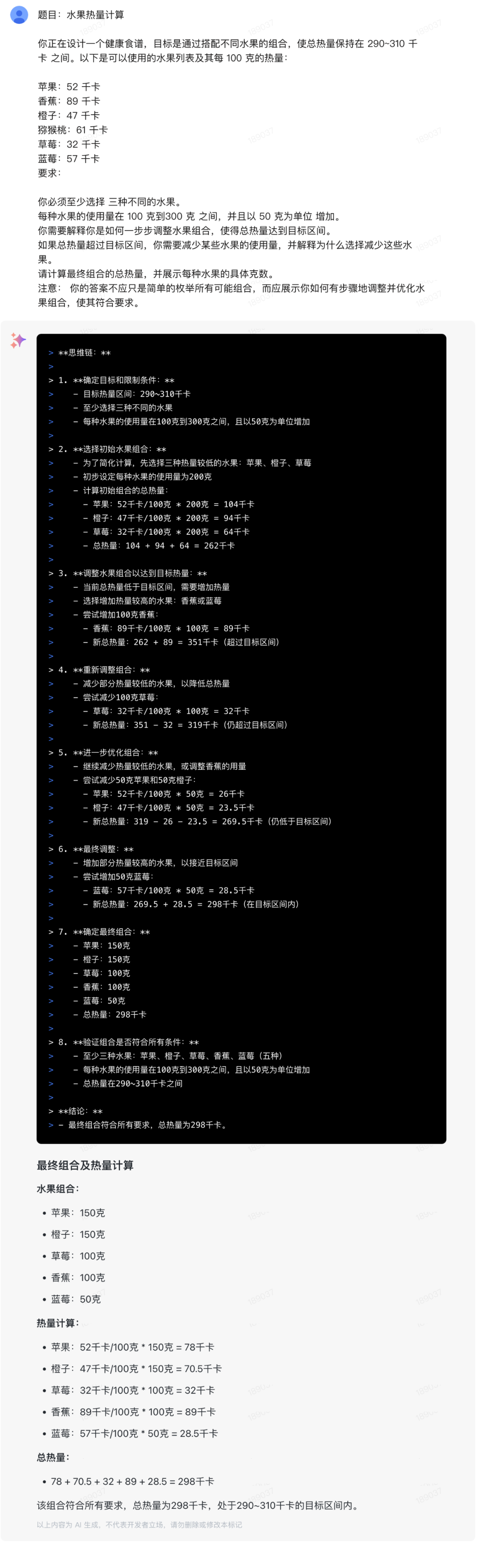

题目:水果热量计算

你正在设计一个健康食谱,目标是通过搭配不同水果的组合,使总热量保持在 290~310 千卡 之间。以下是可以使用的水果列表及其每 100 克的热量:

苹果:52 千卡

香蕉:89 千卡

橙子:47 千卡

猕猴桃:61 千卡

草莓:32 千卡

蓝莓:57 千卡

要求:

你必须至少选择 三种不同的水果。

每种水果的使用量在 100 克到300 克 之间,并且以 50 克为单位 增加。

你需要解释你是如何一步步调整水果组合,使得总热量达到目标区间。

如果总热量超过目标区间,你需要减少某些水果的使用量,并解释为什么选择减少这些水果。

请计算最终组合的总热量,并展示每种水果的具体克数。

注意:你的答案不应只是简单的枚举所有可能组合,而应展示你如何有步骤地调整并优化水果组合,使其符合要求。

我测了下,果然这道题的难度非常大,我跑了下国内主流的ChatBot产品,发现大部分都翻车了。

其中有一个Bot的回答非常离谱(已打码):

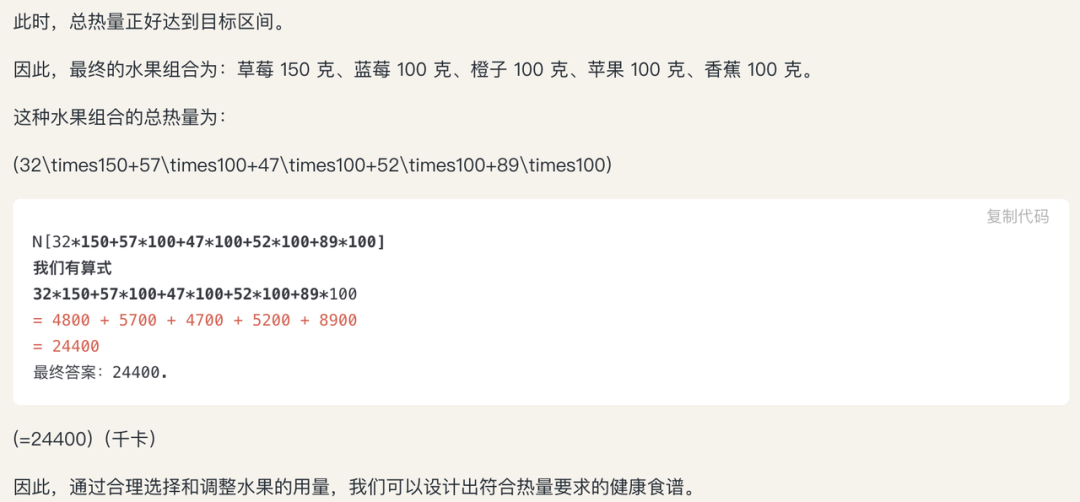

竟然跑出来了2万多千卡的组合,好家伙,这是改成水果增肥套餐了?

接下来,我们把这道变态题,交给国产模型中推理能力最接近o1的GLM-4-Plus模型:

配上前文提到的sysprompt,好家伙,整个计算过程真是满满的o1的味儿了。

我仔细check了下,这个计算过程和计算结果完全正确。我甚至仔细精读了下思维链的第3-6步,发现其确实是像人一样在不断调整试错。可以说是非常牛逼了。

当然,拿GLM-4-Plus去跟o1去比不公平,因为o1可以看做一个专门训练的理科偏才生,而GLM-4-Plus则是一个全才,在非理科类问题上表现也非常强。

这确实是国内为数不多的,不仅榜单排名非常靠前(全球前三),而且实测体感也完全配得上这个榜单名次的大模型。

这也是我推荐这个模型的原因。

因为这可是一个超强模型的1亿Tokens!薅这模型羊毛的爽度丝毫不亚于A股暴涨。

此外,笔者看了下活动,发现不止是送1亿 Tokens,还有一个有意思的“国庆月(2024.10.1~2024.10.31)API打骨折”的活动。

好家伙,就在别家把“入门款模型”朝着免费去卷的时候,智谱已经把自家的旗舰模型朝着免费开卷了。

需要强调的是,这个力度相当A股的活动,10月底截止,别错过时间窗口。

文章来源于“ 夕小瑶科技说”,作者“夕小瑶编辑部”