Dify、n8n、Coze、Fastgpt、Ragflow到底该怎么选?超详细指南~

Dify、n8n、Coze、Fastgpt、Ragflow到底该怎么选?超详细指南~大家好,我是袋鼠帝 一直以来,分享了不少关于工作流平台、LLM应用平台的不少干货文章。 主要包含:Dify、Coze、n8n、Fastgpt、Ragflow。大家好,我是袋鼠帝 一直以来,分享了不少关于工作流平台、LLM应用平台的不少干货文章。 主要包含:Dify、Coze、n8n、Fastgpt、Ragflow

大家好,我是袋鼠帝 一直以来,分享了不少关于工作流平台、LLM应用平台的不少干货文章。 主要包含:Dify、Coze、n8n、Fastgpt、Ragflow。大家好,我是袋鼠帝 一直以来,分享了不少关于工作流平台、LLM应用平台的不少干货文章。 主要包含:Dify、Coze、n8n、Fastgpt、Ragflow

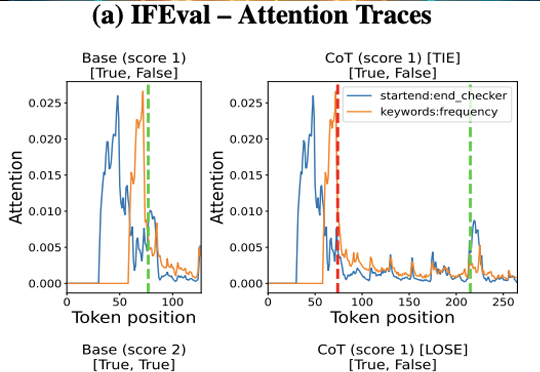

DeepSeek-R1火了,推理模型火了,思维链(Chain-of-Thought,CoT)火了!

不再依赖语言,仅凭图像就能完成模型推理?

何恺明团队又一力作!这次他们带来的是「生成模型界的降维打击」——MeanFlow:无需预训练、无需蒸馏、不搞课程学习,仅一步函数评估(1-NFE),就能碾压以往的扩散与流模型!

刚刚,昇腾两大技术创新,突破速度瓶颈重塑AI推理。FusionSpec创新的框架设计配合昇腾强大的计算能力,将投机推理框架耗时降至毫秒级,打破延迟魔咒。OptiQuant支持灵活量化,让推理性价比更高。

大语言模型(LLM)的生成范式正在从传统的「单人书写」向「分身协作」转变。传统自回归解码按顺序生成内容,而新兴的异步生成范式通过识别语义独立的内容块,实现并行生成。

看到朋友在网上的分享: 用Deep Research 的时候就怕在研究来源中看到ZHIHU、SINA、CSDN 这样的网址,这简直就是报告结果的灾难! 垃圾进 垃圾出。。 在大模型还没有进化出反思修正和推理新知识能力的时候,务必屏蔽掉低质量信息源,AI无脑文越演越烈。

得益于AI上下文和审美能力的提升,现在做HTML已经没什么门槛了,可以应用到很多方面,例如小红书封面、PPT、原型图、数据看板等等。

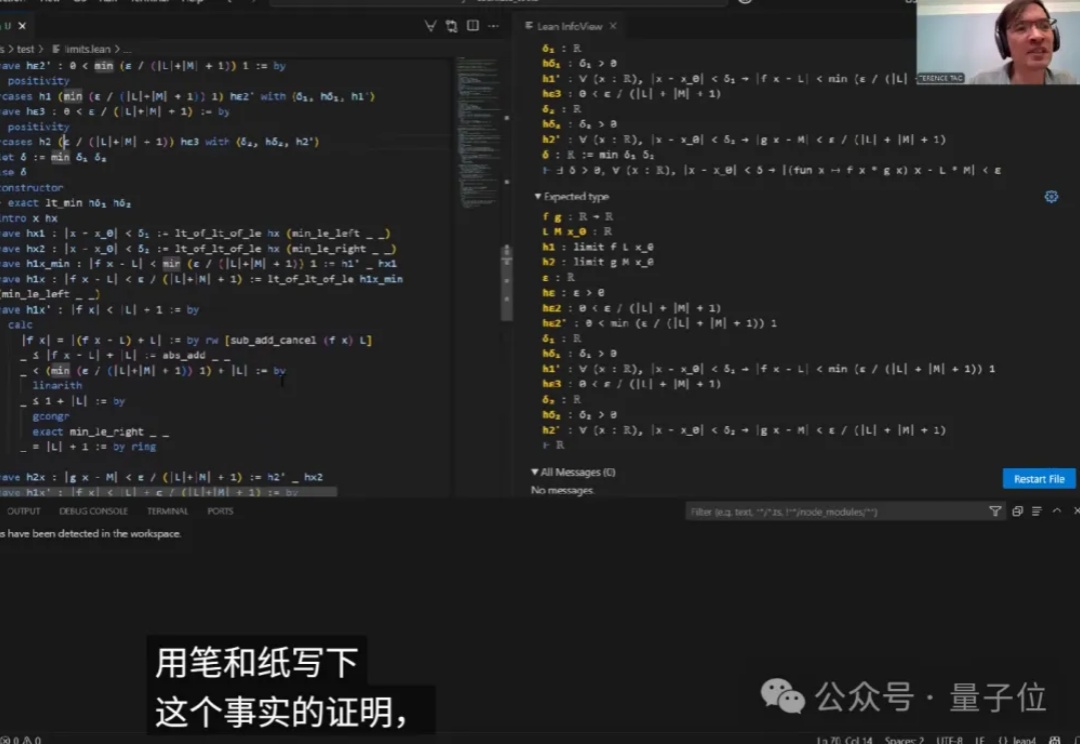

视频新人博主陶哲轩又更新了!这次是“喂饭级”AI教程—— 手把手演示如何只用GitHub Copilot证明函数极限问题。

洛桑联邦理工学院研究团队发现,当GPT-4基于对手个性化信息调整论点时,64%的情况下说服力超过人类。实验通过900人参与辩论对比人机表现,结果显示个性化AI达成一致概率提升81.2%。研究警示LLM可能被用于传播虚假信息,建议利用AI生成反叙事内容应对威胁,但实验环境与真实场景存在差异。

今天橘子的新产品可以一分钟将任何内容变成播客的 ListenHub发布了,照例想用提示词为他做一张长图。

有多久没喝雪碧了,记不清了。

大家好,我是袋鼠帝前几天收到一个客朋友的咨询:“有没有什么爬虫软件推荐?”

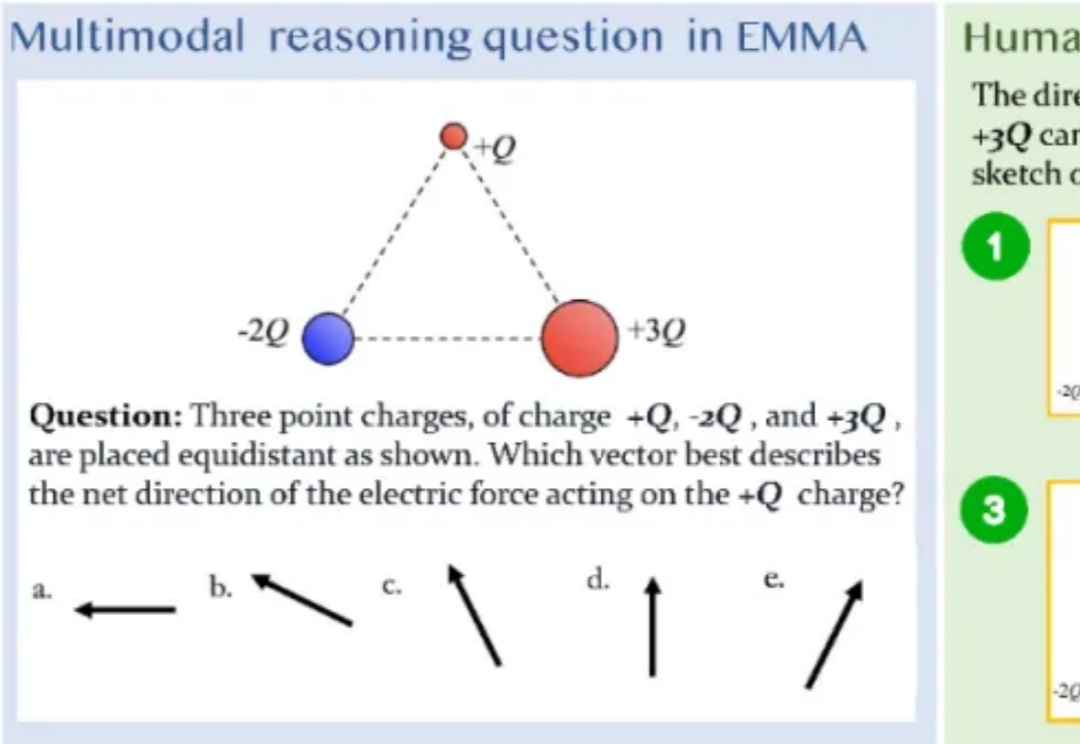

在基本物理任务上,前沿AI模型仍会失败!ML研究院的测试案例显示白领将被Ai替代,而制造业等蓝领工作不受影响。未来已来,只是分布得不均匀。

要问最近哪个模型最火,混合专家模型(MoE,Mixture of Experts)绝对是榜上提名的那一个。

「三个点电荷 + Q、-2Q 和 + 3Q 等距放置,哪个向量最能描述作用在 + Q 电荷上的净电力方向?」

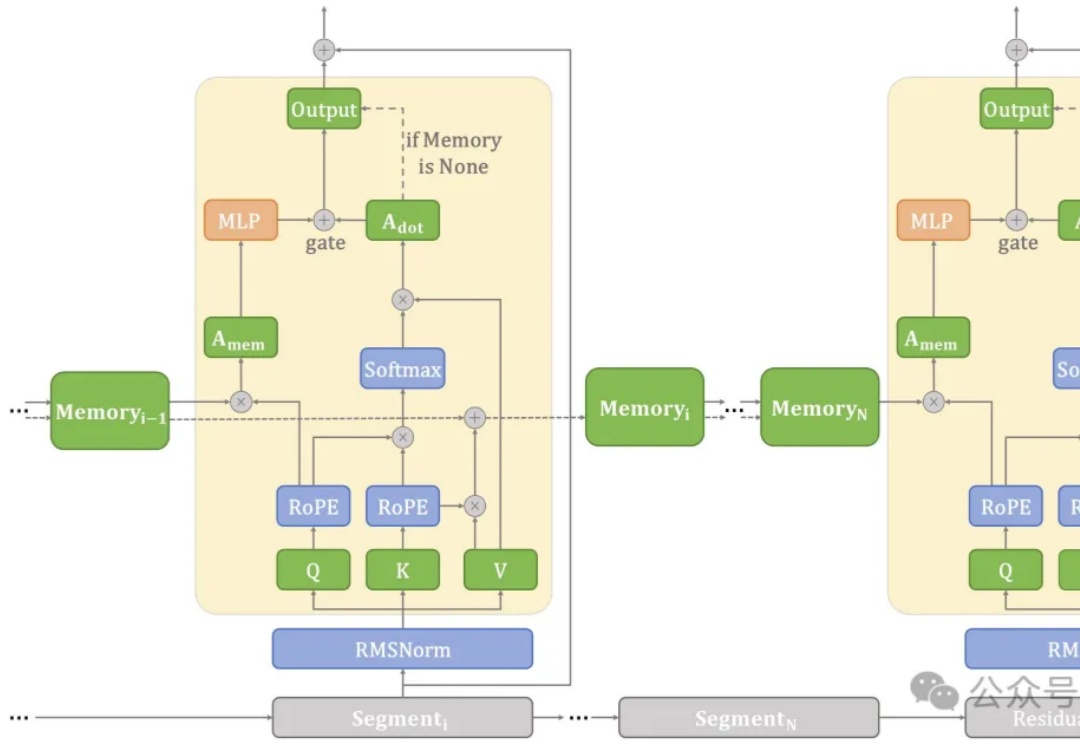

在端侧设备上处理长文本常常面临计算和内存瓶颈。

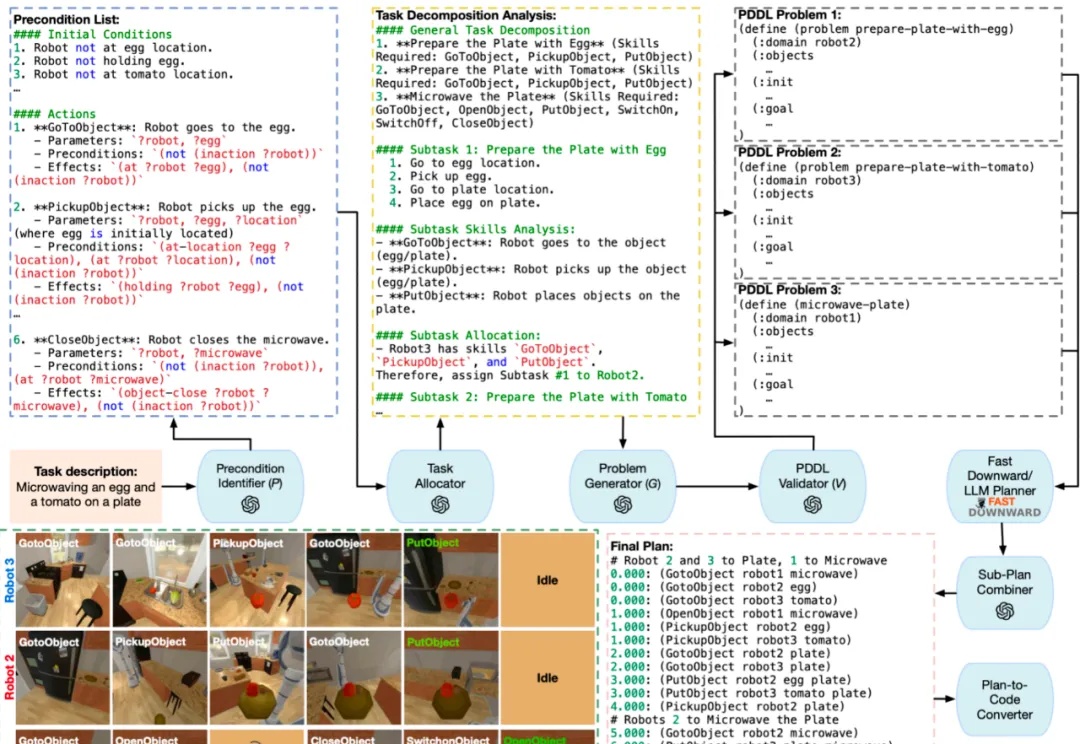

2025 年 5 月,美国加州大学河滨分校 (UC Riverside) 与宾夕法尼亚州立大学 (Penn State University) 联合团队在机器人领域顶级会议 ICRA 2025 上发布最新研究成果 LaMMA-P。

就在刚刚,智源研究员联合多所高校开放三款向量模型,以大优势登顶多项测试基准。其中,BGE-Code-v1直接击穿代码检索天花板,百万行级代码库再也不用怕了!

太震撼了,有开发者代码实证后发现,谷歌AlphaEvolve的矩阵乘法突破,被证明为真!Claude辅助下,他成功证明,它果然仅用了48次乘法,就正确完成了4×4矩阵的乘法运算。接下来,可以坐等AlphaEvolve更「奇点」的发现了。

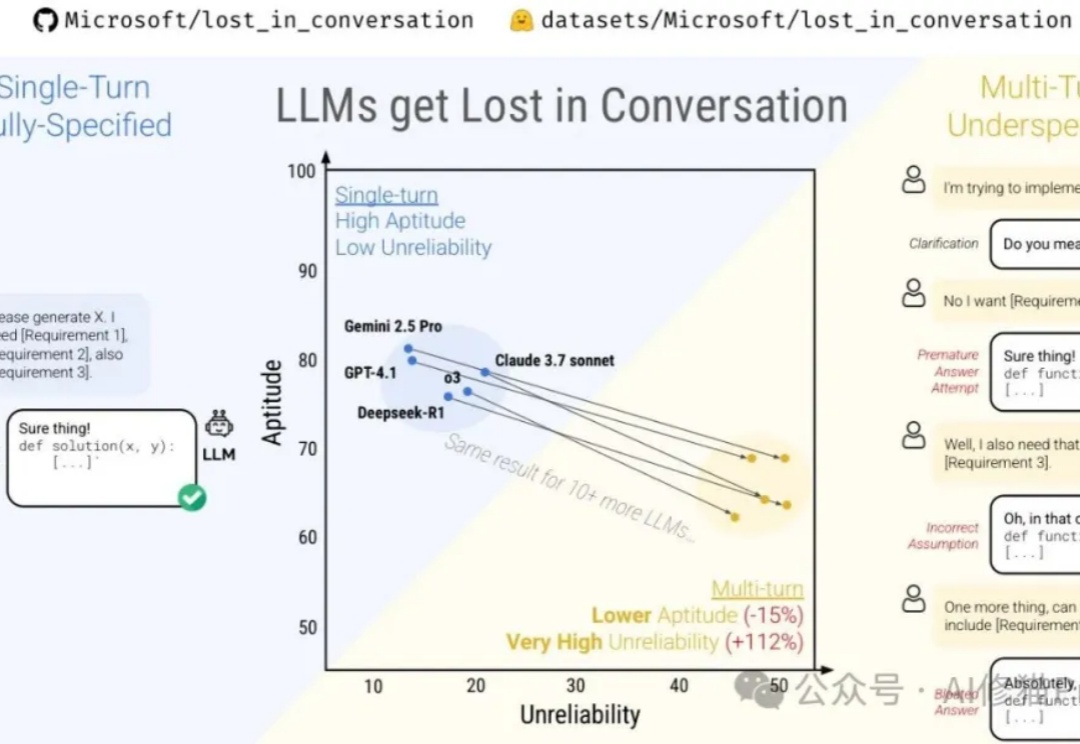

微软最近与Salesforce Research联合发布了一篇名为《Lost in Conversation》的研究,说当前最先进的LLM在多轮对话中表现会大幅下降,平均降幅高达39%。这一现象被称为对话中的"迷失"。文章分析了各大模型(包括Claude 3.7-Sonnet、Deepseek-R1等)在多轮对话中的表现差异,还解析了模型"迷失"的根本原因及有效缓解策略。

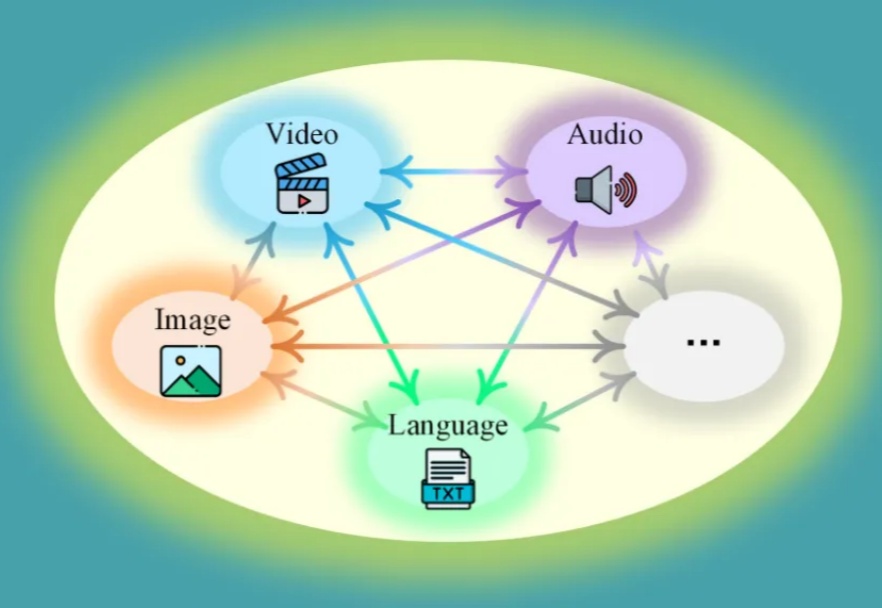

理想中的多模态大模型应该是什么样?十所顶尖高校联合发布General-Level评估框架和General-Bench基准数据集,用五级分类制明确了多模态通才模型的能力标准。当前多模态大语言模型在任务支持、模态覆盖等方面存在不足,且多数通用模型未能超越专家模型,真正的通用人工智能需要实现模态间的协同效应。

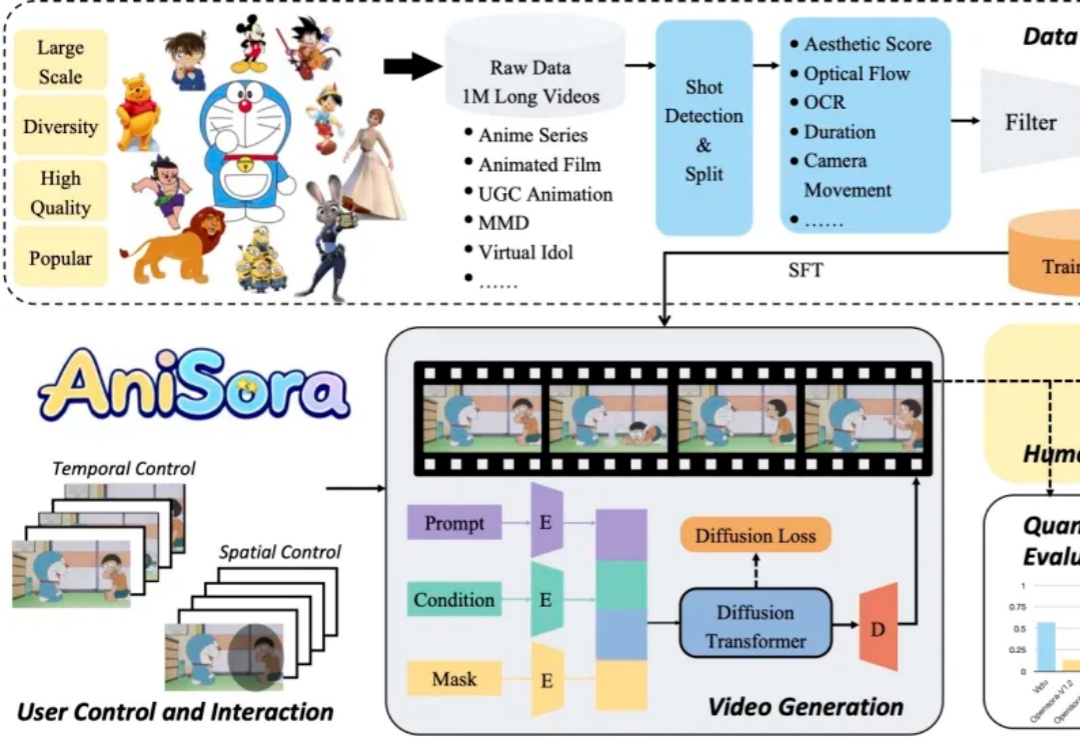

B 站开源动画视频生成模型 Index-AniSora,支持番剧、国创、漫改动画、VTuber、动画 PV、鬼畜动画等多种二次元风格视频镜头一键生成!

部署超大规模MoE这件事,国产芯片的推理性能,已经再创新高了—— 不仅是“英伟达含量为0”这么简单,更是性能全面超越英伟达Hopper架构!

AI能写论文、画图、考高分,但连「看表读时间」「今天是星期几」都错得离谱?最新研究揭示了背后惊人的认知缺陷,提醒我们:AI很强大,但精确推理还离不开人类。

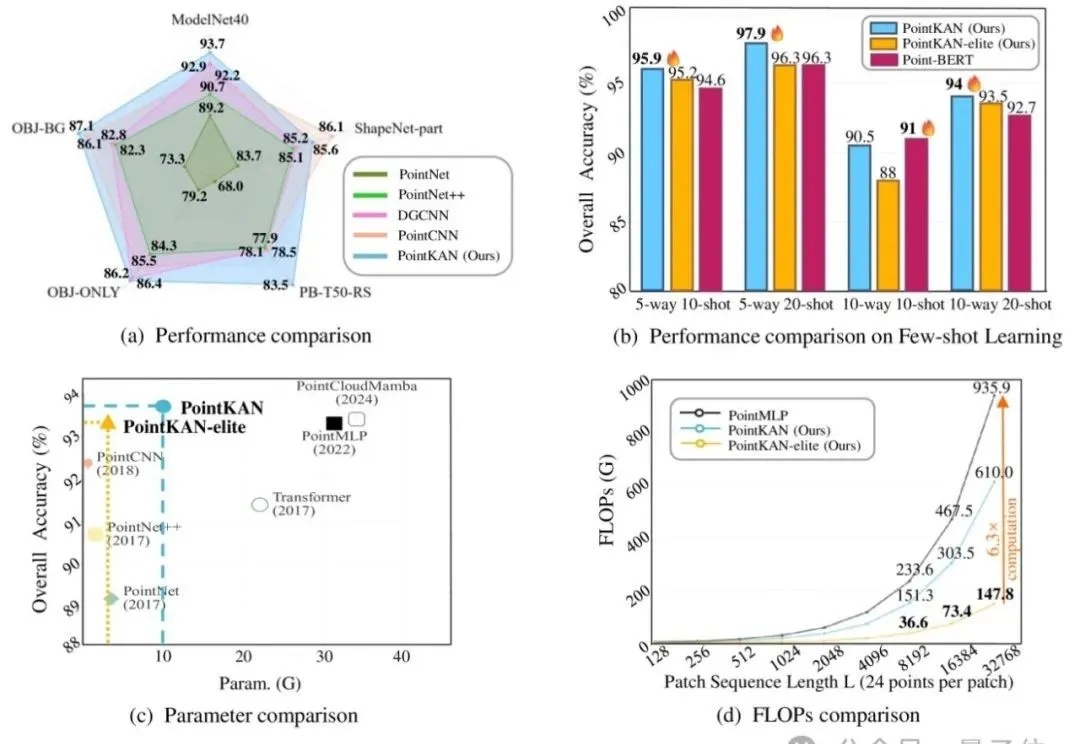

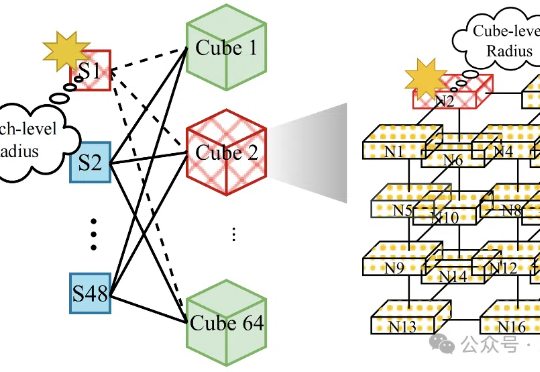

新架构选择用KAN做3D感知,点云分析有了新SOTA!

随着大模型的参数规模不断扩大,分布式训练已成为人工智能发展的中心技术路径。

本文由匹兹堡大学智能系统实验室(Intelligent Systems Laboratory)的研究团队完成。第一作者为匹兹堡大学的一年级博士生薛琪耀。

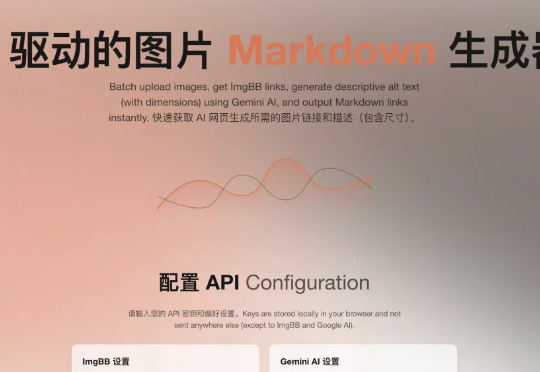

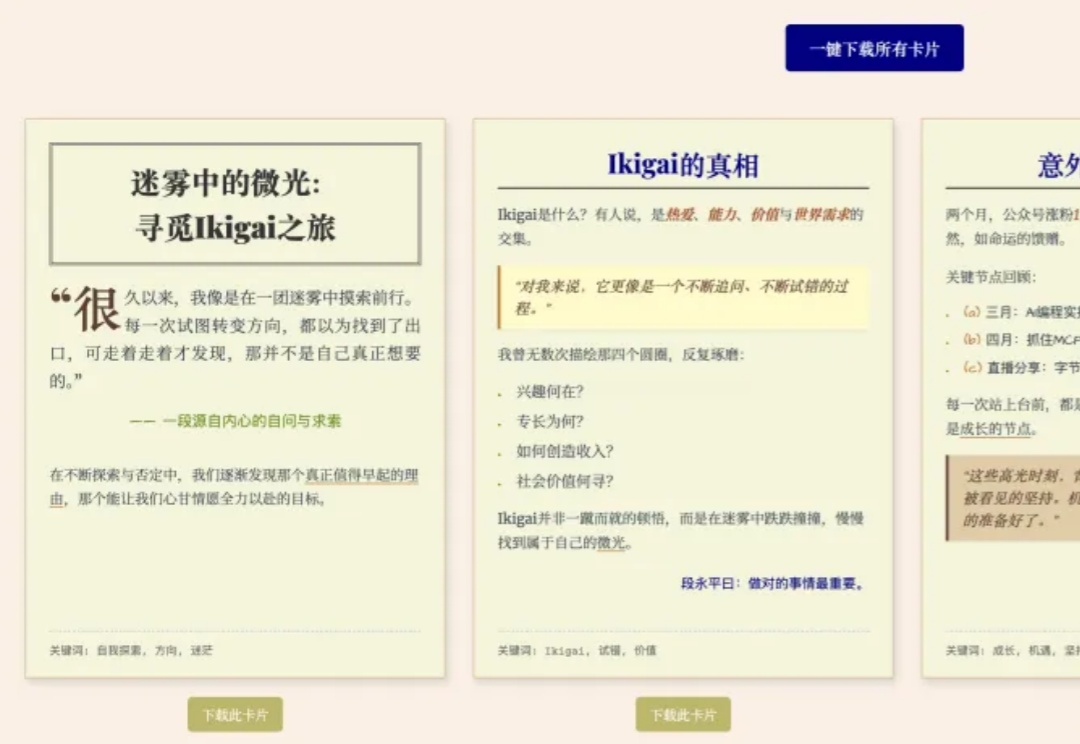

你有没有这样的烦恼:辛辛苦苦写完一篇公众号文章,想转发到小红书,却要再花大量时间制作3:4比例的精美图片?作为一个小红书小号拥有者(小1万粉丝呢,虽然躺在那吃灰有点可惜),我深知这种痛苦。每次想着要做几张图片就头大,甚至因此放弃了不少内容的二次分发。

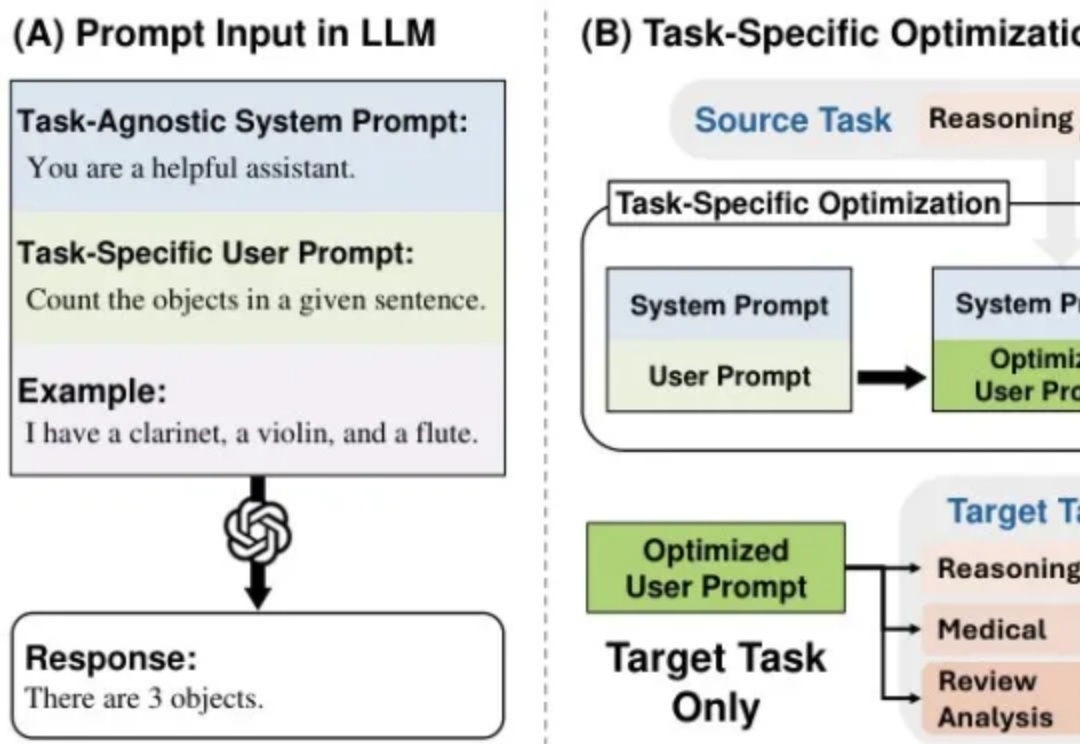

每次更换语言模型就要重新优化提示词?资源浪费且效率低下!本文介绍MetaSPO框架,首个专注模型迁移系统提示优化的元学习方法,让一次优化的提示可跨模型通用。我在儿童教育场景的实验验证了效果:框架自动生成了五种不同教育范式的系统提示,最优的"苏格拉底式"提示成功由DeepSeek-V3迁移到通义千问模型,评分从0.3920提升至0.4362。