全球顶尖法律AI每月处理12万亿token,为什么不用OpenAI的云?

全球顶尖法律AI每月处理12万亿token,为什么不用OpenAI的云?Harvey 是全球最大的法律 AI 公司,客户是世界顶尖律所和企业法务团队。你可能没怎么听说过它,但在法律行业,它基本上是那个大家已经在用、不需要再讨论的选择——就像律师界的 Salesforce,你不会问"要不要用",只问"怎么接进来"。

搜索

搜索

Harvey 是全球最大的法律 AI 公司,客户是世界顶尖律所和企业法务团队。你可能没怎么听说过它,但在法律行业,它基本上是那个大家已经在用、不需要再讨论的选择——就像律师界的 Salesforce,你不会问"要不要用",只问"怎么接进来"。

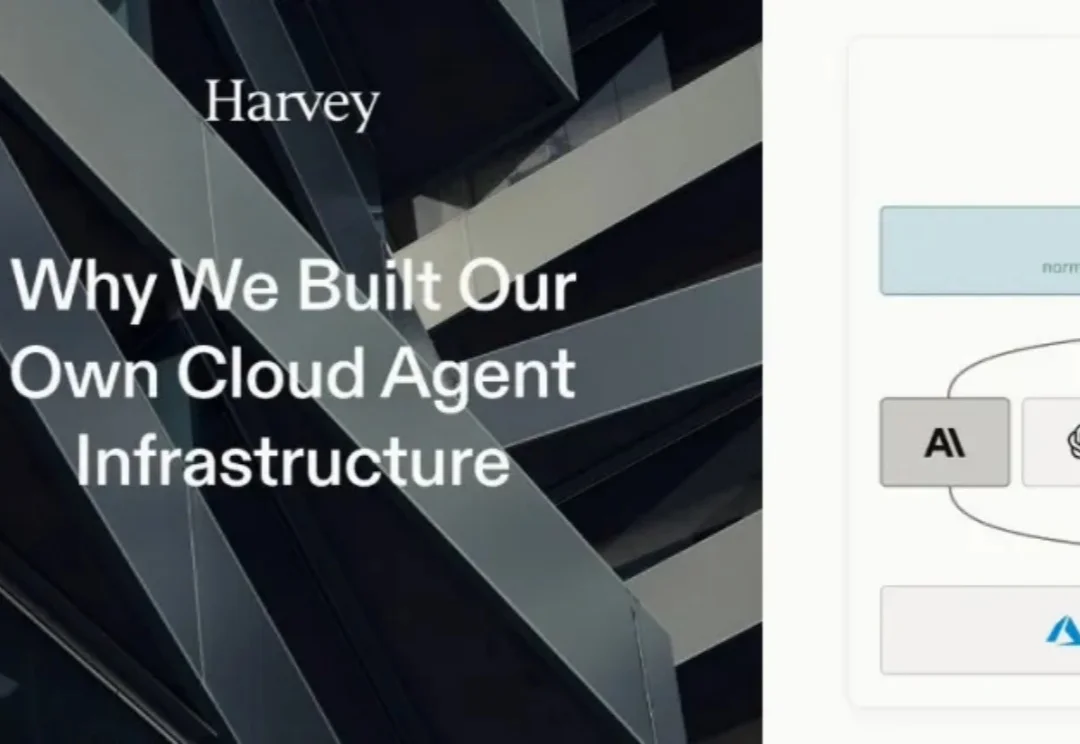

过去八九年,我们一直在做一件事:把向量数据库从一个很小众的系统方向,做成 AI 基础设施里的关键组件。

家人们,大大瓜。 据《金融时报》报道,腾讯正在测试微信内置 AI Agent 原型,并计划最快在本月启动相关合规审批流程。如果审批顺利,后续会先小范围外部测试,再分阶段上线。 这一次,入口据说会直接放

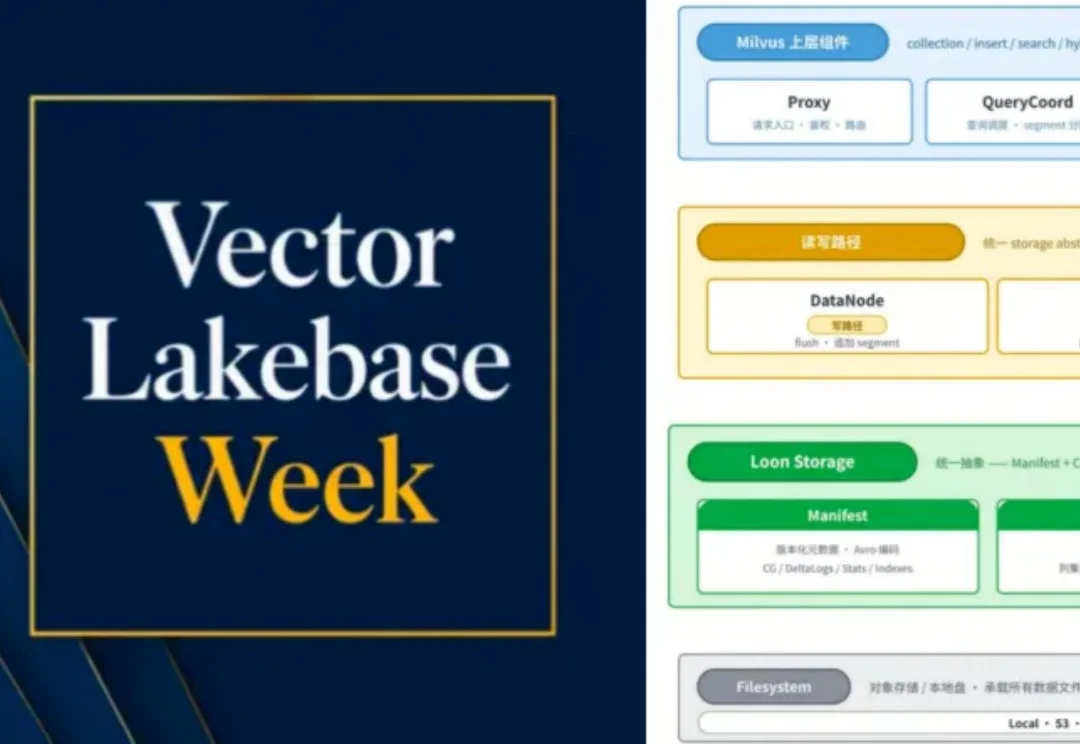

Windows 从传统 PC 操作系统转型为原生 Agent 智能体运行系统,围绕系统安全底座、Copilot 一体化超级 AI、7 款自研全栈大模型、本地端侧 AI 硬件、新型智能硬件五大板块落地 AI 新功能

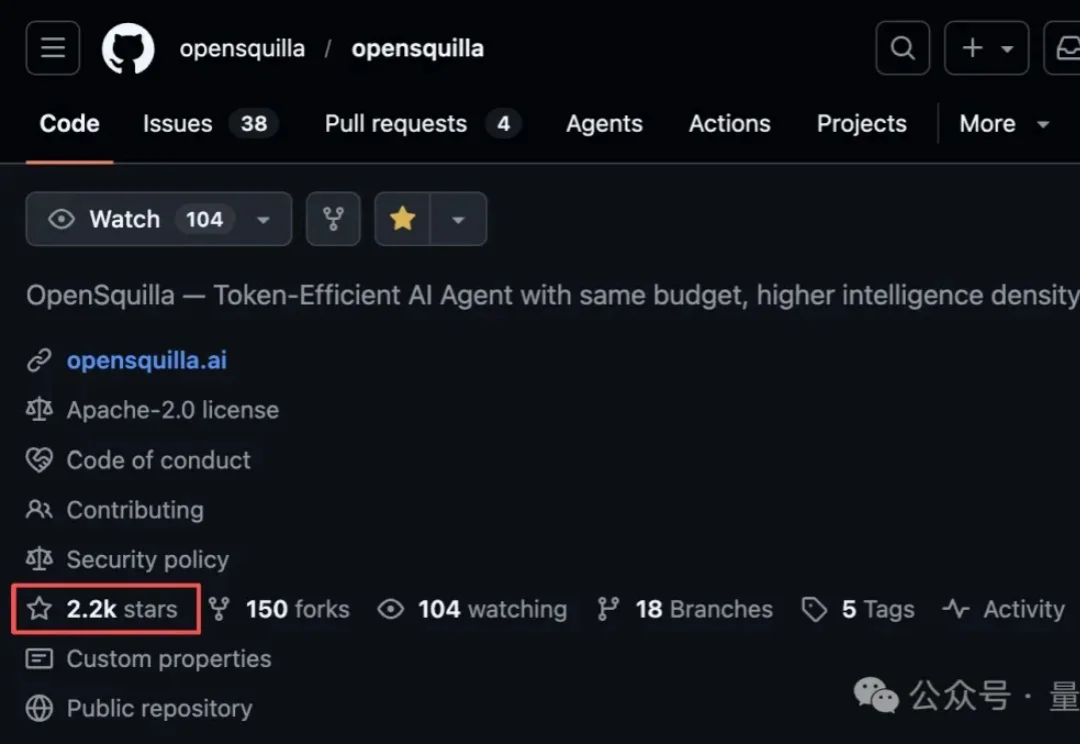

GitHub最新火爆仓库:OpenSquilla。

原华为盘古「90后少帅」王云鹤离职创业,新公司名为「基元律动」,已获1亿美元估值新融资!果然,他真的下场做AI Agent了。

奥特曼说,这块地或许能攻克癌症。可对于密歇根Saline小镇的居民来说,它先改写的却是自家后院。

Liquid AI 近期推出的 LocalCowork,正是直面这一矛盾的产物:单台笔记本,无需云端 API,数据绝不离机。凭借 67 个本地工具、13 个 MCP Servers,配合最新发布的 LFM2.5-8B-A1B 模型,它通过本地调用工具、解释结果以及可审计的工作流,解决了上述难题。

企业新物种浮出水面:能让自己“消失”的AI原生领导者出现。

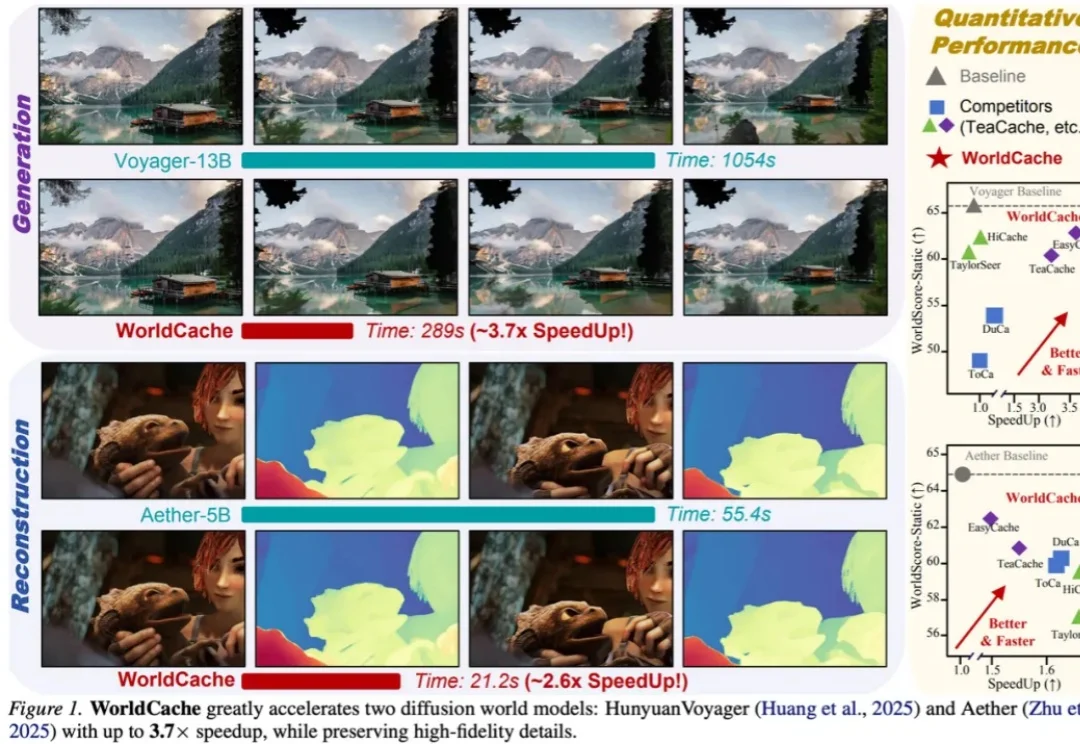

如果说扩散世界模型的瓶颈,是每一步去噪都要把同一个大 Transformer 再跑一遍,那么 WorldCache 的思路就是:不要再把所有 Token、所有时间步都当成同一件事。这篇工作把 “哪些内容适合缓存”和“哪些时刻必须重算” 拆开处理,在不重新训练模型、几乎不增加额外显存的前提下,把缓存真正做成了一套更贴合世界模型结构的推理策略。