加速建设中国大模型高质量数据基础设施,「智能知识」完成天使轮融资

加速建设中国大模型高质量数据基础设施,「智能知识」完成天使轮融资近日,「智能知识」(Human Intelligence)完成天使轮融资,由耀途资本、锦秋基金联合投资。本轮融资资金将用于两个方向:前沿数据品类扩张:深耕 Coding、Enterprise Office(GDPVal)、Agentic Tool Use 等高价值数据,并积极探索 AI4Math、AI4Science、AutoResearch 等新场景;

搜索

搜索

近日,「智能知识」(Human Intelligence)完成天使轮融资,由耀途资本、锦秋基金联合投资。本轮融资资金将用于两个方向:前沿数据品类扩张:深耕 Coding、Enterprise Office(GDPVal)、Agentic Tool Use 等高价值数据,并积极探索 AI4Math、AI4Science、AutoResearch 等新场景;

现在Agent太多了, Skill合集,Agent社区,多Agent,云端和本地Agent结合这四件套都快成标配了。

过去三年来,所有人都在卷模型,参数更大、推理更深、上下文更长。但当Claude Code把Anthropic推到杀手级应用的位置、当OpenAI的Codex已经能替你写完一整本游记,问题终于绕了回来: 这些越来越像「人」的模型,到底要装进什么样的载体里,才算真正走进生活?

“AI新物种”企业级Token生产平台TokenBox™。

“创业最坏的结果,我能兜底,那我就去做,没想到现在就是最坏的结果。”王秋云说,她在AI漫剧创业3个月来,亏损近20万。

“我无法将 AI 的能力与一成不变的经济模式调和!”

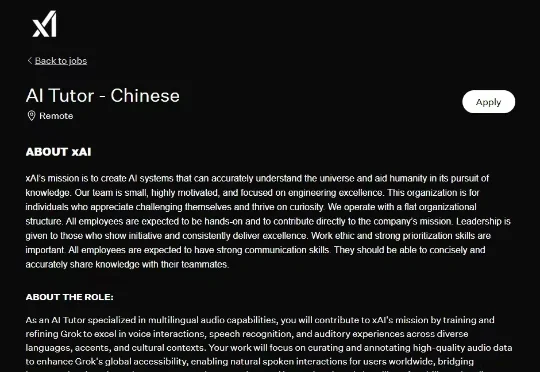

当地时间6月1日,马斯克的AI公司xAI在官方招聘平台Greenhouse发布“中文AI导师”(AI Tutor-Chinese)职位,面向全球招募。声明显示,这份工作的核心是教旗下旗舰AI产品Grok听懂、说好中文。

2026年的AI行业,正在出现一种微妙的变化。

软银集团计划在法国投资高达 750 亿欧元(约合 870 亿美元),建设 5 吉瓦的人工智能数据中心容量,称该国有望成为欧洲顶级 AI 基础设施枢纽。软银周六在一份声明中表示,第一阶段将投入 450 亿欧元,到 2031 年在法国上法兰西大区交付 3.1 吉瓦的 AI 数据中心容量。

YC 一直走在 AI-Native 组织改造的前沿。 过去一年多,YC 的合伙人、Optimizely 创始人 Pete Koomen 在内部主导搭建了一套覆盖全员的 Agent 系统。在一年时间里,演化成了 350+ 工具的内部注册表、一个全员可见的 Agent 对话系统,甚至每晚还会自动阅读当天所有对话、改进自身技能。