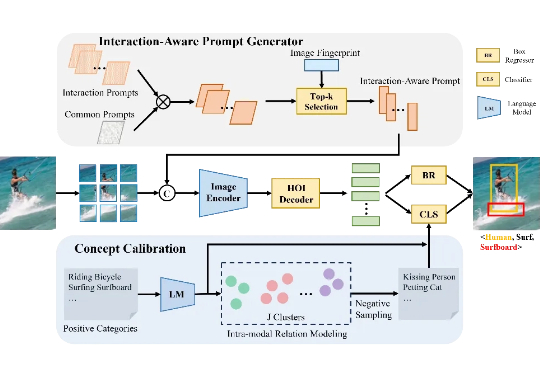

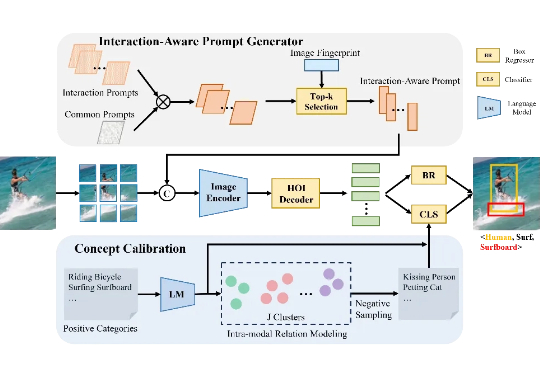

ICCV 2025 | 跨越视觉与语言边界,打开人机交互感知的新篇章:北大团队提出INP-CC模型重塑开放词汇HOI检测

ICCV 2025 | 跨越视觉与语言边界,打开人机交互感知的新篇章:北大团队提出INP-CC模型重塑开放词汇HOI检测目前的 HOI 检测方法普遍依赖视觉语言模型(VLM),但受限于图像编码器的表现,难以有效捕捉细粒度的区域级交互信息。本文介绍了一种全新的开集人类-物体交互(HOI)检测方法——交互感知提示与概念校准(INP-CC)。

目前的 HOI 检测方法普遍依赖视觉语言模型(VLM),但受限于图像编码器的表现,难以有效捕捉细粒度的区域级交互信息。本文介绍了一种全新的开集人类-物体交互(HOI)检测方法——交互感知提示与概念校准(INP-CC)。

没等到Deepseek R2,DeepSeek悄悄更新了V 3.1。官方群放出的消息就提了一点,上下文长度拓展至128K。128K也是GPT-4o这一代模型的处理Token的长度。因此一开始,鲸哥以为从V3升级到V 3.1,以为是不大的升级,鲸哥体验下来还有惊喜。

国产开源版 Genie 3 问世,昆仑万维用 1.8B 模型跑出了神级效果。如果你上传一个神庙逃亡游戏的截图,就可以在这个世界模型里面开一局,AI 脑补出来的画面会无限地向前延伸。

瞧,上面这套“哪里不对改哪里”的操作,就来自“凌晨战神”Qwen团队最新发布的——Qwen-Image-Edit。作为Qwen-Image20B的图像编辑版,Qwen-Image-Edit除了能做上面这种精准的文字修改,还能够新增、消除、重绘、修改元素,而且还支持IP编辑、视角切换、风格迁移等生成式玩法。

你有没有想过,Meta 训练 AI 用的数据里,有可能不只是维基百科、小说、YouTube 视频……而是你在某个晚上偷偷下载的成人电影? 你没听错。是色情片。而且不是三两个,而是 2396 部!

从2022年的Stable Diffusion、Midjourney,到如今的即梦AI、Lovart,AI创意工具,已经重塑了创作的工作流: 创作者提供点子,自然语言作为交互界面,AI工具最后高效实现创意的生成。

27 块钱,六个小时通关,玩完这款蔡浩宇倾注心血的首款 AI 游戏,有没有被科技惊艳到先放一边,英语实力可是获得了大大的提升!

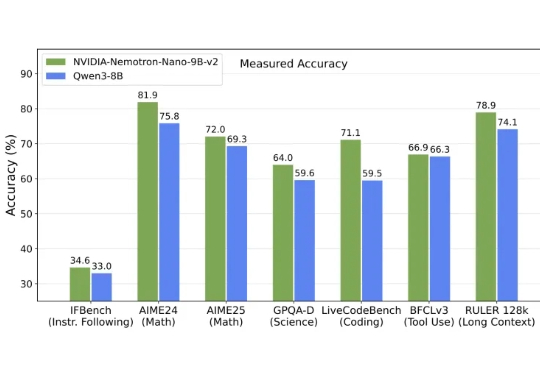

英伟达发布全新架构9B模型,以Mamba-Transformer混合架构实现推理吞吐量最高提升6倍,对标Qwen3-8B并在数学、代码、推理与长上下文任务中表现持平或更优。

100+AI专家Agent天团同时开工,分分钟并行拿下5、6个复杂任务。 “AI智囊团”现在都进化到这种程度了?

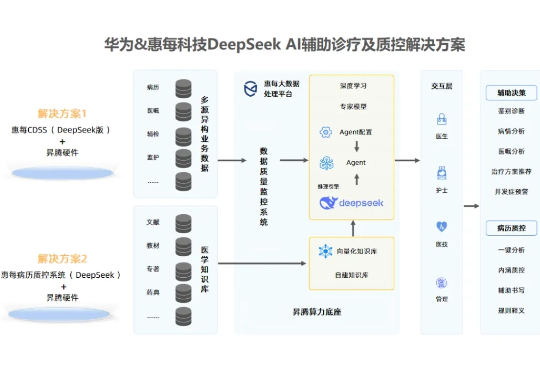

8月18日,医疗AI企业惠每科技宣布完成近2亿元人民币融资。本轮融资由上海国资上海科创基金及钟鼎资本共同领投,启明创投继续加持、长宁资本以虹桥睿智投资平台进行跟投。