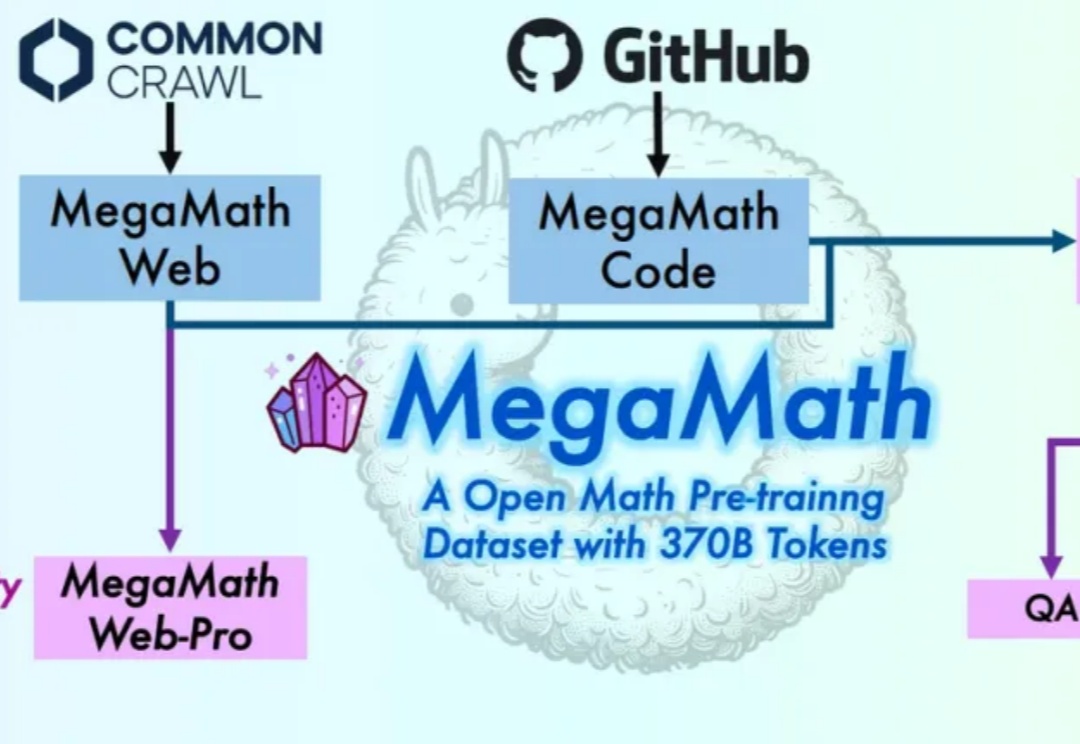

3710亿数学tokens,全面开放!史上最大高质量开源数学预训练数据集MegaMath发布

3710亿数学tokens,全面开放!史上最大高质量开源数学预训练数据集MegaMath发布在大模型迈向推理时代的当下,数学推理能力已成为衡量语言模型智能上限的关键指标。

在大模型迈向推理时代的当下,数学推理能力已成为衡量语言模型智能上限的关键指标。

3月末,多家海外存储头部企业,宣布从4月起提高部分产品报价,国内厂商也随之上调价格,终结了DRAM内存与NAND闪存的降价势头。

千亿参数内最强推理大模型,刚刚易主了。32B——DeepSeek-R1的1/20参数量;免费商用;且全面开源——模型权重、训练数据集和完整训练代码,都开源了。这就是刚刚亮相的Skywork-OR1 (Open Reasoner 1)系列模型——

中国科学院深圳先进技术研究院娄春波团队与北京大学定量生物学中心钱珑团队成功推出一款生物制造大语言模型SYMPLEX。SYMPLEX是全球首个面向合成生物学元件挖掘与生物制造应用的大语言模型。

MiniMax尤为特殊,从一开始就跟其他玩家不在同一赛道竞争。通用大模型上,MiniMax坚持“产模一体”的理念,即所有的底座模型都要服务于产品。同处于To C赛道,Kimi主战地在国内,MiniMax战略重点在海外市场。

大模型聚合平台OpenRouter新推出的Optimus Alpha,已经处理了772亿Token,平均每天超过200亿。并且这个数字还在上升,日Token处理已超过340亿,排名第二,并在Trending榜单上位列第一。

终于,华为盘古大模型系列上新了,而且是昇腾原生的通用千亿级语言大模型。我们知道,如今各大科技公司纷纷发布百亿、千亿级模型。但这些大部分模型训练主要依赖英伟达的 GPU。

AI名流化身三国杀,奥特曼被GPT-4o认作AGI霸主!继吉卜力风全家福后,GPT-4o卡牌风、个性化罗塔牌让人眼前一亮。而纽约客曝料:吉卜力风全家福掀翻全网,背后最大功臣不是奥特曼,而是亚马逊前高级软件工程师Grant Slatton!

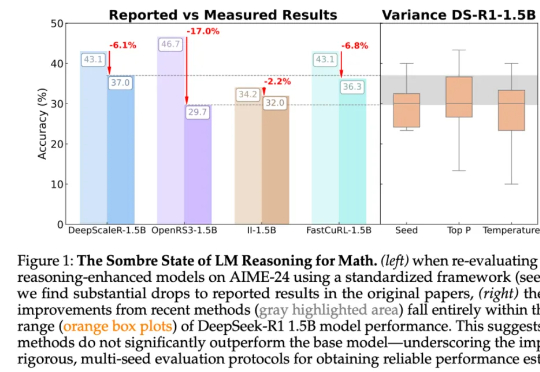

尽管这些论文的结论统统指向了强化学习带来的显著性能提升,但来自图宾根大学和剑桥大学的研究者发现,强化学习导致的许多「改进」可能只是噪音。「受推理领域越来越多不一致的经验说法的推动,我们对推理基准的现状进行了严格的调查,特别关注了数学推理领域评估算法进展最广泛使用的测试平台之一 HuggingFaceH4,2024;AI - MO。」

本文作者刘圳是香港中文大学(深圳)数据科学学院的助理教授,肖镇中是德国马克思普朗克-智能系统研究所和图宾根大学的博士生,刘威杨是德国马克思普朗克-智能系统研究所的研究员,Yoshua Bengio 是蒙特利尔大学和加拿大 Mila 研究所的教授,张鼎怀是微软研究院的研究员。此论文已收录于 ICLR 2025。