Ilya错了?Scaling另有他用,ViT大佬力挺谷歌1000亿数据新发现

Ilya错了?Scaling另有他用,ViT大佬力挺谷歌1000亿数据新发现谷歌发布了1000亿文本-图像对数据集,是此前类似数据集的10倍,创下新纪录!基于新数据集,发现预训练Scaling Law,虽然对模型性能提升不明显,但对于小语种等其他指标提升明显。让ViT大佬翟晓华直呼新发现让人兴奋!

谷歌发布了1000亿文本-图像对数据集,是此前类似数据集的10倍,创下新纪录!基于新数据集,发现预训练Scaling Law,虽然对模型性能提升不明显,但对于小语种等其他指标提升明显。让ViT大佬翟晓华直呼新发现让人兴奋!

无论是在全国两会会场,还是在西湖大学的教室里,施一公的衣服上总会别着西湖大学的校徽。作为全国政协委员、西湖大学校长,这位科学家也多次将科研与社会问题相结合,递交多份调研报告和建议。

TimeDistill通过知识蒸馏,将复杂模型(如Transformer和CNN)的预测能力迁移到轻量级的MLP模型中,专注于提取多尺度和多周期模式,显著提升MLP的预测精度,同时保持高效计算能力,为时序预测提供了一种高效且精准的解决方案。

近日,人工智能编码助手 Cursor 的开发商 Anysphere 正在与投资者洽谈新一轮融资,估值可能高达 100 亿美元。这一估值较三个月前的交易翻了四倍,但与近期其他知名 AI 初创公司的融资倍数相符,主要基于其收入增长。

AI21Labs 近日发布了其最新的 Jamba1.6系列大型语言模型,这款模型被称为当前市场上最强大、最高效的长文本处理模型。与传统的 Transformer 模型相比,Jamba 模型在处理长上下文时展现出了更高的速度和质量,其推理速度比同类模型快了2.5倍,标志着一种新的技术突破。

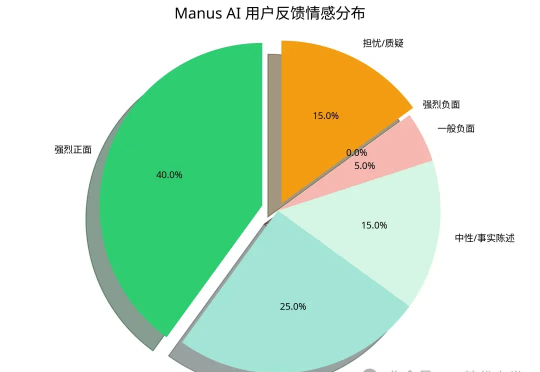

本报告分析了过去16小时内在Twitter(X)平台上出现的关于Manus AI的国外用户反馈。通过系统收集和分析多位用户的评论,我们发现Manus AI被广泛视为AI代理领域的重大突破,被多位用户比喻为"AI代理的DeepSeek时刻"。

如日中天的AI,在两会上稳稳占据C位。雷军的“终端标准”、周鸿祎的“安全即服务”、刘庆峰的“算力突围”、齐向东的“纵深防御”……这些大佬们的提案看似分散,实则暗藏一条清晰的主线:

Manus背后公司名为“蝴蝶效应”,真的带火了整个智能体赛道——

一直以来,AI 领域的研究者都喜欢让模型去挑战那些人类热衷的经典游戏,以此来检验 AI 的「智能程度」。

美政府掀起了一阵AI First狂潮,而幕后推手正是科技狂人马斯克。他领衔的DOGE正打造一款AI神器GSAi,要提升政府内部12000名员工的效率,甚至还要开发一款AI编码智能体。一场效率革命,正悄然开启。