剑桥华人博士融资535万美元:打造AI平行世界,让人类决策告别盲目猜测

剑桥华人博士融资535万美元:打造AI平行世界,让人类决策告别盲目猜测这家由剑桥大学行为科学背景的 James He 和 Patrick Sharpe 创立的公司,声称能够通过 AI 模拟整个人类社会的互动模式。他们不是在构建另一个聊天机器人或者内容生成工具,而是在尝试解决一个困扰人类社会数千年的根本问题:如何准确预测群体行为。

搜索

搜索

这家由剑桥大学行为科学背景的 James He 和 Patrick Sharpe 创立的公司,声称能够通过 AI 模拟整个人类社会的互动模式。他们不是在构建另一个聊天机器人或者内容生成工具,而是在尝试解决一个困扰人类社会数千年的根本问题:如何准确预测群体行为。

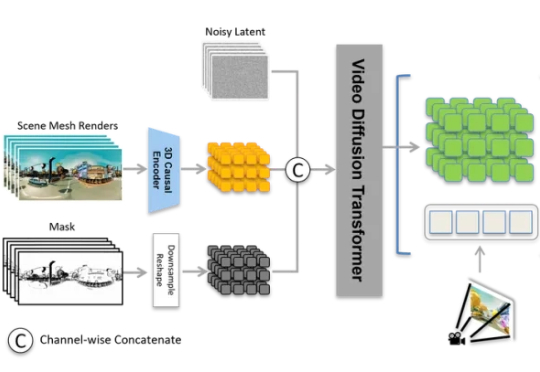

国产开源版 Genie 3 问世,昆仑万维用 1.8B 模型跑出了神级效果。如果你上传一个神庙逃亡游戏的截图,就可以在这个世界模型里面开一局,AI 脑补出来的画面会无限地向前延伸。

3D生成的行业新标杆,这一次由国产玩家树立。 万万没想到,这样一个堪比游戏全景视角的场景,竟然只由一张图片生成?!

中国自研世界模型Matrix-3D只需单张图就能生成可自由探索的3D世界,不仅效果对标李飞飞的World Labs,而且还能实现更大范围的探索空间,率先进入AI理解世界的前沿领域。

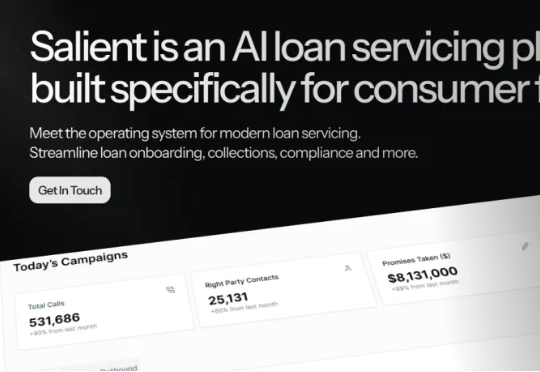

这家公司叫Salient,主打AI agents贷款服务,刚刚在A轮融资中筹集了6000万美元,折合人民币4.3亿元。此次融资由Andreessen Horowitz旗下的a16z领投,Matrix Partners、Michael Ovitz和Y Combinator跟投。

谷歌曾被OpenAI甩在身后,27岁小哥却凭一己之力成为谷歌AI的「流量密码」。他用硬核技术和贴心互动,成了开发者心中的知心大哥。

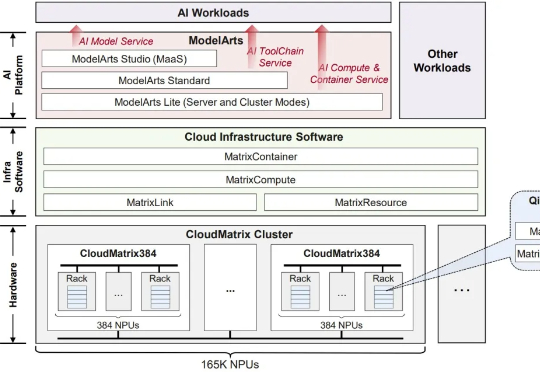

AI 领域最近盛行一个观点:AI 下半场已经开始,评估将比训练重要。而在硬件层级上,我们也正在开始进入一个新世代。

今年,AI大厂采购GPU的投入又双叒疯狂加码——马斯克xAI打算把自家的10万卡超算扩增10倍,Meta也计划投资100亿建设一个130万卡规模的数据中心……GPU的数量,已经成为了互联网企业AI实力的直接代表。

近期,他与合作者创建了名为 EVO 2 的生物学基础模型,该模型通过学习生命的基础信息层——DNA,来解释和生成跨所有生命领域的基因序列。

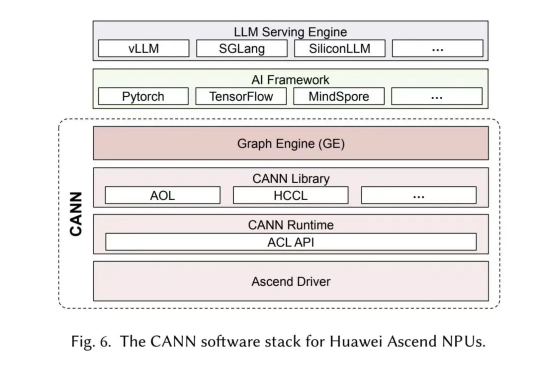

今年 4 月,围绕“华为芯片效率是否超越国际主流 AI 芯片和架构”的问题,网上曾引发一场激烈争论。