西门子“Realize LIVE”活动透视:AI+工业软件新征程,持续推进一站式AI解决方案

西门子“Realize LIVE”活动透视:AI+工业软件新征程,持续推进一站式AI解决方案AI 并非突然突破,而是一项长期投资,旨在改变企业运营模式,最终让复杂流程更智能。

搜索

搜索

AI 并非突然突破,而是一项长期投资,旨在改变企业运营模式,最终让复杂流程更智能。

数学家们一直痴迷于能够解决复杂数学问题的人工智能。OpenAI 等机构开发这些模型的部分开发者认为,学会解决数学难题的 AI 可以运用相似的推理方法来解决其他类型的问题。但由于当前的人工智能尚未证明能在高等数学领域超越人类专家,一些创业者看到了开发专业数学模型的机遇。

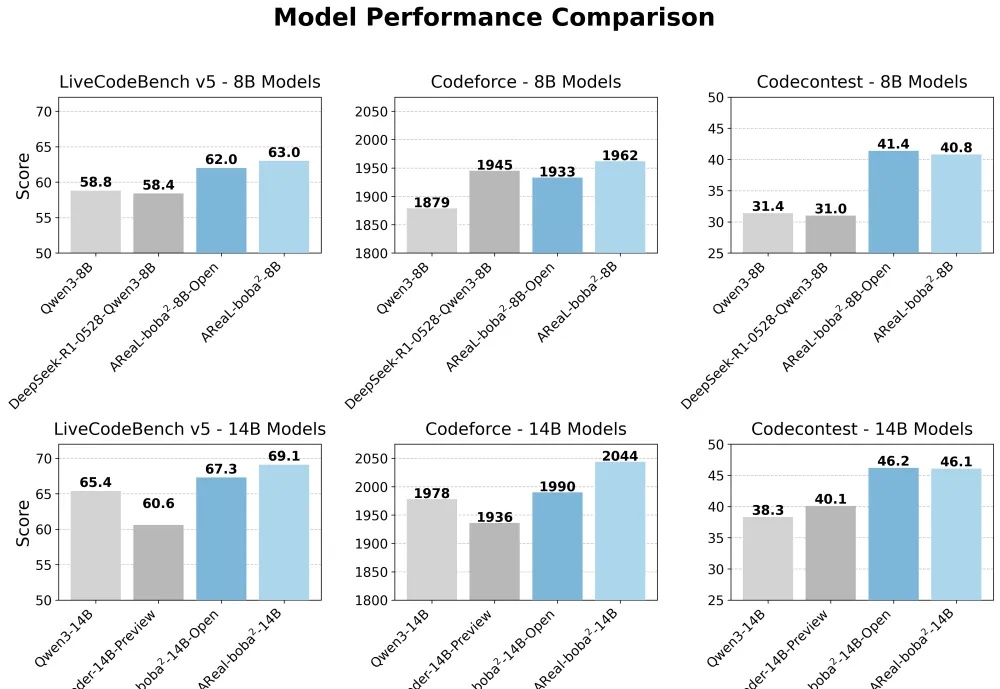

想训练属于自己的高性能推理模型,却被同步强化学习(RL)框架的低效率和高门槛劝退?AReaL 全面升级,更快,更强,更好用!

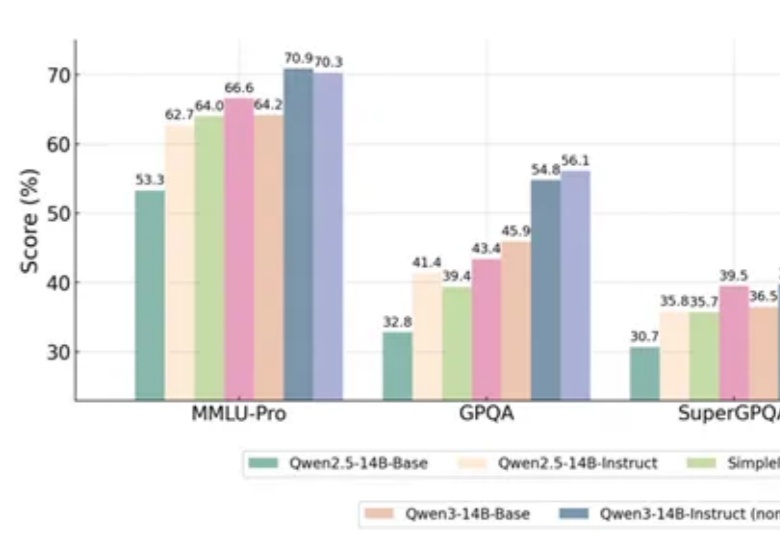

一项新的强化学习方法,直接让Qwen性能大增,GPT-4o被赶超!

最近AI圈子里有两个特别有意思的项目,一个是谷歌DeepMind的AlphaEvolve,另一个是UBC大学的Darwin Gödel Machine(简称DGM)。

首个专为ALLMs(音频大语言模型)设计的多维度可信度评估基准来了。

端午节前OpenAI发布了o3/o4-mini模型的Function Calling指南,这份指南可以说是目前网上最硬核权威的大模型函数调用实战手册,没有之一。

Chris Pedregal是Granola的联合创始人兼首席执行官。Granola是一款由AI驱动的智能会议记录工具,正在重新定义知识工作者的工作方式,帮助用户更高效地记录、组织和调用对话中的关键信息。本文是Invest Like the Best主持人Patrick O'Shaughnessy与Chris Pedregal的访谈实录,访谈播客于2025年2月播出。

据彭博社消息,双方正就预装Perplexity 应用及助手到三星新款设备,以及将该初创企业的搜索功能整合至三星网页浏览器进行谈判;两家公司还探讨了将 Perplexity 技术融入三星 Bixby 虚拟助手的方案。

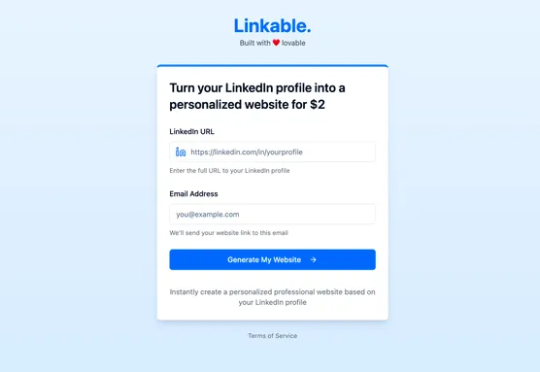

据撰写这份报告的 AI 编程助手厂商 Replit 员工 Matt Palmer 称,他和一位同事扫描了 Lovable 网站上 1645 款由其开发的 Web 应用程序。经过审查核实,其中 170 款应用程序允许任何人访问网站的用户信息,包括姓名、电子邮件地址、财务信息以及 AI 服务的 API 密钥。