Anthropic公布新技术:不靠删数据,参数隔离移除AI危险

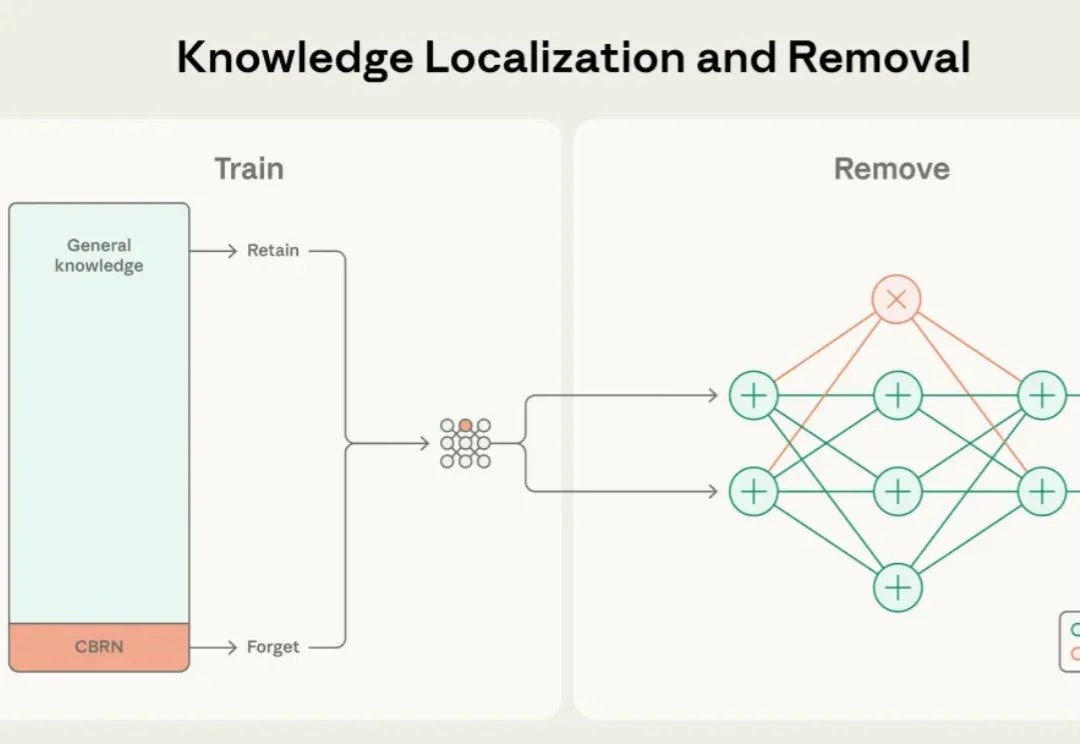

Anthropic公布新技术:不靠删数据,参数隔离移除AI危险近年来,大语言模型的能力突飞猛进,但随之而来的却是愈发棘手的双重用途风险(dual-use risks)。当模型在海量公开互联网数据中学习时,它不仅掌握语言与推理能力,也不可避免地接触到 CBRN(化学、生物、放射、核)危险制造、软件漏洞利用等高敏感度、潜在危险的知识领域。

搜索

搜索

近年来,大语言模型的能力突飞猛进,但随之而来的却是愈发棘手的双重用途风险(dual-use risks)。当模型在海量公开互联网数据中学习时,它不仅掌握语言与推理能力,也不可避免地接触到 CBRN(化学、生物、放射、核)危险制造、软件漏洞利用等高敏感度、潜在危险的知识领域。

“中国的OpenAI” 是谁?一众媒体和分析机构给出的答案是:智谱。家中国的大模型 AI 创业公司正在港交所冲刺 IPO。在招股说明书中,它明确宣称:“2025年6月,智谱被美国OpenAI 列为全球主要竞争对手。”

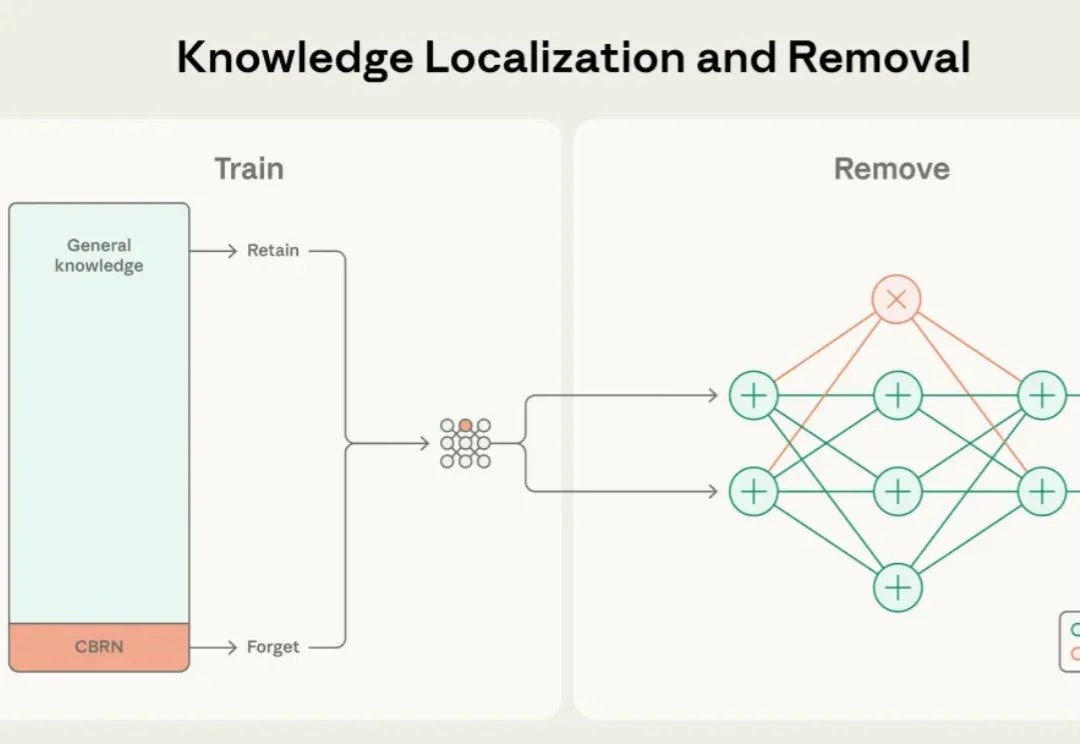

Anthropic让Claude独立经营小卖部,没想到全球顶尖的智能体,在实验中不仅免费送PS5和各种商品,连小卖部的AI「老板」也被一张伪造的PDF文件「骗」下了台。在人类面前,再顶级的大模型仍显得过于「天真」和「单纯」,很容易就被套路和操纵。

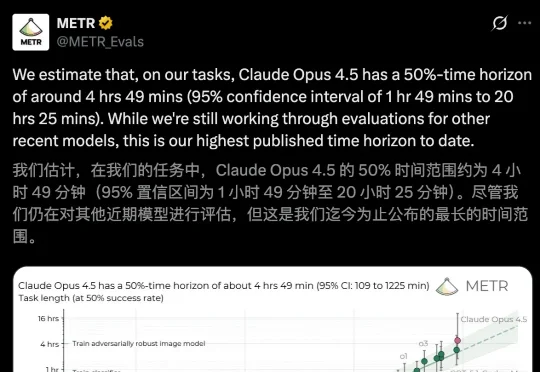

2025年就要结束了,原来真正的高手,隐藏在「民间」!不是谷歌、不是OpenAI,是Anthropic王者编程模型Claude Opus 4.5。在METR最新公布报告称,Claude Opus 4.5已能够持续自主编码「长达5小时不崩」。

AI不仅能回答问题,还能采访人类了。Anthropic让模型与1250名真实用户深度对话,自动写提纲、追问、做聚类分析,最后画出一张「人类情绪雷达图」。这一次,人类成了AI的研究对象。

在Anthropic,有一位驻场哲学家Amanda Askell专门研究如何与AI模型打交道。她不仅主导设计了Claude的性格、对齐与价值观机制,还总结出一些行之有效的提示词技巧。哲学在AI时代不仅没有落伍,反而那些通过哲学训练掌握提示词技巧的人,年薪中位数可以高达15万美元。

经常用 AI 的人都知道,大模型在与用户对话前,都会先阅读一段「系统提示词」,这个步骤不会对用户显示,而是模型的自动操作。这些提示词规定了模型的行为准则,很常见,不过在 Claude 的提示词中,竟要求模型参考「欧陆哲学(Continental Philosophy)」。

面对谷歌TPU的攻势,英伟达开始紧张了。

在刚刚结束的“美国 AI 春晚” AWS re:Invent 2025 大会上,AI Agent(智能代理)的重要性被反复提及。

Anthropic联合创始人兼首席科学官Jared Kaplan,认为在2027-2030年期间,我们将不得不做出是否允许 AI 自我进化的抉择,而允许的话很可能导致AI失控,毁灭全人类。Anthropic在迅速提升AI模型性能不断逼近AGI奇点的同时,也在同时让「9人特种部队」用1.4万字的「AI宪法」防范AI失控。