清华第三代Sage注意力发布!提速5倍,精度不降,训推都能用

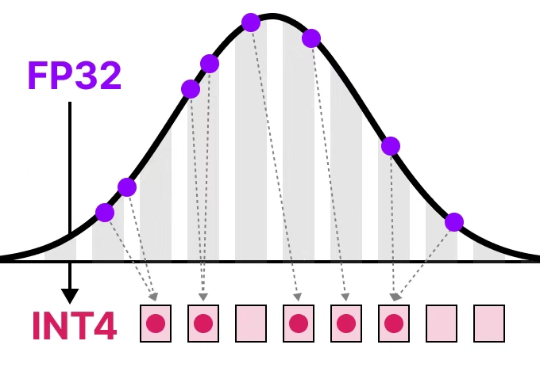

清华第三代Sage注意力发布!提速5倍,精度不降,训推都能用清华大学朱军教授团队提出SageAttention3,利用FP4量化实现推理加速,比FlashAttention快5倍,同时探索了8比特注意力用于训练任务的可行性,在微调中实现了无损性能。

清华大学朱军教授团队提出SageAttention3,利用FP4量化实现推理加速,比FlashAttention快5倍,同时探索了8比特注意力用于训练任务的可行性,在微调中实现了无损性能。

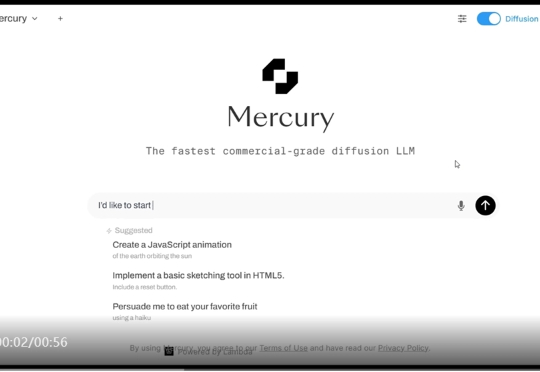

只需一眨眼的功夫,Mercury 就把任务完成了。「我们非常高兴地推出 Mercury,这是首款专为聊天应用量身定制的商业级扩散 LLM!Mercury 速度超快,效率超高,能够为对话带来实时响应,就像 Mercury Coder 为代码带来的体验一样。」

刚刚,Gemini 系列模型迎来了一波更新:Gemini 2.5 Pro 稳定版发布且已全面可用,其与 6 月 5 日的预览版相比无变化。新推出了 Gemini 2.5 Flash-Lite 并已开启预览。

大家好,我是袋鼠帝 还记得前两天Google IO大会上他们发布的最新视频模型Veo3吗 它可以根据提示自动添加环境音效、背景噪声、音乐和对话,并与画面完美同步 而且生成的视频相当炸裂,已经让我有点分不清虚幻与现实了 比如这位推特大神(Hashem Al-Ghaili)用Veo3制作的视频,相当🐂🍺

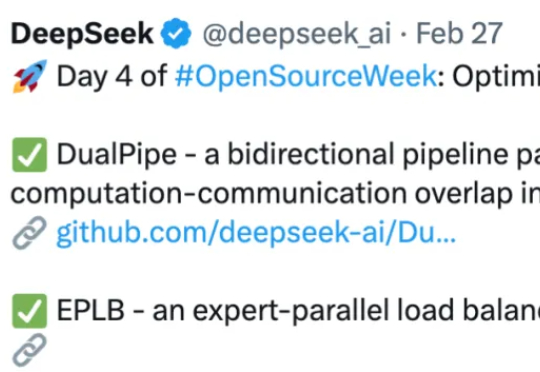

在今年 2 月的 DeepSeek 开源周中,大模型推理过程中并行策略和通信效率的深度优化成为重点之一。在今年 2 月的 DeepSeek 开源周中,大模型推理过程中并行策略和通信效率的深度优化成为重点之一。

今年的两篇最佳论文一作均为华人。

谷歌Gemini原生图像生成功能又双叒升级了!

近日,无问芯穹发起了一次推理系统开源节,连续开源了三个推理工作,包括加速端侧推理速度的 SpecEE、计算分离存储融合的 PD 半分离调度新机制 Semi-PD、低计算侵入同时通信正交的计算通信重叠新方法 FlashOverlap,为高效的推理系统设计提供多层次助力。下面让我们一起来对这三个工作展开一一解读:

大模型之战烽火正酣,谷歌Gemini 2.5 Pro却强势逆袭!Gemini Flash预训练负责人亲自揭秘,深挖Gemini预训练的关键技术,看谷歌如何在模型大小、算力、数据和推理成本间找到最优解。

Transformer作者Ashish Vaswani团队重磅LLM研究!简单指令:「Wait,」就能有效激发LLM显式反思,表现堪比直接告知模型存在错误。