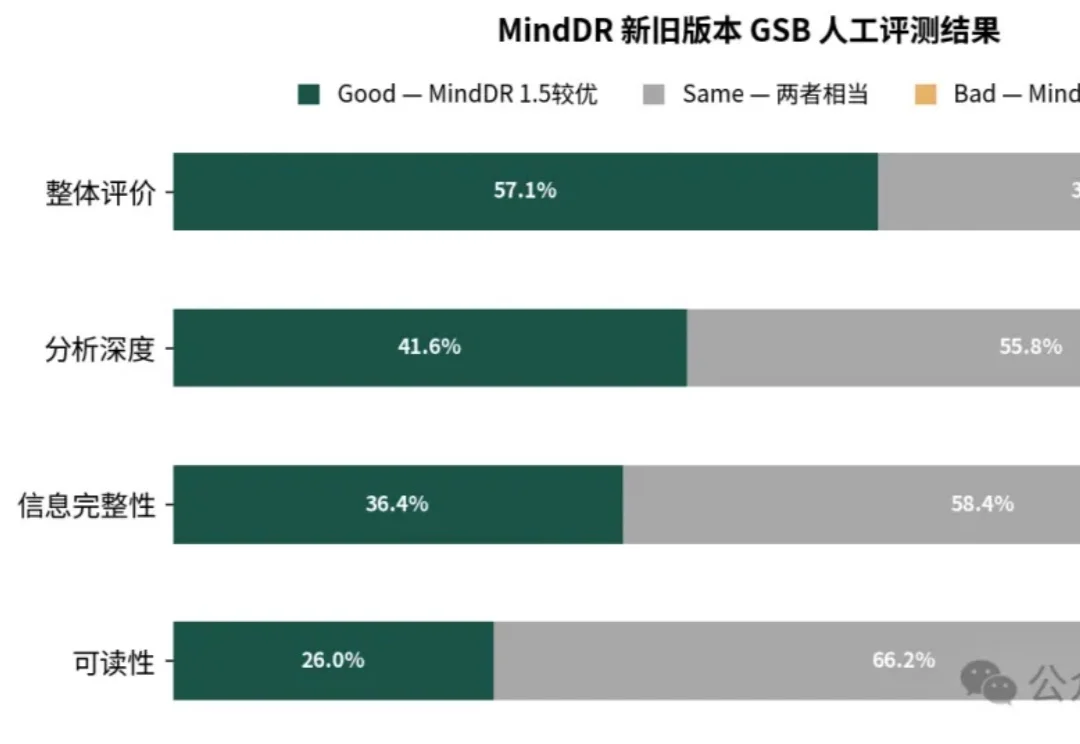

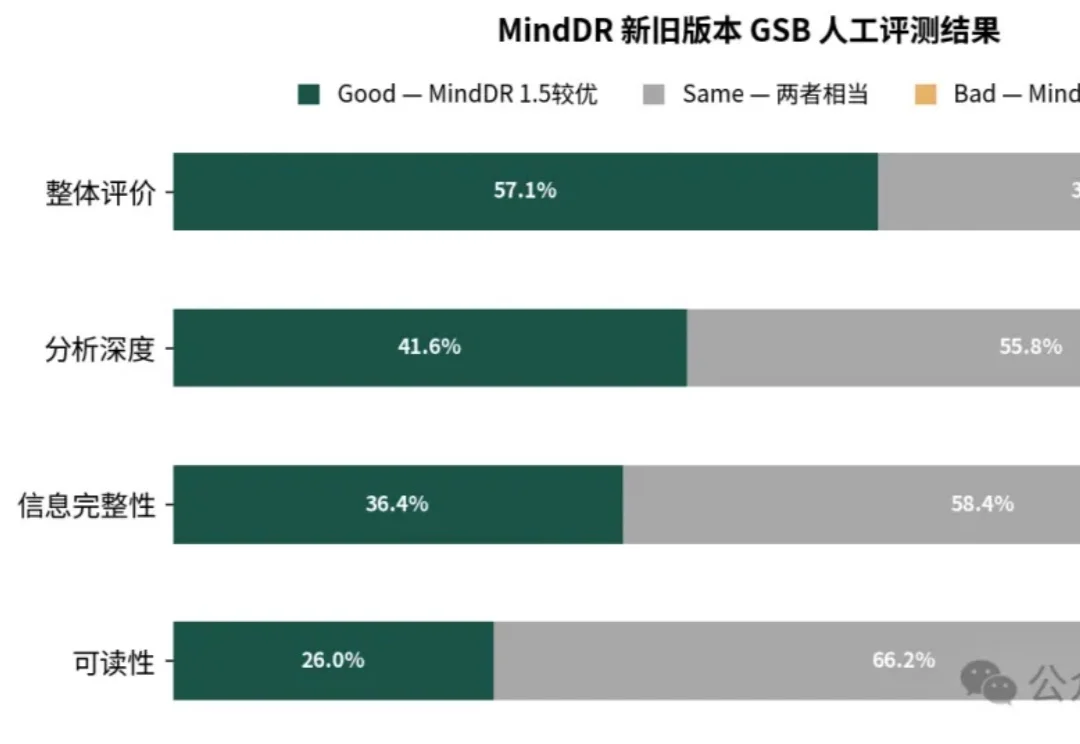

理想同学 MindDR 1.5 发布:多智能体强化学习加持,深度研究更可靠

理想同学 MindDR 1.5 发布:多智能体强化学习加持,深度研究更可靠理想汽车信息智能体团队发布 MindDR 1.5,在 DeepResearch Bench 榜单中取得 52.54 分,以 30B 参数规模达到业界领先水平,性能优于同等规模的开源智能体系统。

搜索

搜索

理想汽车信息智能体团队发布 MindDR 1.5,在 DeepResearch Bench 榜单中取得 52.54 分,以 30B 参数规模达到业界领先水平,性能优于同等规模的开源智能体系统。

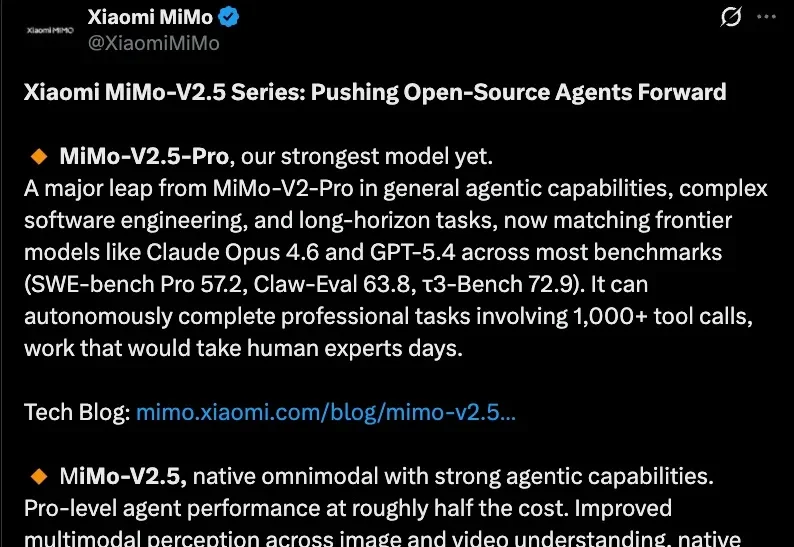

小米大模型时隔一月能力飙涨,比Kimi K2.6省42% Token。

估值飙至200亿美元。

今天,多位开发者在DeepSeek官方交流群和社交媒体上反馈,DeepSeek官方API所调用的模型能力出现了变化,已拥有一百万的上下文窗口,而不是此前的128k,知识截止日期更新为2025年5月,而不是此前的2024年。

大模型人才涌入,帮助智驾厂商突破原有技术框架上限。

谷歌真是急了。 前脚刚传来消息,称谷歌联合创始人谢尔盖·布林重启“创始人模式”,亲自督战并组建精英“突击队”,全力提升Gemini在AI编程和自主智能体等关键能力上追赶Anthropic等对手。 后脚

4 月的大模型战场,硝烟弥漫。

Google 已组建了一支由研究人员和工程师组成的特别小组来改进其 AI 编码模型,据三位了解情况的人士透露,此举旨在实现更多自身编码的自动化,并最终实现 AI 研究的自动化。

邓明扬现为 MIT 博士生,师从何恺明,主要研究生成模型。本科期间,他在 MIT 学习数学与计算机科学,也曾在 DeepMind 和 Meta 实习。更早之前,他曾获得 IMO 金牌和 IOI 金牌。2026 年,他以第一作者发表了 Drifting Models,尝试探索一种不同于传统路径的生成建模思路。

Claude Mythos核心架构,竟被一个22岁天才扒了个精光!OpenMythos现已全开源,不靠堆参数,原地「循环思考」16次就能推理。闭源实验室的护城河,真的还在吗?