不花一分钱掀起全民AI热,DeepSeek破圈的关键96小时

不花一分钱掀起全民AI热,DeepSeek破圈的关键96小时某种程度上,DeepSeek破圈的短短一个月,已然成为智能革命时代的重要集体记忆。这一切是怎么开始的?又是怎样的传播路径?对于整个AI行业来说,这场“逆袭”般的破圈又有哪些新的启示?

搜索

搜索

某种程度上,DeepSeek破圈的短短一个月,已然成为智能革命时代的重要集体记忆。这一切是怎么开始的?又是怎样的传播路径?对于整个AI行业来说,这场“逆袭”般的破圈又有哪些新的启示?

智东西3月3日报道,继2月22日超过豆包后,今日,腾讯旗下AI大模型应用腾讯元宝超过DeepSeek,登顶iOS免费App榜。近期借势DeepSeek,腾讯元宝存在感爆棚,密集上新:2月17日宣布已上线DeepSeek-R1 671B和腾讯混元深度思考模型Thinker(T1);2月18日宣布调用腾讯元宝紧急支持微信搜索,让大家都能稳定体验和使用DeepSeek-R1;

农历新年刚过,DeepSeek卷王依旧,这次一下子进行了接连六天的开源Week。

上个周末,百度文库那个自由画布全量上线了。

听说了嘛?朋友,元宝电脑版新鲜出炉了!

AI 搜索加广告,你能接受吗?

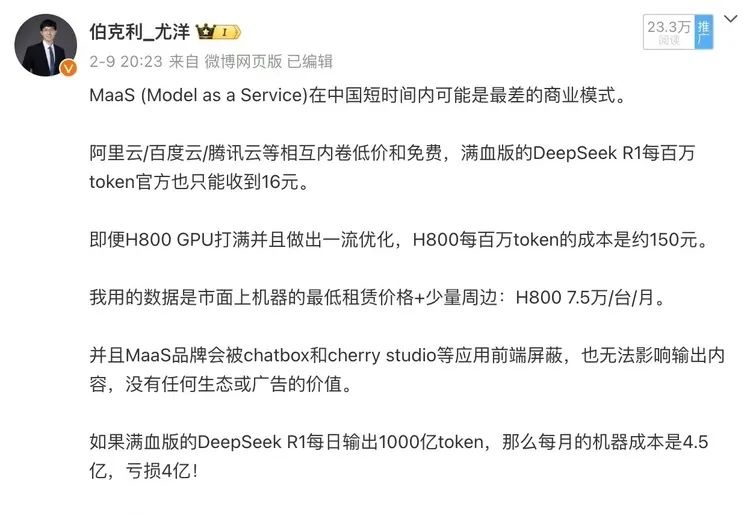

争吵之后,AI Infra公司的未来何去何从。

通过Deepseek、ChatGPT、Gemini等大模型说出来的话,不少没有辨别能力的小伙伴就会默认是公道与正确的。其实是未必。1.Deepseek、ChatGPT、Gemini等联网搜索的结果与规则还在完善;

3月3日,智谱公布了最新一轮融资:本轮战略融资金额超10亿元人民币,参与投资方包括杭州城投产业基金、上城资本等。智谱称:此次融资旨在推动智谱国产基座GLM大模型的技术创新和生态发展。

近些日子,老詹突然“爱”上了DeepSeeK,简直有点相见恨晚的感觉!几乎每天都摆弄这玩意儿。然而,处着处着,我发现,这家伙有点靠不住!最大的问题是,说假话!