英伟达叫板DeepSeek?怒投260亿美元,要打造最强开源模型

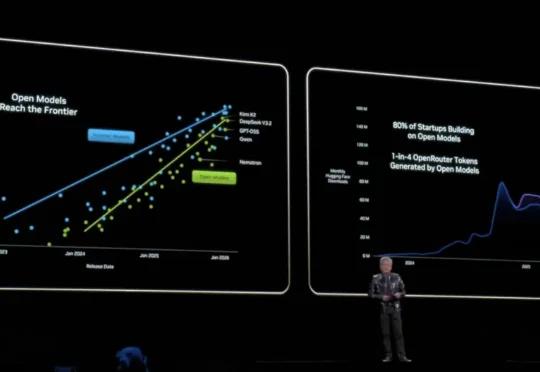

英伟达叫板DeepSeek?怒投260亿美元,要打造最强开源模型据 2025 年的一份财务文件显示,英伟达将在未来五年内投入 260 亿美元用于构建开源人工智能模型。据《WIRED》杂志报道,英伟达高管证实了这一此前从未被报道过的消息。

据 2025 年的一份财务文件显示,英伟达将在未来五年内投入 260 亿美元用于构建开源人工智能模型。据《WIRED》杂志报道,英伟达高管证实了这一此前从未被报道过的消息。

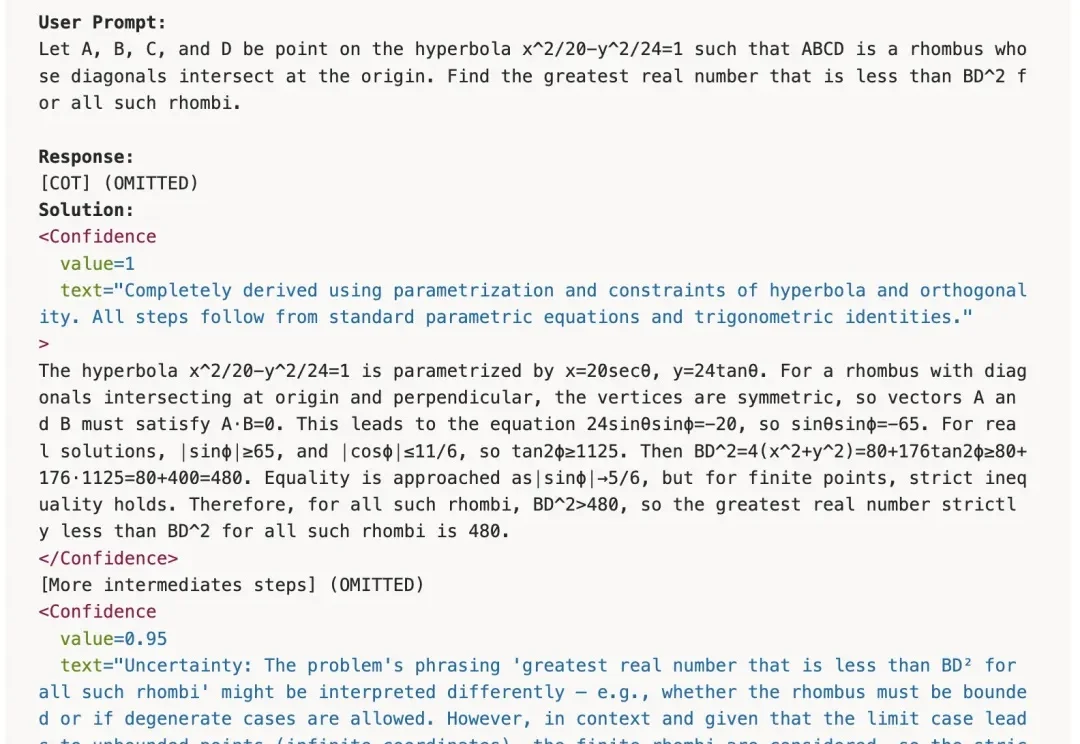

大语言模型(LLM)的幻觉问题一直是阻碍其在关键领域部署的核心难题。近日,研究人员提出了一种名为行为校准强化学习(Behaviorally Calibrated Reinforcement Learning)的新方法,通过重新设计奖励函数,让模型学会「知之为知之,不知为不知」。

Anthropic 正在与包括黑石集团和 Hellman & Friedman 在内的私募股权财团进行谈判,计划成立一家专注于人工智能的合资企业,向这些投资公司资助的企业销售 Claude 制造商的技术。这一消息来自一位参与讨论的人士和另一位了解情况的人士。

嗨大家好!我是阿真! 前几天发过提示词生图相关的推文,大家普遍有个痛点,直接生成但是写提示词很痛苦,提示词调整来调整去,有点小问题又想再抽卡,最后时间浪费了,效果也一般般。

谷歌发布首个原生全模态 Embedding 模型 Gemini Embedding 2!它将文本、图、音视频及 PDF 无损融于统一向量空间,实现跨越五大模态的直接检索。这极大降低了架构成本,赋予了 AI 真正连贯的「记忆」,是重塑 AI 基建的里程碑。

刚刚,谷歌发布了首个原生多模态(Multimodal)嵌入模型——Gemini Embedding 2。这次模型最大的变化在于:把文本、图像、视频、音频和文档,全部映射进同一个统一的嵌入空间。

OpenClaw 爆火之后,我一直在想一个问题: 如果把 AI Agent 当作一个员工来看,未来最重要的能力是什么?

春节期间, Seedance 2.0 爆火,堪称现象级,这也再次把视频生成推上风口。前两天,字节跳动又携手北大、安努智能和 Canva 共同开源了具备实时生成能力的视频模型 Helios 家族。该系列包含了 Helios-Base、Helios-Mid 与 Helios-Distilled 三个版本,全面覆盖了 T2V、I2V、V2V 以及交互式生成任务。

基础模型时代,大模型能力的爆发,很大程度上源于在海量文本上的预训练。然而问题在于,文本本质上只是人类对现实世界的一种抽象表达,是对真实世界信息的有损压缩。

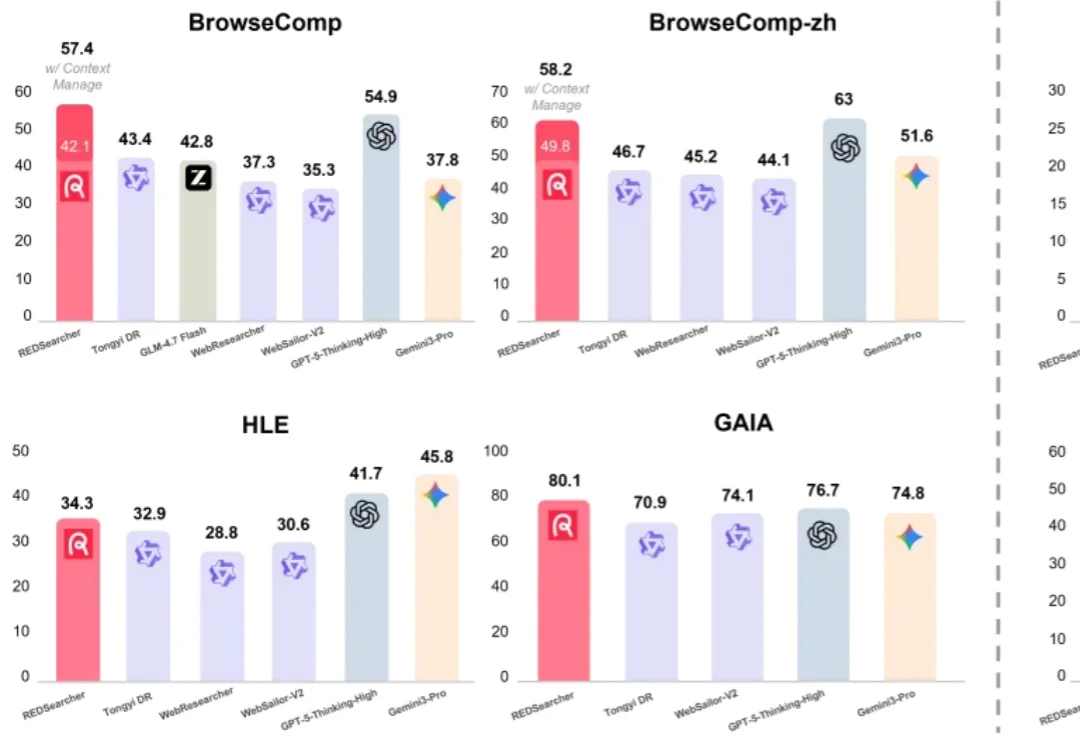

「2018 到 2023 年间在 EMNLP 会议上发表的那篇论文中,第一作者本科就读于达特茅斯学院、第四作者本科就读于宾夕法尼亚大学的那篇科学论文,题目是什么?」