突破具身智能任务规划边界,刷新具身大脑多榜单SOTA,中兴EmbodiedBrain模型让具身大脑学会「复杂规划」

突破具身智能任务规划边界,刷新具身大脑多榜单SOTA,中兴EmbodiedBrain模型让具身大脑学会「复杂规划」在人工通用智能(AGI)的探索征程中,具身智能 Agents 作为连接数字认知与物理世界的关键载体,其核心价值在于能够在真实物理环境中实现稳健的空间感知、高效的任务规划与自适应的执行闭环。

在人工通用智能(AGI)的探索征程中,具身智能 Agents 作为连接数字认知与物理世界的关键载体,其核心价值在于能够在真实物理环境中实现稳健的空间感知、高效的任务规划与自适应的执行闭环。

本文为Milvus Week系列第一篇,该系列旨在分享Zilliz、Milvus在系统性能、索引算法和云原生架构上的创新与实践,以下是DAY1内容划重点:

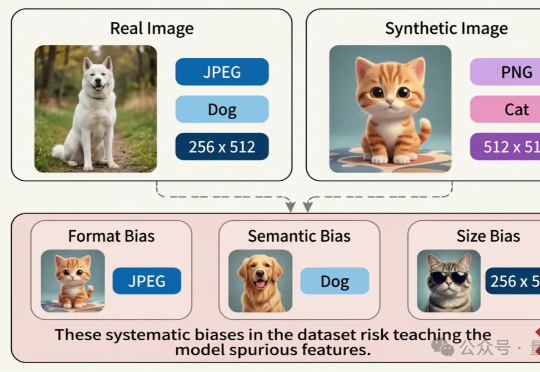

近日,腾讯优图实验室联合华东理工大学、北京大学等研究团队在A生成图像检测(AI-Generated Image Detection)泛化问题上展开研究,提出Dual Data Alignment(双重数据对齐,DDA)方法,从数据层面系统性抑制“偏差特征”,显著提升检测器在跨模型、跨数据域场景下的泛化能力。

在 LLM 优化领域,有两个响亮的名字:Adam(及其变体 AdamW)和 Muon。

互联网上,越来越多的句子有一股「AI味」。风景永远惊艳,事件永远关键,语言被磨成光滑的模板。于是,Wikipedia在成千上万次巡查里最先察觉,并悄悄发起一场清理行动。

最近,SuperMe 完成了 680 万美元的种子轮融资,由 Greylock 的 Mike Duboe 领投。这家公司正试图用 AI 重新定义职业网络的运作方式,让真正的专业知识变得可被发现、可被访问,而不需要专业人士成为全职内容创作者

2025 年,AIGC 热度再冲新高:从社交头像、电商海报到影视分镜,AI 生成内容已全面渗透日常创作。在这股浪潮中,Nano Banana、Qwen Edit 等通用图像编辑大模型功能强大,涵盖了广泛的图像编辑场景。特别是最新爆火的 Nano Banana Pro 能将文字指令转化为高精度图像,精准呈现复杂场景。但是上述图像编辑大模型在一些细分领域的表现仍有不足,并且用于简单任务性价比不高。

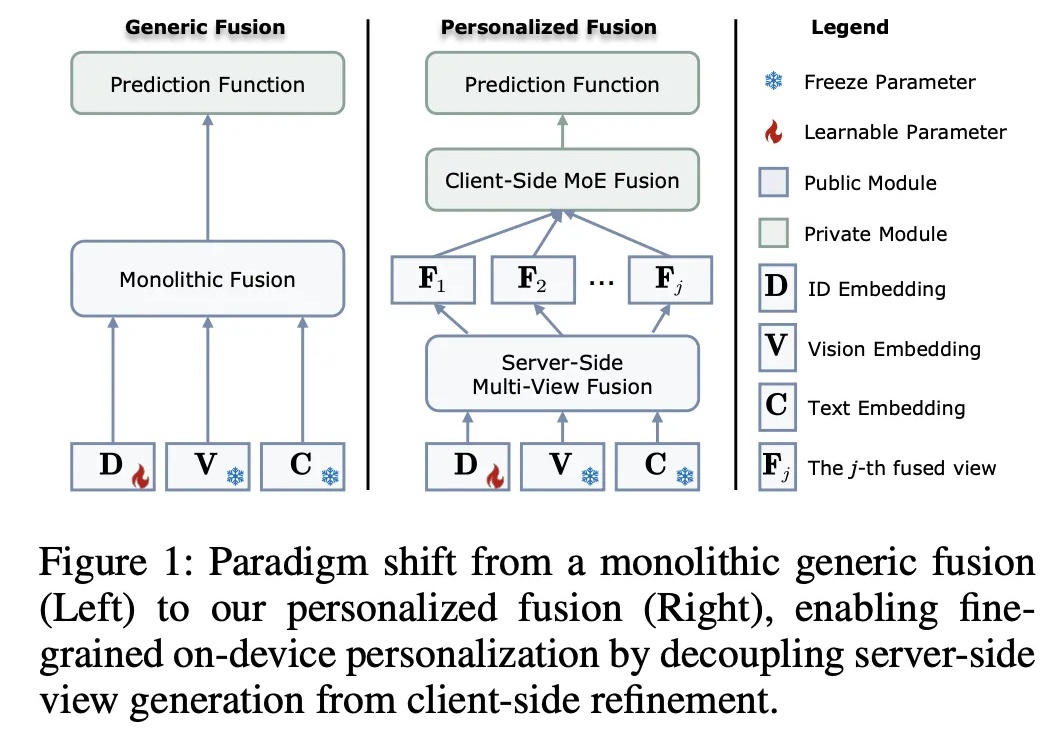

在推荐系统迈向多模态的今天,如何兼顾数据隐私与个性化图文理解?悉尼科技大学龙国栋教授团队联合香港理工大学杨强教授、张成奇教授团队,提出全新框架 FedVLR。该工作解决了联邦环境下多模态融合的异质性难题,已被人工智能顶级会议 AAAI 2026 接收为 Oral Presentation。

前两天,Google发了一个非常有趣的论文: 《Nested Learning: The Illusion of Deep Learning Architectures》

当AI能「看」见实验室的细节,能「听」见研究员的每一次反应,能「感知」实验进展的每一点变化——它的推理将不再局限于硅基世界。那时,AI将通过人类的双手,直接参与并改变物理现实。它或许将成为实验室中最勤奋、最可靠的「智能伙伴」。