YC F25 Demo Day:83个AI项目完整盘点

YC F25 Demo Day:83个AI项目完整盘点进入 2025 年,生成式 AI 正在从“概念验证”走向“规模化落地”,技术与应用的节奏明显加快。这个趋势在 Y Combinator 的 Demo Day 上体现得尤为清晰:在最新的 F25 批次中,AI 公司占比高达 53%(83 家 / 156 家),而在 2021 年的 W21 批次,这一数字仅为 12%。

进入 2025 年,生成式 AI 正在从“概念验证”走向“规模化落地”,技术与应用的节奏明显加快。这个趋势在 Y Combinator 的 Demo Day 上体现得尤为清晰:在最新的 F25 批次中,AI 公司占比高达 53%(83 家 / 156 家),而在 2021 年的 W21 批次,这一数字仅为 12%。

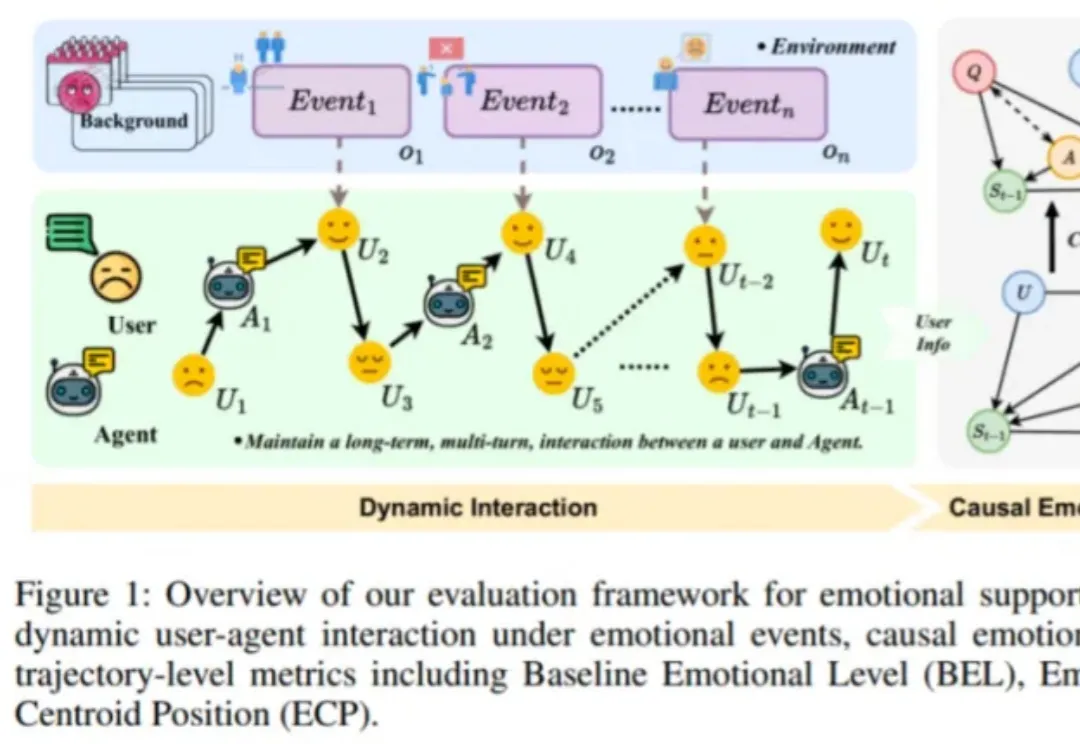

近日,由趣丸科技与北京大学软件工程国家工程研究中心共同发表的《Detecting Emotional Dynamic Trajectories: An Evaluation Framework for Emotional Support in Language Models(检测情感动态轨迹:大语言模型情感支持的评估框架)》论文,获 AAAI 2026 录用。

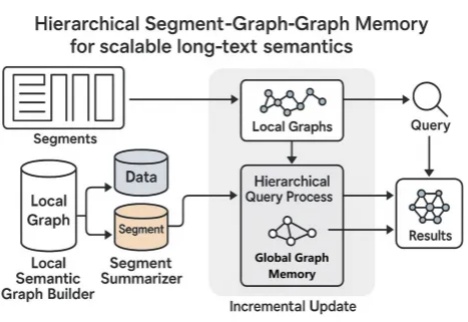

国内记忆框架首开源,企业实战已上线运行。在海外巨头已经将“记忆系统”提升到基础设施层的同时,红熊AI便是其中之一。公司成立于2024年,围绕多模态大模型与记忆科学开展研发,并将这些能力用于为企业提供智能客服、营销自动化与AI智能体服务。

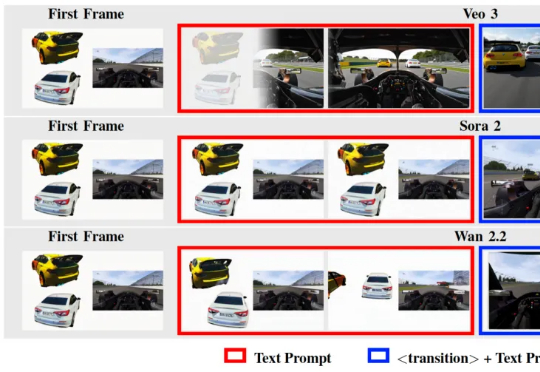

在 Text-to-Video / Image-to-Video 技术突飞猛进的今天,我们已经习惯了这样一个常识: 视频生成的第一帧(First Frame)只是时间轴的起点,是后续动画的起始画面。

记忆,或是 AI 从「即时回答工具」迈向「个性化超级助手」的关键突破

当你阅读《红楼梦》《哈利·波特》《百年孤独》等长篇小说时,读着读着可能就忘记前面讲了什么,有时还会搞混人物关系。AI 在阅读长文章的时候也存在类似问题,当文章太长时它也会卡主,要么读得特别慢,要么记不住前面的内容。

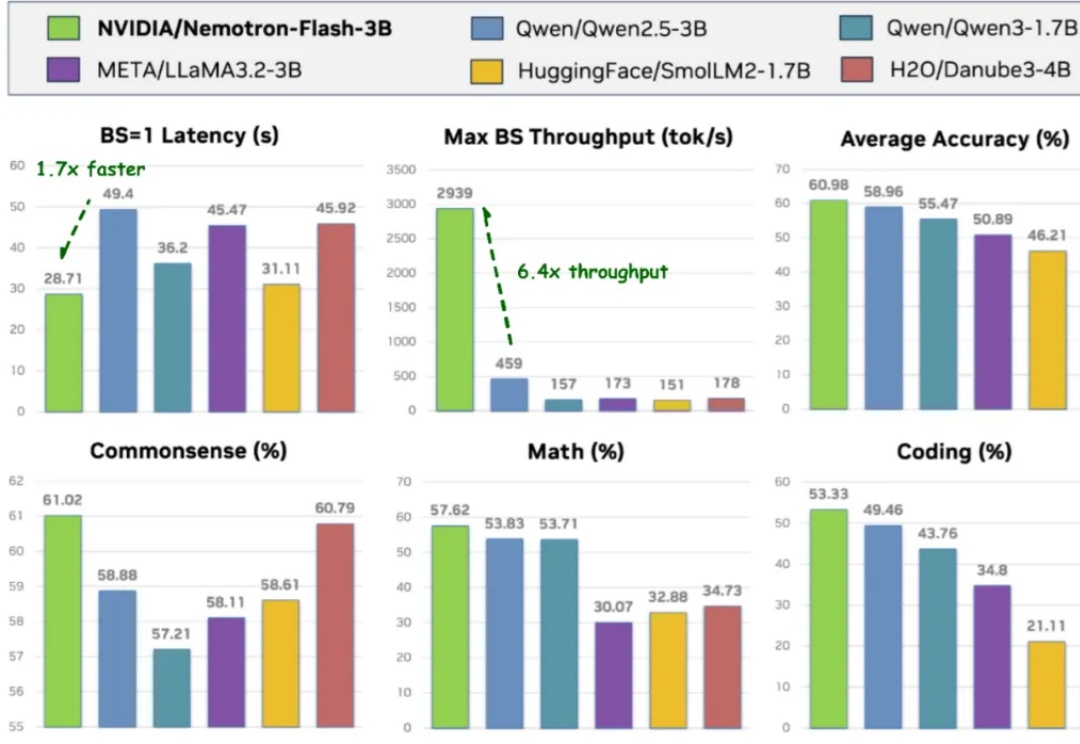

导读 过去两年,小语言模型(SLM)在业界备受关注:参数更少、结构更轻,理应在真实部署中 “更快”。但只要真正把它们跑在 GPU 上,结论往往令人意外 —— 小模型其实没有想象中那么快。

2025 年以来,各种 AI Coding 的宣发,已经从科技进步,快进到了科幻文学赛道。C 端市场,一句话生成 Demo 的宣发内容仍在收割流量,将技术演进包装成科幻叙事;但没人关心小白为什么要做 coding,一句话生成的的 demo,在生产环境能跑起来吗?

1米3的机器人小土豆,三步上篮也可以如此丝滑。

斯坦福明星华人博士生的创业机器人,终于正式亮相!