资源多到什么程度,才能创业追 OpenAI?

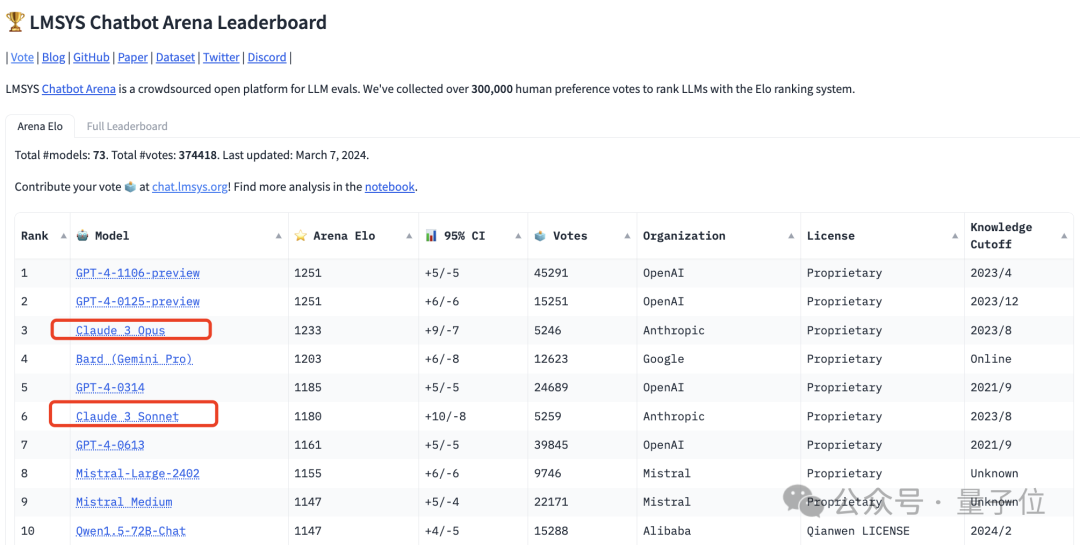

资源多到什么程度,才能创业追 OpenAI?xAI 今天宣布推出 Grok-2 和 Grok-2 mini 测试版,官方说,它的表现比 Claude 3.5 Sonnet 和 GPT-4-Turbo 更好。

来自主题: AI资讯

7014 点击 2024-08-15 10:27

xAI 今天宣布推出 Grok-2 和 Grok-2 mini 测试版,官方说,它的表现比 Claude 3.5 Sonnet 和 GPT-4-Turbo 更好。

国产大模型,多模态能力都开始超越GPT-4-Turbo了??

开源大模型领域,又迎来一位强有力的竞争者。

最终,Claude 3最强的“大杯”模型Opus得分1233,成为第一个能和GPT-4-Turbo一较高下的选手。

参照SuperCLUE(中文通用大模型综合性测评基准)框架专门定制了1000道题目集,一一测试了ChatGPT4、 智谱chatGLM-4、Baichuan2-Turbo、百度ERNIE-Bot 4.0、Yi-34B-chat、llama 2等模型在保险业务上的表现。