AI百人榜刷屏,小扎照单全收?辛顿Ilya师徒霸榜,第二名竟是本科生

AI百人榜刷屏,小扎照单全收?辛顿Ilya师徒霸榜,第二名竟是本科生Ilya登顶、Hinton家族双双入选、图灵「穿越上榜」,本科生的也能冲进前十!

搜索

搜索

Ilya登顶、Hinton家族双双入选、图灵「穿越上榜」,本科生的也能冲进前十!

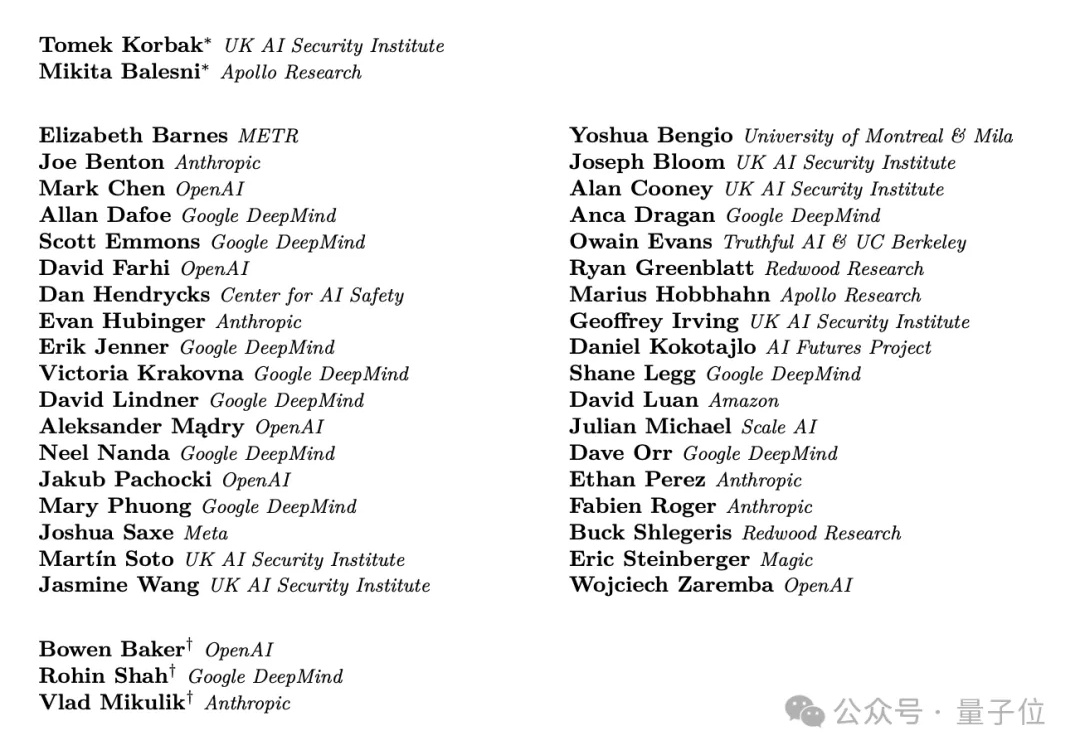

难得难得,几大AI巨头不竞争了不抢人了,改联合一起发研究了。

2023年感恩节,OpenAI创始人奥特曼被炒鱿鱼,五天五夜的科技圈大戏席卷全网。亚马逊斥资4000万美元,将这段「AI圈权游」搬上大银幕,Andrew Garfield化身奥特曼,带你重温那场惊心动魄的逆转剧情!

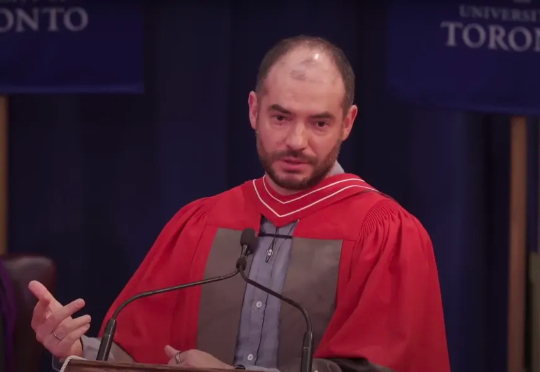

Ilya,被迫当公司CEO了。是的,即便两次改变了AI、改变了世界,但Ilya一直是研究员、首席科学家…而这一次,不得不当自己创办公司的CEO。全怪Meta挖人太狠,全怪扎克伯克开的薪资条件无法拒绝。

从「与GPT-3.5畅聊」到「ChatGPT」,OpenAI团队如何在混乱中拍板上线、又怎样被用户「点赞」调教成「赛博舔狗」?从产品发布、命名内幕、团队文化到AI时代核心竞争力,深度访谈揭开幕后全过程!

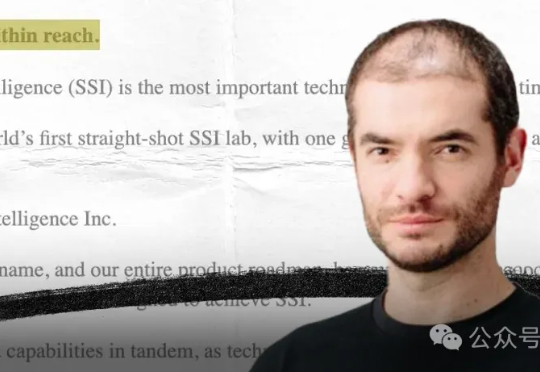

就在刚刚,Ilya出现了!他大义凛然发文,自封为SSI唯一CEO,而Daniel Levy将担任总裁。要实现SSI的梦想,多少钱都不卖。

扎克伯格为了AGI大业疯狂挖人,这回挖到了Ilya头上。

沉寂一年多,消失的Ilya Sutskever终于出现了!

Ilya 去哪了? 作为 OpenAI 联合创始人,Ilya Sutskever 一直是最靠近 AI 技术核心的人。如今他不再出现在 OpenAI 的发布会现场,而是选择重新开始。

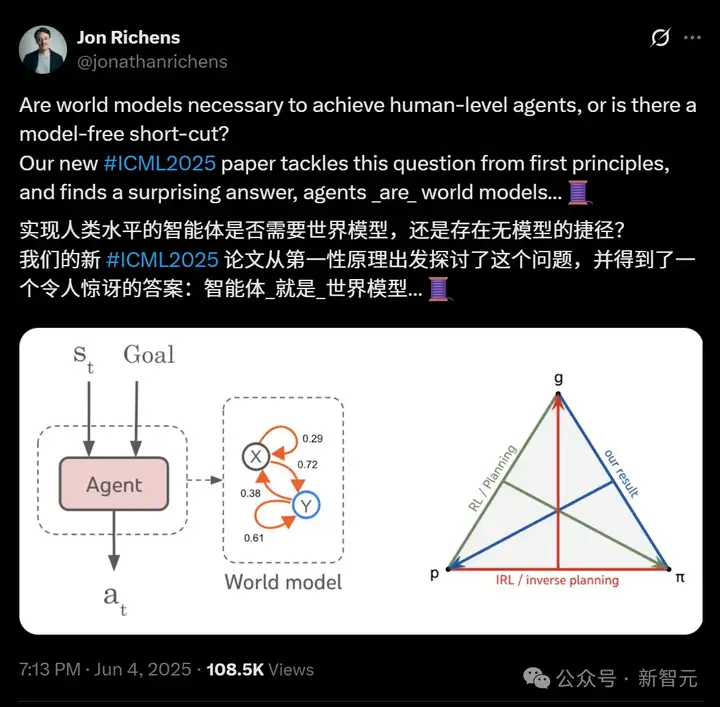

就在刚刚,DeepMind科学家Jon Richens表示,自己的一篇ICML 2025论文发现,智能体就是世界模型!总之,如果要实现AGI,是绝对不存在无模型的捷径的。而这个说法,恰巧跟Ilya 23年的预言不谋而合了。