谢赛宁李飞飞LeCun搞的寒武纪,究竟是个啥?

谢赛宁李飞飞LeCun搞的寒武纪,究竟是个啥?“寒武纪”这个名字在AI圈里火得发烫。

搜索

搜索

“寒武纪”这个名字在AI圈里火得发烫。

就在刚刚,即将离职 Meta 的图灵奖得主 Yann LeCun 在 Threads、领英等社交平台上宣布已经开启事业的下一阶段:创业。

上周,来自 Anthropic 的研究人员表示,他们最近观察到“首个由 AI 协同操作的网络攻击行动”,在一次针对数十个目标的攻击活动中,他们检测到有黑客使用该公司的 Claude AI 工具参与行动。不过,外部研究人员对 Anthropic 这一发现的评价要谨慎得多。

世界模型,着实有点火!今天,李飞飞重磅访谈放出,从AI革命兴起到下一个智能前沿——具备空间智能的世界模型。一场访谈,可以窥见AI教母关于AI未来的深刻洞察。

图灵奖得主LeCun与Meta分道扬镳!LLM邪路一条,「世界模型才是」未来。

AGI之路,终于交汇到了世界模型的战场。 李飞飞,发布了旗下首款商用世界模型Marble;几乎同一时间,Lecun离职Meta,准备创立自己的世界模型公司;在此之前,谷歌旗下的世界模型Genie 3,也曾掀起业界轰动。

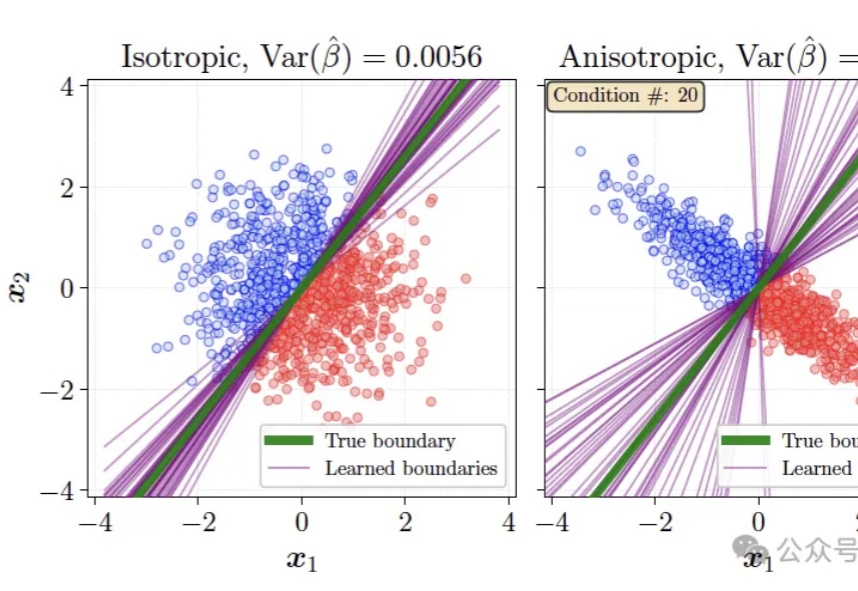

《LeJEPA:无需启发式的可证明且可扩展的自监督学习》。

克雷西 发自 凹非寺 量子位 | 公众号 QbitAI 忍无可忍,LeCun离职Meta。 金融时报消息,LeCun向同事透露了自己的离职计划,下一步打算创业。 数个月的重重挤兑之下,一忍再忍的LeC

当AI不再对着文字死记硬背,而是学会在视频里对人类世界进行超感知,这套全新范式会不会撬开AGI的大门?

这是一个人类 AI 群星闪耀时的时刻——黄仁勋、李飞飞、杰弗里·辛顿(Geoffrey Hinton)、约书亚·本吉奥(Yoshua Bengio)、杨立昆(Yann LeCun)、比尔·戴利(Bill Dally),罕见同台参与同一个圆桌讨论 AI。之所以能聚在一起,是因为他们六人获得了 2025 年伊丽莎白女王工程奖。