4000万样本炼出AI读心术,刷新七榜SOTA,最强「人类偏好感应器」开源

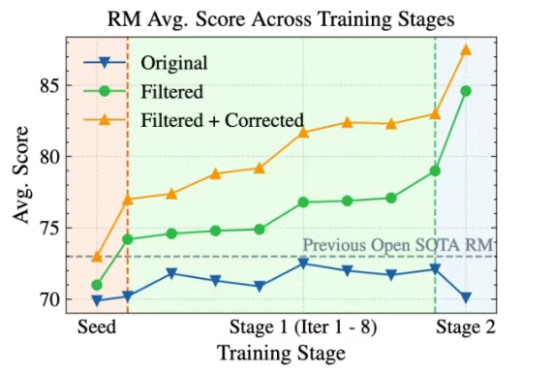

4000万样本炼出AI读心术,刷新七榜SOTA,最强「人类偏好感应器」开源Skywork-Reward-V2全新发布!巧妙构建超高质量的千万级人类偏好样本,刷新七大评测基准SOTA表现。8款模型覆盖6亿至80亿参数,小体积也能媲美大模型性能。

Skywork-Reward-V2全新发布!巧妙构建超高质量的千万级人类偏好样本,刷新七大评测基准SOTA表现。8款模型覆盖6亿至80亿参数,小体积也能媲美大模型性能。

大语言模型(LLM)以生成能力强而著称,但如何能让它「听话」,是一门很深的学问。 基于人类反馈的强化学习(RLHF)就是用来解决这个问题的,其中的奖励模型 (Reward Model, RM)扮演着重要的裁判作用,它专门负责给 LLM 生成的内容打分,告诉模型什么是好,什么是不好,可以保证大模型的「三观」正确。

如果一个视觉语言模型(VLM)只会“看”,那真的是已经不够看的了。

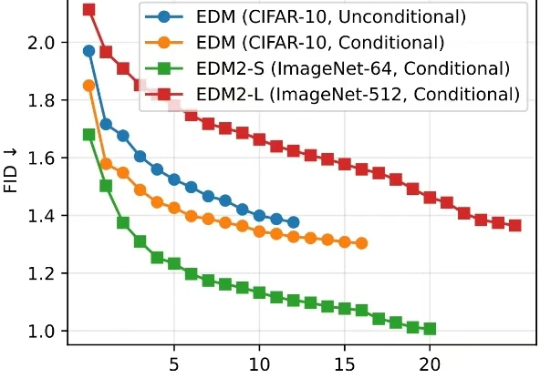

清华大学朱军教授团队与 NVIDIA Deep Imagination 研究组联合提出一种全新的视觉生成模型优化范式 —— 直接判别优化(DDO)。

国际机票预订决策复杂,涉及地点进出、时间浮动与购买时机等多变量博弈,远超普通消费者能力。AI可通过模拟专家决策流程(包括需求澄清、动态数据检索、透明推荐、智能购票时机建议)赋能用户,但需跨越策略进化与数据成本门槛。OTA因其C端入口、计算能力和数据成本优势最有望主导AI应用落地,重塑行业生态。

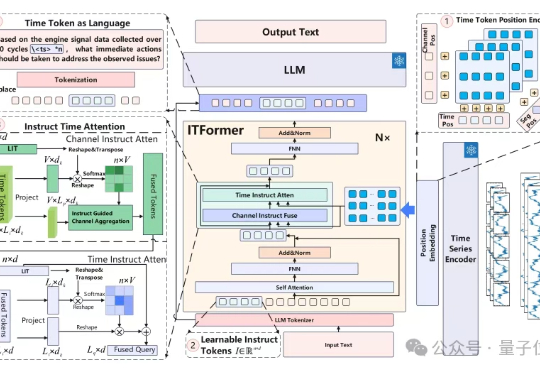

时序数据分析在工业监控、医疗诊断等领域至关重要。比如航空发动机监控这个复杂工业场景中,工程师需分析海量多通道传感器数据,以判断设备状态并制定维护决策。

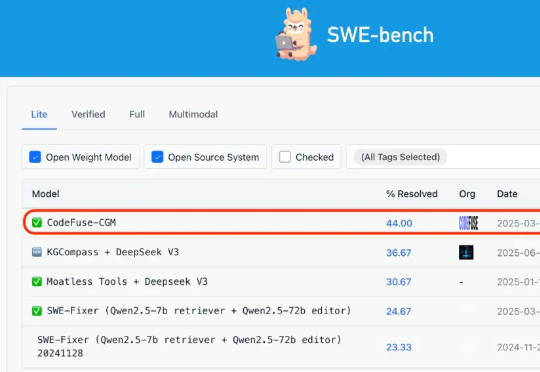

Agentless+开源模型,也能高质量完成仓库级代码修复任务,效果媲美业界 SOTA 。

在近日举办的2025年新领军者年会上,中国生物制药首席执行长谢承润接受媒体采访,并发表了AI在药物研发中应用的相关看法。

这款 Agent 擅长多轮搜索和推理,平均每项任务执行 23 个推理步骤,访问超过 200 个网址。它是基于 Kimi k 系列模型的内部版本构建,并完全通过端到端智能体强化学习进行训练,也是国内少有的基于自研模型打造的 Agent。

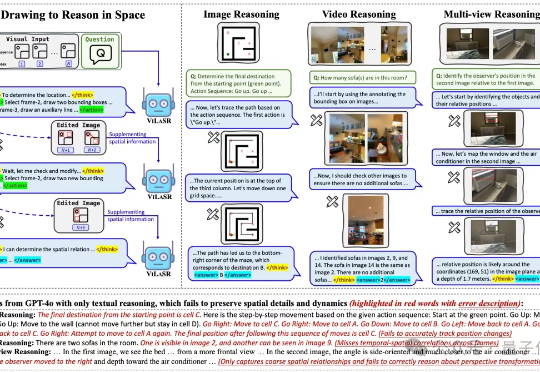

“边看边画,边画边想”,让大模型掌握空间思考能力,结果直接实现空间推理任务新SOTA。