速递|4900万美元种子轮融资,估值3亿美元,STLabs挑战ServiceNow,打造企业IT的自动驾驶

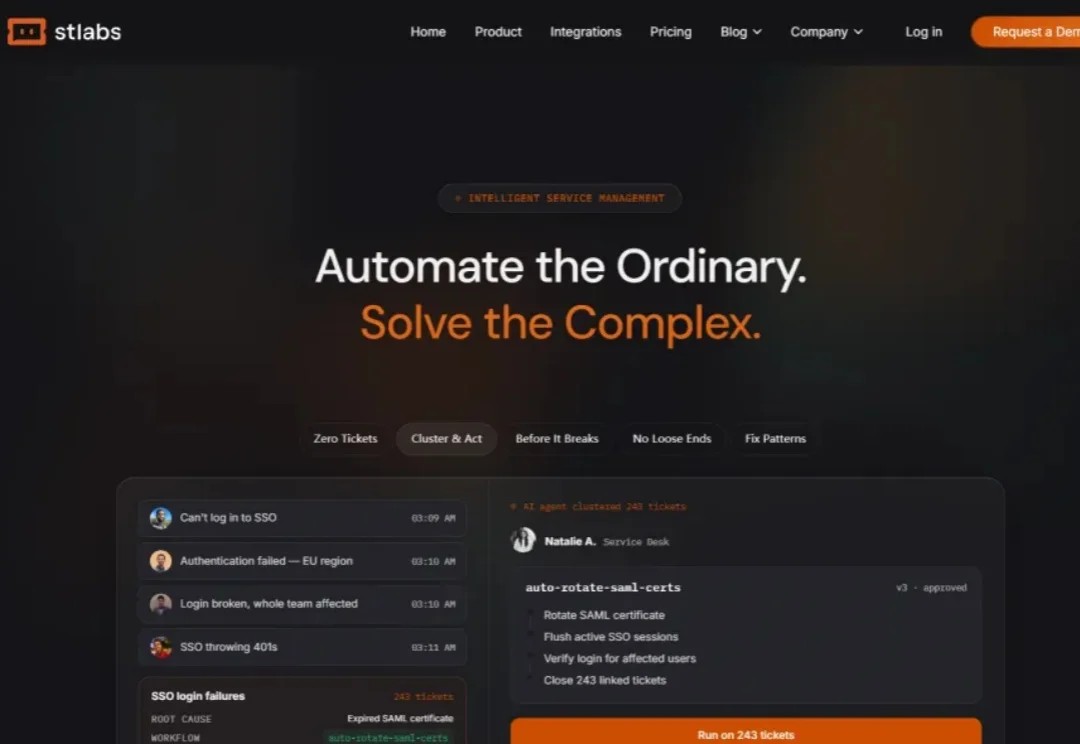

速递|4900万美元种子轮融资,估值3亿美元,STLabs挑战ServiceNow,打造企业IT的自动驾驶由 Datadog 前总裁阿米特·阿加瓦尔创立的 Standard Template Labs 已完成首轮 4900 万美元融资,旨在重塑大型企业内部信息技术服务的运作方式。

由 Datadog 前总裁阿米特·阿加瓦尔创立的 Standard Template Labs 已完成首轮 4900 万美元融资,旨在重塑大型企业内部信息技术服务的运作方式。

2025 年 1 月,特朗普在白宫亲自站台,宣布了一个号称“史上最大 AI 基础设施项目”的宏伟计划。OpenAI 联合软银、甲骨文和阿布扎比主权基金 MGX,组建了一家名为 Stargate LLC 的合资公司,承诺在四年内向美国 AI 基础设施投入 5,000 亿美元。

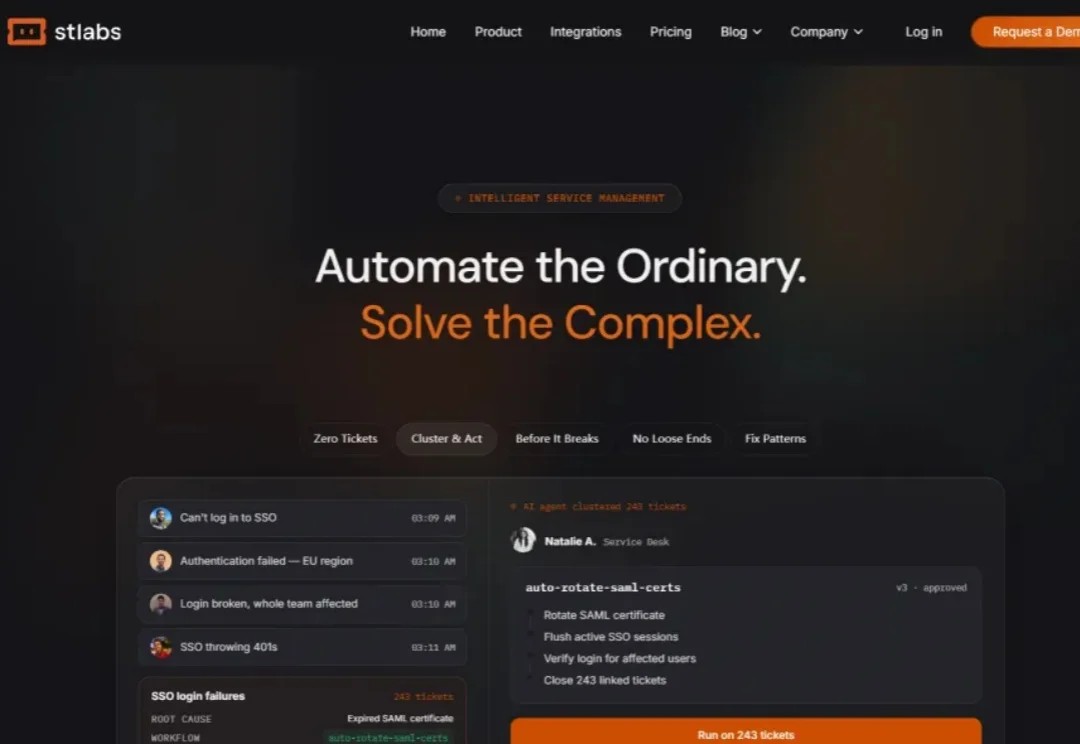

NUS、ZJU、UW、Stanford、CUHK 联合提出 「ThinkMorph」,主张让文字与图像在统一架构里「原生协作」、「共同演化」,而不是像当下大多数多模态模型那样,看完图像就闭上眼睛,后续完全靠文字链条推进。仅用 2.4 万条数据微调 7B 统一模型,视觉推理平均提升 34.74%,多项任务比肩甚至超越 GPT-4o 和 Gemini 2.5 Flash。

OpenClaw 火爆的盛况至今仍在持续,在国内甚至出现了排队在腾讯总部楼下等待安装 OpenClaw 的场景,让人感叹「一代人有一代人的领鸡蛋」。

3月6日,腾讯混元发布了一篇名为“HY-WU (Part I): An Extensible Functional Neural Memory Framework and An Instantiation in Text-Guided Image Editing”的技术报告。提出了一种崭新的功能性记忆(functional neural memory)范式(weight unleashing),

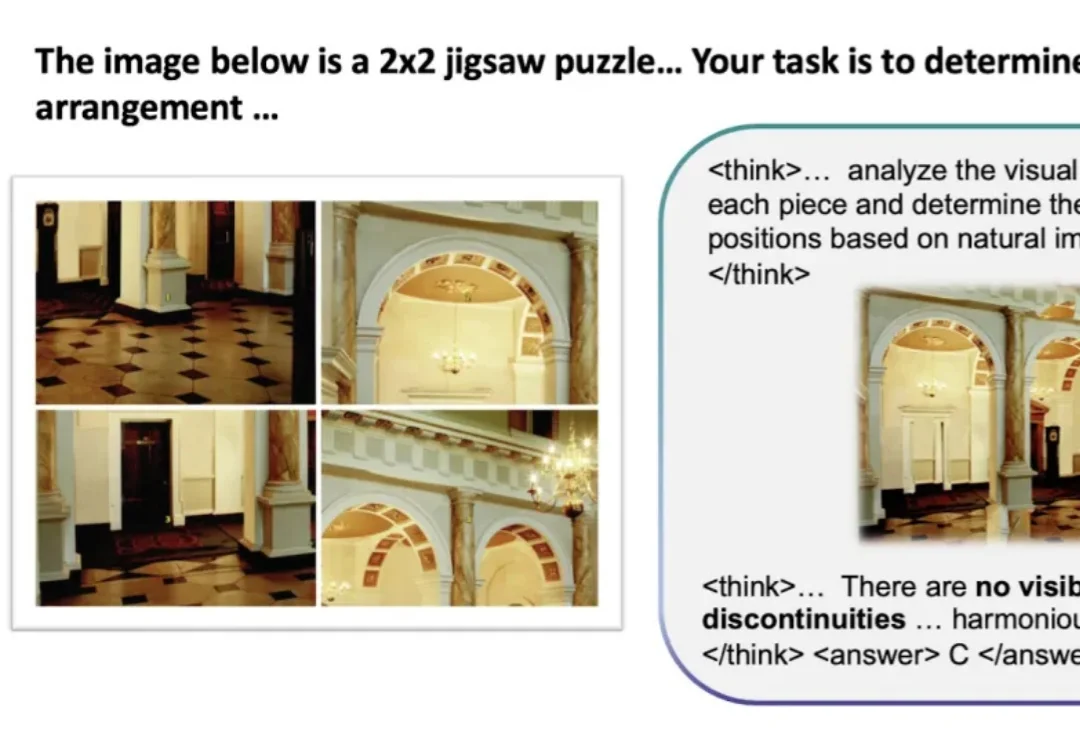

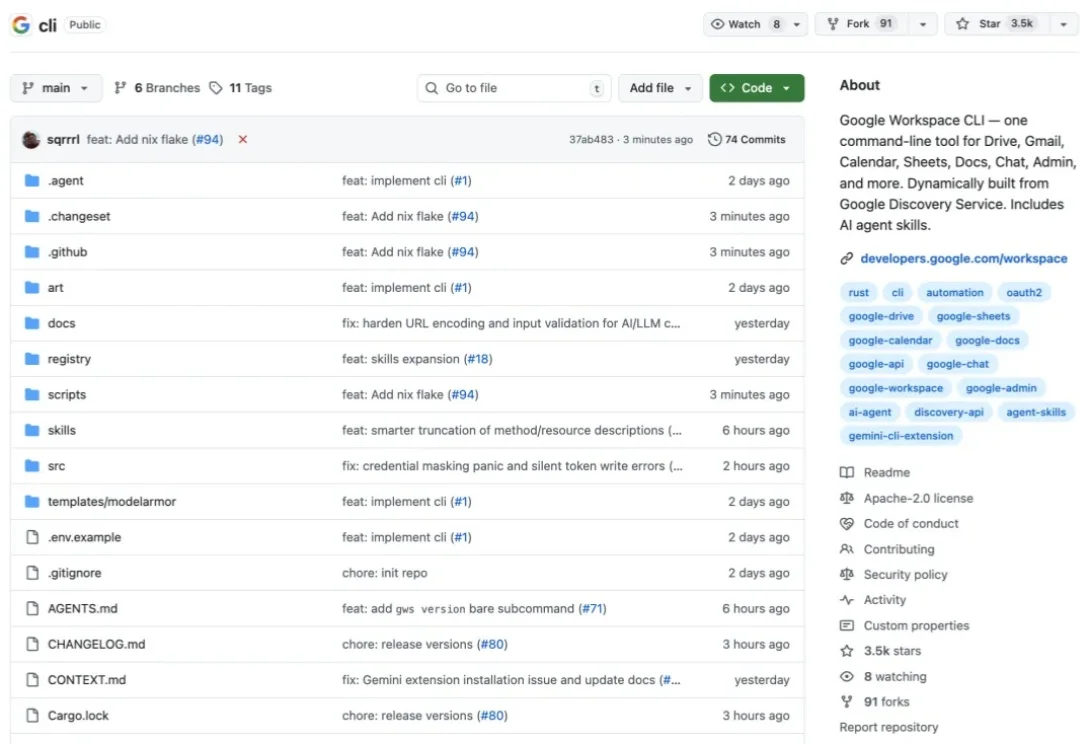

今天上午的时候,Google Workspace CLI 上线到了 GitHub,挂在 Google Workspace 的官方组织名下。我开始写这篇文章的时候,这个项目是 2700 个 Star;当我发出去的时候,重新截了个图,已经有 3500 个 Star 了

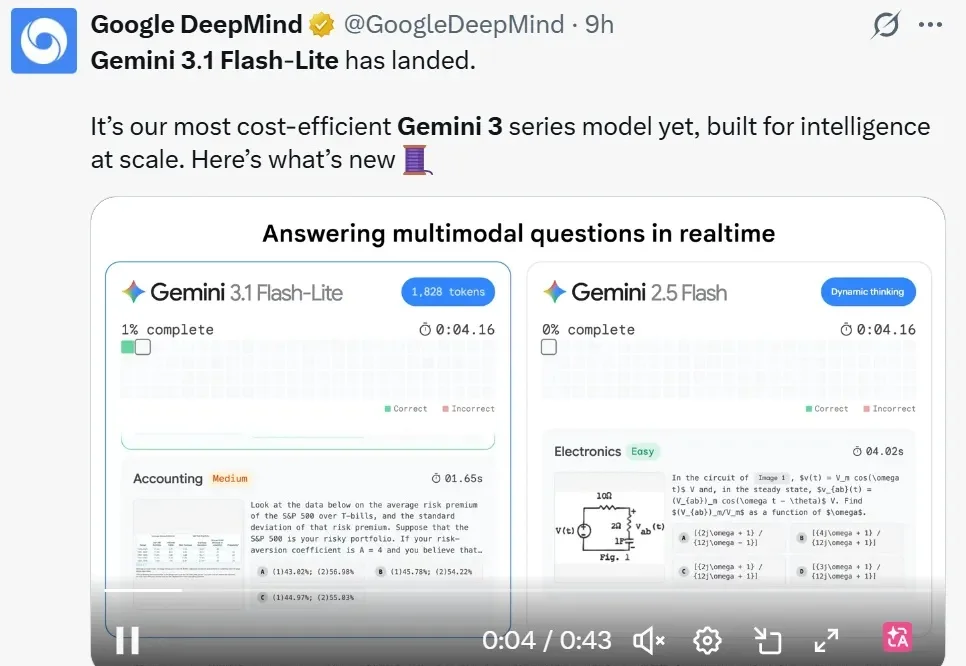

深夜,两大科技巨头谷歌和 OpenAI 硬刚起来,相继推出了新版本大模型,分别是 Gemini 3.1 Flash-Lite、GPT‑5.3 Instant。

GPT-5.3 Instant不卷跑分,专治「聊天翻车」:不再动不动拒绝回答,不再满嘴说教免责,幻觉率暴降27%,写作能力也跳了一个台阶。

它叫 Patty,由 OpenAI 驱动,是汉堡王 BK Assistant 平台的语音助手。员工可以随时问它:枫糖波旁烧烤皇堡放几片培根?奶昔机怎么清洁?它都能答。设备故障或食材缺货时,系统会在 15 分钟内自动同步所有渠道——自助点餐机、得来速、电子菜单板——全部更新,不需要人工干预。

今天早上,Google Labs发布了Pomelli最新功能Photoshoot,我们可以从一张产品图片出发,轻松制作高质量定制品牌照片,用于产品营销。Pomelli是Google Labs联合Google DeepMind于2025 年10月推出的AI营销工具实验项目,底层驱动模型为Nano Banana,专为中小企业设计。