LeCun出手,造出视频世界模型,挑战英伟达COSMOS

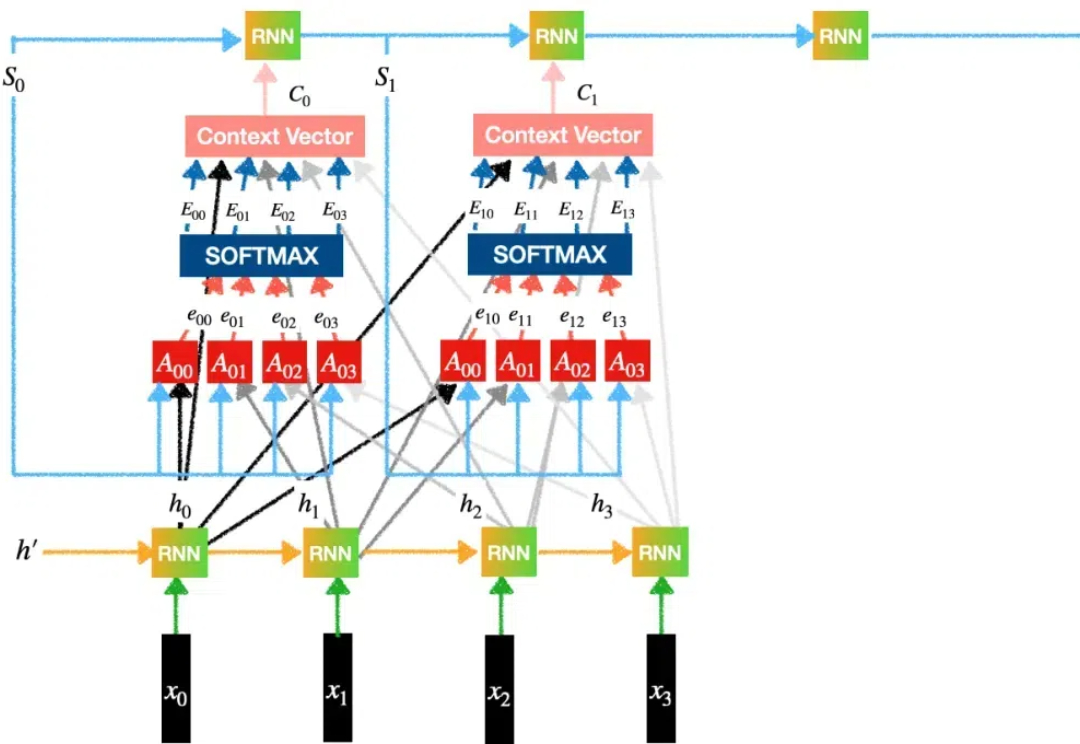

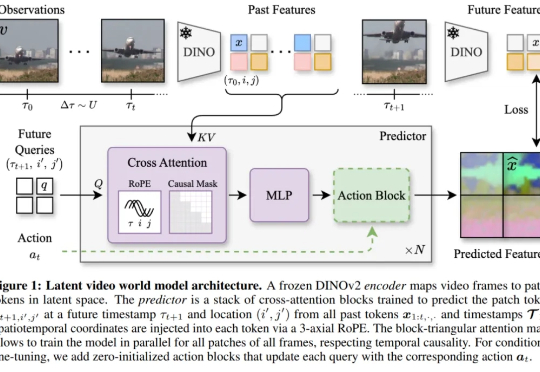

LeCun出手,造出视频世界模型,挑战英伟达COSMOS2018 年,LSTM 之父 Jürgen Schmidhuber 在论文中( Recurrent world models facilitate policy evolution )推广了世界模型(world model)的概念,这是一种神经网络,它能够根据智能体过去的观察与动作,预测环境的未来状态。

来自主题: AI技术研报

7597 点击 2025-07-30 10:23