跨境电商版Sora发布:全球首个AI原生电商视频Multi-Agent来了

跨境电商版Sora发布:全球首个AI原生电商视频Multi-Agent来了你的下一个视频团队,不一定非得是人。

搜索

搜索

你的下一个视频团队,不一定非得是人。

Sora画下的饼终于被做熟了!用DeepSeek式的慢思考逻辑,把AI视频从「看运气抽卡」变成了「确定性交付」,这才是电商人真正需要的工业革命。

今天,谷歌Veo 3.1终于迎来重磅升级,表现力直接爆表! 这一次,谷歌特别优化了移动端体验。只需上传一些「素材图片」(ingredient images),就能轻松创作出更有趣、更有创意、画质极佳的视频。

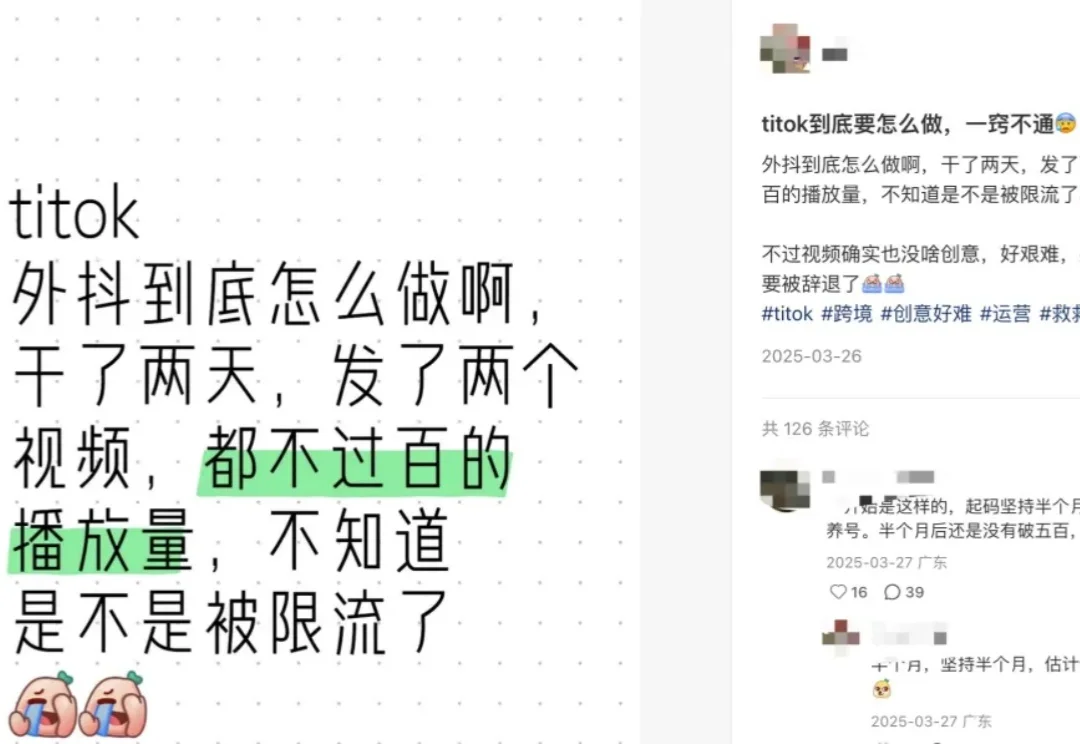

随着 AIGC(Artificial Intelligence Generated Content) 的爆发,我们已经习惯了像 Sora 或 Wan 这样的视频生成模型能够理解「一只宇航员在火星后空翻」这样天马行空的指令。然而,3D 人体动作生成(3D MoGen)领域却稍显滞后。

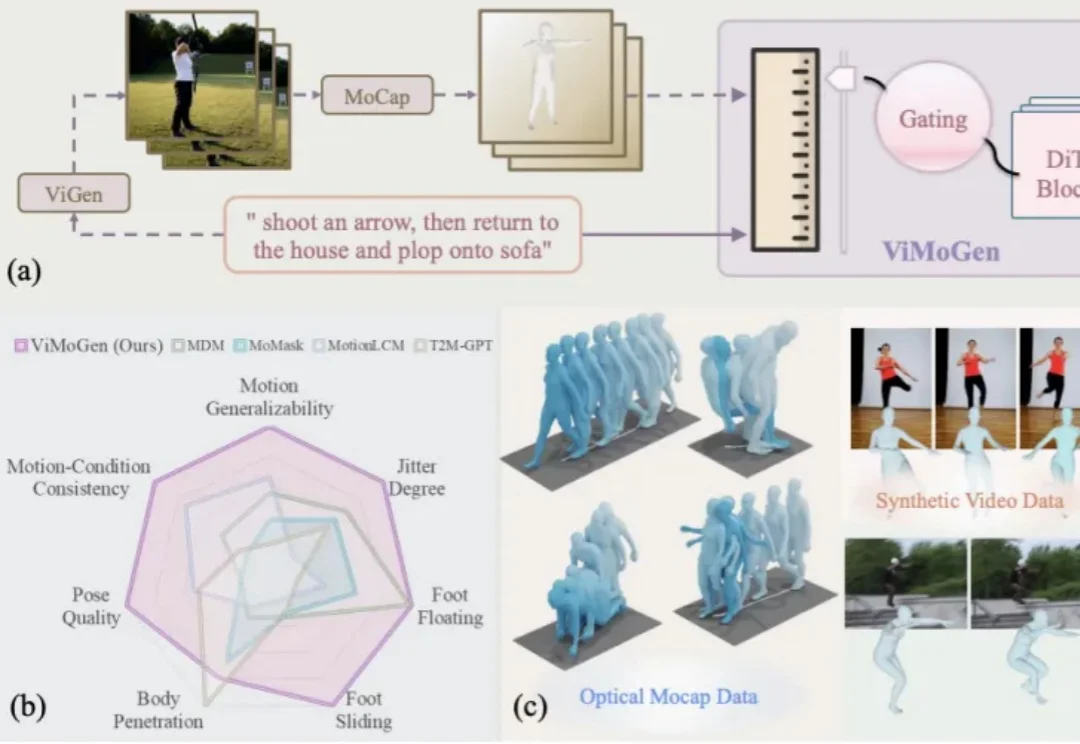

今年下半年,Sora的出现再次将AI视频推至全球讨论的焦点。基于用户提供的图像信息,AI能够复刻人物形象,并生成高度逼真的视频内容,生成式视频能力的边界被进一步延展

坏了,阿里这波是冲着Sora 2去的!

有创意,就能人人当导演的时代真的来了。

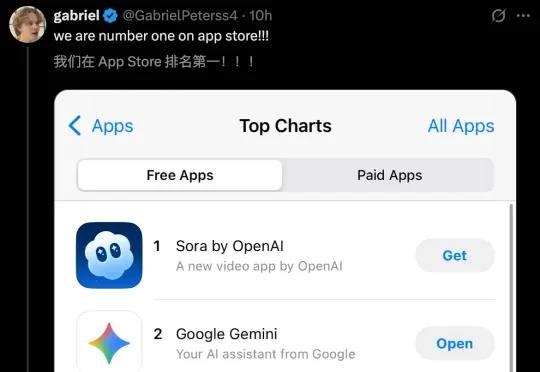

从 0 到上线,在OpenAI内部,安卓版 Sora经历的时间只有 28 天,而且期间只用了 2-3 名员工。

自 Sora 2 发布以来,各大科技厂商迎来新一轮视频生成模型「军备竞赛」,纷纷赶在年底前推出更强的迭代版本。

4人28天手搓Sora APP,约85%代码竟是AI写的!10月初,OpenAI重磅发布迭代后Sora 2,以及首个AI视频应用Sora APP。时隔两个月,OpenAI团队揭秘这款爆火应用(首个安卓版),如何构建的背后故事。