AAAI 2026|教会视频扩散模型「理解科学现象」:从初始帧生成整个物理演化

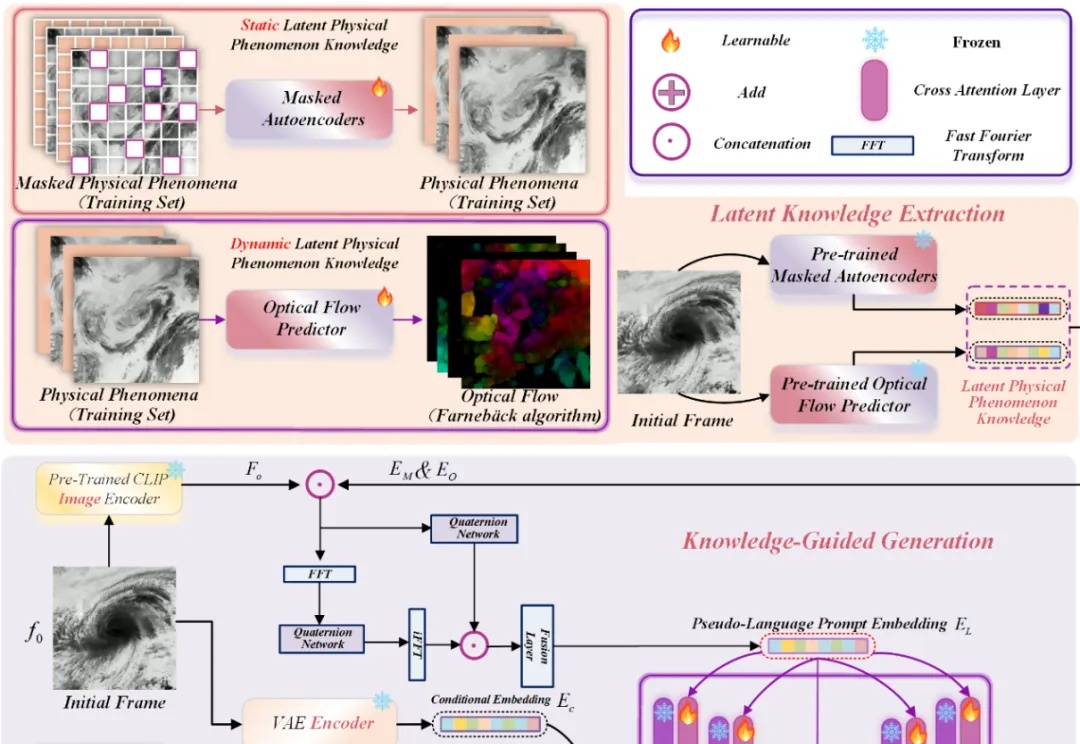

AAAI 2026|教会视频扩散模型「理解科学现象」:从初始帧生成整个物理演化近年来,Stable Diffusion、CogVideoX 等视频生成模型在自然场景中表现惊艳,但面对科学现象 —— 如流体模拟或气象过程 —— 却常常 “乱画”:如下视频所示,生成的流体很容易产生违背物理直觉的现象,比如气旋逆向旋转或整体平移等等。

近年来,Stable Diffusion、CogVideoX 等视频生成模型在自然场景中表现惊艳,但面对科学现象 —— 如流体模拟或气象过程 —— 却常常 “乱画”:如下视频所示,生成的流体很容易产生违背物理直觉的现象,比如气旋逆向旋转或整体平移等等。

硅谷华人大三学生创立的教育类 AI 产品 VideoTutor,近日宣布完成 1100 万美元种子轮融资,成为硅谷学生创业中融资规模最高的项目。

AI 视频初创公司 Video Rebirth 今日宣布完成 5000 万美元的融资。本轮融资参与方阵容强大,包括全球及新加坡的头部美元基金、互联网巨头、中国及韩国老牌游戏上市公司、全球领先的芯片企业及知名家族办公室,募集资金将主要用于视频模型的持续迭代、顶尖人才招募及全球市场拓展。

每周我们都会和不少AI公司创业者交流,体验和评测新的AI产品,以各种方式去研究这些项目。

在多模态生成领域,由视频生成音频(Video-to-Audio,V2A)的任务要求模型理解视频语义,还要在时间维度上精准对齐声音与动态。早期的 V2A 方法采用自回归(Auto-Regressive)的方式将视频特征作为前缀来逐个生成音频 token,或者以掩码预测(Mask-Prediction)的方式并行地预测音频 token,逐步生成完整音频。

华人大三学生,1100 万美元种子轮,硅谷学生创业目前融资最高产品。

AI医学生产力工具开发公司「零假设」近日获近亿元A轮融资,由荷塘创投、国方创新、上海喆驭投资,老股东元禾原点超额认购。本轮融资主要用于打磨、落地场景化AI医学智能体,构建连通药企和医生的学术沟通桥梁。唯快资本长期担任独家融资顾问。

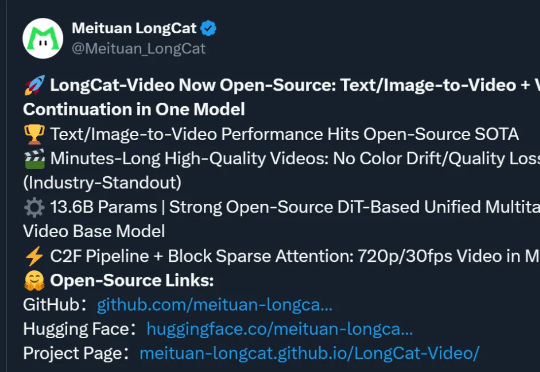

美团,你是跨界上瘾了是吧!(doge)没错,最新开源SOTA视频模型,又是来自这家“送外卖”的公司。模型名为LongCat-Video,参数13.6B,支持文生/图生视频,视频时长可达数分钟。

学术展示视频作为科研交流的重要媒介,制作过程仍高度依赖人工,需要反复进行幻灯片设计、逐页录制和后期剪辑,往往需要数小时才能产出几分钟的视频,效率低下且成本高昂,这凸显了推动学术展示视频自动化生成的必要性。

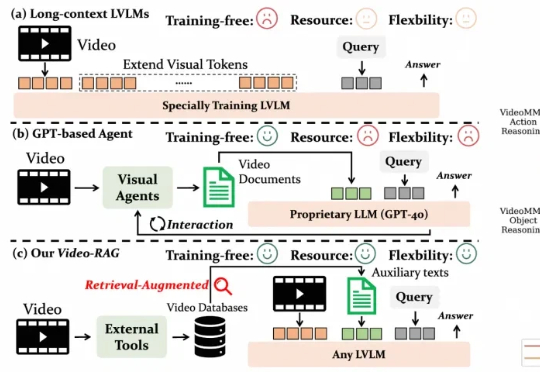

尽管视觉语言模型(LVLMs)在图像与短视频理解中已取得显著进展,但在处理长时序、复杂语义的视频内容时仍面临巨大挑战 —— 上下文长度限制、跨模态对齐困难、计算成本高昂等问题制约着其实际应用。针对这一难题,厦门大学、罗切斯特大学与南京大学联合提出了一种轻量高效、无需微调的创新框架 ——Video-RAG。