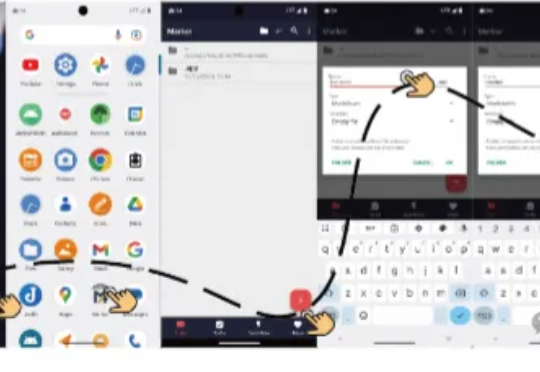

GUI智能体训练迎来新范式!半在线强化学习让7B模型媲美GPT-4o

GUI智能体训练迎来新范式!半在线强化学习让7B模型媲美GPT-4o浙江大学与通义实验室Mobile-Agent团队在UI-R1的基础上,推出全新研究成果——UI-S1,提出了一种名为半在线强化学习(Semi-online Reinforcement Learning)的创新训练范式。

浙江大学与通义实验室Mobile-Agent团队在UI-R1的基础上,推出全新研究成果——UI-S1,提出了一种名为半在线强化学习(Semi-online Reinforcement Learning)的创新训练范式。

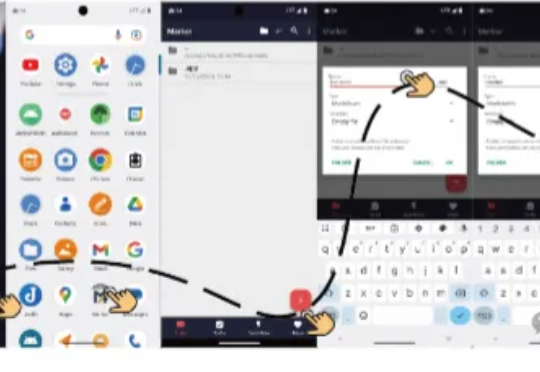

2017 年,一篇标题看似简单、甚至有些狂妄的论文在线上出现:《Attention Is All You Need》。

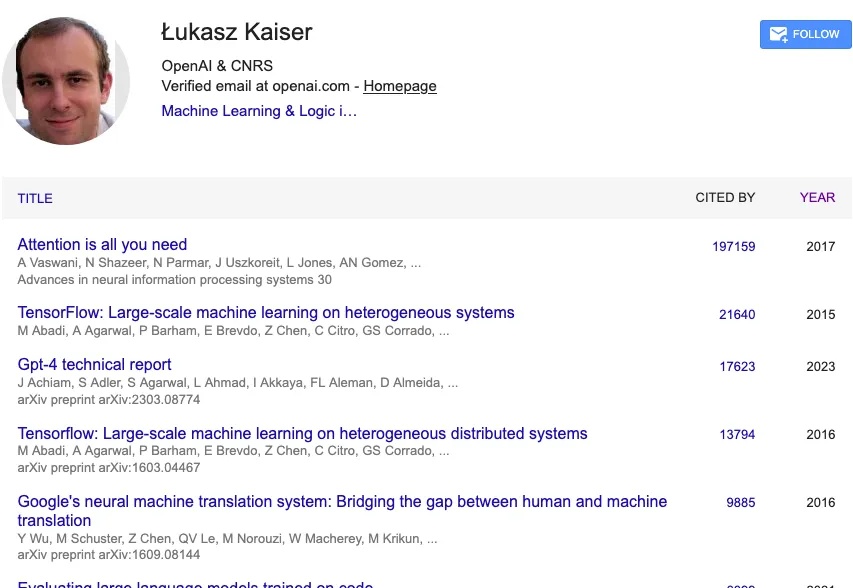

Scale AI的新软件工程基准SWE-BENCH PRO,出现反转!表面上看,“御三家”集体翻车,没一家的解决率超过25%: GPT-5、Claude Opus 4.1、Gemini 2.5分别以23.3%、22.7%、13.5%的解决率“荣”登前三。

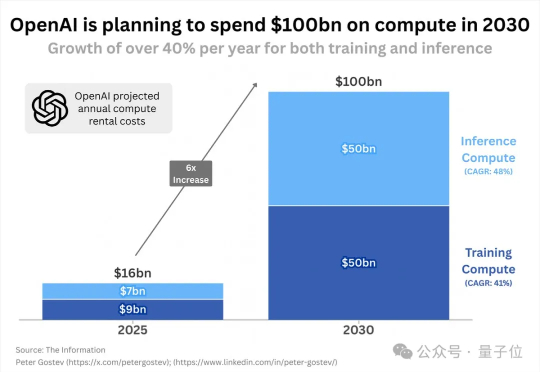

OpenAI已经花了160亿美元(约人民币1138亿)租用计算资源。相当于每天一睁眼,就有几千万花出去租服务器。但这还不是最夸张的。据The Information消息,OpenAI计划在未来五年额外支出约1000亿美元,用于从云服务提供商处租用备用服务器 。

近日,AI医疗上市公司Doximity,起诉另一家AI医疗独角兽OpenEvidence,指控其损害声誉并挖走员工。两家公司都在打造医生版“ChatGPT",但因为行业竞争而不断升级法律战。

xAI重磅推出Grok 4 Fast,创新融合推理与非推理双模式,支持200万token上下文。在NYT Connections基准和AA智能指数中表现卓越,超越多家顶级模型,标志着AI智能获取门槛的进一步降低。

阿里巴巴集团安全部联合清华大学、复旦大学、东南大学、新加坡南洋理工等高校,联合发布技术报告;其理念与最近OpenAI发布的GPT-5 System Card放在首位的“From Hard Refusals to Safe-Completions”理念不谋而合。

拿下中国AI云市场第一后,阿里云又敞开说了。 援引第三方机构Omdia数据,中国AI云市场规模达到223亿元,阿里云占比35.8%位列第一。围绕这一领先地位的技术根基,阿里云的弹性计算、集群、容器、人工智能平台等技术产品负责人来了场AI Infra分享会。

GPT‑5来了,让AI第一次像「随身博士」——不只答题,更能协同完成多步骤任务。奥特曼在最新对谈中给出一份可执行的未来清单:年轻人要学什么、创业护城河怎么建、内容过载时代为何「真实人」更稀缺……

TwinMind的创始人Daniel George在JPMorgan工作时深深体验了这种痛点,当时他每天要参加无数个会议,于是他开发了一个脚本来录制音频、转录文本,并输入到ChatGPT中。神奇的事情发生了,随着时间的推移,ChatGPT开始真正理解他的项目,甚至能生成可用的代码。