单卡2秒生成一个视频!清华联手生数开源TurboDiffusion,视频DeepSeek时刻来了

单卡2秒生成一个视频!清华联手生数开源TurboDiffusion,视频DeepSeek时刻来了现在生成一个视频,比你刷视频还要快。

现在生成一个视频,比你刷视频还要快。

最近,Notion 创始人 Ivan Zhao 写了一篇年终总结《Steam, Steel, and Infinite Minds》。Ivan 讲了一个特别有趣的观点:AI 是我们这个时代的「革命性材料」。就像工业时代的钢铁、数字时代的半导体一样。

什么?决定 AI 上限的已不再是底座模型,而是外围的「推理编排」(Orchestration)。

视频生成领域的「DeepSeek时刻」来了!清华开源TurboDiffusion,将AI视频生成从「分钟级」硬生生拉进「秒级」实时时代,单卡200倍加速让普通显卡也能跑出大片!

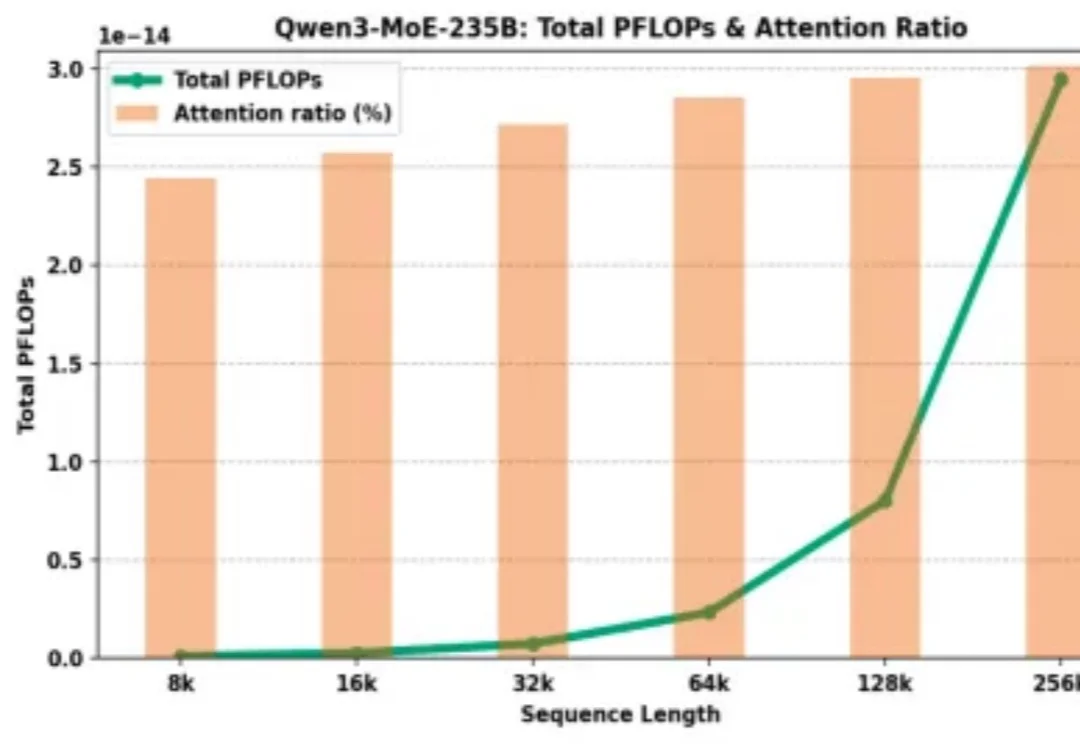

为什么大模型厂商给了 128K 的上下文窗口,却在计费上让长文本显著更贵?

「我谨以谦卑的心情并十分荣幸地向各位宣布: 我的朋友,骡子马,东百抽象明星,前GQ时尚编辑,成为光荣的葬愛家族一员💗

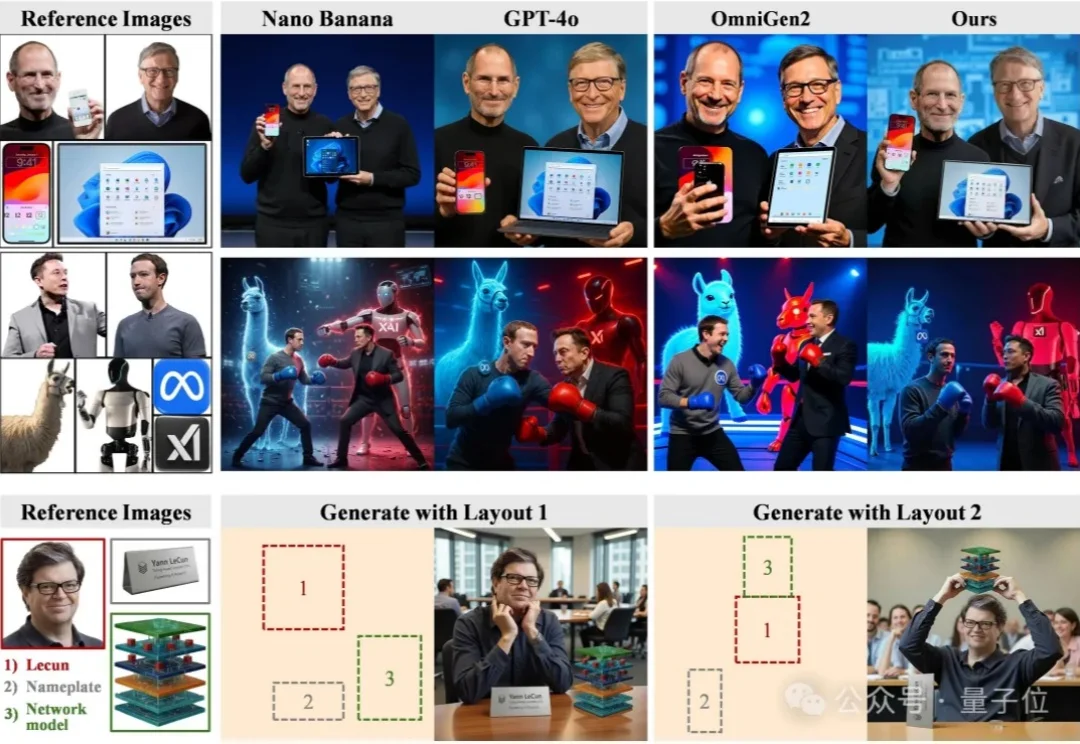

浙江大学ReLER团队开源ContextGen框架,攻克多实例图像生成中布局与身份协同控制难题。基于Diffusion Transformer架构,通过双重注意力机制,实现布局精准锚定与身份高保真隔离,在基准测试中超越开源SOTA模型,对标GPT-4o等闭源系统,为定制化AI图像生成带来新突破。

在 SIGGRAPH Asia 2025 期间,盛大 AI 东京研究院(Shanda AI Research Tokyo)以展台活动、BoF 学术讨论与顶尖教授闭门交流等形式完成首次公开亮相,标志着盛大在数字人的 “交互智能 (Interactive Intelligence)” 与世界模型的 “时空智能 (Spatiotemporal Intelligence)” 等两大方向的研究

在李飞飞团队 WorldLabs 推出 Marble、引爆「世界模型(World Model)」热潮之后,一个现实问题逐渐浮出水面:世界模型的可视化与交互,依然严重受限于底层 Web 端渲染能力。

尽管扩散模型在单图像生成上已经日渐成熟,但当任务升级为高度定制化的多实例图像生成(Multi-Instance Image Generation, MIG)时,挑战随之显现: