Redis 之父这篇 AI 文章,让我特别共鸣。

Redis 之父这篇 AI 文章,让我特别共鸣。上周写过一篇文章,后来删了。评论区有几个朋友说,我在营造焦虑。这肯定不是我想要的结果。想了想,问题可能出在我没把核心意思讲清楚。

上周写过一篇文章,后来删了。评论区有几个朋友说,我在营造焦虑。这肯定不是我想要的结果。想了想,问题可能出在我没把核心意思讲清楚。

事实就是事实!编程已经被AI永久改变了!

如果三年前有人告诉你,一个没有周杰伦等专属大牌、没有热门综艺OST的音乐APP,能在月活上逼近网易云音乐,你会觉得这是天方夜谭。

当我深入分析Metaforms的解决方案时,发现他们的创新不仅仅在于技术本身,更在于对市场研究工作流程的深刻理解和重新设计。他们开发的AI agent系统能够无缝集成到现有的研究流程中,自动化那些最耗时的手工操作。

人总会找到一个理由喝酒:工作不开心了,分手不开心了,找不到人生意义不开心了......越喝越多,话就越来越密,总会经历一个状态——拉着我让我推荐一杯“最适合”ta的。 我在朋友的酒吧里兼职摇酒,“不开

谷歌 Gemini 数据联合负责人 Andrew Dai 联手苹果首席研究科学家 Yinfei Yang,隐身创办 AI 新秀 Elorian。首轮将融资 5000 万美元,剑指「视觉推理」这个下一代大模型的核心问题。

Anthropic联创又出来说话了!

这些改变世界的产品,最初居然都是不被当回事儿的支线项目(side project)?!

2026硅谷「爽文剧本」已备好:Ilya将卖掉SSI、OpenAI可能吞下Pinterest、特斯拉将接盘xAI、苹果AI有望翻身……这些惊人预言到底哪些会在2026年成真?

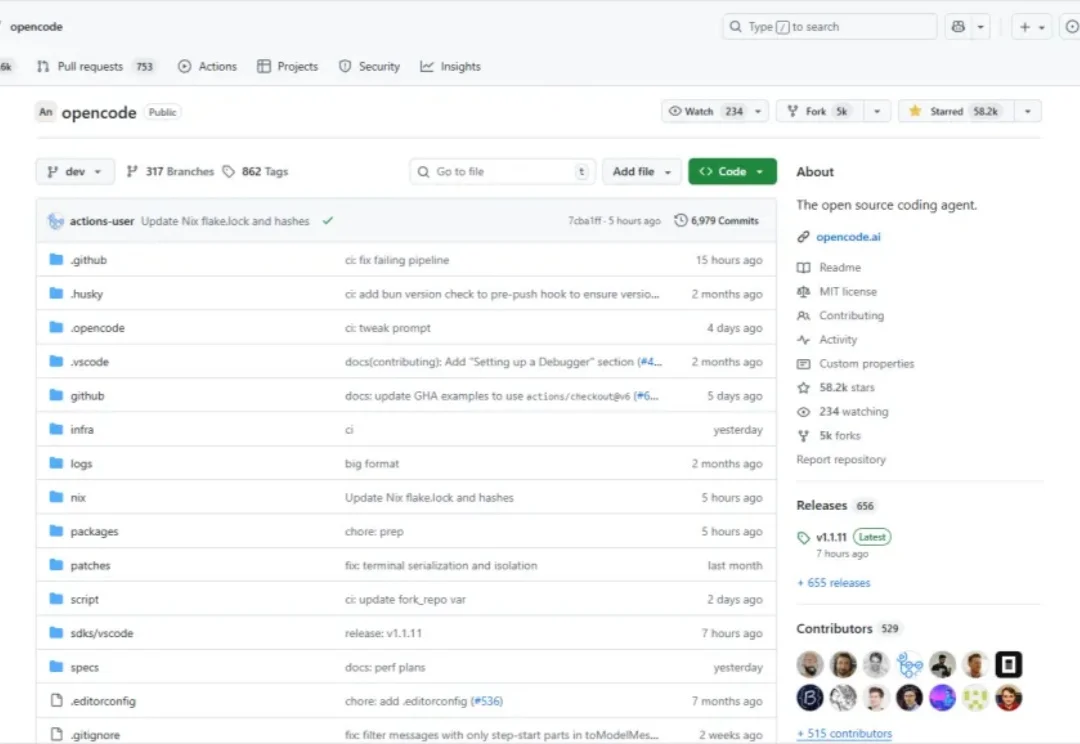

相信很多朋友,都听过Claude Code的大名。