扩散LLM推理用上类GRPO强化学习!优于单独SFT,UCLA、Meta新框架d1开源

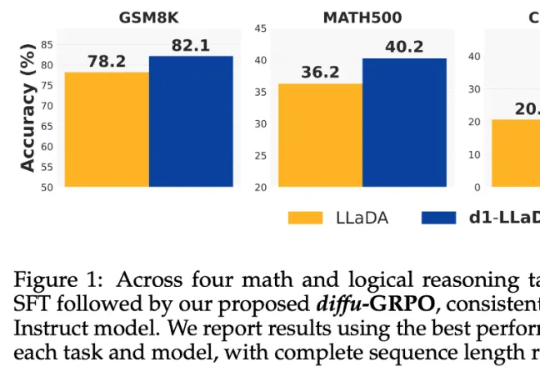

扩散LLM推理用上类GRPO强化学习!优于单独SFT,UCLA、Meta新框架d1开源当前,强化学习(RL)方法在最近模型的推理任务上取得了显著的改进,比如 DeepSeek-R1、Kimi K1.5,显示了将 RL 直接用于基础模型可以取得媲美 OpenAI o1 的性能不过,基于 RL 的后训练进展主要受限于自回归的大语言模型(LLM),它们通过从左到右的序列推理来运行。

当前,强化学习(RL)方法在最近模型的推理任务上取得了显著的改进,比如 DeepSeek-R1、Kimi K1.5,显示了将 RL 直接用于基础模型可以取得媲美 OpenAI o1 的性能不过,基于 RL 的后训练进展主要受限于自回归的大语言模型(LLM),它们通过从左到右的序列推理来运行。

最近也是好起来了,上周四去杭州参加了字节火山的线下meetup开发者大会。在会议现场亲自体验了他们这次新发布的大模型和产品,整个过程还挺有意思的。视觉模型Doubao-1.5-vision-pro也非常nice

想象一个世界,你的亲人从未真正离去。DeepMind与科罗拉多大学提出「生成幽灵」——基于逝者数据打造自主的数字智能体。它不仅承载记忆和声音,还能以「逝者视角」回复当下事件,带来情感慰藉与想象。这不是科幻小说,AI正在创造逝者的数字回声,分享新见解并回应当下世界。

一句话看懂:o3以深度推理与工具调用能力领跑复杂任务,GPT-4.1超长上下文与精准指令执行适合API开发,而o4-mini则堪称日常任务的「性价比之王」。

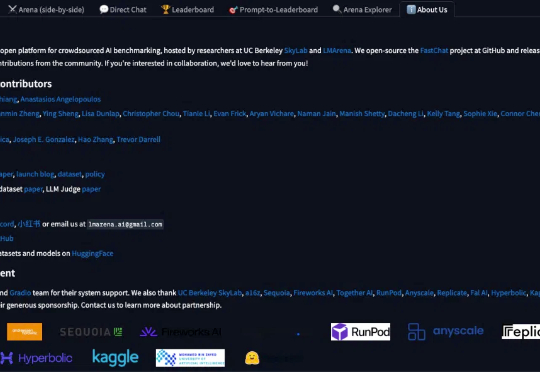

作为学术研究项目,原加州大学伯克利分校的Chatbot Arena,其网站已成为访客试用新人工智能模型的热门平台,现正转型为独立公司。

此事的结果,大概率是AI企业最终会选择妥协。

阿拉伯联合酋长国计划利用人工智能,协助起草新法规及审查修订现行法律,这是这个海湾国家在AI上已投入数十亿美元基础上,采取的最激进尝试。人工智能研究人员表示,该国官方媒体所称的“人工智能驱动监管”计划比其他任何地方所见都更为超前,同时指出细节尚不充分。其他政府正尝试运用 AI 提升效率,从法案摘要到优化公共服务,但尚未通过分析政府与法律数据来主动提议修改现行法律。

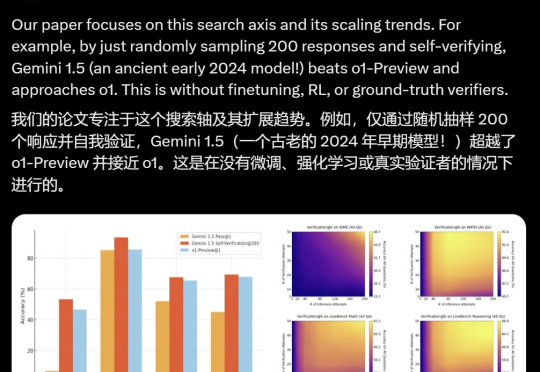

采样多就一定准吗?研究人员用实验告诉你:是的,而且超乎想象!基于采样的搜索不仅能在并行处理中大展身手,还通过隐式扩展让验证更精准。

OpenAI 最近发布了三份针对企业客户的研究报告,本次挑选了其中的「AI in the Enterprise」一篇进行了翻译。

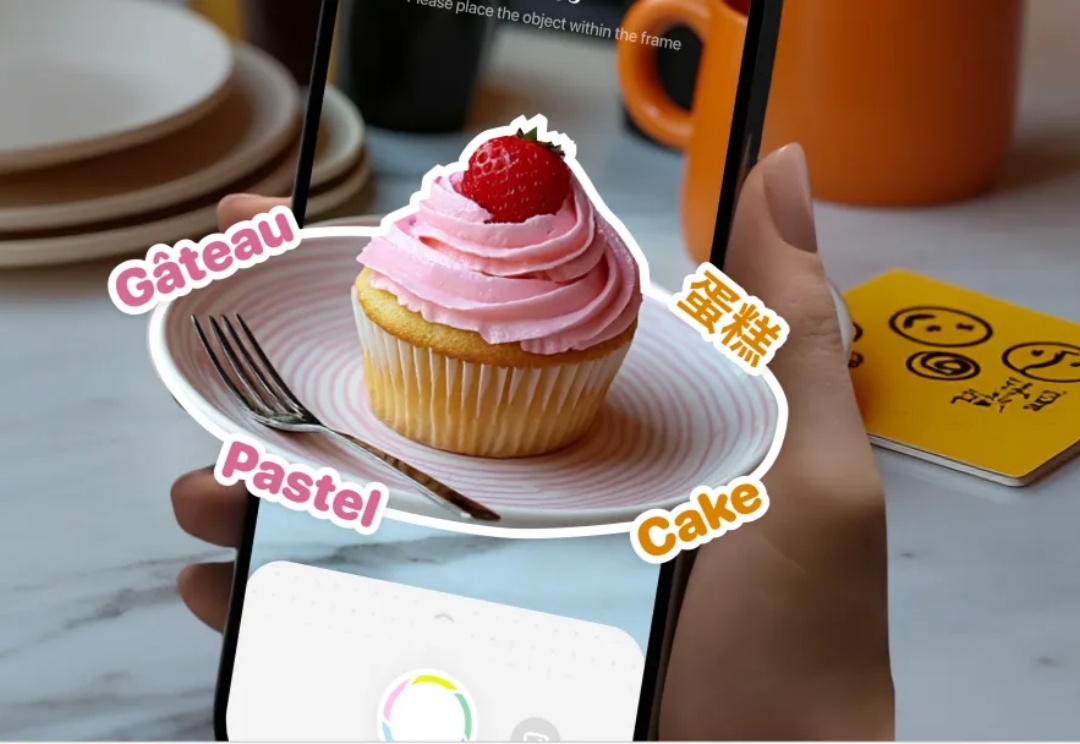

从一句“爸爸,这个怎么说?”开始,一款爆火的外语学习 App 诞生了。