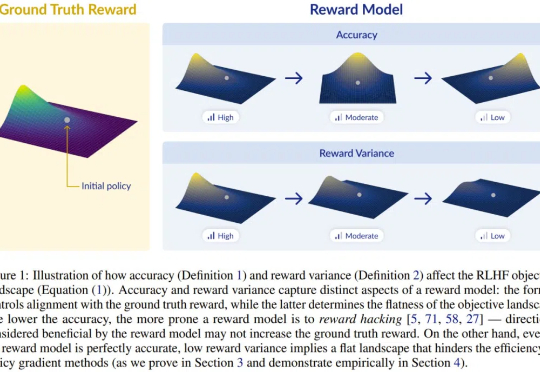

为什么明明很准,奖励模型就是不work?新研究:准确度 is not all you need

为什么明明很准,奖励模型就是不work?新研究:准确度 is not all you need训练狗时不仅要让它知对错,还要给予差异较大的、不同的奖励诱导,设计 RLHF 的奖励模型时也是一样。

来自主题: AI技术研报

11002 点击 2025-03-24 15:33

训练狗时不仅要让它知对错,还要给予差异较大的、不同的奖励诱导,设计 RLHF 的奖励模型时也是一样。

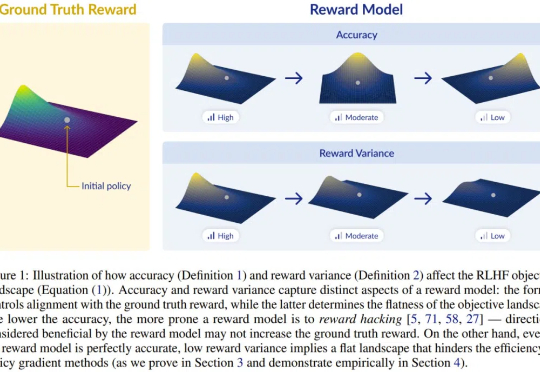

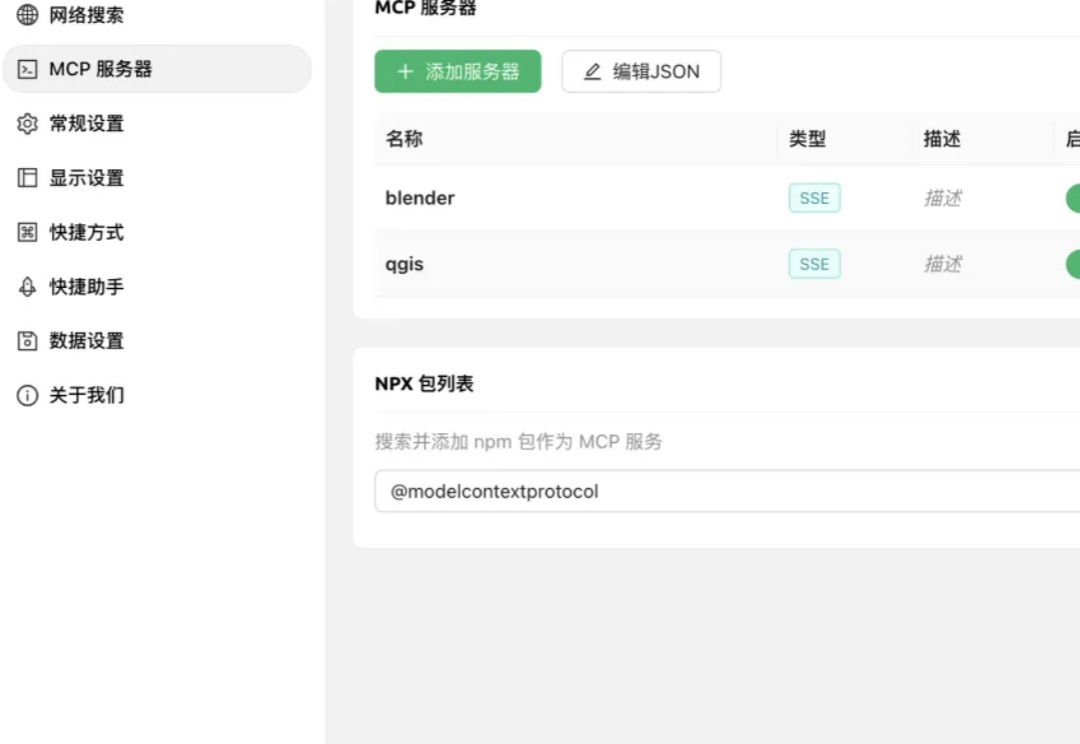

我最近一段时间,除了处理项目上的一些问题,我将我的大部分时间都在体验目前的MCP成果上,我也在和不同的朋友进行交流,其实交流下来,只要是自己亲身使用过目前的MCP工具的基本上都有一些共同的认知:

据与两家公司高管交谈的两位人士透露,OpenAI 高管在最近几个月多次与信实工业(Reliance Industries)的高管会面,讨论了潜在的产品和销售合作伙伴关系。

上期做了一个一键安装 MCP 项目的平价方案,

前段时间 AI 成了带货密码,而其中卖得最好的品类之一就是 AI 键盘。

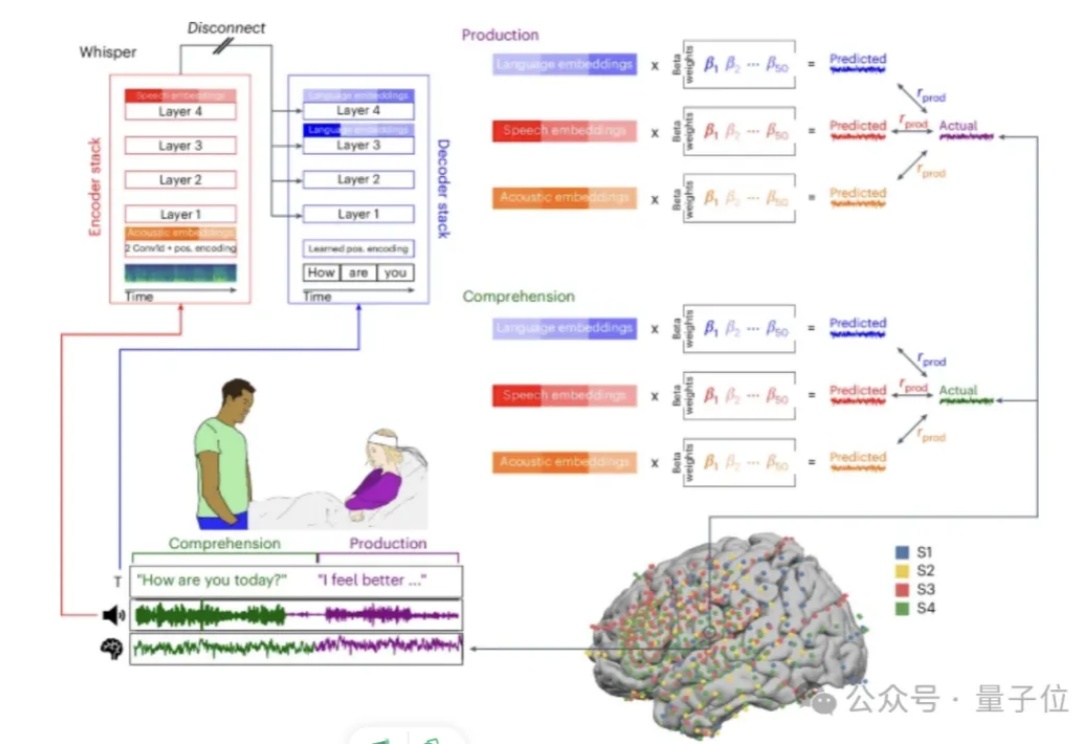

谷歌最新发现,大模型竟意外对应人脑语言处理机制?!

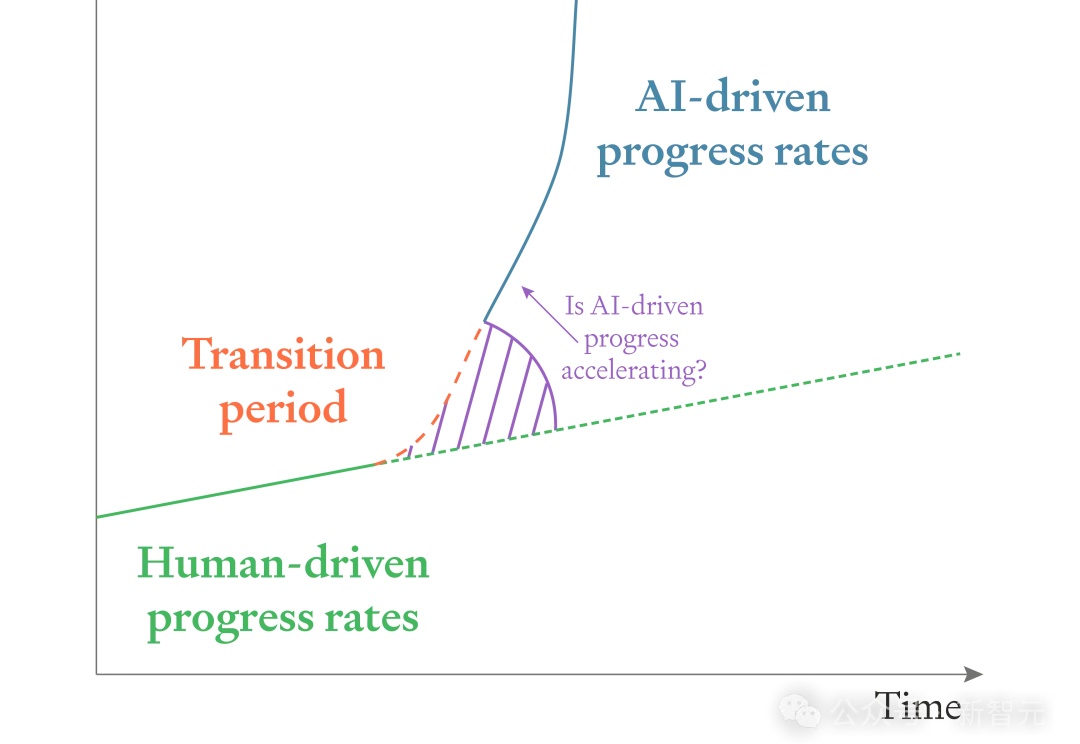

DeepSeek之后,大模型下半场的走向如何?

硅谷投资人Tom Davidson的硬核长文预测,给出了惊人结论:全栈的AI大爆炸,或将率先发生在中国!而当芯片规模扩大1万倍时,AI将逼近物理极限。

当你想将tool带入一个你无法控制的Agent时,MCP就是有用的。

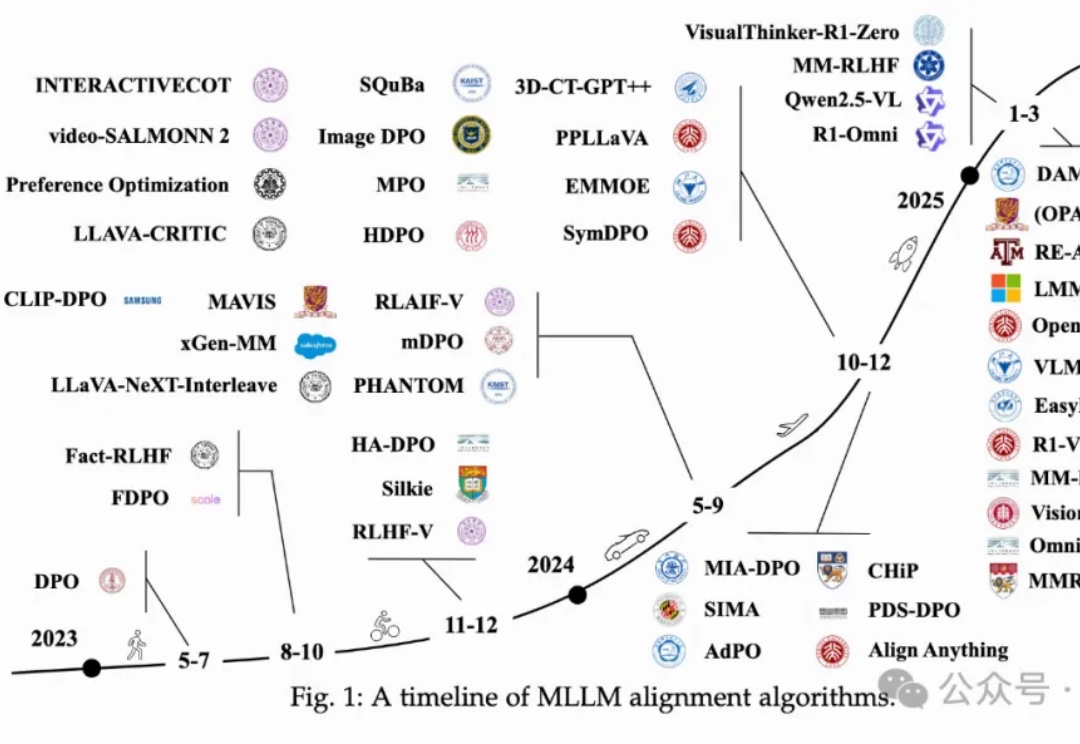

万字长文,对多模态LLM中对齐算法进行全面系统性回顾!