阿里mPLUG-Owl新升级,鱼与熊掌兼得,模态协同实现MLLM新SOTA

阿里mPLUG-Owl新升级,鱼与熊掌兼得,模态协同实现MLLM新SOTAOpenAI GPT-4V 和 Google Gemini 都展现了非常强的多模态理解能力,推动了多模态大模型(MLLM)快速发展,MLLM 成为了现在业界最热的研究方向。

OpenAI GPT-4V 和 Google Gemini 都展现了非常强的多模态理解能力,推动了多模态大模型(MLLM)快速发展,MLLM 成为了现在业界最热的研究方向。

构建AI Agent有三步:第一步,专家知识的数字化;第二步,支持更多模态的交互;第三步,领域知识的循环沉淀。

在Gemini开放API不到一周的时间,港中文等机构就完成评测,联合发布了多达128页的报告,结果显示:在37个视觉理解任务上,Gemini-Pro表现出了和GPT-4V相当的能力。

多模态技术是 AI 多样化场景应用的重要基础,多模态大模型(MLLM)展现出了优秀的多模态信息理解和推理能力,正成为人工智能研究的前沿热点。上周,谷歌发布 AI 大模型 Gemini,据称其性能在多模态任务上已全面超越 OpenAI 的 GPT-4V,再次引发行业的广泛关注和热议。

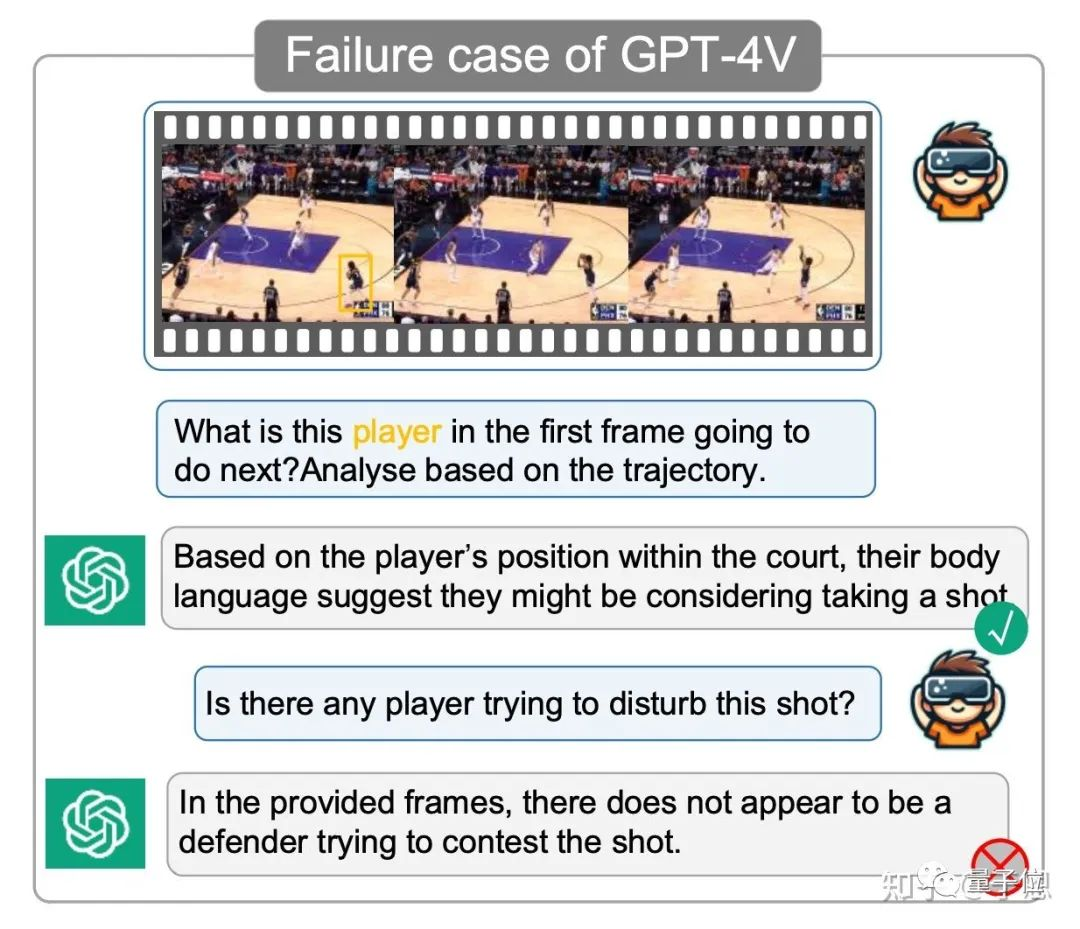

多模态大语言模型展现了强大的图像理解和推理能力。但要让它们基于当前观测来对未来事件进行预测推理仍然非常困难。

12月15日,上海交通大学医学院附属瑞金医院正式发布瑞金医学大模型矩阵,涵盖RJH-Base基座大模型、RJH-Med应用大模型,以及多模态大模型,并携手上海人工智能实验室、腾讯等建设可持续发展的医学大模型应用生态,实践以数据、知识、算法、模型为关键驱动的医学AI新范式。

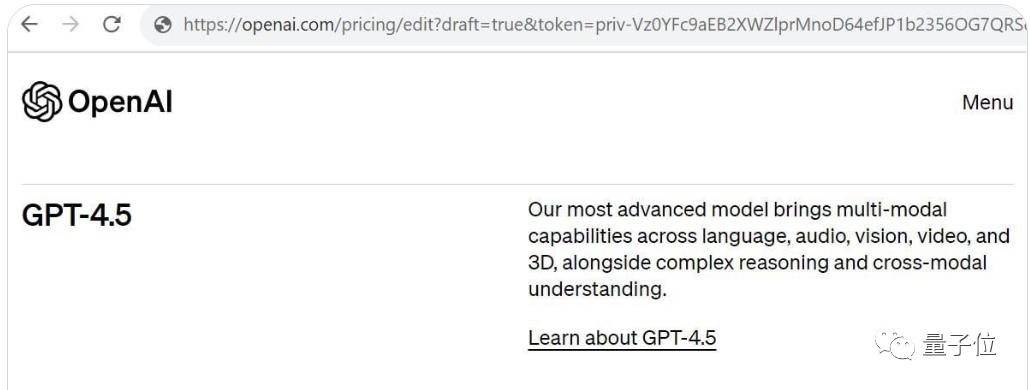

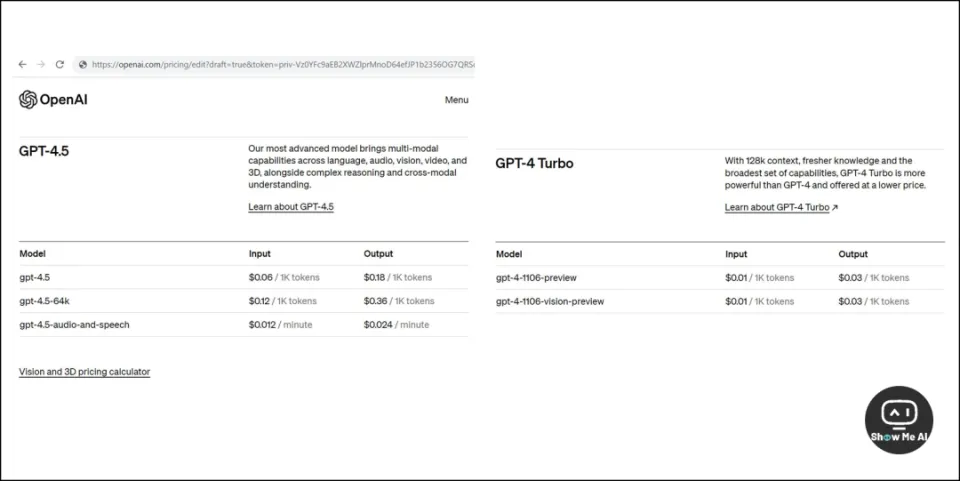

GPT 4.5疑似大泄漏: 一个是新模型将具备全新多模态能力,文本语音图片以及视频和3D信息全都能一并处理,并且还可以跨模态理解。

OpenAI GPT-4.5 遭泄露,我们即将见识「加强版」多模态大模型

过去我们谈AIGC,谈的是生成算法模型的突破创新,谈的是多模态技术的融合……而从来没有一个时刻像2023这般让我们距AI如此之近。

喂给大模型语料——最初是维基百科和Reddit,后来扩展到音频、视觉图像甚至雷达和热图像——后者广义上说是换了种表达方式的语言。也因此有生成式AI的创业者认为,一个极度聪明的大语言模型就是那个通往AGI最终答案,多模态的研究道路只是目前对前者的底气不足。