视觉模型底座超越OpenAI,格灵深瞳开启多模态落地的Scaling Law

视觉模型底座超越OpenAI,格灵深瞳开启多模态落地的Scaling Law大模型时代,有个大家普遍焦虑的问题:如何落地?往哪落地?

大模型时代,有个大家普遍焦虑的问题:如何落地?往哪落地?

在AI面前,做一个会提问的文科生

基于图神经网络的方法被广泛应用于不同问题并且显著推动了相关领域的进步,包括但不限于数据挖掘、计算机视觉和自然语言处理。考虑到图神经网络已经取得了丰硕的成果,一篇全面且详细的综述可以帮助相关研究人员掌握近年来计算机视觉中基于图神经网络的方法的进展,以及从现有论文中总结经验和产生新的想法。

Sam Altman拿了这么多各路神仙的钱后,会不会也为了“回购”而睡不着觉?

当答案变得唾手可得时,真正有价值的反而是提出正确问题的能力,以及掌握正确思维方式的能力。

所有模型都是通过在来自互联网的海量数据上进行训练来工作的,然而,随着人工智能越来越多地被用来生成充满垃圾信息的网页,这一过程可能会受到威胁。

AI革命,从自动驾驶到教育重塑

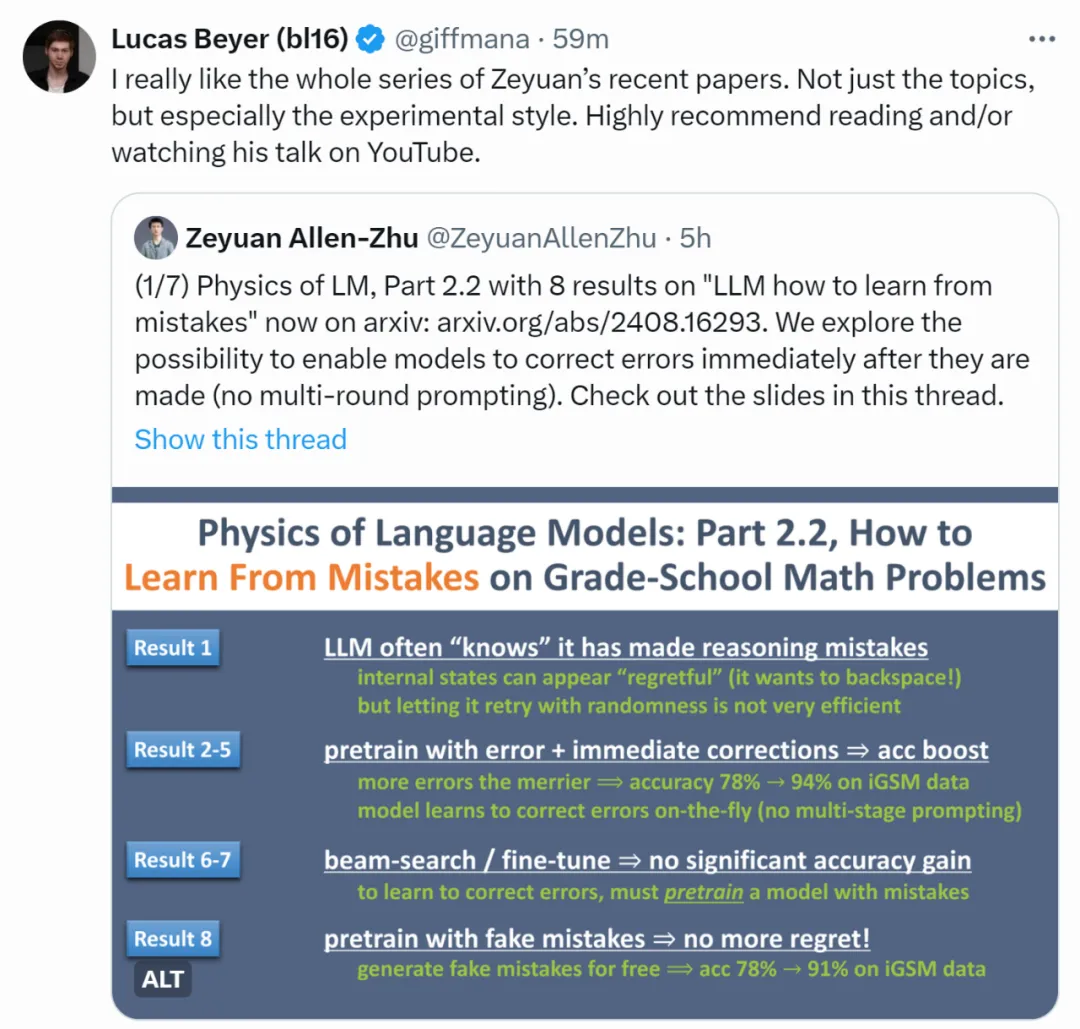

即便是最强大的语言模型(LLM),仍会偶尔出现推理错误。除了通过提示词让模型进行不太可靠的多轮自我纠错外,有没有更系统的方法解决这一问题呢?

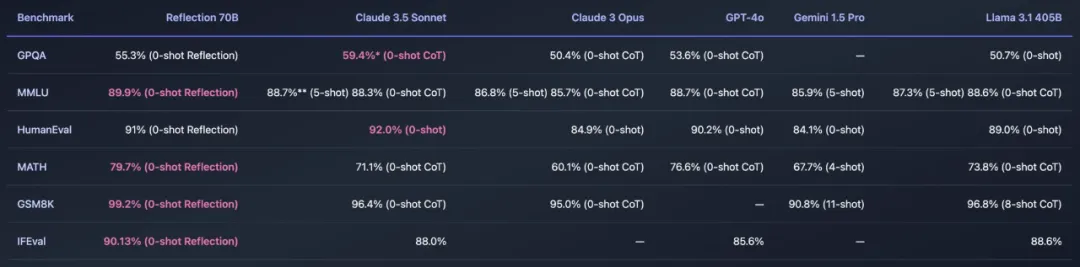

最近,开源大模型社区再次「热闹」了起来,主角是 AI 写作初创公司 HyperWrite 开发的新模型 Reflection 70B。

宾夕法尼亚大学苏炜杰教授团队在ICML 2023会议中进行实验显示,经过作者自评校准后,审稿分数的误差降低超过20%。