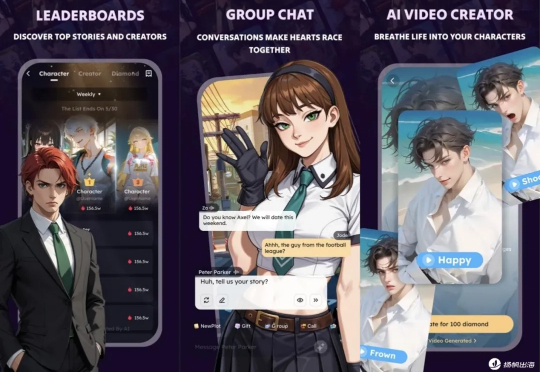

AI社交持续吸金,多款应用月收入飙升,“AI剧本漫”玩法爆了

AI社交持续吸金,多款应用月收入飙升,“AI剧本漫”玩法爆了近年来,AI社交赛道作为一个快速崛起的“品种”,曾凭借玩法新颖与技术想象力迅速吸引了市场关注。然而,随着入局者增加,赛道逐渐暴露出增长瓶颈:玩法趋于固化、功能高度同质化、用户体验缺乏持续吸引力。种种迹象都在指向一个信号:市场正在走向降温与饱和。

搜索

搜索

近年来,AI社交赛道作为一个快速崛起的“品种”,曾凭借玩法新颖与技术想象力迅速吸引了市场关注。然而,随着入局者增加,赛道逐渐暴露出增长瓶颈:玩法趋于固化、功能高度同质化、用户体验缺乏持续吸引力。种种迹象都在指向一个信号:市场正在走向降温与饱和。

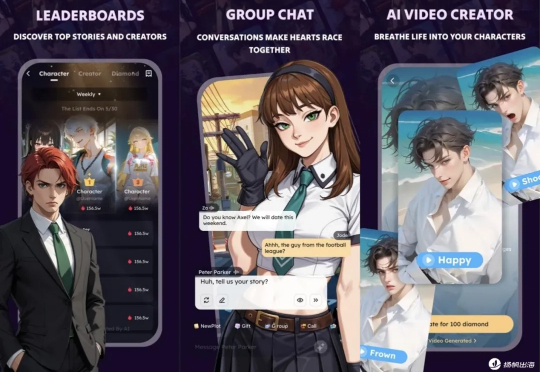

打工人超超超实用利器来了!还在自己苦巴巴地做汇报,干巴巴地念PPT么? 谷歌NotebookLM最新功能,只需要输入数据、图表、旁白,就可以自动生成带AI音频的PPT,甚至不需要自己去讲。

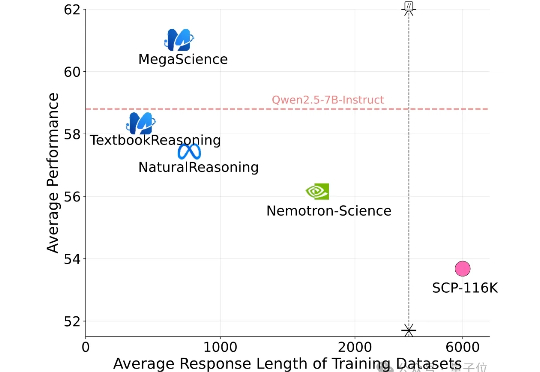

有史规模最大的开源科学推理后训练数据集来了! 上海创智学院、上海交通大学(GAIR Lab)发布MegaScience。该数据集包含约125万条问答对及其参考答案,广泛覆盖生物学、化学、计算机科学、经济学、数学、医学、物理学等多个学科领域,旨在为通用人工智能系统的科学推理能力训练与评估提供坚实的数据。

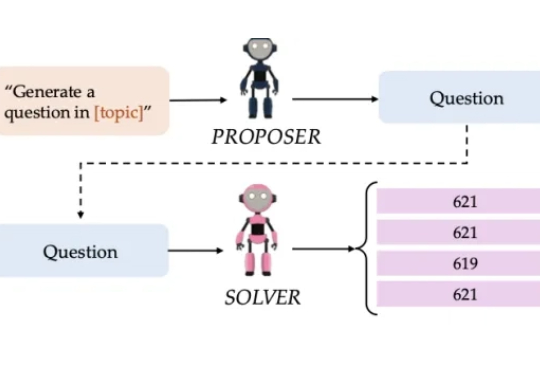

AI通过自问自答就能提升推理能力?! 这正是卡内基梅隆大学团队提出的新框架SQLM——一种无需外部数据的自我提问模型。

心理健康问题影响着全球数亿人的生活,然而患者往往面临着双重负担:不仅要承受疾病本身的痛苦,还要忍受来自社会的偏见和歧视。世界卫生组织数据显示,全球有相当比例的心理健康患者因为恐惧社会歧视而延迟或拒绝治疗。

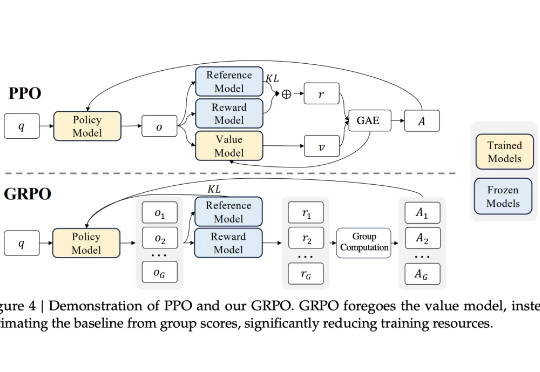

众所周知,大型语言模型的训练通常分为两个阶段。第一阶段是「预训练」,开发者利用大规模文本数据集训练模型,让它学会预测句子中的下一个词。第二阶段是「后训练」,旨在教会模型如何更好地理解和执行人类指令。

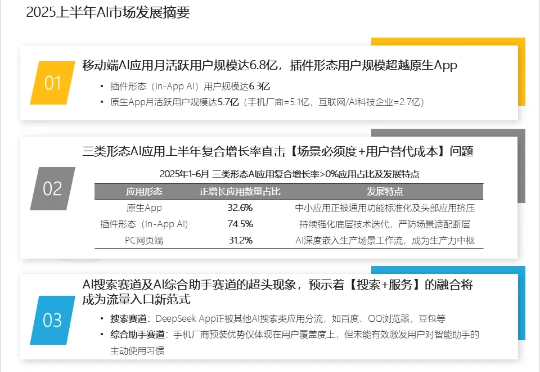

QuestMobile 发布了 2025 年国内 AI 应用的上半年报告,总的来说,相比海外市场 app 和 web 市场都很火热的情况,国内市场的情况差别比较大。

AI行业对数据的渴求程度,质量大于数量。

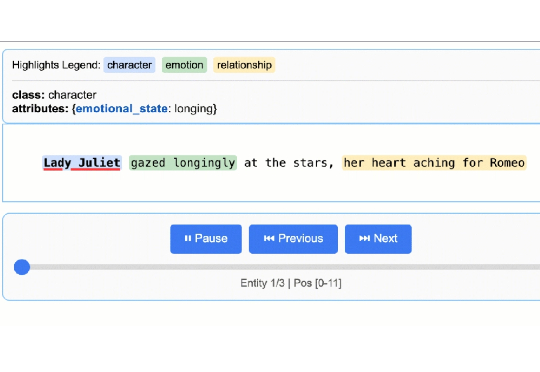

LangExtract 是一个 Python 库,利用大型语言模型(LLMs)从非结构化文本中提取结构化信息,基于用户定义的指令。它可以处理临床笔记或报告等材料,识别并组织关键细节,同时确保提取的数据与源文本对应。

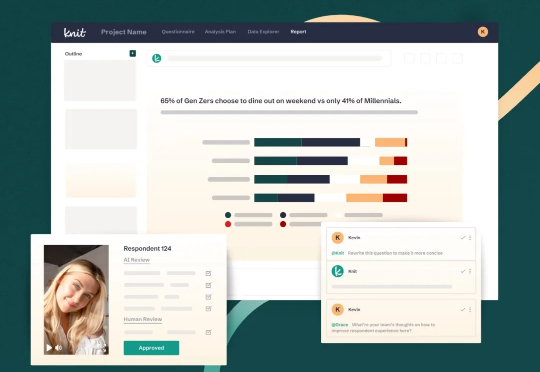

当传统调研机构还在用老套路——焦点小组、电话访谈、数周的数据分析——来服务客户时,一家名为 Knit 的创业公司正在用完全不同的方式重新定义这个价值数百亿美元的行业。他们刚刚完成了 1610 万美元的 A 轮融资,由 GFT Ventures 和阿什顿·库彻的 Sound Ventures 领投,这不仅仅是一笔投资,更是对企业洞察未来方向的一次重大押注。