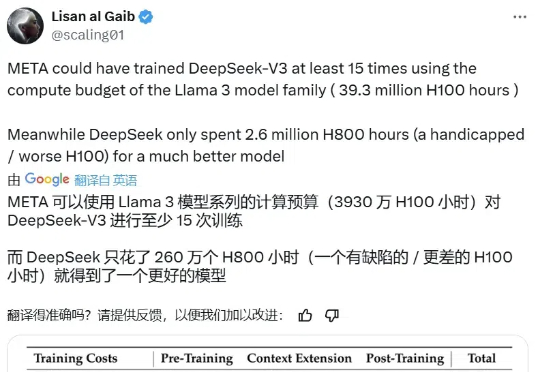

Meta陷入恐慌?内部爆料:在疯狂分析复制DeepSeek,高预算难以解释

Meta陷入恐慌?内部爆料:在疯狂分析复制DeepSeek,高预算难以解释「工程师正在疯狂地分析 DeepSeek,试图从中复制任何可能的东西。」DeepSeek 开源大模型的阳谋,切切实实震撼着美国 AI 公司。最先陷入恐慌的,似乎是同样推崇开源的 Meta。

搜索

搜索

「工程师正在疯狂地分析 DeepSeek,试图从中复制任何可能的东西。」DeepSeek 开源大模型的阳谋,切切实实震撼着美国 AI 公司。最先陷入恐慌的,似乎是同样推崇开源的 Meta。

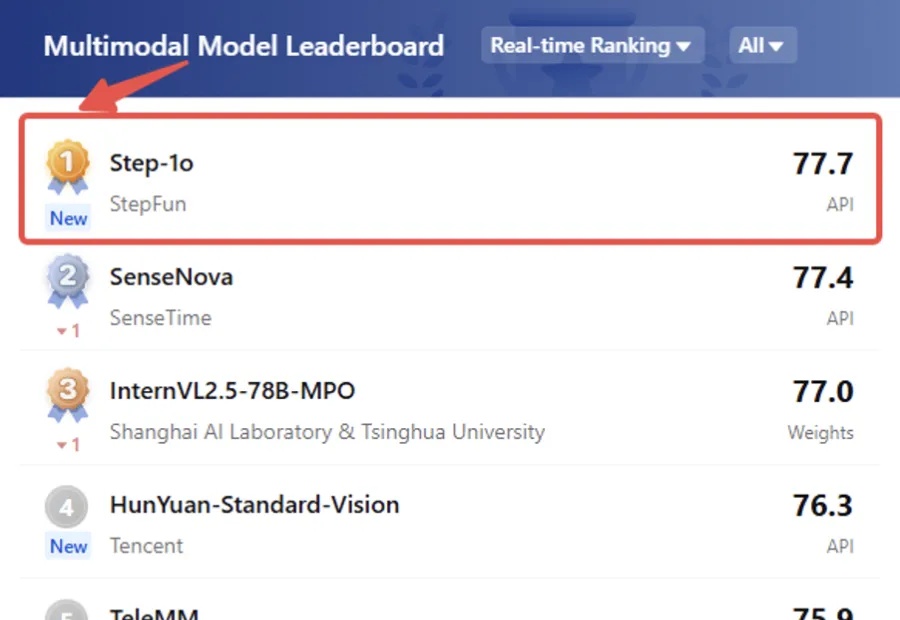

跟AI交互这事儿,商汤最新发布的大模型,是有点“够快、够准、够好”在身上的。

刚刚发布的豆包大模型1.5,不仅多模态能力全面提升,霸榜多个基准;更难得的是,它在训练过程中从未使用过任何其他模型生成的数据,坚决不走蒸馏「捷径」。

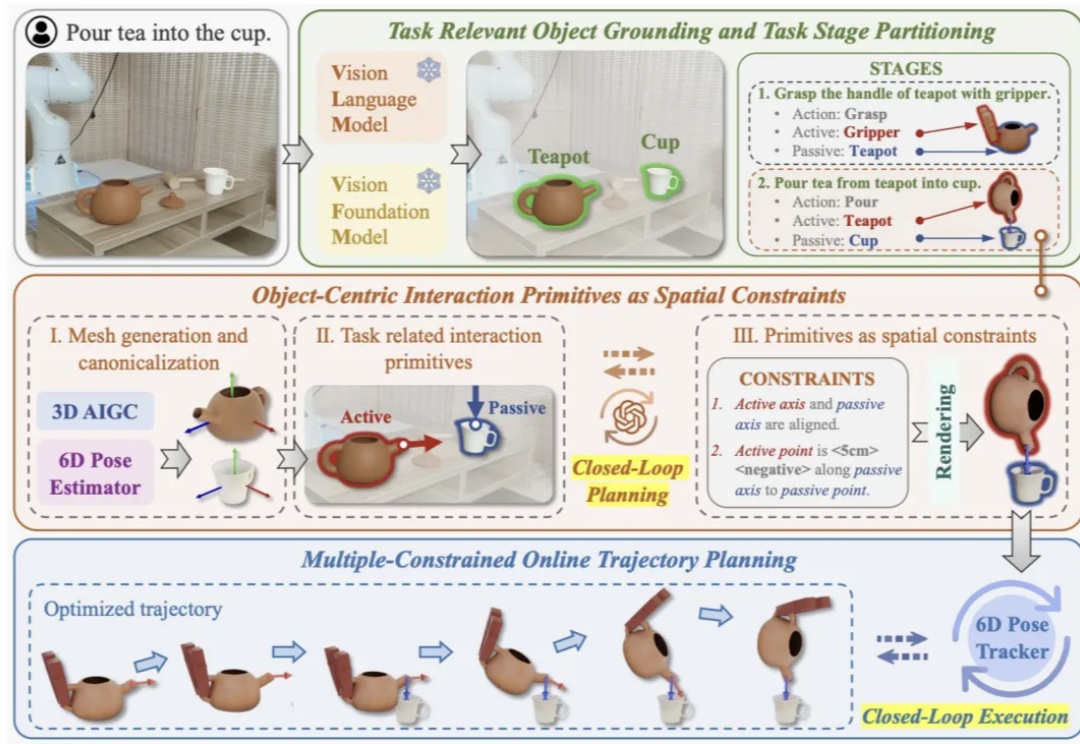

近年来视觉语⾔基础模型(Vision Language Models, VLMs)在多模态理解和⾼层次常识推理上⼤放异彩,如何将其应⽤于机器⼈以实现通⽤操作是具身智能领域的⼀个核⼼问题。这⼀⽬标的实现受两⼤关键挑战制约:

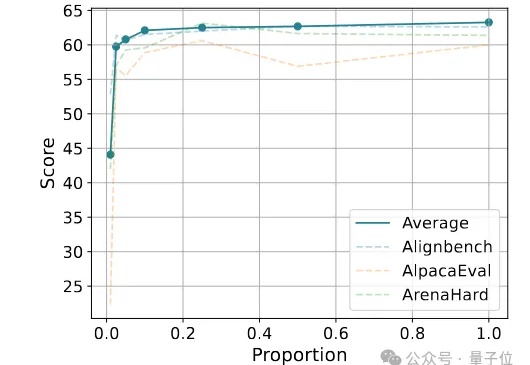

仅使用20K合成数据,就能让Qwen模型能力飙升——

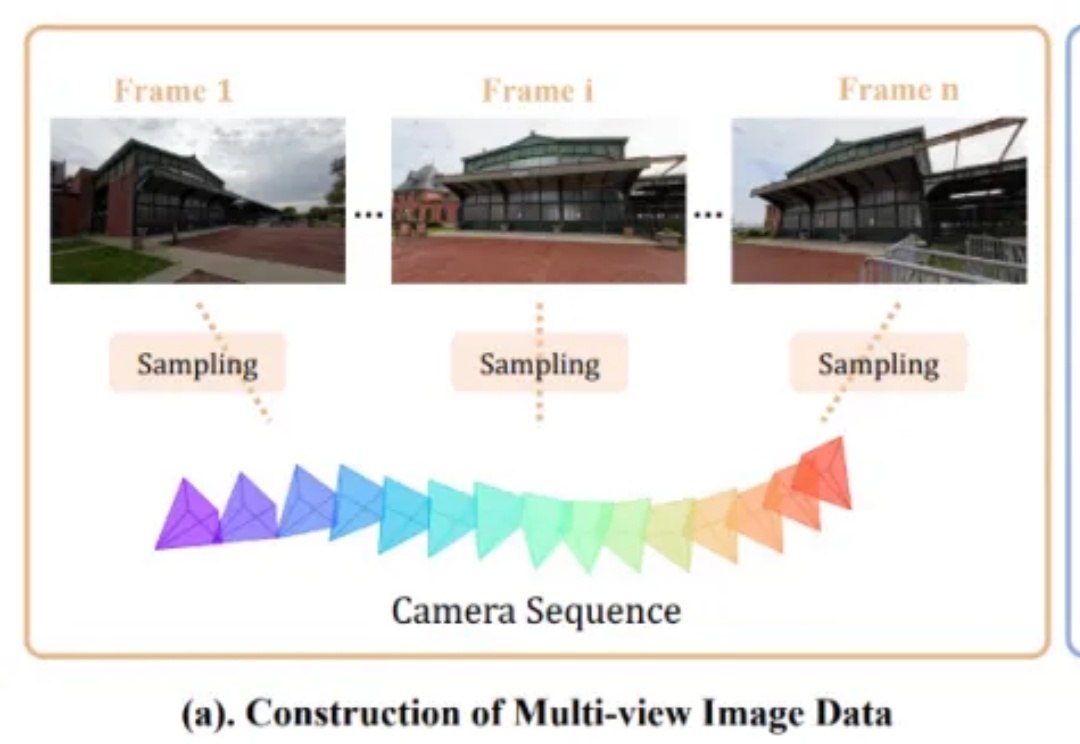

可灵,视频生成领域的佼佼者,近来动作不断。继发布可灵 1.6 后,又公开了多项研究揭示视频生成的洞察与前沿探索 ——《快手可灵凭什么频繁刷屏?揭秘背后三项重要研究》。

AI视频模型正以意想不到的方式影响着世界各地每个人的生活,也包括一位远在大洋彼岸的60岁老奶奶。

今天是个好日子,DeepSeek 与 Kimi 都更新了最新版的推理模型,吸引了广泛关注。与此同时,谷歌 DeepMind、加州大学圣地亚哥分校、阿尔伯塔大学的一篇新的研究论文也吸引了不少眼球,并直接冲上了 Hugging Face 每日论文榜第一(1 月 20 日)。

我勒个老天奶,大模型六小强之一的阶跃星辰,给大家拜早年的方式可真不一样——

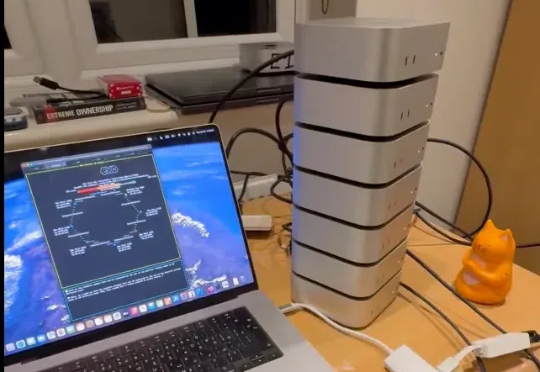

DeepSeek-R1,正在接受全球网友真金白银的检验。花30秒用manim代码制作解释勾股定理的动画,一次完成无错误。为了玩上这样的模型,有人花上10多万元,组7台M4 Pro Mac mini+1台M4 Max Macbook Pro的家用超算。