只激活3.8B参数,性能比肩同款7B模型!训练微调都能用,来自微软

只激活3.8B参数,性能比肩同款7B模型!训练微调都能用,来自微软只需激活60%的参数,就能实现与全激活稠密模型相当的性能。

来自主题: AI技术研报

10488 点击 2024-07-18 16:44

搜索

搜索

只需激活60%的参数,就能实现与全激活稠密模型相当的性能。

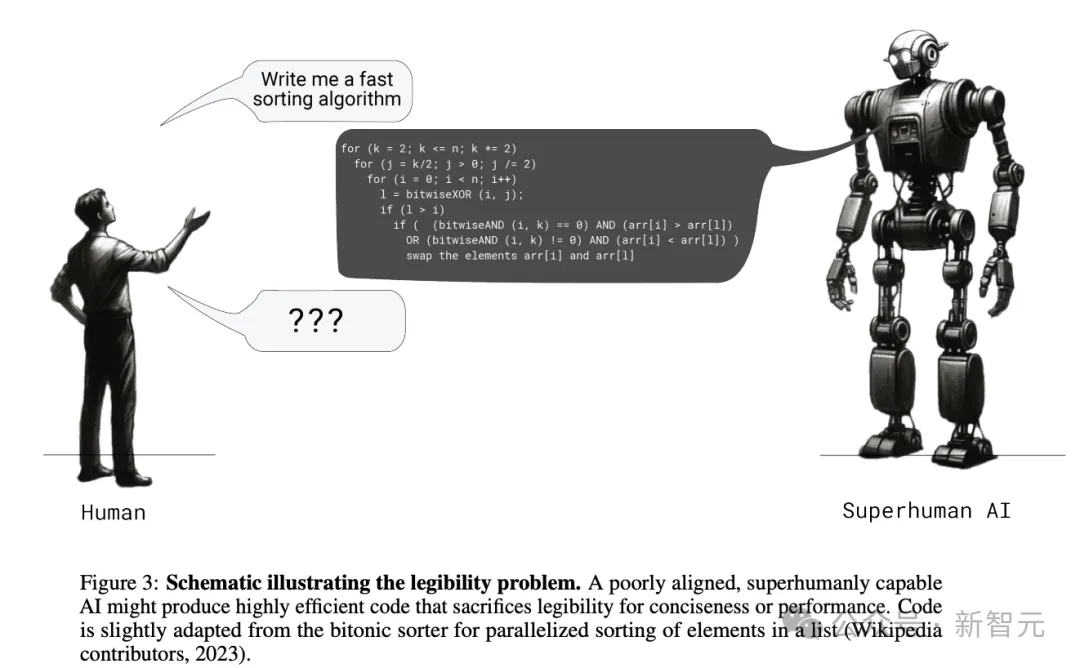

让大小模型相互博弈,就能实现生成内容可读性的提升!

当我们不停在CoT等领域大下苦功、试图提升LLM推理准确性的同时,OpenAI的对齐团队从另一个角度发现了华点——除了准确性,生成答案的清晰度、可读性和可验证性也同样重要。

自回归解码已经成为了大语言模型(LLMs)的事实标准,大语言模型每次前向计算需要访问它全部的参数,但只能得到一个token,导致其生成昂贵且缓慢。

视频生成也能参考“上下文”?!

AI侵权又来了……

这不是新职业

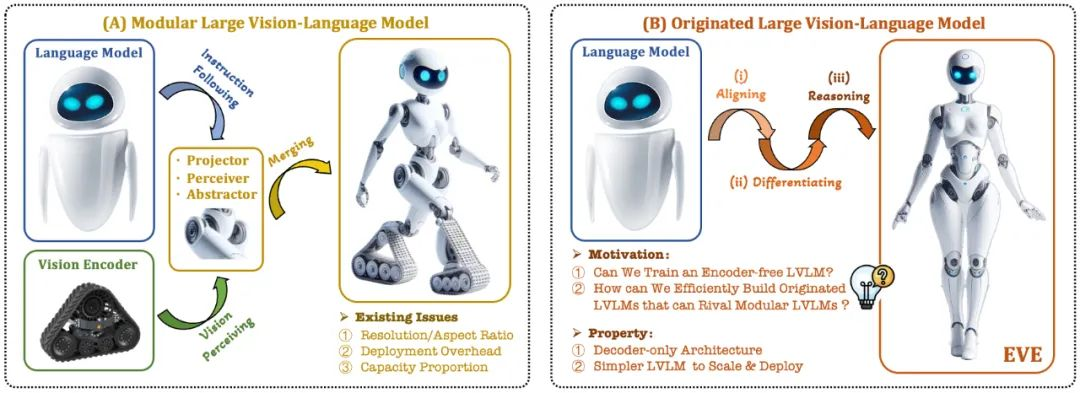

近期,关于多模态大模型的研究如火如荼,工业界对此的投入也越来越多。

把因果链展示给 LLM,它就能学会公理。

假如你有闲置的设备,或许可以试一试。