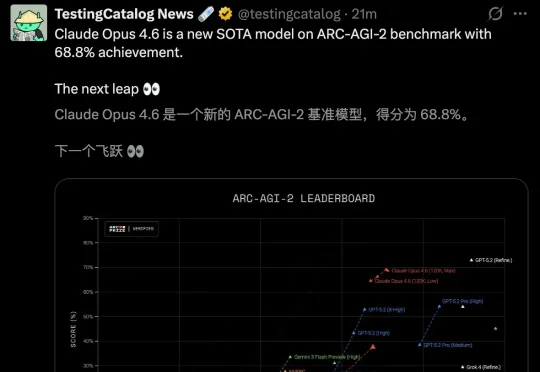

刚刚, Claude Opus 4.6登顶编程之王! 杀入Office全家桶, 15亿打工人变天

刚刚, Claude Opus 4.6登顶编程之王! 杀入Office全家桶, 15亿打工人变天整个硅谷又癫狂了!Anthropic深夜扔出王炸,Claude 4.6用近乎恐怖的编程能力和智能体军团,给OpenAI和谷歌上了一堂名为「降维打击」的课。

搜索

搜索

整个硅谷又癫狂了!Anthropic深夜扔出王炸,Claude 4.6用近乎恐怖的编程能力和智能体军团,给OpenAI和谷歌上了一堂名为「降维打击」的课。

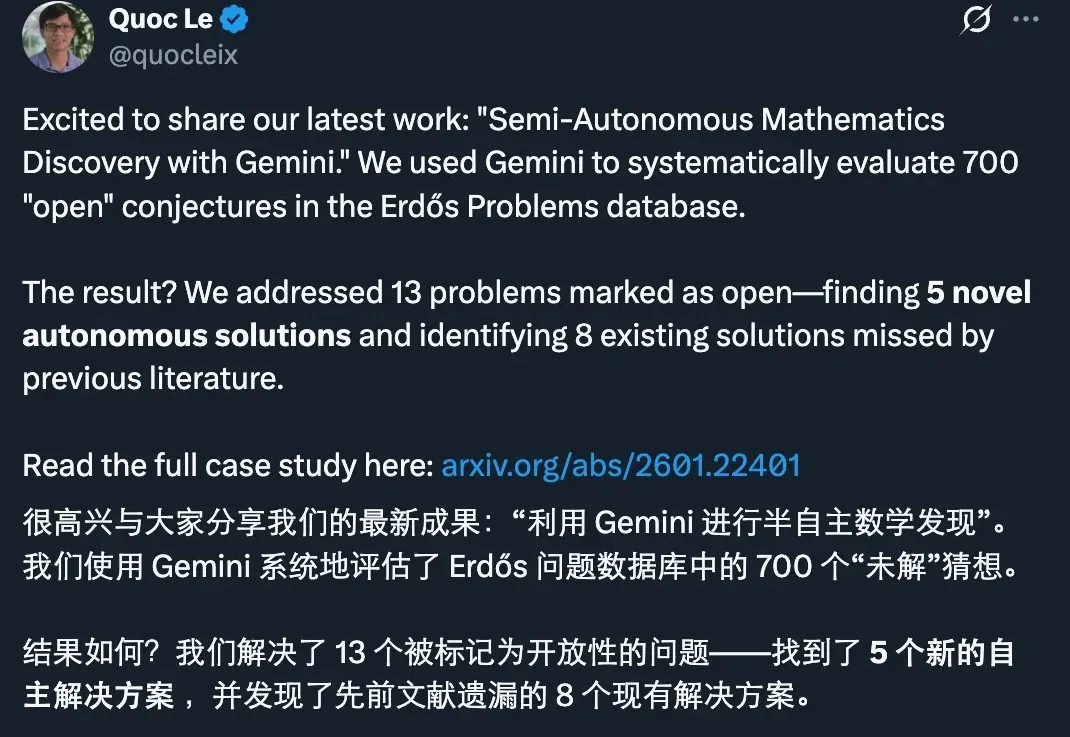

刚刚,谷歌发布了一项新的研究进展:他们用 Gemini 做了一次系统性的数学攻关实验,把目标对准了著名的 Erdős Problems 数据库里 700 个仍被标注为 open(未解决)的猜想。

世界模型真的变天了!今天,谷歌正式发布重磅世界模型原型产品“Project Genie”,只需一句话或一张图,就能一键生成可玩、可交互的实时虚拟世界。 它的重磅程度,让谷歌“掌舵人”劈柴哥和 Google DeepMind 创始人哈萨比斯亲自为它站台。

谷歌Chrome拥抱Gemini 3,用38亿用户的绝对底牌向OpenAI宣战:浏览器不仅是入口,更是终结一切App的超级智能体!

谷歌正式开放世界模型Genie 3的实验性研究原型Project Genie。一夜间暴打了游戏公司市值。《GTA》开发商Take-Two Interactive缩水10%,在线游戏平台Roblox 下跌了超过12%,最惨的是游戏引擎制造商Unity下跌了21%。

行业内许多人认为AI 模型市场的赢家早已确定:大型科技公司将主导市场(谷歌、Meta、微软,以及部分亚马逊业务)并联合其选择的模型开发商,主要是 OpenAI 和 Anthropic。

谷歌在去年夏天发布了一个世界模型 Genie 3。

来了来了!就在刚刚,预热了快半年的 Genie 3 ,终于!可以上手玩了!确实,AI 这种东西,最后还是得靠自己上手。你不进去走两步,很难真的知道它和别的东西差在哪。

世界模型迎来高光时刻:谷歌还在闭源,中国团队已经把SOTA级世界模型全面开源了,LingBot-World正面硬刚Genie 3,彻底打破了全球垄断!

今天,谷歌AlphaGenome登上了Nature封面!去年5月,谷歌DeepMind重磅发布了新一代「阿尔法」模型——AlphaGenome。