多模态大模型理解真实世界的水平到底如何?

有新基准来衡量了。

就在最近,小红书和上海交通大学联合提出WorldSense,一个全新的基准测试,用来评估多模态大模型(MLLMs)的多模态真实场景理解能力。

基于WorldSense,团队对各种先进的MLLMs进行了广泛评估,结果发现:

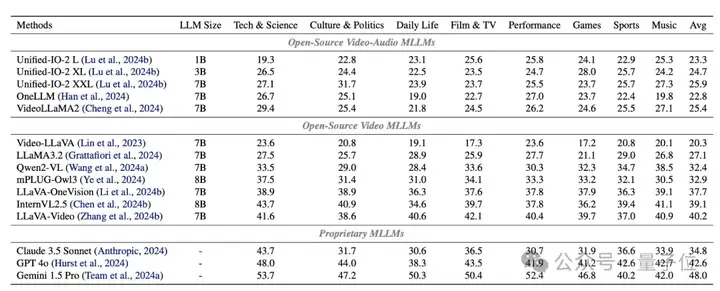

开源的视频-音频模型在该基准上的准确率仅约25%,几乎等同于随机猜测;即使是表现最好的专有模型 Gemini 1.5 Pro,准确率也只有48%,远不能满足可靠的真实世界应用需求。

下面具体来看。

想象一下,当你开车时,不仅要依靠眼睛观察道路标志、交通信号灯和障碍物,还要用耳朵听其他车辆的喇叭声、后方传来的警笛声,甚至通过手对方向盘的触感、车辆行驶时的震动来做出实时决策,确保安全驾驶。

这就是人类在真实场景中自然的多模态信息整合能力。

而现在的多模态大模型,在处理这些复杂的真实世界场景时,表现究竟如何呢?

WorldSense的诞生,正是为了填补现有评估体系的关键空白。

与以往那些存在诸多局限性的基准测试不同,它具备三大核心亮点,为多模态大模型的评估开辟了新的道路。

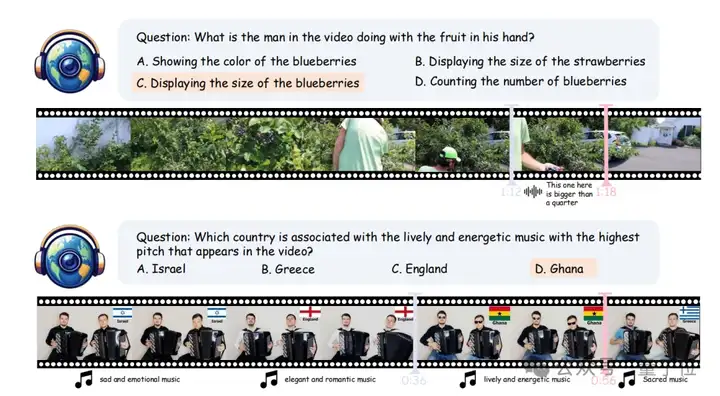

在WorldSense的设计中,音频和视频紧密耦合,每个问题都需要模型充分挖掘音频和视频中的线索,将两者信息有机结合,才能找到正确答案。

比如,在上图第一个例子中,有个人手里拿着水果。如果仅依靠视觉信息,我们可能只能看到他拿着东西这个动作,但很难确定他具体在做什么,是展示水果的颜色、大小,还是在进行其他操作;而仅凭借音频,我们甚至都难以判断他手中拿的是什么水果。

只有将视觉与音频信息协同起来,模型才能准确理解场景,给出正确答案。这种设计严格考验模型同时处理多种感官输入、进行精准理解的能力。

最新的开源视频音频多模态大模型仅仅获得了25%左右的准确率,而表现最好的Gemini 1.5 Pro也只有48%的准确率,并且在缺失一个模态的情况下性能下降约15%左右。

这进一步说明了全模态协同在真实世界感知的重要性和WorldSense中多模态信息的强耦合,也揭示了现有多模态大模型的局限性。

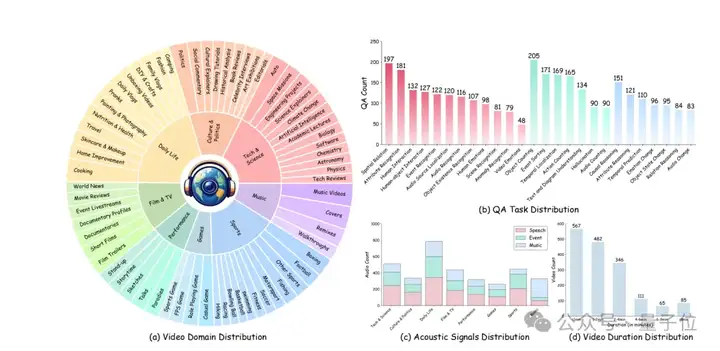

据介绍,WorldSense涵盖了1662个视听同步视频,系统地分为8个主要领域和67个细粒度子类别,覆盖了丰富的真实世界场景。

同时,它还包含3172个多选问答对,横跨26种不同的认知任务,从基础的物体识别、声音辨别,到复杂的因果推理、抽象概念理解,全方位评估MLLMs的多模态理解能力。

为了保证评估的可靠性,所有的问答对都是由80位专家手动标注。

而且,标注过程并非一蹴而就,而是经过多轮严格的人工审核,从语言表达的清晰度、逻辑的连贯性,到答案的准确性和唯一性,都进行了反复考量。

不仅如此,还借助自动MLLM验证技术,进一步确保标注质量。

经过这样双重保障的标注过程,确保问题和答案的准确性和高质量。

如前所述,研究团队基于WorldSense对各种先进的MLLMs进行了广泛评估,结果令人深思。

开源的视频 - 音频模型在该基准上的准确率仅约25%,几乎等同于随机猜测;即使是表现最好的专有模型Gemini 1.5 Pro,准确率也只有48%,远不能满足可靠的真实世界应用需求。

这表明当前的模型在理解真实世界场景方面还面临巨大挑战,同时也凸显了全模态协同理解的重要性。

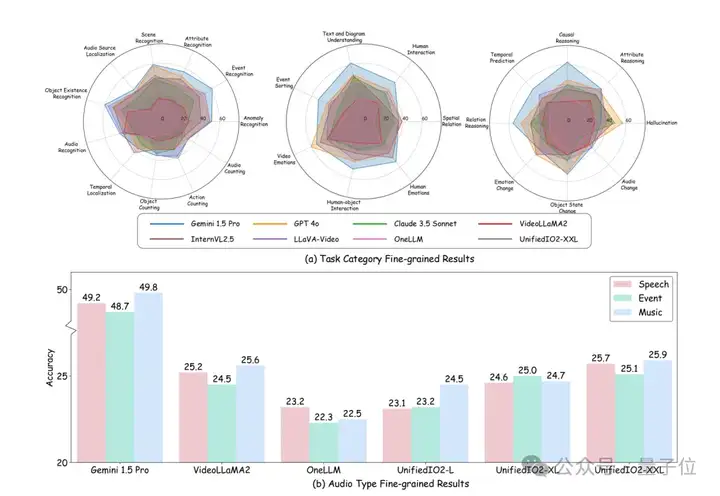

为进一步深入剖析这些模型的性能短板,研究人员开展了细粒度分析,从不同音频类型和任务类别两个关键维度入手,挖掘模型在实际应用中的具体问题。

这一分析为我们深入洞察现有模型的局限性提供了关键视角。

最终结果如下:

1、音频相关任务表现欠佳:模型在音频识别、计数等任务上表现差,显著落后于其他任务类型。这是由于音频信号复杂,现有模型架构和训练方法难以有效解析利用其中的频率、音色等信息。

2、情感相关任务挑战巨大:这类任务需整合面部表情、语气语调、语音内容等多模态线索,模型表现较差,暗示其训练数据缺乏情感样本,且架构算法难以融合多模态信息进行判断。

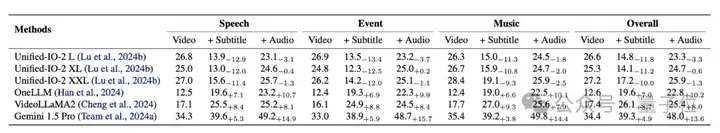

3、不同音频类型下表现各异:以Gemini 1.5 Pro为例,其处理事件相关问题的准确率低于语音或音乐任务,其他模型也存在类似情况。这凸显现有模型缺乏对各种音频类型通用、稳定的理解能力。

鉴于上述评估中揭示的多模态大模型(MLLMs)在性能上的巨大差距,研究团队深入探究了提升MLLMs性能的潜在方法,具体涵盖视觉信息、音频信息以及视频帧等方面的研究。

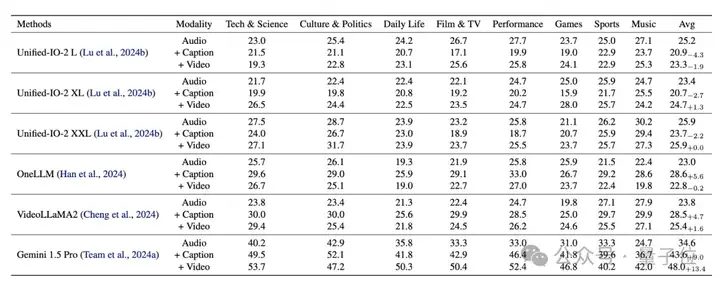

研究人员通过设置不同的输入配置,探究视觉信息对模型性能的影响,这些配置包括仅音频输入、音频结合视频字幕输入以及音频结合视频帧输入。

从实验结果来看,视觉信息通常能提升模型性能。以Gemini 1.5 Pro为例,其仅音频输入时准确率为34.6%,而添加视频帧输入后,准确率提升至48.0%。

然而,不同模型受视觉信息的影响存在差异。像UnifiedIO2系列模型,在结合视频字幕输入时,性能提升效果并不稳定,甚至出现了性能下降的情况。

这一现象表明,一方面,视觉信息若能被模型恰当整合,对增强多模态理解至关重要;另一方面,当前模型在有效利用视觉信息方面的能力仍然有限,可能是因为模型在处理视觉特征与其他模态信息融合时存在困难,或者是在提取视觉关键信息上还不够高效。

在音频信息的研究上,团队设置了三种输入配置进行实验,分别是仅视频输入、视频结合字幕输入以及视频结合原始音频输入。

实验结果呈现出有趣的规律。

对于Gemini 1.5 Pro和OneLLM等模型,添加字幕能提高准确率,而添加原始音频后,准确率提升更为显著,这充分说明字幕和原始音频中的声学特征(如语气、情感、环境声音等)都为多模态理解提供了有价值的信息,且原始音频包含了字幕无法捕捉的重要线索,对多模态理解意义重大。

但不同模型对音频信息的处理能力也有所不同。UnifiedIO2 在整合字幕或音频时,性能出现了下降,尤其是字幕输入导致准确率明显降低,这反映出该模型在多模态处理方面存在困难,可能无法有效融合音频和视觉等多模态信息。

而Video - LLaMA2虽然在添加两种模态信息时性能都有所提升,但对字幕的依赖更强,在处理原始音频时表现相对较弱,这表明它更擅长处理文本形式的音频信息,而在解析复杂声学信息上能力不足。

此外,研究人员还对仅视频输入的 MLLMs 提供转录字幕进行评估,发现几乎所有模型在添加字幕后性能都显著提升,不过在音乐相关问题上,由于字幕无法有效捕捉旋律、节奏和和声等固有声学特征,性能提升并不明显。

这进一步证明了原始音频在多模态理解中的独特价值,同时也表明当前模型在整合声学和文本信息以实现全面场景理解方面存在较大的提升空间。

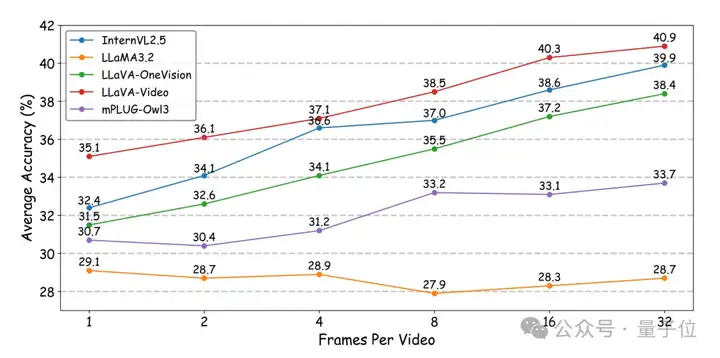

研究团队还研究了视频帧的时间采样密度对模型性能的影响,通过改变仅视频输入的 MLLMs 的输入帧数来进行实验。

结果显示,大多数模型在增加帧密度后,性能有显著提升。

这是因为更高的帧密度能够让模型更好地捕捉视频中细粒度的时间动态变化和微妙的视觉改变,从而提升对视频内容的理解。

例如,在一些包含快速动作或微小细节变化的视频中,增加帧密度能让模型获取更多关键信息,进而做出更准确的判断。但也有例外,如 LLaMA - 3.2 在增加帧密度时,性能并未提升。

这可能与该模型自身的架构特点或训练方式有关,导致它无法有效利用增加的帧信息,这也为后续研究如何优化模型以更好地利用视频帧信息提供了思考方向。

小结一下,通过对视觉信息、音频信息以及视频帧采样密度的研究,为提升MLLMs在真实世界场景中的理解能力提供了重要的参考方向。

未来的研究可以基于这些发现,进一步优化模型架构和训练方法,以增强模型对多模态信息的处理能力,缩小与人类真实世界理解能力之间的差距。

论文链接:

https://arxiv.org/abs/2502.04326

项目主页:

https://jaaackhongggg.github.io/WorldSense/

文章来自于“量子位”,作者“WorldSense团队”。