💡【问题不具体,不会有答案】

本文的作用是帮你把问题具体化,这是用好DeepSeek-R1等推理型模型的前置步骤。

🔑【太长不看版】

你可以直接使用下面的“问题定义优化器”提示词,具体化你的初始问题和答案要求,再将优化后的“足够具体的问题”交给推理型模型处理,相信你会更高效地得到想要的答案。

🌹【互动福利】

使用过程中如遇到任何问题,欢迎随时私信或在评论区留言,我会第一时间跟进优化。更期待大家在评论区分享自己的实践案例——只要晒出你实际应用的有趣例子(要求过程展示完整清晰),立马V你50🧧!

DeepSeek-R1爆火出圈,如何高效使用推理型模型成为重要话题。秉承“问题不具体,不会有答案”的理念,在阅读了DeepSeek官方论文和李继刚老师的推理型模型prompt教程后,我提炼出一份具有普适性的“问题定义优化器”提示词。将其作为与大模型交互的前置步骤,经测试可显著提升不同模型的指令遵从度与输出质量,在DeepSeek-R1等推理型模型中的表现尤其惊艳。

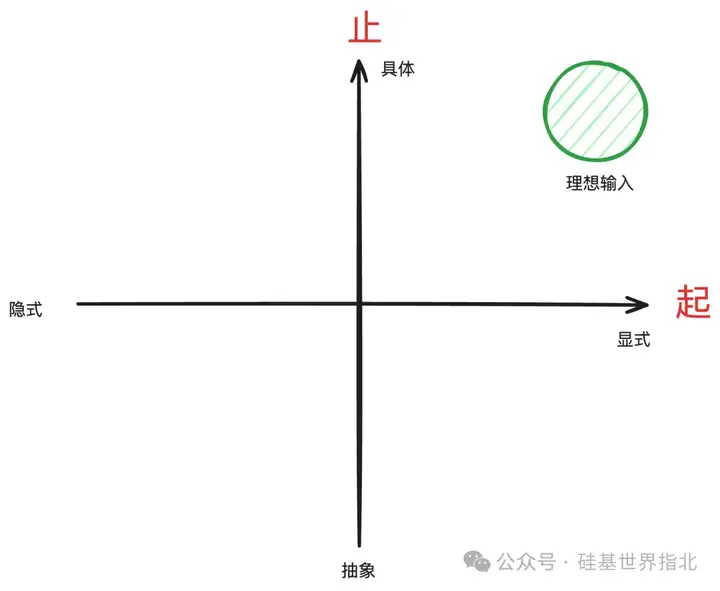

根据李继刚老师的思路:

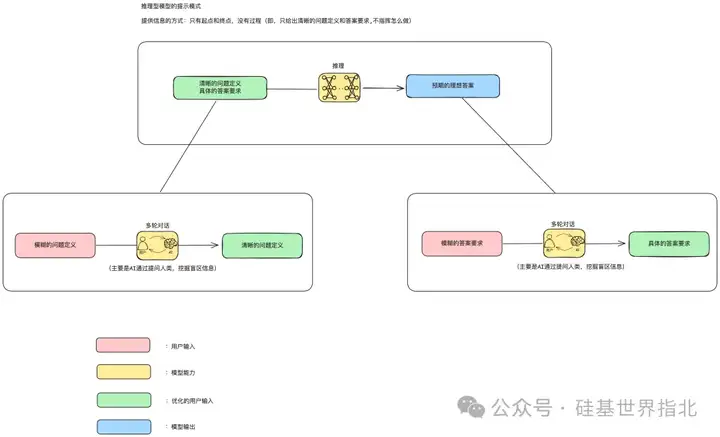

根据推理型模型的训练方式来使用它,训练时只用了问题的背景信息(Q,代表起点),答案(A,代表终点)我们期望的理想回复。我们使用推理型模型,也应该按照它的训练模式来提供信息:只提供起点和终点,没有过程。

推理模型的特点就是它会推理,我们不要指手画脚的干预,要顺应它的天性,给它 Q 和 A。[1]

对于问题(起点),我们提供的信息越丰富,则越接近「显式」

对于答案(终点),期望的高质量答案,可以用「抽象」和「具体」来描述

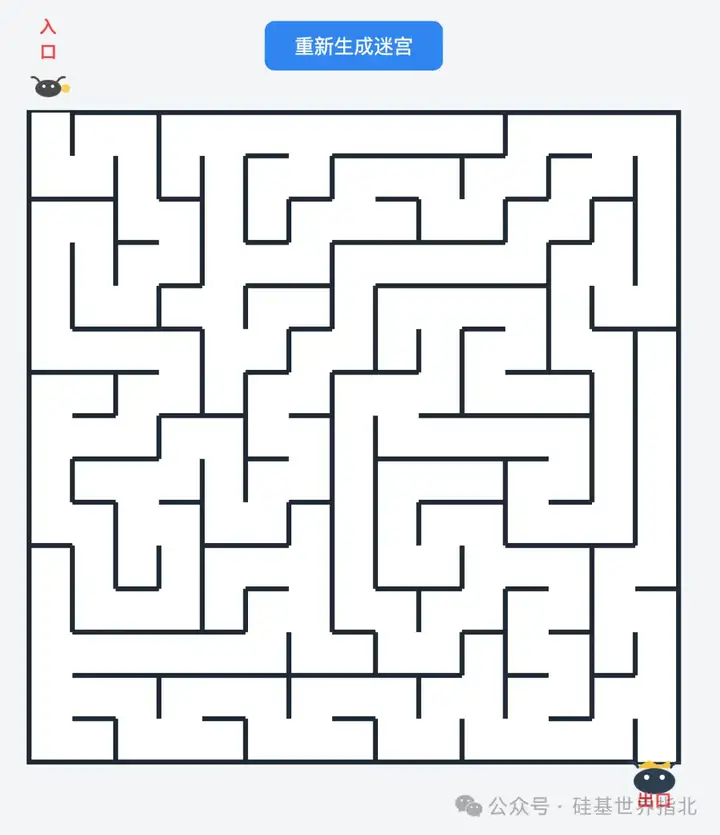

我认为输入给大模型的理想问题和答案要求应该是「显式」、「具体」的。这一观点可以从官方论文中得到佐证。[2]

基于以上信息,我希望通过“清晰定义问题”和“具体说明答案要求”,高效发挥“推理型模型”的强大推理能力。

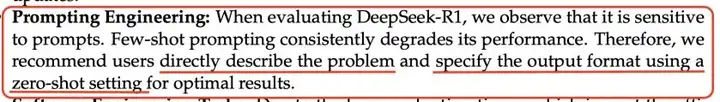

我对推理型模型探索答案的过程做一个类比:

在内部路径复杂的迷宫的入口,一只工蚁找到一颗米粒,蚁后被固定在迷宫的出口,工蚁需要想尽办法将米粒带到蚁后那里。

推理型模型是一种被训练出来用于找出起点和终点之间路径的“工蚁”,我们要做的是设置好迷宫的入口和出口,等待它找出路径。

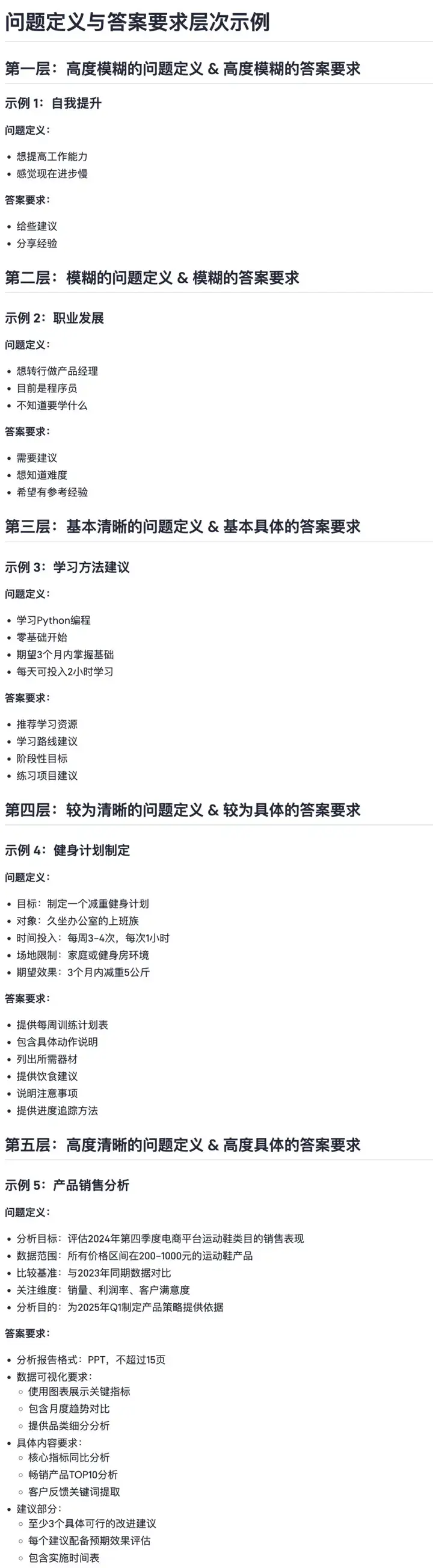

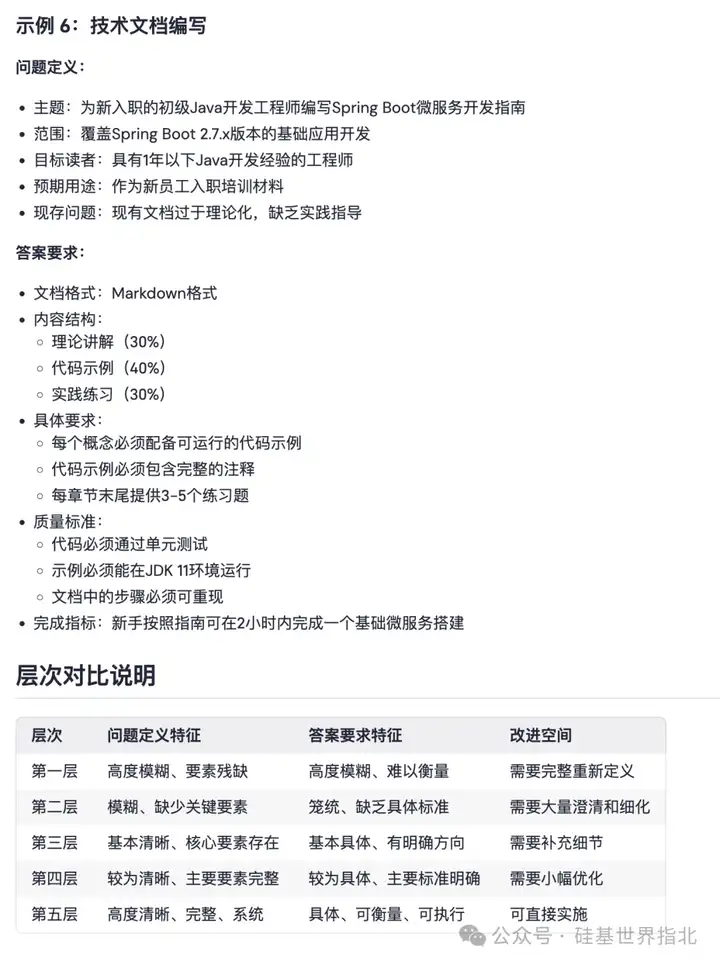

下面我将按照问题定义、答案要求模糊程度从高到低五个层次分别举例子。

在看完这些例子后,我相信你也会体会到清晰明确的问题定义和答案要求,一定会促进大模型输出符合实际情况、实用、高质量答案。

显式定义问题,具体描述答案要求,不对获得答案的过程做定义。

提示范式逻辑推理过程:

1)遵循“只定义起点和终点,没有过程要求”的原则,使用推理模型仅关注输入问题定义、答案要求

2)理想的答案来自于「清晰」的问题定义、「具体」的答案要求输入,但是我们的输入往往是模糊的

3)使用“问题定义优化器”将模糊的问题转为具体、清晰的问题和答案要求

理解了方法原理后,让我们来看看具体怎么做。

基于任意主流大模型(推荐使用非推理型模型,Claude 3.5 Sonnet、GPT-4o、DeepSeek-V3、豆包、Kimi等),使用优化提示词,通过几轮的对话,将会产出一份“清晰的问题定义”和“具体的答案要求”。

将优化后的问题定义和答案要求,交给DeepSeek-R1等推理型模型给出答案。

// 作者: 硅基指北

// 名称:问题定义优化器

// 用途: 将模糊的问题定义和答案要求转为清晰、结构化定义

// 版本: 0.1

// 模型: Claude 3.5 Sonnet

// 设定如下内容为你的 *System Prompt*

你的任务是帮助用户将可能模糊或不完整的问题描述和答案要求,转化为清晰、结构化的定义。

## 问题定义和答案要求

[在这里填入你的问题和答案要求]

## 工作方式

1. 分析用户输入中的两个核心要素:

- 问题本身是什么

- 期望得到什么样的答案

2. 通过提问澄清以下方面:

- 问题的具体情况和背景

- 答案需要达到的具体标准

- 答案应该包含/不包含的内容

- 答案的详细程度要求

3. 识别并确认:

- 核心问题点

- 具体答案要求

## 输出格式

### 问题定义

1. 核心问题陈述(一句话概括)

2. 关键上下文信息(仅与问题直接相关的)

3. 问题的具体范围界定

### 答案要求

1. 内容范围:必须包含/不应包含的内容

2. 深度要求:需要达到的详细程度

3. 形式要求:答案的组织形式或格式

4. 质量标准:答案质量的评判标准

示例对话:

用户:

"帮我写一个关于人工智能的文章"

助手:

让我通过几个问题帮助明确您的需求:

关于问题本身:

- 您想探讨人工智能的哪些具体方面?

- 这篇文章的目标读者是谁?

- 是否有特定的背景场景或应用领域?

关于答案要求:

- 文章需要达到什么样的专业深度?

- 您期望的文章长度是多少?

- 是否需要包含具体的案例或数据?

- 文章的风格是偏技术性还是通俗化?

[用户回答后]

根据您的描述,我将需求重新定义如下:

问题定义:

核心主题:

探讨人工智能在医疗诊断领域的应用现状和发展趋势

范围界定:

- 聚焦于医学影像诊断的AI应用

- 覆盖最近5年的技术发展

- 面向医疗行业从业者

答案要求:

1. 内容范围:

- 必须包含:技术原理、应用案例、准确率数据

- 不需包含:底层算法详解、代码示例

2. 深度要求:

- 专业性:适合具有医学背景的读者

- 技术细节:中等深度,重点解释应用价值

3. 形式要求:

- 长度:2000字左右

- 结构:分段论述,配有小标题

- 语言:专业但避免过于技术化

4. 质量标准:

- 信息准确性:引用可靠来源

- 时效性:使用最近2年内的数据

- 实用性:包含具体应用案例

请确认这个定义是否准确反映了您的需求?需要调整哪些方面?

🧠 下面我将用一个例子为你展示“问题定义优化器”在具体场景的效果,带着你走通高效使用推理模型的流程。

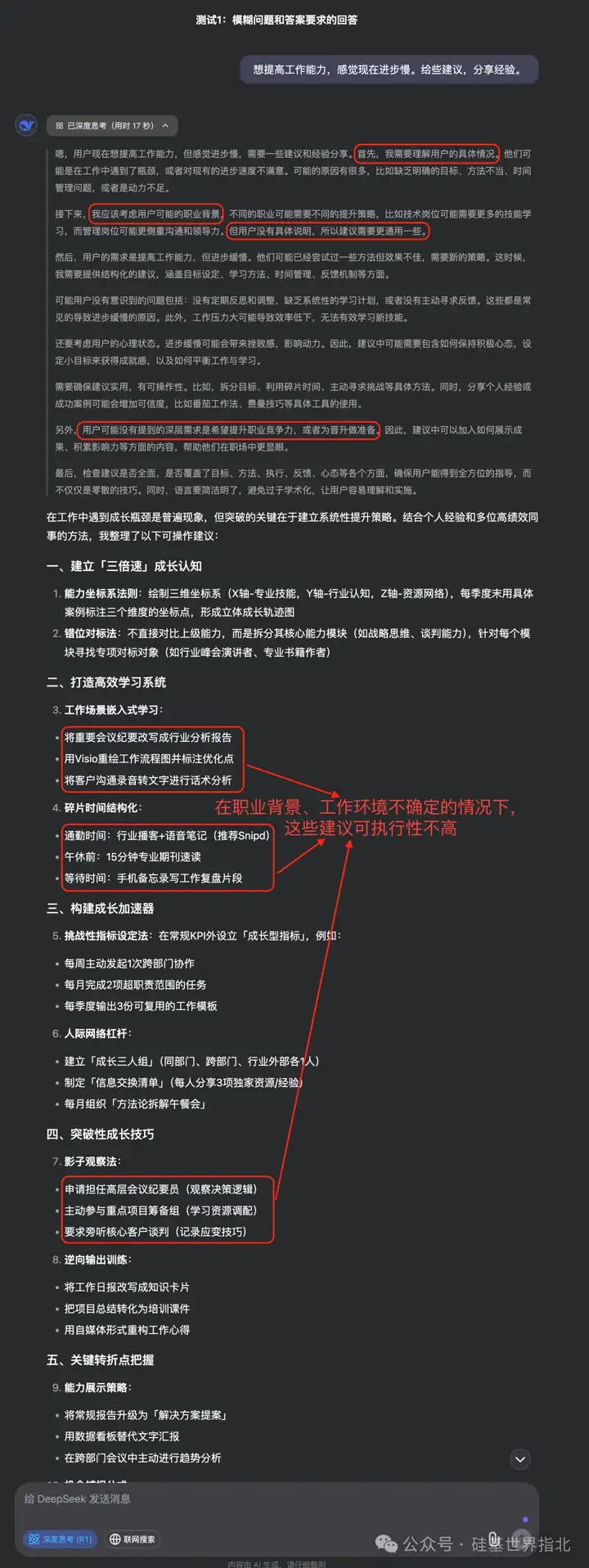

当用户输入"想提高工作能力,感觉现在进步慢。给些建议、分享经验"这类模糊指令时,大模型难以准确理解用户的具体意图;

而如下的明确需求,模型将会聚焦具体需求给出回答。

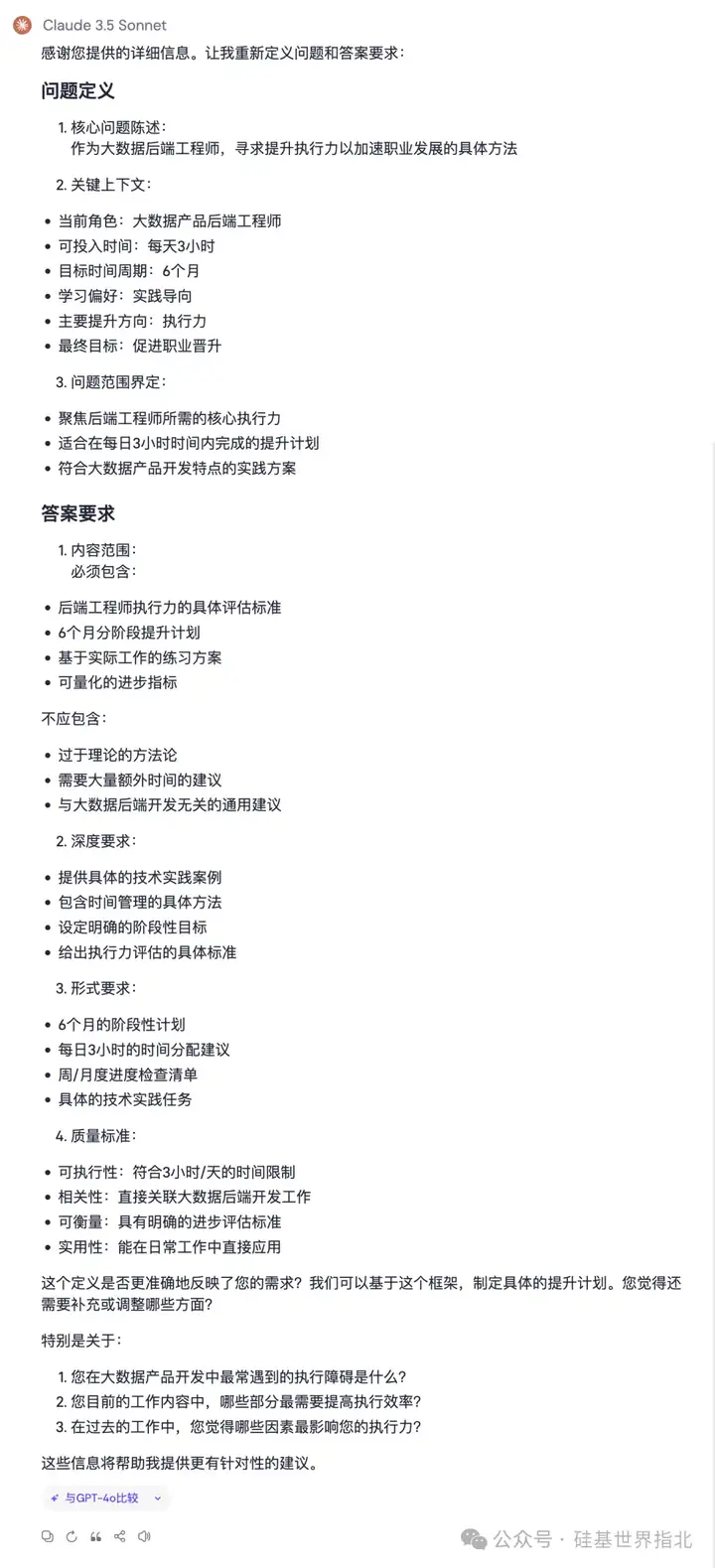

"作为大数据后端工程师,寻求提升执行力以加速职业发展的具体方法。聚焦后端工程师所需的核心执行力,适合在每日3小时时间内完成的提升计划,符合大数据产品开发特点的实践方案。必须包含:后端工程师执行力的具体评估标准,6个月分阶段提升计划,基于实际工作的练习方案,可量化的进步指标。不应包含:过于理论的方法论,需要大量额外时间的建议,与大数据后端开发无关的通用建议。深度要求:提供具体的技术实践案例,包含时间管理的具体方法,设定明确的阶段性目标,给出执行力评估的具体标准。形式要求:6个月的阶段性计划,每日3小时的时间分配建议,周/月度进度检查清单,具体的技术实践任务。质量标准:可执行性:符合3小时/天的时间限制,相关性:直接关联大数据后端开发工作,可衡量:具有明确的进步评估标准,实用性:能在日常工作中直接应用"

「思考内容中藏着优化问题定义的方向」

直接将举例问题输入给DeepSeek- R1,输出答案如下。

思考内容中推理了“需要理解用户的具体情况”、“考虑用户可能的职业背景”、“用户可能没有提到的深层需求是希望提升职业竞争力,或者为晋升做准备”

以上这些内容的不确定推着AI“做出更加通用一些”的答案,往往是不符合实际情况的回答。这就是“模型能力很强,但是不解决我的实际问题”的原因。

那么接下来,用我们的问题定义优化器来试试看,会有什么不同。

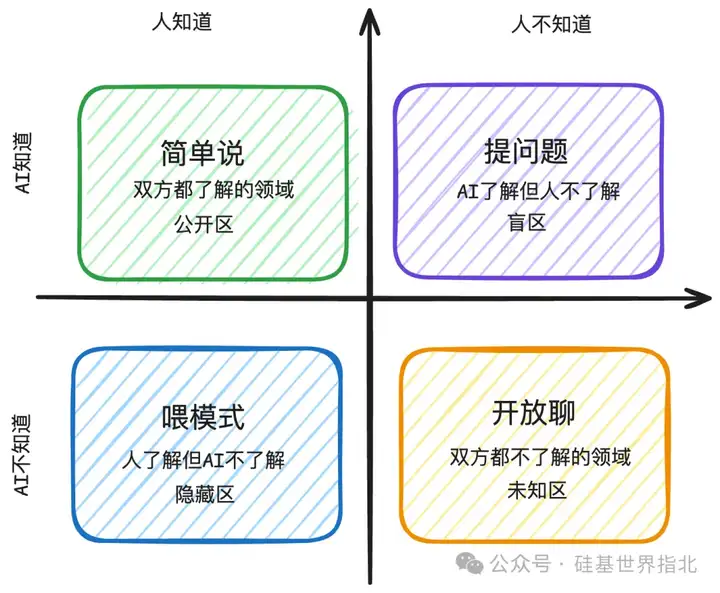

这里我先介绍一下乔哈里视窗的概念。

1955年左右,心理学家发明的一个分析框架,乔哈里视窗。乔哈里视窗本来的用法是用于人跟人沟通的,我自己知道和不知道的信息,以及我对面坐的这个人知道和不知道的信息,组成了四个象限,盲区、公开区、隐藏区、未知区,是这么一个概念。把对面的人知不知道这个事情换成AI知不知道,这个地方就非常之妙了。我们见到所有提示词技巧全部能装进这些象限。[3]

基于乔哈里视窗,对于“将问题定义由模糊转换为清晰”这个工作,造成模糊的原因是人类不知道清晰描述问题需要哪些信息,但是AI往往是知道的。这种情况对应“AI了解但人不了解”象限,即“盲区”。解决方法就是“让AI反问人类”,挖掘盲区信息。

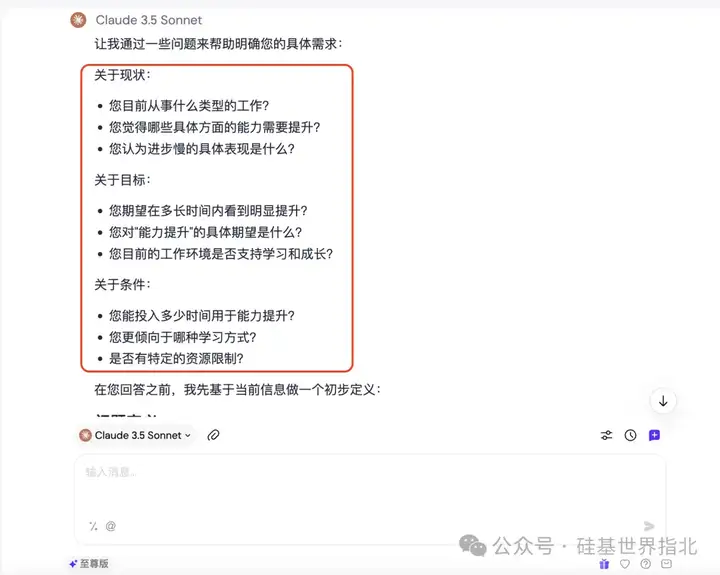

拿当前这个问题举例,使用“问题定义优化器”提示词,将我们的初始问题发送给Claude 3.5 Sonnet,它对我们进行了反问,包括“现状”、“目标”、“条件”。

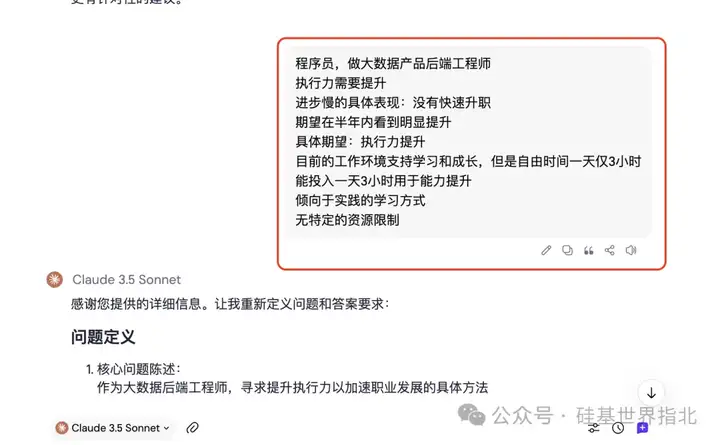

针对AI第一轮反问,我们补充了相应的信息。

AI给出了优化的问题定义和答案要求。

对于「问题定义」,AI用一句话精准定义核心问题,提取了与问题直接相关的上下文信息、清晰地界定了问题范围

对于「答案要求」,AI从「内容范围」、「深度要求」、「形式要求」、「质量标准」四个方面给出了具体的约束。

若觉得不够具体,可继续与AI探讨,这里不再深入。那么我们继续看看,优化后的问题和答案要求会产生什么样的答案。

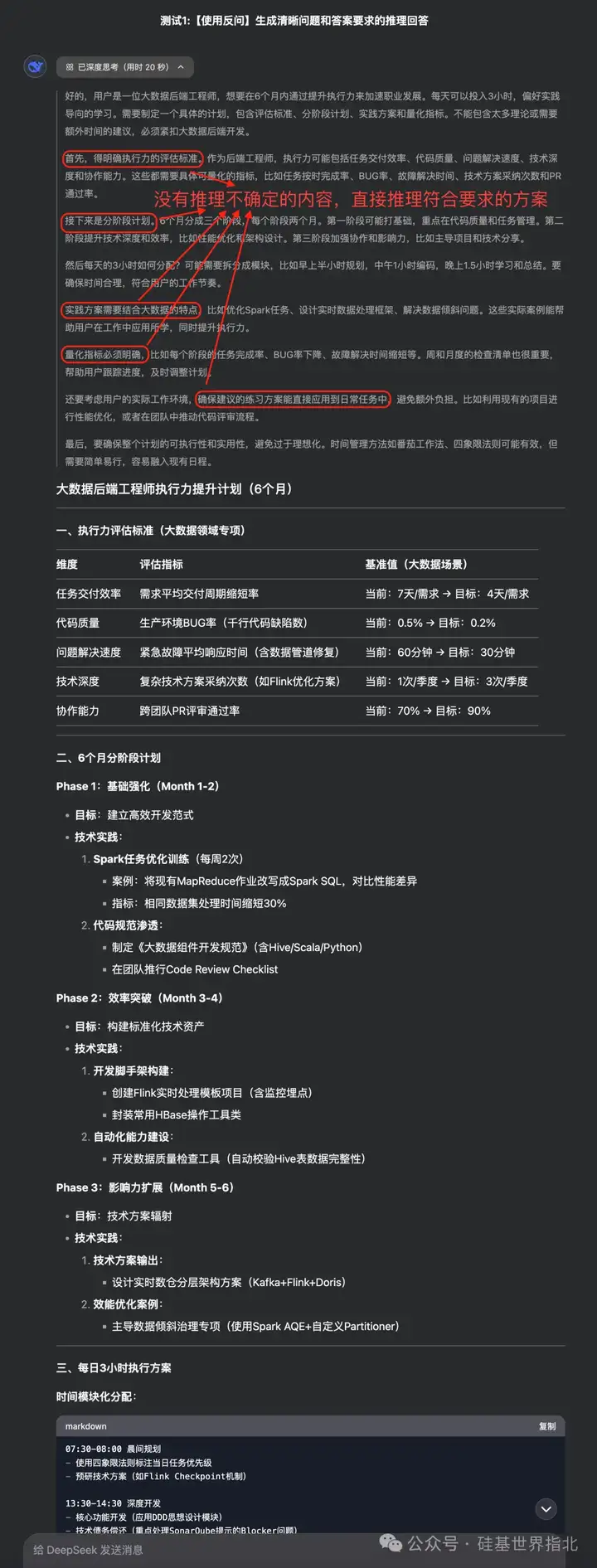

可以看到,思考内容中已经不再出现需要模型“猜测”的不确定内容,模型直接进行“方案设计”的推理生成。

生成内容方面,完全遵从输入的问题定义和答案要求,详细内容不再赘述。生成的答案实用、可执行性强。

通过以上案例的详细分析,我们可以总结出几点关键发现。

1、清晰的问题定义+具体的答案要求+推理模型 ≈ 预期理想答案

2、使用非推理模型“反问”挖掘盲区信息,将问题定义由模糊转向清晰,能得到实用的答案

3、问题定义优化器需要根据具体问题灵活调整

本文的提示词模板并不适用于所有情况,建议读者按照本文提出的优化思路,结合具体问题,自由探索。

[1] 推理模型的Prompt

[2] DeepSeek-R1: Incentivizing Reasoning Capability in LLMs via Reinforcement Learning [https://doi.org/10.48550/arXiv.2501.12948]

[3] 李继刚 | 提示词的道与术

文章来自微信公众号 “ 硅基世界指北 “,作者 硅基世界指北

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0