世界模型(World Model)作为近年来机器学习和强化学习的研究热点,通过建立智能体对其所处环境的一种内部表征和模拟,能够加强智能体对于世界的理解,进

而更好地进行规划和决策。在强化学习领域中,世界模型通常被建模为一个神经网络,通过历史状态和动作,预测未来可能出现的状态。其中,Dreamer 算法在多

种模拟环境的成功表现让我们看到了世界模型优秀的表征和泛化能力。如果将世界模型应用于复杂真实场景,是否能够实现更好的控制决策呢?

对此,ByteDance Research 研究团队与上海交通大学合作,成功将世界模型应用于四足机器人视觉控制领域,提出了基于世界模型的感知算法 WMP(World

Model-based Perception),WMP 通过在模拟器中学习世界模型和策略,其中世界模型通过历史感知信息(包括视觉感知和本体感知)预测未来的感知,策略以世

界模型提取的特征作为输入,输出具体控制动作。

WMP 将模拟器中训练的世界模型和策略 Zero-Shot 迁移到宇树 A1 机器人进行验证,在多种环境下取得了出色的成绩,达到了目前为止 A1 机器人 SOTA 的通过性

能。同时,使用模拟数据训练的世界模型可以准确预测真实轨迹,展示出卓越的泛化性能,有望成为一种机器人控制的新范式。

研究背景

近年来,强化学习 (RL) 通过在物理模拟器中训练策略,然后将其转移到现实世界(Sim-to-Real transfer),在足式机器人的运动控制领域被广泛应用。在足式机器

人的运动控制中,视觉图像信息对于诸如越障等复杂环境是不可或缺的。

凭借强化学习的奖励信号从长序列、高维的视觉信息中学习策略难度极大。为了更好地引入视觉信息,传统特权学习(privileged learning)框架首先学习一个教师策

略,教师策略的输入包含只能在模拟器中得到的特权信息,如高度图扫标点(heightmap scandots),各类障碍物的几何参数等。之后再学习一个以深度图序列为输

入的学生策略以模仿教师策略的动作。

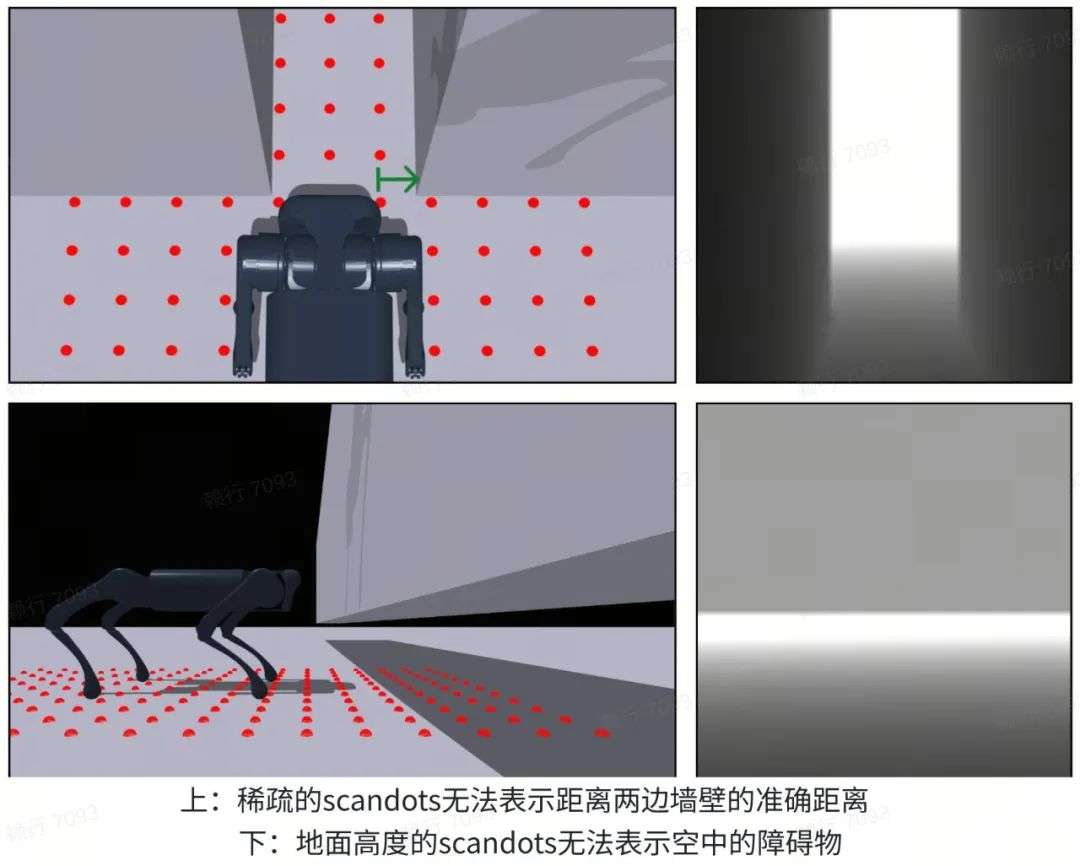

由于特权学习两阶段的训练模式,学生策略的性能往往落后于教师策略;并且特权信息的选择需要人工设计,较为繁琐,同时易受到具体环境的限制。如下图所示,

使用 scandots 作为特权信息无法处理需要精确距离的环境以及存在空中障碍物的环境。

相比之下,动物能够在没有特权信息的情况下仅凭借视觉感官信息通过各种非结构化的地形,并且在不熟悉的环境中依然能够做出合理的决策。认知科学的一种解释

是动物会利用脑中建立的心智模型(mental model)对外部环境进行理解和预测以便更好地理解和应对周围的环境,从而做出合理的动作和决策。

ByteDance Research 的机器人研究团队在此启发下设计了一种更加通用的机器人控制框架 WMP(World Model-based Perception)。WMP 通过构建世界模型来处

理复杂的感知信息,并将世界模型提取的环境信息输入给策略,解决了特权学习中特权信息难以设计的局限性。通过训练的世界模型和策略可以直接迁移到真实环境

的 A1 机器人上,在多种复杂任务中达到了目前该领域的领先水平效果。例如,在世界模型的帮助下,A1 机器人可以跳过 85cm 的间隙,跳上 55cm 的高台,穿过

22cm 高的桥洞。这些结果证明了世界模型对于决策的正向作用,为之后世界模型在机器人等领域的研究提供了重要参考。

方法

WMP 采用经典的 RSSM 框架作为世界模型的结构,RSSM 包括编码模块 encoder,解码模块 decoder,以及循环模块 recurrent model。encoder 将感知信息以及

循环状态编码为一个随机变量,decoder 通过循环状态和随机变量恢复出原始的感知信息,而循环模块则通过循环状态、随机变量以及动作序列预测下一个循环状

态。为了满足真机运行的算力要求,WMP 将世界模型的运行频率设定为策略运行频率的 k 分之一。由于世界模型主要处理更高层级的信息,较低的控制频率同样能

满足底层控制的需求,这与人体大脑和小脑展现出的不同的控制频率情况有一定的相似之处。

一个训练有素的世界模型的循环状态包含足够多的信息从而预测未来的时间步,也有助于策略执行动作。因此在 WMP 框架中,策略会接受来自世界模型的循环状态

作为输入。并使用强化学习算法 PPO 进行训练。此外,策略的训练和世界模型的训练使用模拟数据同步进行,简化了特权学习中的两阶段训练。训练后的策略和世

界模型可以无需微调直接迁移到真实机器人设备。

实验结果

模拟实验:

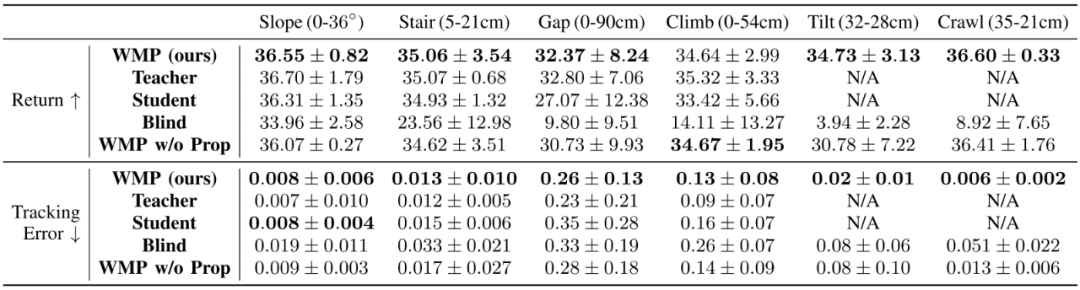

WMP 算法使用 Issacgym 模拟器构建的 6 种地形上进行训练:Slope、Stair、Gap、Climb、Crawl、Tilt。由于 scandot 特权信息的局限性,使用特权学习训练的

Student baseline 只使用前四个地形进行训练。在模拟器的定量对比实验中,WMP 在绝大多数任务中获得了比 Baseline 更高的回报奖励以及更小的速度追踪误差。

真机实验:

在真机实验中,WMP 继承了模拟器中的优秀表现,相比 baseline 能以更高的成功率通过更难的地形,并且在室内和室外环境中表现保持一致,进一步展现出世界模

型优秀的泛化能力。

一镜到底视频:

验证实验:

使用模拟数据训练需要考虑的一个问题是世界模型对真实轨迹预测的准确性如何。验证实验表明,世界模型对于真实轨迹的图像能给出准确的预测,尤其是对于关键

的部分。例如,世界模型对桥洞障碍物整体形状的预测存在偏差,但对机器人需通过的窄缝的位置角度的预测十分准确。这验证了世界模型有利于解构和提取不同域

中的关键要素,从而有助于模拟到真实的泛化。

总结

本研究提出了一种新的运动控制框架,通过构筑的世界模型来处理视觉信息和辅助决策,在四足机器人运动控制领域取得了不错的效果。WMP 揭示了世界模型在

Sim2Real 以及机器人控制领域的巨大潜力,为之后世界模型在现实世界更广泛的应用提供了样例和宝贵的经验。

参考文献:

1. Ha, David, and Jürgen Schmidhuber. "World models." arXiv preprint arXiv:1803.10122 (2018).

2. Hafner, Danijar, et al. "Learning latent dynamics for planning from pixels." International conference on machine learning. PMLR, 2019.

3. Hafner, Danijar, et al. "Learning latent dynamics for planning from pixels." International conference on machine learning. PMLR, 2019.

4. Hafner, Danijar, et al. "Mastering atari with discrete world models." arXiv preprint arXiv:2010.02193 (2020).

5. Hafner, Danijar, et al. "Mastering diverse domains through world models." arXiv preprint arXiv:2301.04104 (2023).

6. Lee, Joonho, et al. "Learning quadrupedal locomotion over challenging terrain." Science robotics 5.47 (2020): eabc5986.

7. Miki, Takahiro, et al. "Learning robust perceptive locomotion for quadrupedal robots in the wild." Science robotics 7.62 (2022): eabk2822.

8. Agarwal, Ananye, et al. "Legged locomotion in challenging terrains using egocentric vision." Conference on robot learning. PMLR, 2023.

9. Wu, Philipp, et al. "Daydreamer: World models for physical robot learning." Conference on robot learning. PMLR, 2023.

10. Zhuang, Ziwen, et al. "Robot parkour learning." arXiv preprint arXiv:2309.05665 (2023).

11. Cheng, Xuxin, et al. "Extreme parkour with legged robots." 2024 IEEE International Conference on Robotics and Automation (ICRA). IEEE, 2024.

文章来自于 微信公众号“机器之心”,作者 :机器之心编辑部

【开源免费】Browser-use 是一个用户AI代理直接可以控制浏览器的工具。它能够让AI 自动执行浏览器中的各种任务,如比较价格、添加购物车、回复各种社交媒体等。

项目地址:https://github.com/browser-use/browser-use

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner