只要极少量的标注样本,就能让模型精准分割3D场景?

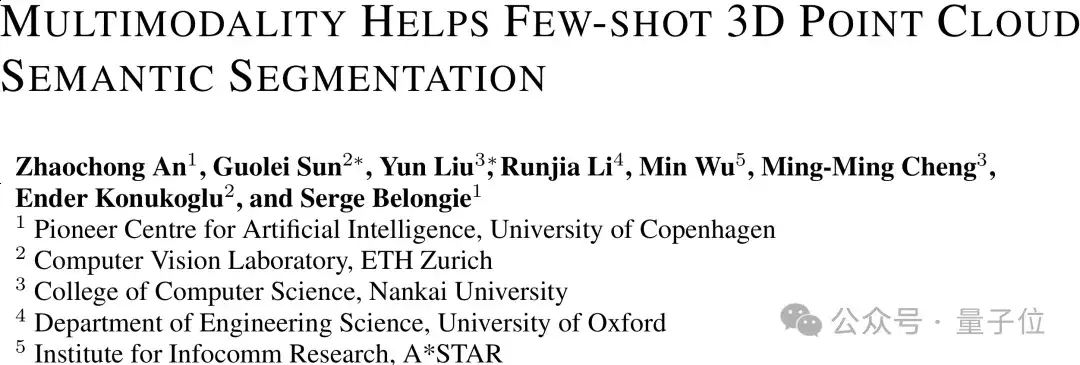

来自哥本哈根大学、苏黎世联邦理工学院等机构的研究人员,提出了一个全新的多模态Few-shot 3D分割设定和创新方法。

无需额外标注成本,该方法就可以融合文本、2D和3D信息,让模型迅速掌握新类别。

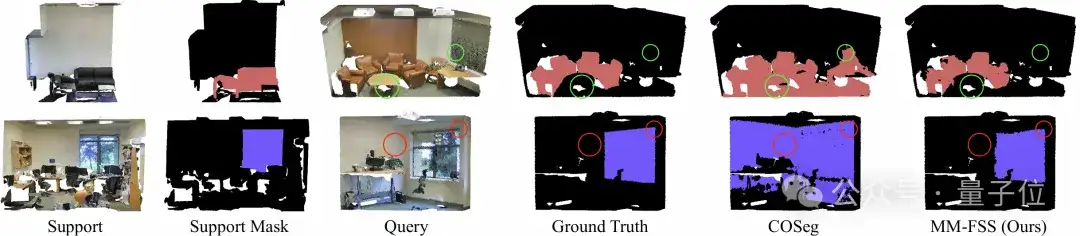

△3D Few-shot分割结果示例

人形机器人、VR/AR,以及自动驾驶汽车,都依赖于对3D场景的精确理解。

然而,这种精准的3D理解往往需要大量详细标注的3D数据,极大推高了时间成本和资源消耗。

Few-shot学习是一种有效的解决思路,但当前研究都局限于单模态点云数据,忽略了多模态信息的潜在价值。

对此,这项新研究填补了这一空白,文章已被ICLR 2025接收为Spotlight论文。

3D场景理解在具身智能、VR/AR等领域至关重要,帮助设备准确感知和解读三维世界。

然而,传统全监督模型虽在特定类别上表现出色,但其能力局限于预定义类别。

每当需要识别新类别时,必须重新收集并标注大量3D数据以及重新训练模型,这一过程既耗时又昂贵,极大地制约了模型的应用广度。

3D Few-shot学习旨在利用极少量的示例样本以适应模型来有效的识别任意的全新类别,大大降低了新类适应的开销,使得传统的3D场景理解模型不再局限于训练集中有限的类别标签,对广泛的应用场景有重要的价值。

具体而言,对于Few-shot 3D点云语义分割(FS-PCS)任务,模型的输入包括少量支持样本(包含点云及对应新类标签)和查询点云。

模型需要通过利用支持样本获得关于新类别的知识并应用于分割查询点云,预测出查询点云中关于新类别的标签。

在模型训练和测试时使用的目标类别无重合,以保证测试时使用的类均为新类,未被模型在训练时见过。

目前,该领域涌现出的工作都只利用点云单模态的输入,忽略了利用多模态信息的潜在的益处。

对此,这篇文章提出一个全新的多模态Few-shot 3D分割设定,利用了文本和2D模态且没有引入额外的标注开销。

在这一设定下,他们推出了创新模型——MultiModal Few-Shot SegNet (MM-FSS)。

该模型通过充分整合多模态信息,有效提升小样本上新类别的学习与泛化能力,证明了利用普遍被忽略的多模态信息对于实现更好的小样本新类泛化的重要性。

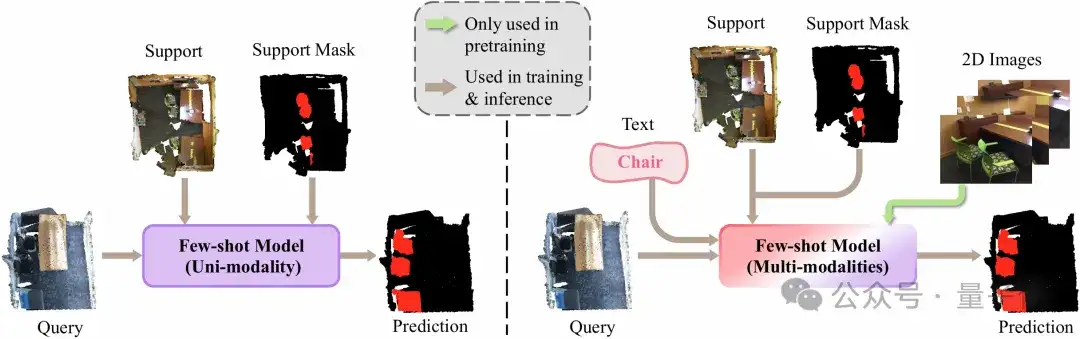

△传统和多模态FS-PCS设定对比

(为便于讨论,以下都将Few-shot 3D点云语义分割简称为FS-PCS。)

传统的FS-PCS任务中,模型的输入包含少量的支持点云以及对应的新类别的标注(support point cloud & support mask)。

此外,输入还包括查询点云(query point cloud)。模型需借助support样本中关于新类别的知识,在query点云中完成新类别分割。

而作者引入的多模态FS-PCS包括了除3D点云之外的两个额外模态——文本和2D。

文本模态相应于支持样本中的目标类别/新类的名称。2D模态相应于2D图片,往往伴随3D场景采集同步获得。

值得注意的是,2D模态仅用于模型预训练,不要求在meta-learning和测试时作为输入,保证了其Few-shot输入形式与传统FS-PCS对齐,仅需要相同的数据且无需额外标注。

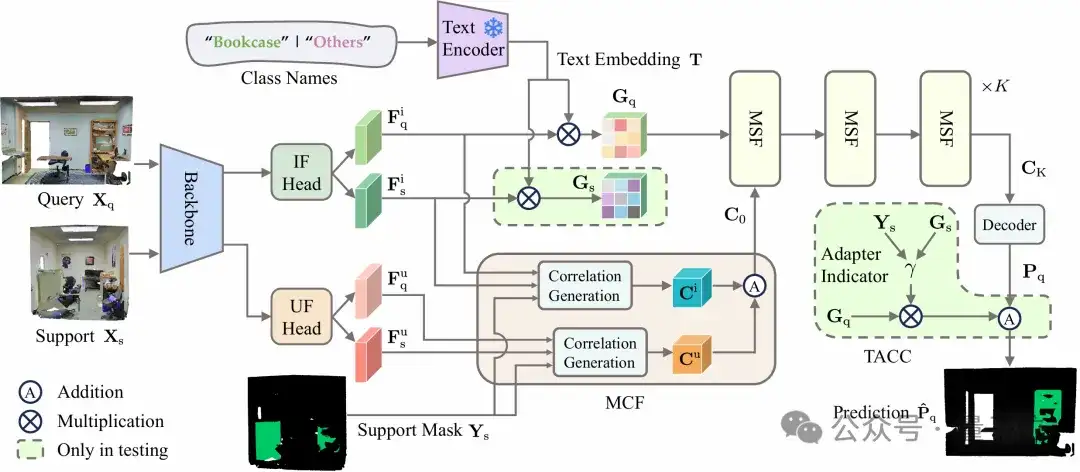

MM-FSS在Backbone后引入了两个特征提取分支:

△MM-FSS模型架构

在预训练阶段,MM-FSS先进行跨模态对齐预训练,通过利用3D点云和2D图片数据对,使用2D视觉-语言模型(VLM)输出的2D特征监督IF head输出的3D特征,使得IF Head学习到与2D视觉-语言模型对齐的3D特征。

这一阶段完成后,Backbone和IF Head保持冻结,确保模型在Few-shot学习时能利用其预训练学到的Intermodal特征。这样,在Few-shot任务中无需额外的2D输入,仅依赖Intermodal特征即可获益于多模态信息。

此外,该特征也隐式对齐了VLM的文本特征,为后续阶段利用重要的文本引导奠定基础。

而在Few-shot训练(称为meta-learning)时,给定输入的support和query点云,MM-FSS分别将IF Head和UF Head输出的两套特征计算出对应的两套correlations(correlations表示每个query点和目标类别prototypes之间的特征相似度)。

两套correlations会通过Multimodal Correlation Fusion (MCF)进行融合,生成初始多模态correlations,包含了2D和3D的视觉信息。

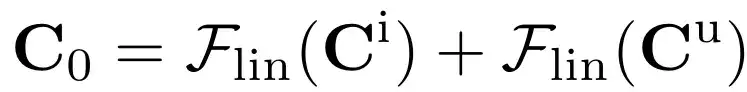

这个过程可以表示为:

其中Ci和Cu分别表示用IF Head和UF Head特征算得的correlations。C0为MCF输出的初始多模态correlations。

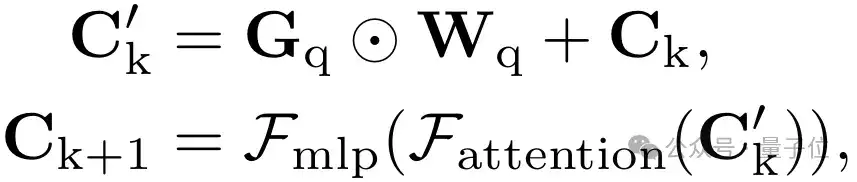

当前获得的多模态correlations融合了不同的视觉信息源,但文本模态中的语义信息尚未被利用,因此设计了Multimodal Semantic Fusion (MSF)模块,进一步利用文本模态特征作为语义引导,提升多模态correlations:

其中Gq为文本模态的语义引导,Wq为文本和视觉模态间的权重(会动态变化以考虑不同模态间变化的相对重要性),Ck为多模态correlations。

到测试阶段,为缓解Few-shot模型对于训练类别的training bias(易被测试场景中存在的训练类别干扰,影响新类分割),MM-FSS在测试时引入Test-time Adaptive Cross-modal Calibration (TACC) 。

TAAC利用跨模态的语义引导(由IF Head生成)适应性地修正预测结果,实现更好的泛化。

跨模态的语义引导未经meta-learning训练,有更少的training bias。

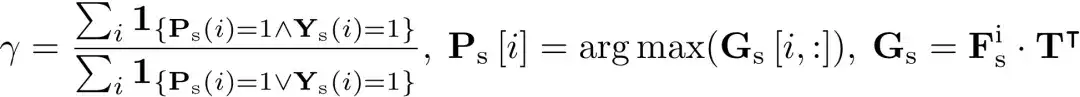

为了有效的执行测试时修正,作者提出基于支持样本及其标签估算可靠性指标,用于自动调整修正程度(当该语义引导可靠性更高时,分配更大的修正权重,否则分配更小的权重):

其中Pq为模型的预测,Gq为跨模态语义引导,γ为适应性指标。

通过借助支持点云以及可用的支持点云标签可以如下计算γ作为修正可靠成都的估计:

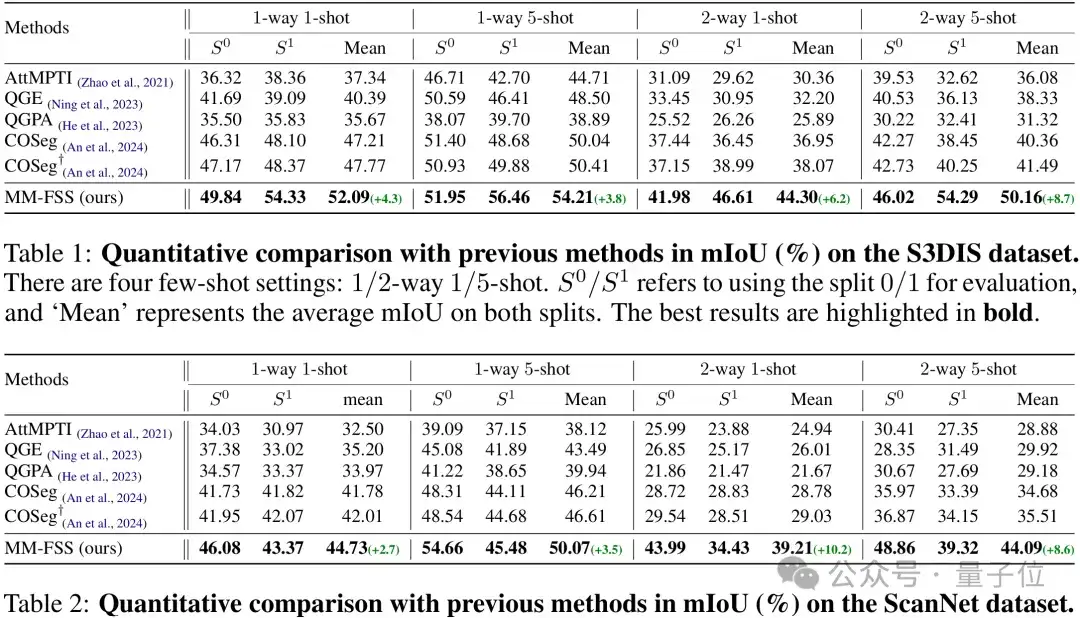

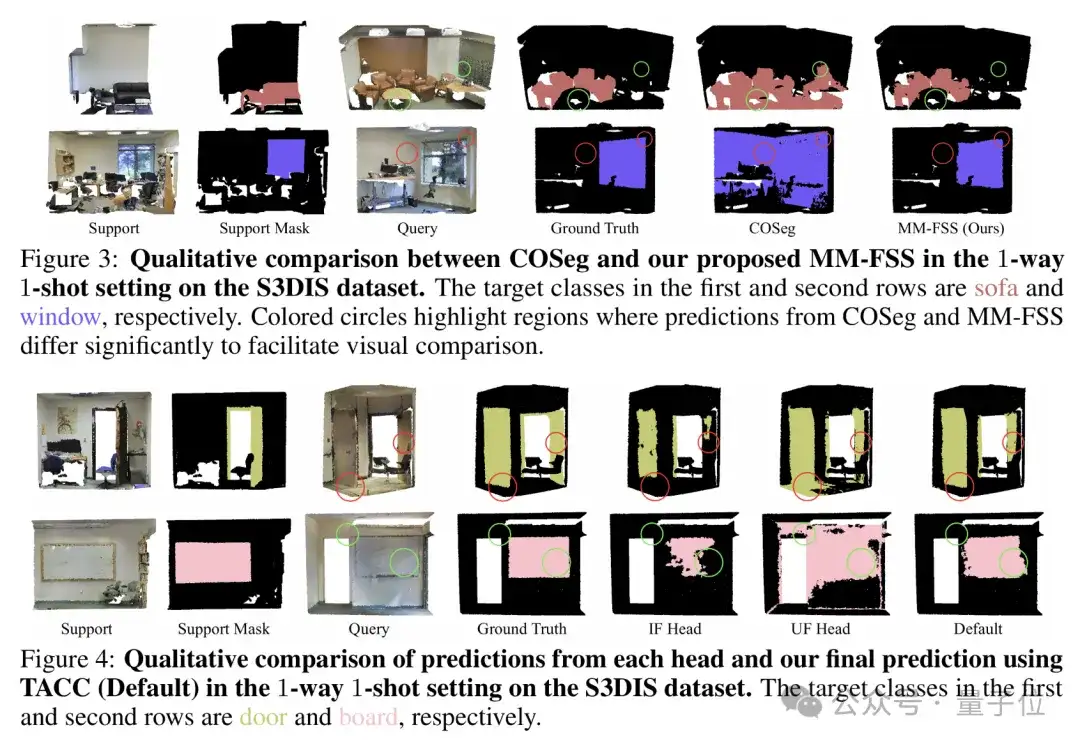

实验在两个标准的FS-PCS数据集上进行,证明了MM-FSS在各类few-shot任务中都实现了最佳性能。

可视化也清楚表明了模型能够实现更优的新类分割,展示了更强的新类泛化能力。更多详细实验和分析内容请参见论文。

总之,这项工作首次提出了全新的多模态FS-PCS设定,无额外开销地融合文本和2D模态。在该设定下,作者提出首个多模态FS-PCS模型MM- FSS。

MM-FSS包含了MCF和MSF来有效的从视觉线索和语义信息双重角度高效聚合多模态知识,增强对新类概念的全面理解。

同时,MM-FSS也揭示了过往被普遍忽略的“免费”多模态信息对于小样本适应的重要性,为未来的研究提供了宝贵的新视野且开放了更多有趣的潜在方向。

可参考的方向包括性能的提升、训练和推理效率的优化,更深入的模态信息利用等。

该文章的第一作者安照崇,目前在哥本哈根大学攻读博士学位,导师为Serge Belongie。

他硕士毕业于苏黎世联邦理工学院(ETH Zurich),在硕士期间跟随导师Luc Van Gool进行了多个研究项目。

他的主要研究方向包括3D/视频理解、小样本学习以及多模态学习。

文章的通讯作者是苏黎世联邦理工的孙国磊博士和南开大学的刘云教授。

欢迎关注论文和代码,了解更多细节!

论文:

https://arxiv.org/abs/2410.22489

代码:

https://github.com/ZhaochongAn/Multimodality-3D-Few-Shot

文章来自微信公众号 “ 量子位 “,作者 小q