前言:本文介绍了一项突破性的AI推理技术创新——思维草图(SoT)框架。该框架从人类认知过程中获取灵感,通过一个200M大小的路由模型将LLM引导到概念链、分块符号化和专家词汇三种推理范式,巧妙地解决了大语言模型推理过程中的效率瓶颈。实验表明,SoT能在保持准确性的同时将令牌使用量减少70-80%。这一创新不仅大幅降低了AI推理的计算成本,更为在移动设备、边缘计算等资源受限场景下的AI应用开辟了新途径。我已将其写成SoT-Agent框架,让其产生更广泛的用途。

近期,尤其是通过"思维链"(Chain of Thought, CoT)提示技术的应用,使模型能够分解复杂问题并逐步推导出答案。但这种能力的提升伴随着一个显著的代价——推理过程中产生的冗长中间输出大幅增加了计算开销。

当模型解决一个简单的数学问题时,它可能会生成数百个令牌来详细解释每一个推理步骤,而这些步骤中的大部分内容对于最终答案的准确性并非必要。这种"思维的冗余"不仅增加了推理的延迟,还显著提高了API调用成本,对于需要大规模部署AI推理能力的企业和开发者来说,这构成了一个不可忽视的效率瓶颈。“过度思考”成为最近很热的研究方向。

传统的优化方法主要集中在减少输入提示的大小或改进模型架构上,却很少关注推理过程本身的效率问题。在资源受限的环境中,如移动设备、边缘计算场景,或者对推理成本特别敏感的应用场景中,这一问题尤为突出。我们需要一种能够在保持推理准确性的同时,显著减少令牌使用量的新方法,而这正是韩国科学技术院(KAIST)研究团队提出的"思维草图"(Sketch-of-Thought, SoT)框架所要解决的核心问题。

"思维草图"(Sketch-of-Thought, SoT)框架的核心理念源自对人类专家解决问题方式的观察和认知科学研究。当一位物理学家解决复杂问题时,他们不会写下完整的句子来解释每一步,而是会记下关键变量、简写方程式,使用领域特定的符号,这些简洁的标记捕捉了推理过程的精髓。

SoT框架的关键创新:

SoT框架的灵活性在于它可以结合任何基于认知科学的自定义推理范式,研究团队实现了三种具体的推理范式,每种范式针对不同类型的推理任务,并通过轻量级路由模型动态选择最适合的推理策略。

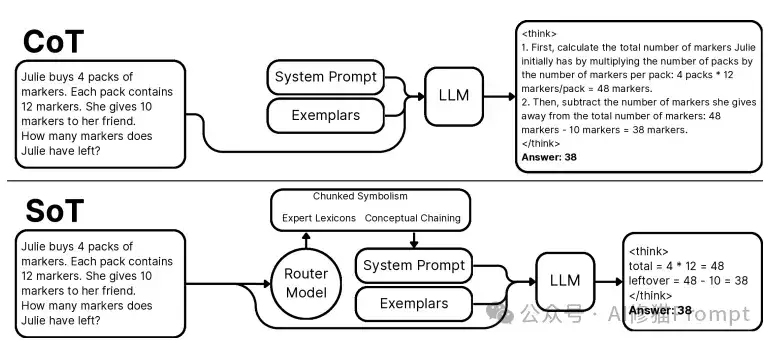

思维链(CoT)和思维草图(SoT)工作流程对比

上图展示了思维链(CoT)和思维草图(SoT)两种方法的工作流程对比。上半部分显示CoT方法,其中模型直接从提示生成冗长的推理步骤;下半部分展示SoT方法,它使用路由模型选择最优的推理范式(分块符号化、专家词汇或概念链),从而生成显著更简洁的中间推理步骤,同时保持准确性。图中通过一个数学问题示例(Julie买了4包记号笔,每包12支,她送给朋友10支,问她还剩多少支?)直观地展示了两种方法的区别:CoT生成详细的推理过程,而SoT生成更为简洁的符号化表达。

概念链(Conceptual Chaining)的理论基础:

核心特点:

例如,当回答"首尔使用的货币名称是什么?"这个问题时:

应用场景:

效果:

分块符号化(Chunked Symbolism)的理论基础:

核心特点:

示例应用:

问题:"一辆汽车以2.5 m/s²的速度加速10秒。如果其初始速度为15 m/s,那么最终速度是多少?"

传统CoT:

让我们一步步解决这个问题:

1. 首先,我们知道初始速度是15 m/s

2. 加速度是2.5 m/s²

3. 时间是10秒

4. 我们可以使用公式:最终速度 = 初始速度 + 加速度 × 时间

5. 代入数值:最终速度 = 15 + 2.5 × 10

6. 计算得到:最终速度 = 15 + 25 = 40 m/s

分块符号化:

a = 2.5 m/s²

t = 10 s

vi = 15 m/s

vf = vi + (a × t)

vf = 15 + (2.5 × 10) = 40 m/s

应用效果:

专家词汇(Expert Lexicons)的理论基础:

核心机制:

示例应用:

问题:"一位STEMI患者接受MONA治疗。他们对阿司匹林过敏。他们使用这种治疗方法是否有风险?"

传统CoT:

让我分析这个医疗情况:

1. STEMI是ST段抬高型心肌梗死的缩写

2. MONA治疗是一个标准治疗方案,包括:

- M: 吗啡(Morphine)

- O: 氧气(Oxygen)

- N: 硝酸盐(Nitrates)

- A: 阿司匹林(Aspirin)

3. 患者对阿司匹林过敏

4. 由于MONA方案包含阿司匹林,这对患者有风险

专家词汇:

STEMI → ST-Elevation MI

MONA → Morphine, O2, Nitrates, Aspirin

∴ Aspirin ∈ MONA + ASA allergy = Risk

应用效果:

优势特点:

核心创新:

技术实现:

PSoT = ROUTER(q) # q为查询,PSoT为选择的推理范式

路由模型特点:

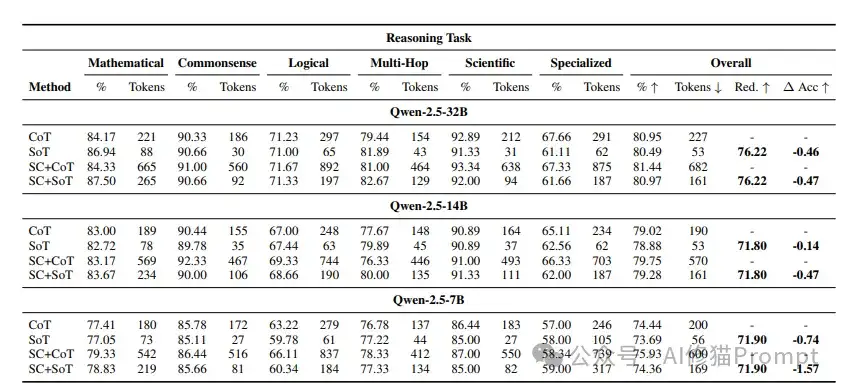

研究团队对SoT框架进行了全面而深入的评估,跨越15个不同类型的推理数据集,涵盖了从数学计算到医学诊断等多个领域。实验结果:在保持准确性的前提下,SoT实现了令人瞩目的效率提升。

升。

在不同规模的模型上,SoT都展现出了卓越的性能。以32B模型为例,框架实现了76.22%的令牌减少,而准确性仅下降了0.46%。这种微小的准确性损失相对于显著的效率提升来说,可以说是微不足道的。类似的效果也在14B和7B模型上得到验证,分别实现了71.80%和71.90%的令牌减少,准确性损失分别仅为0.14%和0.74%。这一结果有力地证明了SoT框架的普适性和稳定性。

在某些特定领域,SoT不仅没有损失准确性,反而带来了性能的提升。在数学推理任务中,32B模型使用SoT后的准确性提升了2.77%,同时还减少了60.18%的令牌使用量。这一反直觉的发现暗示着,简洁的表达方式可能有助于模型更好地把握问题的本质。

多跳推理任务的结果同样引人注目。在这类需要多步推理的复杂任务中,所有规模的模型都实现了准确性的提升(分别为+2.45%、+2.22%和+0.44%),同时令牌使用量减少了67-72%。这表明SoT的简洁表达方式可能帮助模型更好地捕捉关键的推理链接,避免了冗长表达可能带来的注意力分散。

SoT的优势还延伸到了多语言和多模态场景。在韩语、意大利语和德语的测试中,框架分别实现了85.71%、85.12%和85.11%的令牌减少,准确性的变化范围在-2.00%到+1.50%之间。这种跨语言的稳定表现说明,SoT捕捉到的是超越具体语言表达的基本推理模式。在多模态任务中,尽管准确性有3.44%的下降,但81.46%的令牌减少仍然使其成为一个极具吸引力的选择。

SoT框架的实际应用价值远超出实验室环境。在当今AI技术快速发展但计算资源仍然宝贵的背景下,SoT为我们提供了一个兼顾效率与效果的解决方案。

在资源受限的场景中,SoT的优势尤为明显。假如一个移动设备上运行的AI应用,或是边缘计算环境中的推理系统,计算资源和能耗都是关键的限制因素。在这些场景下,SoT的高效推理方式使得复杂的AI能力成为可能。例如,一个教育应用可以在普通平板电脑上提供高质量的数学问题解答,或是一个医疗辅助系统能够在边缘设备上进行快速的初步诊断。

对于需要大规模部署AI服务的企业来说,SoT带来的成本节省更是显著。以一个处理数百万日常查询的客服系统为例,使用SoT可以将API调用成本降低70-80%。这种规模的成本节省不仅能够直接改善企业的运营效率,还能让更多中小企业有机会采用先进的AI技术。

在教育领域,SoT的应用前景同样广阔。传统的AI辅导系统往往受限于计算资源,难以在普通教室环境中部署。而采用SoT框架的系统能够在普通硬件上提供个性化的学习指导,让每个学生都能享受到AI辅助教育的好处。

医疗保健领域是SoT专家词汇范式的一个理想应用场景。在这个领域,专业术语和标准化表达本就是医疗工作者的日常语言。SoT的专家词汇范式完美契合了这一特点,能够高效处理复杂的医学推理任务,为临床决策提供及时的支持。

需要注意的是,SoT还展现出与其他推理增强技术良好的协同效果。例如,当与自一致性(Self-Consistency)技术结合时,系统能够在保持高准确性的同时,显著减少令牌使用量。这种灵活性和可组合性,为SoT在更广泛的应用场景中的推广提供了有力支持。

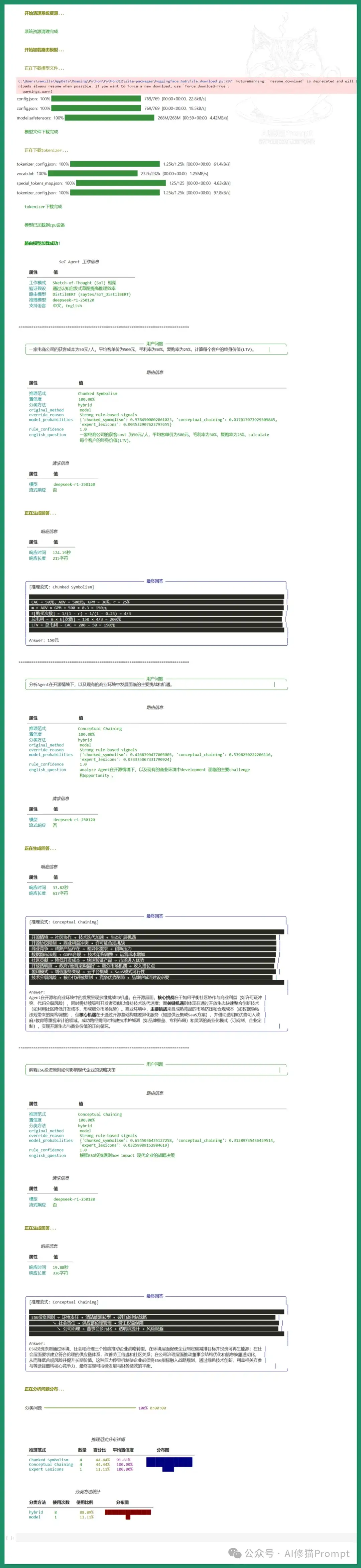

为了展示SoT框架的实际应用价值,我写了一个名为SoT_Agent的智能代理系统。这个系统不仅是对SoT理论的实践验证,更是一个面向实际应用的完整解决方案。

系统的核心是一个轻量级的路由模型,基于DistilBERT实现。这个模型能够智能地分析输入问题的特征,并为其选择最合适的推理范式。这种动态选择机制确保了系统能够以最高效的方式处理各类问题,从简单的数学计算到复杂的概念分析都能得到恰当的处理。

在推理范式的实现上,我精心设计了三种核心模板,每种模板都针对特定类型的问题优化。这些模板不是简单的格式规范,而是融入了认知科学的深刻洞察,能够引导模型生成既简洁又有效的推理过程。

系统的一个显著特点是其多语言处理能力。通过巧妙的设计,系统能够自然处理中英文问题,这种能力不是简单的翻译,而是对不同语言中推理模式的深入理解。

让我们通过一个具体的例子来看看系统的实际表现:

SoT_Agent的架构设计充分体现了SoT框架的核心理念。在设计过程中,修猫特别注重系统的轻量化和灵活性,同时确保了推理过程的高效性和可靠性。

系统的核心是一个基于DistilBERT的路由模块。这个模块不是简单的分类器,而是一个能够深入理解问题特征的智能系统。它能够分析问题的语言结构、逻辑关系和专业特征,从而为每个问题选择最合适的推理范式。这种动态选择机制确保了系统能够以最优的方式处理各类问题。

多语言支持是系统另一个重要特性,论文的研究仅支持德语、英语、意大利语、韩语,缺少对中文的支持,修猫通过精心设计的关键词映射和语言检测机制,系统能够自然地处理中英文问题。这不是简单的翻译对照,而是对不同语言中推理模式的深入理解和适配。

系统的核心功能通过简洁而强大的代码实现。以下是关键组件的实现示例:

class SoT_Agent:

def __init__(self, api_key, base_url, model):

# 初始化路由模型,采用轻量级DistilBERT架构

self.router_model = DistilBertForSequenceClassification.from_pretrained(

"saytes/SoT_DistilBERT",

force_download=True, # 确保使用最新模型

resume_download=True # 支持断点续传

)

# 加载优化后的提示模板和示例

self._load_prompts_and_examples()

这段代码展示了系统初始化的核心逻辑。通过精心设计的参数配置和错误处理机制,确保了系统的稳定性和可靠性。路由模型的加载采用了断点续传机制,这在网络不稳定的环境中特别有价值。

让我们通过一个具体的应用案例,来看看系统在不同场景下的表现:

SoT_Agent的实现充分展现了SoT框架的实用价值。系统的轻量级设计确保了它能够在各种环境中高效运行,而灵活的范式切换机制则保证了处理不同类型问题时的最优性能。完善的错误处理和状态反馈机制更是为系统的实际部署提供了有力保障。

这个实现不仅验证了SoT框架的可行性,更为未来的AI系统设计提供了有益的参考。它展示了如何将理论创新转化为实用系统,如何在追求效率的同时保证系统的可靠性和可扩展性。这些经验对于构建下一代AI推理系统具有重要的启发意义。这项研究计划本周内在我的Agent群内开源。

SoT的创新点:

现有方法的局限:

SoT的优势:

SoT框架的提出标志着大语言模型推理效率优化的一个重要里程碑。通过将人类认知中的"草图"概念巧妙地引入AI推理过程,SoT不仅在技术层面实现了突破,更为重要的是开创了一种全新的思维方式。

最重要的是:这种用小模型路由的方式可能是一个很好的启发,能够有效的解决推理模型资源消耗较大的问题。

Reference:

https://arxiv.org/pdf/2503.05179

https://github.com/SimonAytes/SoT/tree/main

https://huggingface.co/saytes/SoT_DistilBERT

文章来自微信公众号 “ AI修猫Prompt ”

【开源免费】字节工作流产品扣子两大核心业务:Coze Studio(扣子开发平台)和 Coze Loop(扣子罗盘)全面开源,而且采用的是 Apache 2.0 许可证,支持商用!

项目地址:https://github.com/coze-dev/coze-studio

【开源免费】n8n是一个可以自定义工作流的AI项目,它提供了200个工作节点来帮助用户实现工作流的编排。

项目地址:https://github.com/n8n-io/n8n

在线使用:https://n8n.io/(付费)

【开源免费】DB-GPT是一个AI原生数据应用开发框架,它提供开发多模型管理(SMMF)、Text2SQL效果优化、RAG框架以及优化、Multi-Agents框架协作、AWEL(智能体工作流编排)等多种技术能力,让围绕数据库构建大模型应用更简单、更方便。

项目地址:https://github.com/eosphoros-ai/DB-GPT?tab=readme-ov-file

【开源免费】VectorVein是一个不需要任何编程基础,任何人都能用的AI工作流编辑工具。你可以将复杂的工作分解成多个步骤,并通过VectorVein固定并让AI依次完成。VectorVein是字节coze的平替产品。

项目地址:https://github.com/AndersonBY/vector-vein?tab=readme-ov-file

在线使用:https://vectorvein.ai/(付费)

【开源免费】AutoGPT是一个允许用户创建和运行智能体的(AI Agents)项目。用户创建的智能体能够自动执行各种任务,从而让AI有步骤的去解决实际问题。

项目地址:https://github.com/Significant-Gravitas/AutoGPT

【开源免费】MetaGPT是一个“软件开发公司”的智能体项目,只需要输入一句话的老板需求,MetaGPT即可输出用户故事 / 竞品分析 / 需求 / 数据结构 / APIs / 文件等软件开发的相关内容。MetaGPT内置了各种AI角色,包括产品经理 / 架构师 / 项目经理 / 工程师,MetaGPT提供了一个精心调配的软件公司研发全过程的SOP。

项目地址:https://github.com/geekan/MetaGPT/blob/main/docs/README_CN.md

【开源免费】LangGPT 是一个通过结构化和模板化的方法,编写高质量的AI提示词的开源项目。它可以让任何非专业的用户轻松创建高水平的提示词,进而高质量的帮助用户通过AI解决问题。

项目地址:https://github.com/langgptai/LangGPT/blob/main/README_zh.md

在线使用:https://kimi.moonshot.cn/kimiplus/conpg00t7lagbbsfqkq0