不怕推理模型简单问题过度思考了,能动态调整CoT的新推理范式SCoT来了!

SCoT,即自结构化推理链(Self-structured Chain of Thought )。

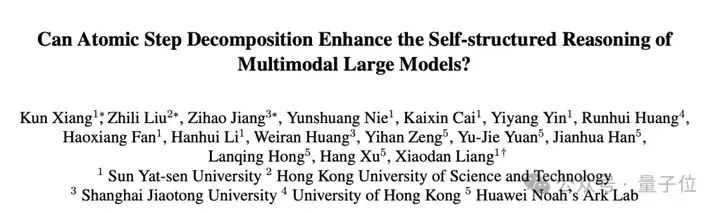

它通过将推理过程分解为最小语义原子步骤,能动态生成适配不同复杂度问题的CoT结构,解决了现有方法在推理多样性和效率上的不足。

另外,为了激发推理能力,研究人员还提出了AtomThink,这是一个包含数据构造、训练、推理和评估的全过程框架,用来提升多模态大模型在复杂推理任务上的表现。

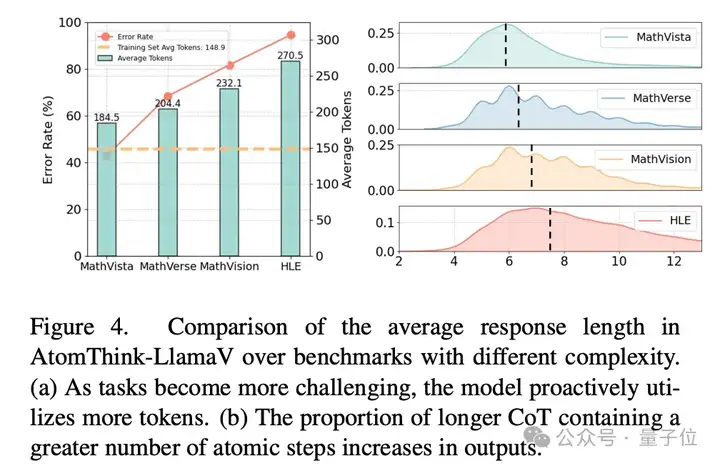

实验中,SCoT使模型能根据问题复杂度自动调整推理链长度,复杂问题的推理步骤更长。

在多个数据集上,AtomThink框架显著提升了基线模型的准确率,数据利用效率和推理效率也表现出显著优势。

并且,原子能力评估揭示了多模态模型在不同推理能力上的分布特征,为理解多模态推理模式提供了新视角。

这项研究由来自中山大学、香港科技大学、上海交通大学、香港大学、华为诺亚方舟实验室的研究人员联合提出,以下是更多细节。

当前,结构化和非结构化CoT面临一定的挑战。

现有方法或依赖于固定模板的结构化推理,或采用自由形式的非结构化推理,存在如推理行为单一、需要人工设计模版、计算效率低下或在简单问题上过度思考的问题。

因此,团队提出两个假设:

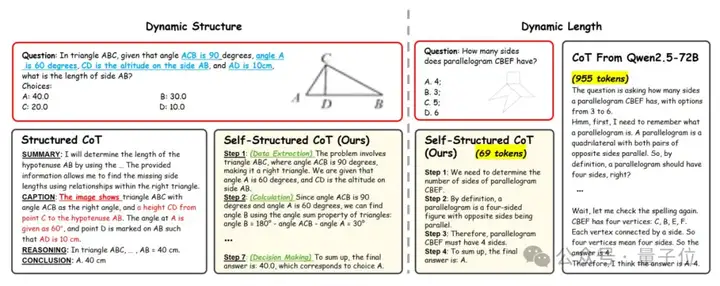

为了为具有不同复杂性的问题动态生成适当的推理结构,团队引入了自结构化思维链(SCoT)和一个全过程训推框架AtomThink。

其中自结构化思维链(SCoT),即作者提出将推理过程分解为最小语义单元——原子步骤,并通过多轮预测方法动态生成推理链。

模型每次仅预测一个原子步骤,并将其附加到历史推理步骤中,作为下一轮推理的输入。

为应对模型推理异常(如重复、停滞等),引入基于规则的过滤机制和温度累积策略,以增强推理的多样性和流畅性。

AtomThink框架则包含四个关键模块:

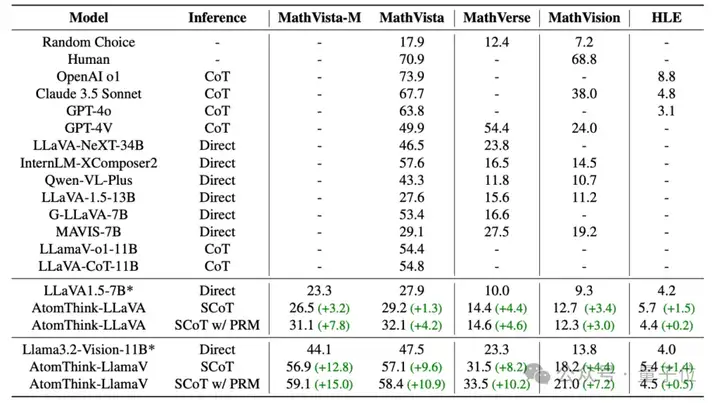

研究团队选取不同规模的LLaVA1.5-7B和Llama3.2-Vision-11B作为基线模型,使用AMATH-SFT数据集进行微调,并在MathVista、MathVerse、MathVision和Humanity’s Last Exam基准数据集上进行评估。

实验设置包括直接推理、普通推理链(CoT)、自结构化推理链(SCoT)以及结合过程奖励模型(PRM)的SCoT推理。

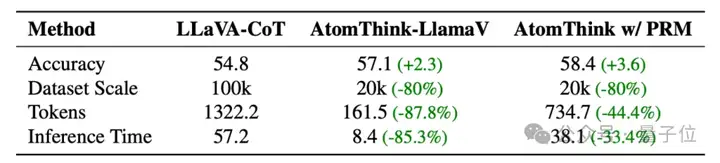

在MathVista、MathVerse和MathVision数据集上,AtomThink框架显著提升了基线模型Llama3.2-Vision-11B的准确率,分别提高10.9%、10.2%和7.2%。

与现有结构化CoT方法相比,AtomThink在准确率、数据利用效率和推理效率上均表现出显著优势,在准确率超越LLaVA-CoT的条件下数据利用效率提升5倍,推理效率提升85.3%。

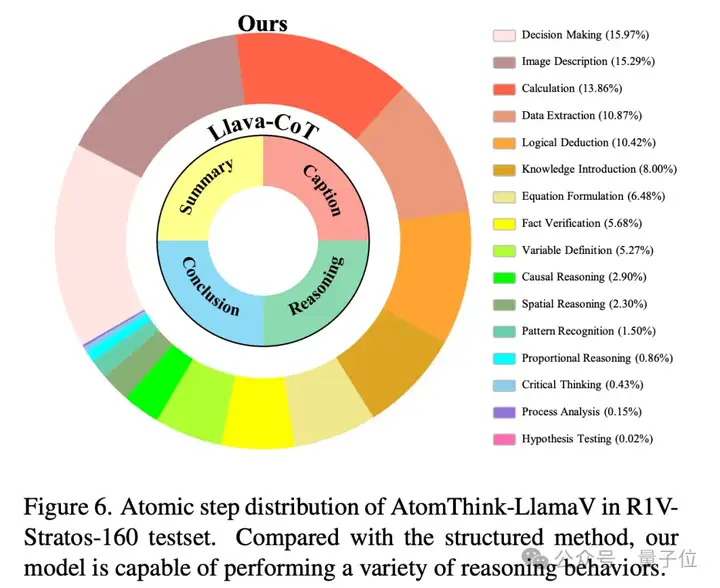

另外,与结构化方法相比,SCoT能够动态生成更多样化的推理结构,涵盖图像描述、数据提取、逻辑推理、因果推理等多种能力。

模型还能够根据问题复杂度自动调整推理链长度,复杂问题的推理步骤更长,表现出自适应的深度探索能力。

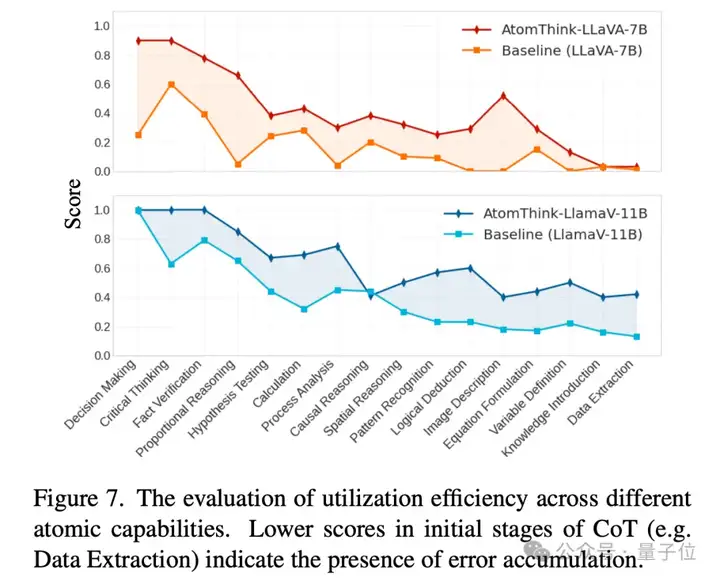

为了评估推理模型对于不同中间步骤的利用能力,团队提出了一个新颖的评估方式。

首先通过聚类GPT-4o的推理行为来生成原子步骤分布集合(包含16种行为),构建历史步骤后进行rollout来计算对最近步骤的利用效率。

通过原子能力评估发现模型存在推理误差累计现象,在CoT早期阶段(如数据提取和图像描述)开始继承推理的错误率较高,提示未来工作需关注推理初期的质量控制。

论文:https://arxiv.org/pdf/2503.06252

开源仓库:https://github.com/Quinn777/AtomThink

文章来自于“量子位”,作者“SCoT团队”。

【免费】ffa.chat是一个完全免费的GPT-4o镜像站点,无需魔法付费,即可无限制使用GPT-4o等多个海外模型产品。

在线使用:https://ffa.chat/

【开源免费】XTuner 是一个高效、灵活、全能的轻量化大模型微调工具库。它帮助开发者提供一个简单易用的平台,可以对大语言模型(LLM)和多模态图文模型(VLM)进行预训练和轻量级微调。XTuner 支持多种微调算法,如 QLoRA、LoRA 和全量参数微调。

项目地址:https://github.com/InternLM/xtuner